人工智能(AI)在军事行动中引发前所未有的不确定性,这在AI赋能的自主武器系统(AWS)与决策支持系统(DSS)中尤为显著——其不仅影响关键战场决策,更带来新颖且不可预测的风险。尽管部分风险可预先研判管控,但因系统运行环境的复杂性、动态性与对抗性,诸多风险仍具固有性与不可避免性。即便秉持善意的AI操作员,在严格审查与谨慎部署后仍可能面临不可预见的平民伤亡事件。实践中,此类事件多被定性为"事故",即国际人道法(IHL)预期容忍的战争现实。

本文质疑该假设,主张通过迭代方法可缓解(若非预防)先验不可预测的AI失效。该方法通过系统整合部署后评估洞见,使决策者能更新对现实使用中暴露的边界案例及其他"已知未知项"的认知,为未来AI部署提供关键依据。我们提出由两项互补机制——"部署迭代审查"与"部署迭代评估"——构成的迭代评估框架。该框架代表管理不确定性并最小化军事AI使用中平民伤亡的最佳实践。初始事故虽或难免,但通过结构化迭代流程(含报告、分析与适配),其复现率可显著降低。致力于负责任运用军事AI者应将该框架嵌入作战规划与法律合规的核心环节。

关键词:不确定性;人工智能(AI);事故;自主武器系统;决策支持系统;可预测性;武器审查;国际人道法

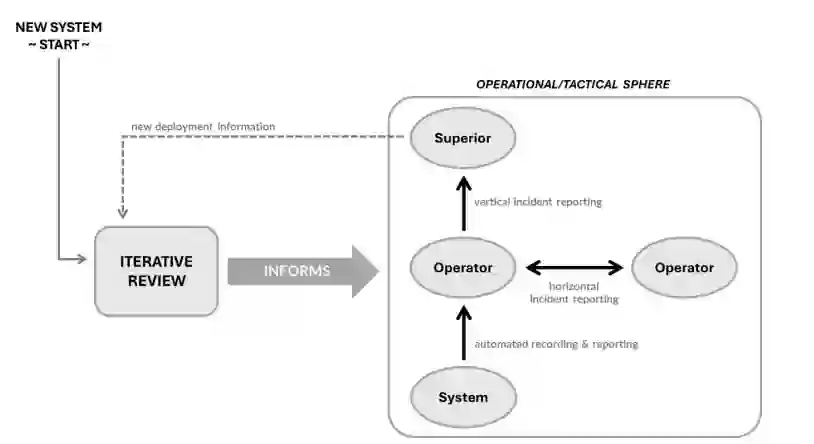

图1:迭代评估的可视化操作指南

随着人工智能(AI)日益深入军事行动,使用者将面临加剧的不确定性、不可预测风险及系统脆弱性。诸多挑战仅在事后显现——即失效已导致平民伤亡等人道损害后。实践中此类事件常被归为"不可避免的事故",作为战争必然副产品被容忍。本文挑战此假设,提出"迭代评估框架"作为军队在动态作战环境中主动缓解AI相关平民伤害的最佳实践方案。该框架基于两大基石:一方面承认军事AI失效初期或难避免,决策者无法预知不可知之事;另一方面强调国际人道法(IHL)精神要求交战方采取一切可行措施防止可预知风险的伤害重演。为此,迭代评估框架引入双层机制以支持快速自适应缓解新兴AI风险。

本文结构如下:第2节剖析AI系统的高度不可预测性如何削弱传统质控与风险缓解机制预防重复失效的效能;第3节半技术性解析AI不确定性的多元来源,论证多数源于技术固有属性——故无法单靠技术手段消除,亦不能通过先验预防完全解决。为应对此挑战,本文倡导采纳迭代思维:将IHL义务持续贯彻于全周期而非孤立节点。基于此理念,第4-5节分别探讨迭代评估在武器审查与目标锁定阶段的应用;第6节整合模型为可视化操作指南;第7节提出将迭代评估嵌入军事实践的关键建议。

需先行阐明迭代评估框架的性质与目标:刻意选用"框架"而非"规范"或"原则",因其非法定约束性义务(尤其IHL严格解释下),而是决策者在AI研发、测试与部署中可采纳的结构化措施集,其核心是迭代优化哲学。该框架既非激进创新——诸多建议已存于当代军事条令与学术研究;核心挑战亦非概念新颖性,而在作战与后勤现实约束下的持续落实。同时应承认其局限:无法消除所有不确定性(此乃军事行动固有特征),但能通过预防可避免伤害强化IHL遵约。本质上,它旨在减少因决策者缺失理论上可知信息(而非鲁莽行事)导致的伤害。

本文预设AI使用者秉持善意,力求遵守IHL并负责任管理不确定性;假定所有IHL要求的测试、审查及攻击预防义务均已履行;不涉及恶意场景(如故意部署未经验证的"黑箱系统")。迭代评估旨在补充而非替代这些IHL基础义务。核心论点是:即使传统IHL要求完全满足,采纳迭代路径仍有持续改进空间。