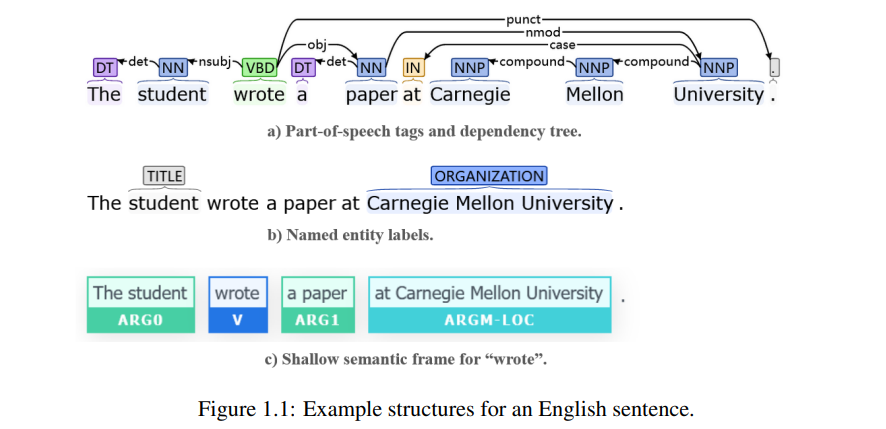

在自然语言处理(NLP)中,许多任务涉及结构化预测:预测由一组相互依赖的变量组成的结构化输出。这允许从非结构化的原始文本中提取有用的信息,这对于人类和机器的下游任务和分析都有益处。为了获得自动化模型,主要范式是以数据驱动的监督学习方式进行。在这个范式中,主要的瓶颈是手动注释数据的可用性,这通常是昂贵且耗时的。此外,我们通常希望将模型扩展到各种新场景,比如不同的领域或语言。如果训练实例不足以涵盖目标场景,模型性能可能会显著下降,而在所有这些新情况下注释大量数据实例是昂贵且低效的。 为了减轻这个问题并减少结构化预测模型对大量注释的依赖,我们需要考虑模型和数据两个方面,这是数据驱动机器学习的主要驱动力。与这些核心方面相关,我们探讨了三个方向。首先,我们研究模型设计中的结构化建模,其中涉及如何对复杂的结构化输出进行建模和预测。这对于结构化预测任务特别重要,因为这些任务通常具有大的输出空间。此外,在模型和数据的交互方面,我们研究了迁移学习,其中利用相关数据来帮助低资源的目标任务。在这种情况下,如何设计更不受源数据和目标数据之间差异影响的模型对于迁移的成功也至关重要。最后,我们探讨主动学习,重点关注数据本身。当资源有限时,很难获得大量注释的实例,但注释一小部分实例是可行的。通过选择信息量丰富的实例集的策略,可能只需要较少的手动注释就可以实现令人满意的性能。

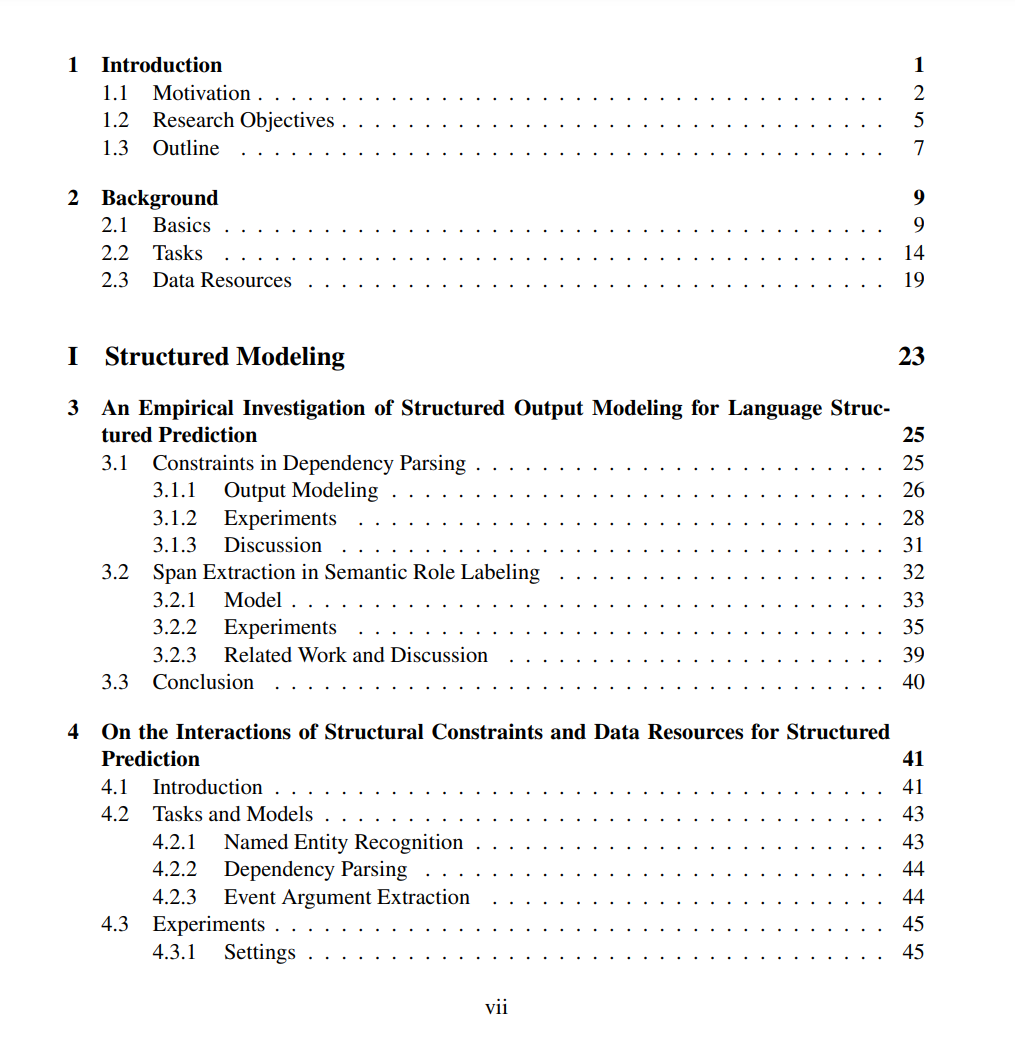

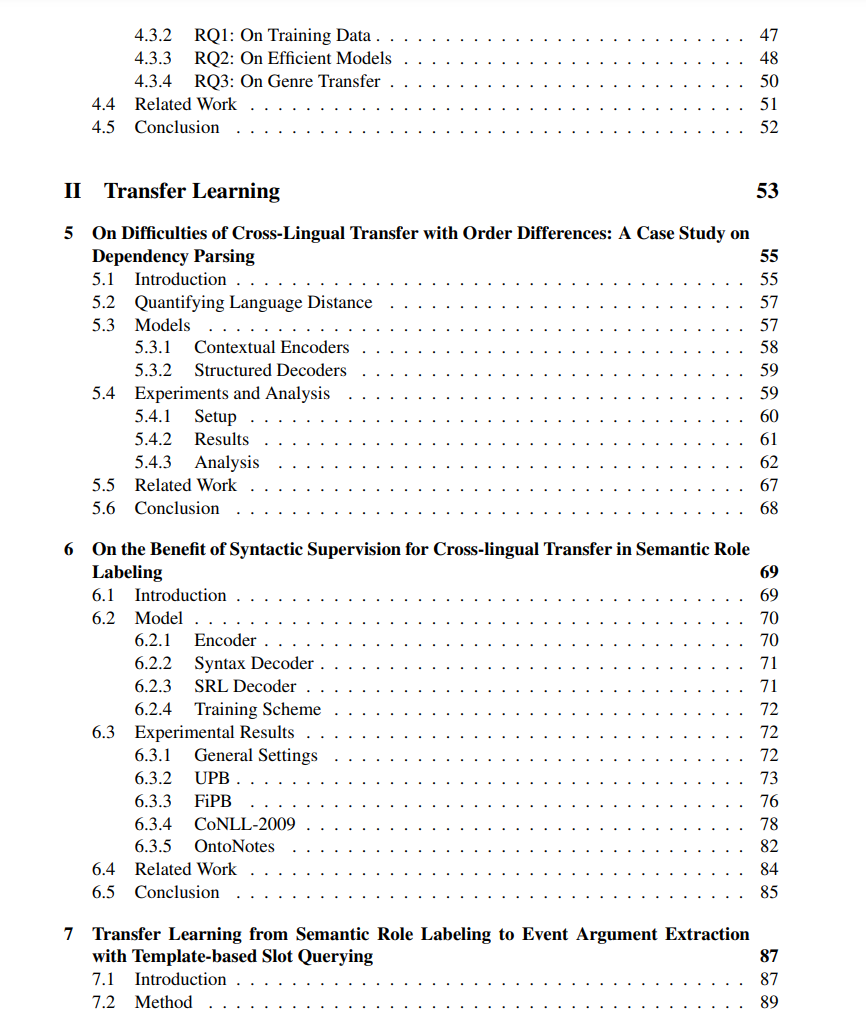

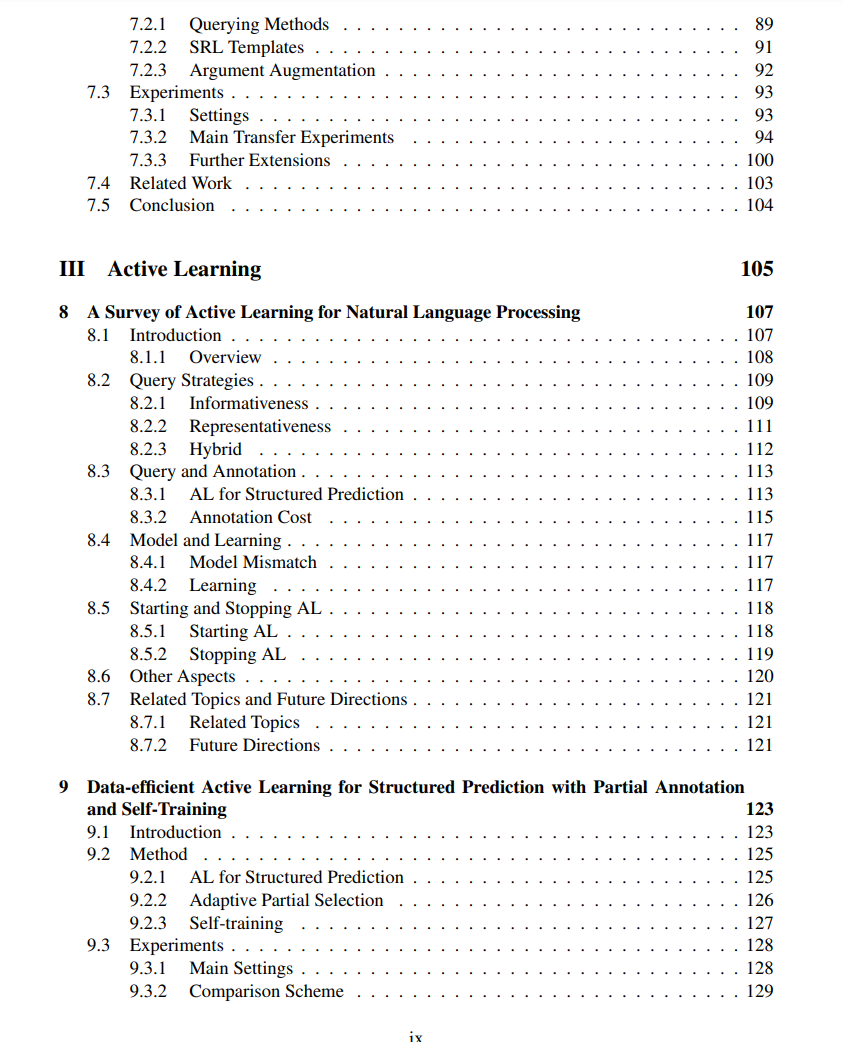

这篇论文包括三个部分,对应这三个方向。在第一部分中,我们研究了深度神经模型中结构化输出建模的影响。我们发现,结构化建模在句子级别的完全匹配和更高效的模型方面带来了好处。我们进一步将分析扩展到低资源情景,并研究结构约束与训练数据规模之间的交互作用。在第二部分中,我们研究了一系列相关的结构化任务,并发现来自相关数据的监督,例如来自相同任务但不同语言(跨语言学习)以及来自相关任务(多任务学习)的监督,可以是有益的,尤其是在利用那些对源数据和目标数据差异关注较少的模型时。最后,在第三部分中,我们对NLP中的结构化预测进行了系统的主动学习研究。特别是,我们分析了使用部分结构进行注释和学习的有效性,这可以提高主动学习的数据效率。此外,我们展示了将主动学习与使用主动学习数据池中未标记实例的自训练相结合,可以带来进一步的改进。