题目: Value-laden Disciplinary Shifts in Machine Learning

简介:

随着机器学习模型越来越多地用于高风险决策,学者们试图进行干预以确保这些模型不会对不受欢迎的社会和政治价值观进行编码。然而,到目前为止,很少有人关注价值观如何影响整个机器学习学科。价值观如何影响学科的重点和发展方式?如果不希望的值在规程级别上起作用,那么对特定模型的干预将不足以解决问题。相反,需要纪律层面的干预。

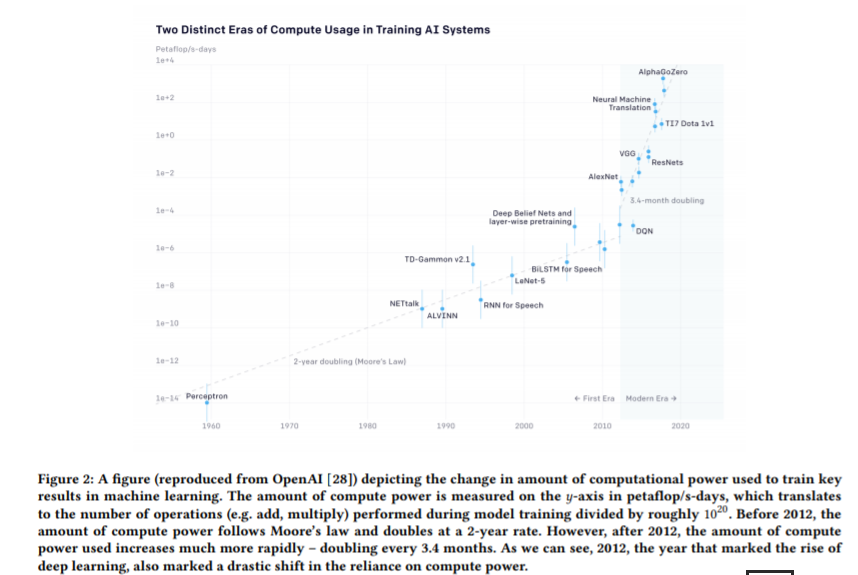

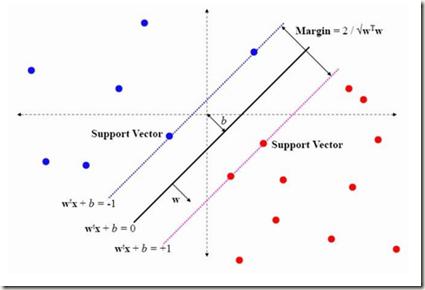

本文从科学哲学的角度来分析机器学习这门学科。我们开发了一个概念框架来评估机器学习模型(如神经网络、支持向量机、图形模型)占据主导地位的过程。模型类型的兴起和衰落常常被描述为客观的过程。然而,这种学科转变更加微妙。首先,我们认为模型类型的兴起是自我强化——它影响模型类型的评价方式。例如,深度学习的兴起与对计算量和数据量丰富的环境中评估的更大关注交织在一起。其次,模型类型的评估方式编码了社会和政治价值。例如,在计算量丰富和数据量丰富的环境中,对评估的更大关注对权力、隐私和环境关注的集中化的价值观进行了编码。

作者简介:

Ravit Dotan主要从事认识论、科学哲学和机器学习哲学。主要研究兴趣的是证据的概念、价值在推理中的作用以及理论选择。次要兴趣是女权主义和社会哲学。特别感兴趣的是分析合法婚姻的制度及其对边缘群体的影响,了解什么是“种族”和“性别”。

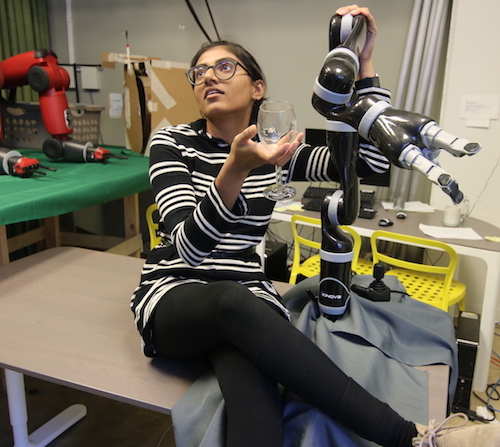

Smitha Milli是加州大学伯克利分校EECS三年级的博士生,师从Anca Dragan和Moritz Hardt。目前是Twitter META的实习生。研究重点是建立更符合价值的ML系统,即使面对人类的“非理性”、交互和适应。

成为VIP会员查看完整内容

相关内容

专知会员服务

38+阅读 · 2020年5月30日

专知会员服务

77+阅读 · 2020年2月8日

专知会员服务

126+阅读 · 2019年11月16日

Arxiv

10+阅读 · 2020年3月12日