获取高质量数据是科学和工程中的一大挑战。数据收集,无论是通过大规模在线调查还是精心进行的实验室实验,往往成本高、耗时且受限于资源有限。因此,设计最佳实验以收集信息丰富且有价值的数据,对于资源的有效分配以及最终做出更好的决策至关重要。

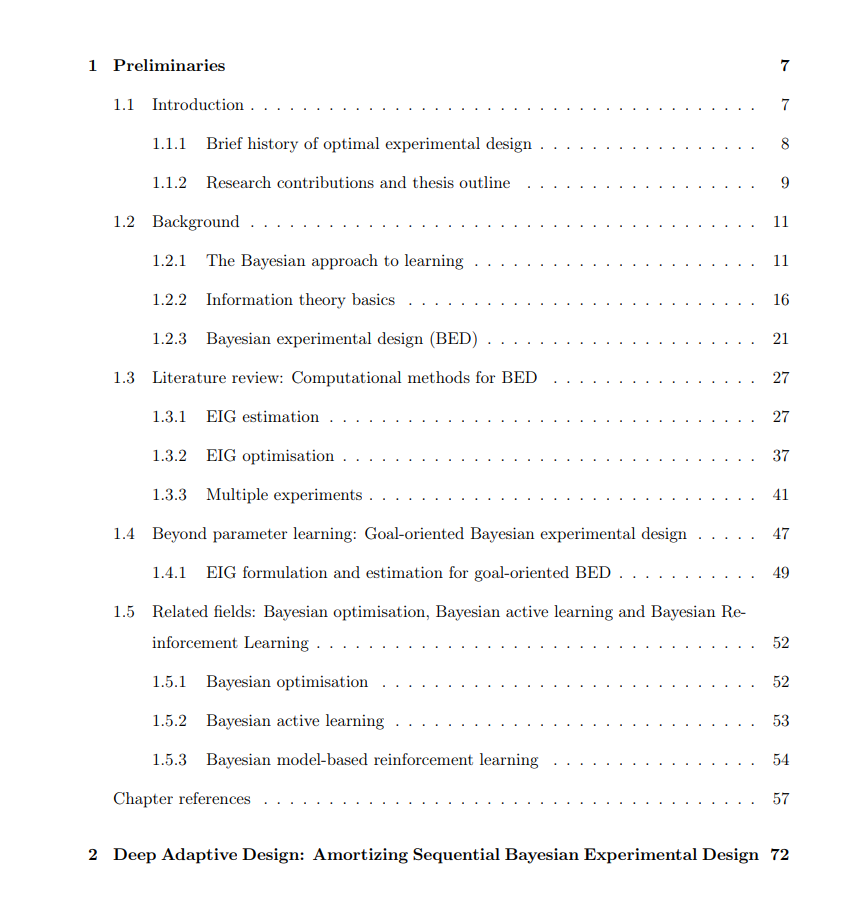

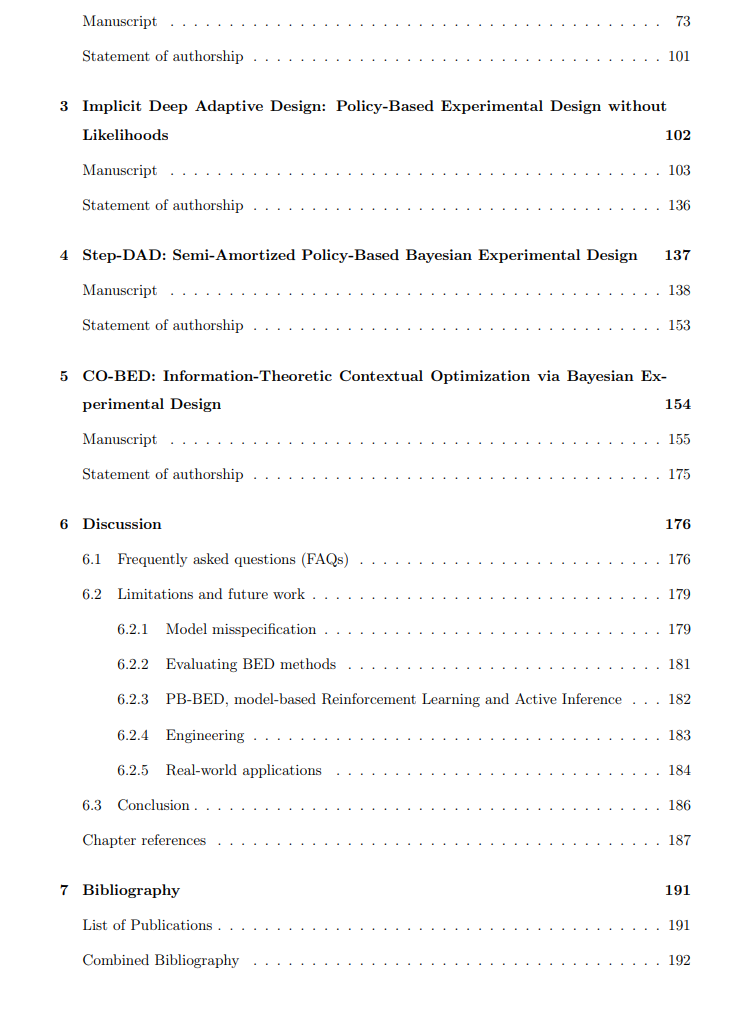

贝叶斯实验设计(BED)提供了一个原则性数学框架,用于设计实验以高效学习感兴趣的现象。本论文聚焦于信息论的贝叶斯实验设计,采用期望信息增益(EIG)作为设计标准。最大化 EIG 确保收集到的数据对于潜在的科学问题或假设是最具信息量的。这一方法有潜力显著提高数据采集的质量和效率,从而解决高成本、时间限制和资源有限等关键挑战。 尽管潜力巨大,BED 的实际应用历来受到显著计算挑战的限制。主要挑战在于计算 EIG,对于大多数现实问题而言,这是不可行的。此外,自适应实验设计利用从先前实验中获得的信息来指导后续实验的设计,这进一步增加了计算复杂性。 本论文专注于开发可扩展且计算效率高的贝叶斯实验设计方法,以克服这些挑战。我们引入了一种新方法称为基于策略的贝叶斯实验设计(PB-BED),它利用深度学习充分摊销自适应实验设计的成本,实现实时设计决策。此外,我们还引入了一种半摊销的方法,允许在实验过程中根据实际收集到的数据对设计策略进行定期优化。这种方法增强了 PB-BED 框架的适应性和稳健性,确保随着新信息的收集,设计策略保持最佳状态。 最后,我们引入了一个统一的与模型无关的框架,用于利用信息论原则设计大规模的上下文实验。本论文的贡献代表了朝着自动化和可靠的实验设计策略迈出的一步,这些策略有潜力加速科学发现,改善各个领域的数据驱动决策。 数据在现代世界中扮演着关键角色,成为科学发现和工业进步的基础。近年来,基于大型数据集训练的复杂统计模型被越来越多地用于以自动化和自主的方式指导决策过程(Araujo et al., 2020; Bogert et al., 2021; Adlung et al., 2021)。然而,用于训练这些模型的数据质量和相关性可能差异显著。数据集可能受到噪声、冗余或偏见的影响,或者可能不直接适用于特定的任务。当模型在次优数据上进行训练时,它们往往会继承甚至加剧其中存在的偏见和局限性。结果,模型可能产生偏见的分析和预测,这可能导致误导性的结论和糟糕的后续决策(Barocas and Selbst, 2016; Corbett-Davies et al., 2017; Ntoutsi et al., 2020; Paullada et al., 2021; Mehrabi et al., 2021; Budach et al., 2022)。因此,高质量和相关数据在现代数据驱动的环境中是一项无价的资产(Hutchinson et al., 2021; Paleyes et al., 2022; Priestley et al., 2023)。 在某些情况下,数据完全由外部来源生成,无法控制数据获取过程,必须按原样使用现有数据。然而,在许多情况下,有机会影响数据获取过程,从而有可能提高收集数据的质量。这些机会包括仔细选择调查问题、为药物发现试验选择有前景的化合物、对实验室设备进行校准以实现精确测量,以及在机器学习任务中战略性地选择注释数据点。这些可控变量为最大化获取数据的有效性和质量提供了关键机会。这个受控的数据获取过程可以通过最优实验设计的视角进行形式化(Fisher, 1935; Ryan and Morgan, 2007)。在这项工作中,我们采用贝叶斯实验设计的方法(Lindley, 1956; Chaloner and Verdinelli, 1995; Ryan et al., 2016; Rainforth et al., 2024),因为它提供了一个统一、连贯且自洽的框架。贝叶斯实验设计(BED)是一个基于模型的框架,能够有效整合所有可用信息,使其在多步骤自适应实验设置中尤其有利,在这些设置中,决策是随着不完整信息的顺序进行的。这使得对模型进行一致的更新成为可能,确保每个决策都与对实验系统的不断演变的理解相一致。

相关内容

牛津大学是一所英国研究型大学,也是罗素大学集团、英国“G5超级精英大学”,欧洲顶尖大学科英布拉集团、欧洲研究型大学联盟的核心成员。牛津大学培养了众多社会名人,包括了27位英国首相、60位诺贝尔奖得主以及数十位世界各国的皇室成员和政治领袖。2016年9月,泰晤士高等教育发布了2016-2017年度世界大学排名,其中牛津大学排名第一。