从数据中纯粹发现因果模型的结构面临可识别性问题。

通常情况下,如果没有关于数据生成的假设,多个等效模型可能会同样解释观察结果,尽管它们可能会得出截然不同的因果结论。因此,选择它们中的任意一个元素可能会导致不安全的决策,特别是在这些模型与世界真实运作方式不一致时。因此,在数据有限的情况下,必须保持一种关于我们可能候选模型的认知不确定性,以减轻这些不匹配模型所带来的风险。 从贝叶斯的角度来看,这种不确定性可以通过给定数据的模型后验分布来捕捉。

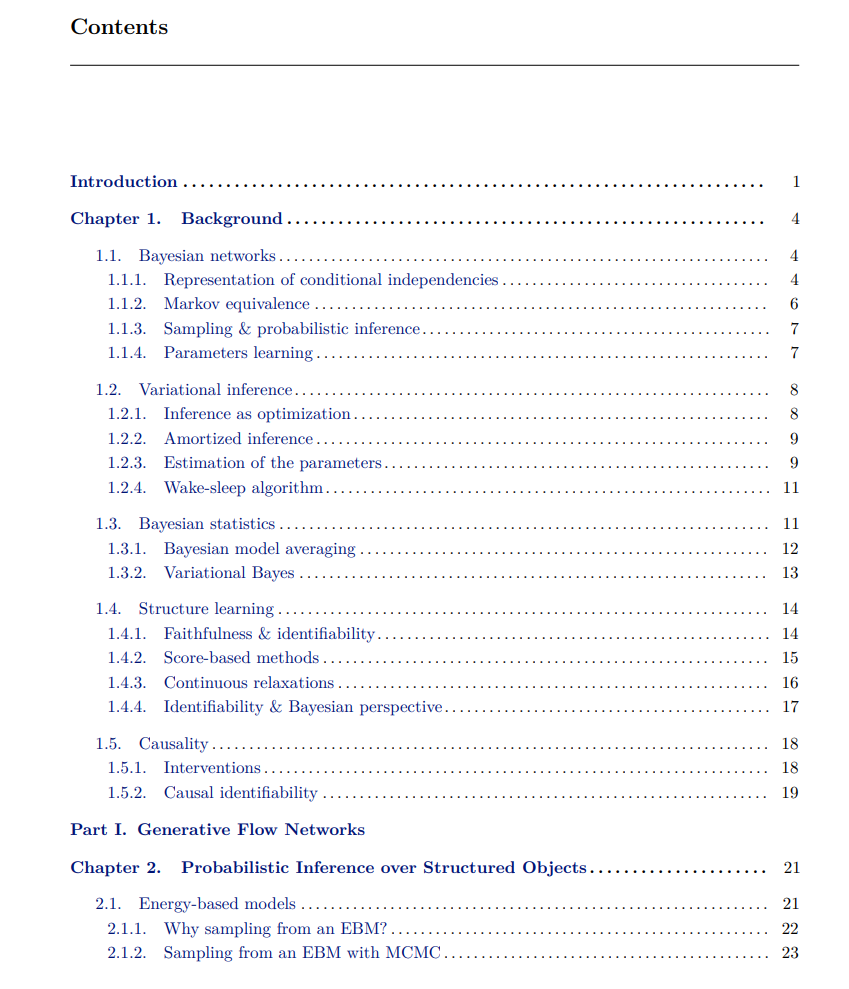

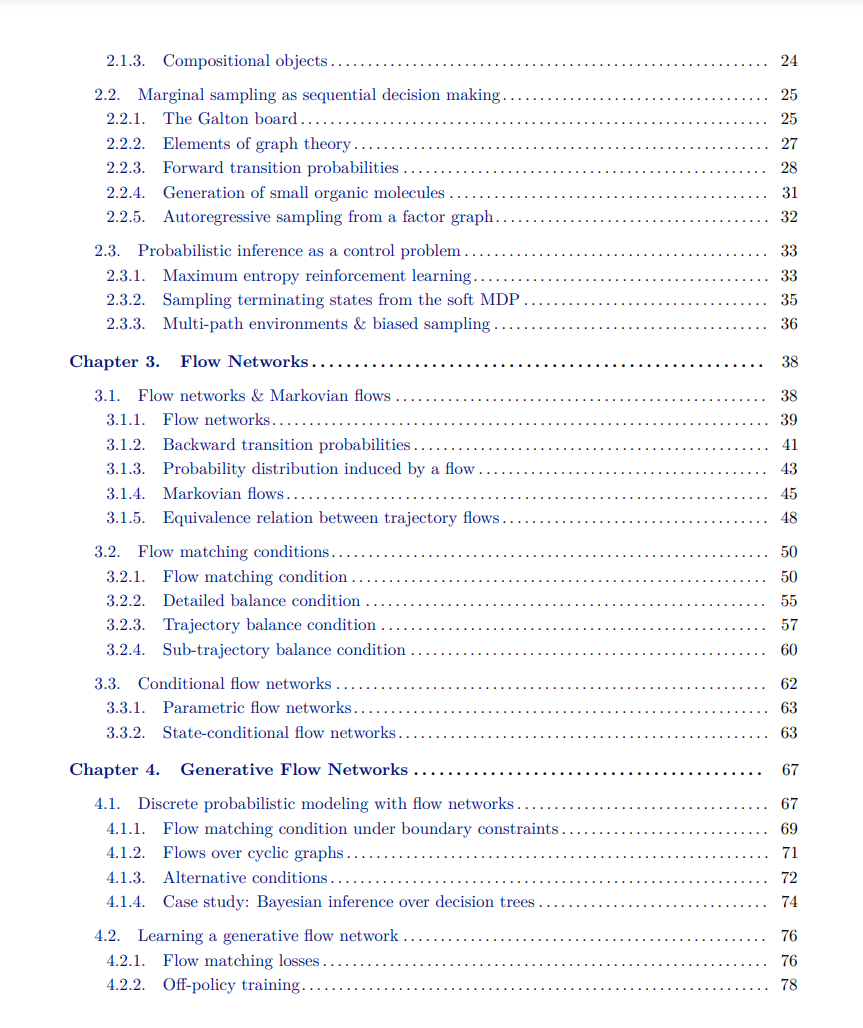

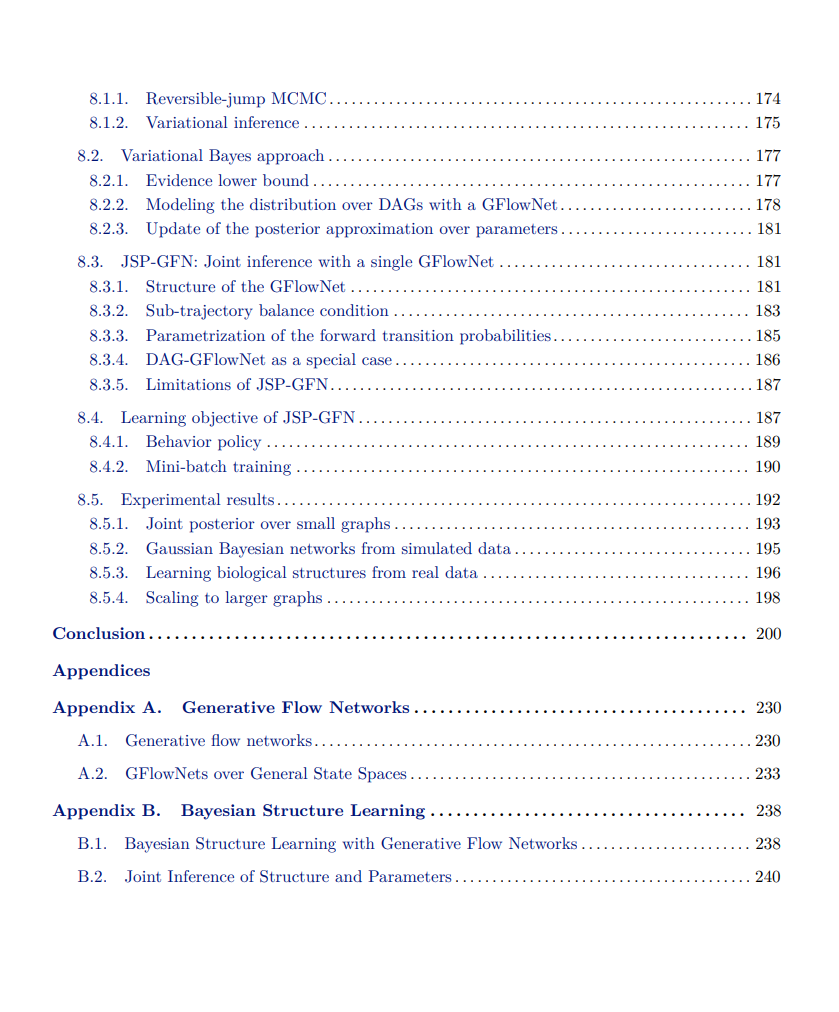

然而,正如贝叶斯推断中的许多问题一样,由于可能的结构数量庞大(这些结构通常表示为有向无环图,DAG),后验分布通常是不可解的。因此,需要进行近似。尽管过去十年中,生成建模领域取得了显著进展,尤其是由变分推断和深度学习强力结合推动的进展,但大多数这些模型都集中于连续空间,使得它们不适用于涉及离散对象(如有向图)的问题,因为这些对象存在高度复杂的无环性约束。 在本论文的第一部分,我们介绍了生成流网络(GFlowNet),一种专门为离散和组合对象(如图)上的分布而设计的新型概率模型。

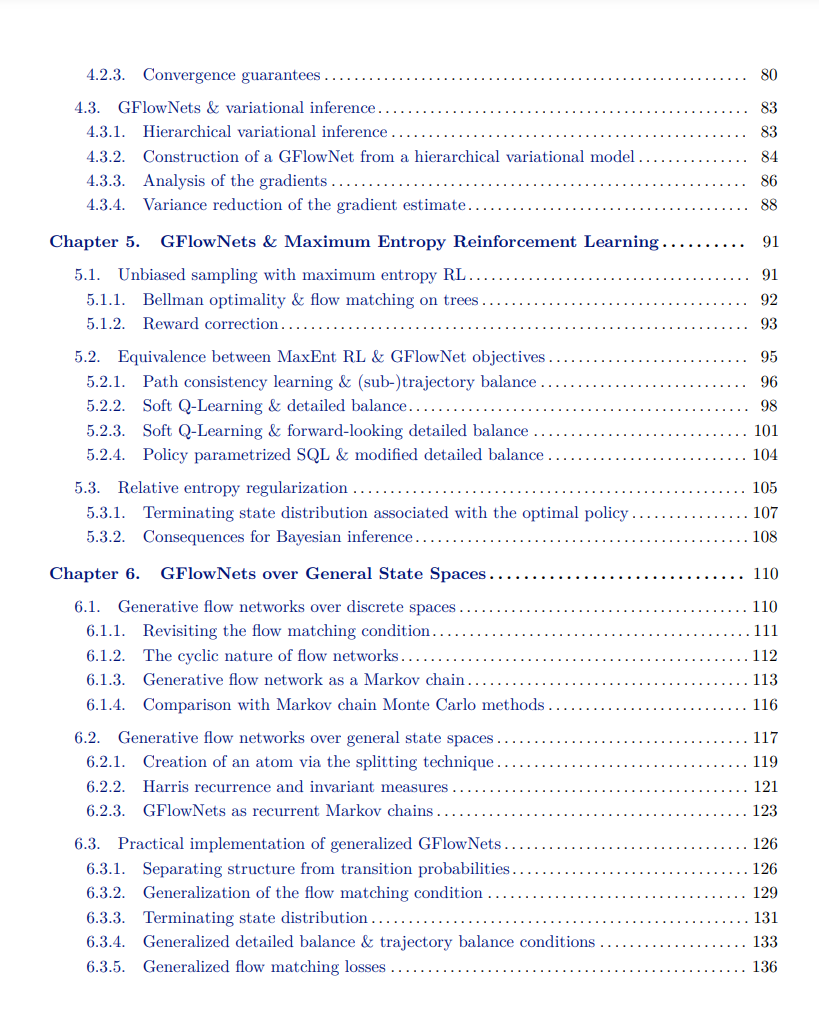

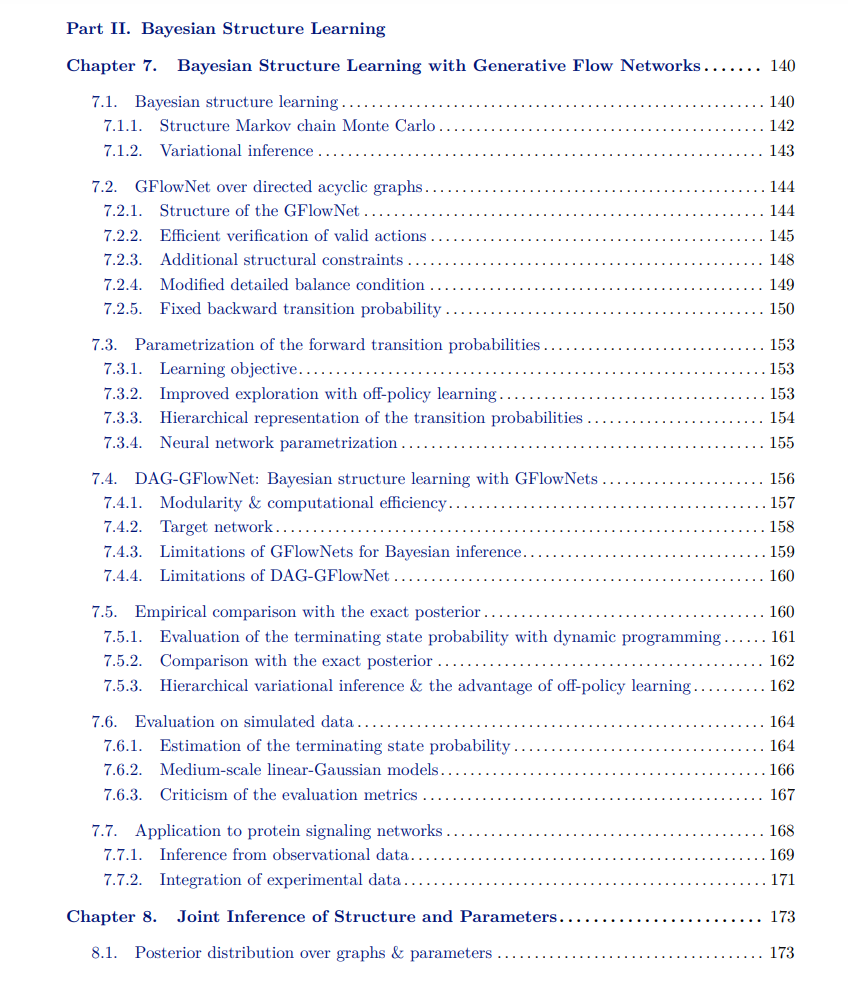

GFlowNet将生成过程视为一个顺序决策问题,通过逐步构建样本来生成数据。这些模型通过在网络中强制执行某些流量的守恒,来描述通过一个归一化常数定义的分布。我们将重点介绍它们如何根植于机器学习和统计学的各个领域,包括变分推断和强化学习,并讨论它们在一般空间中的扩展。 在本论文的第二部分,我们展示了如何利用GFlowNet来近似给定数据的贝叶斯网络的DAG结构的后验分布。

不仅仅是结构,我们还展示了条件分布的参数也可以被集成到由GFlowNet近似的后验中,从而允许对贝叶斯网络进行灵活的表示。 关键词:生成流网络,贝叶斯推断,结构学习,贝叶斯网络,强化学习,变分推断

成为VIP会员查看完整内容

相关内容

Arxiv

190+阅读 · 2023年4月7日