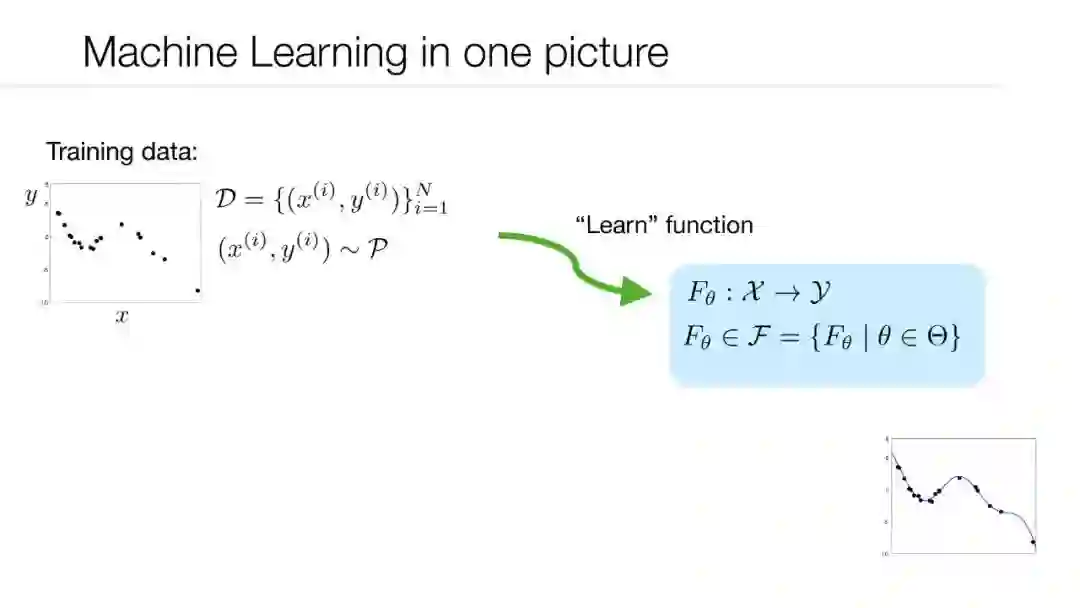

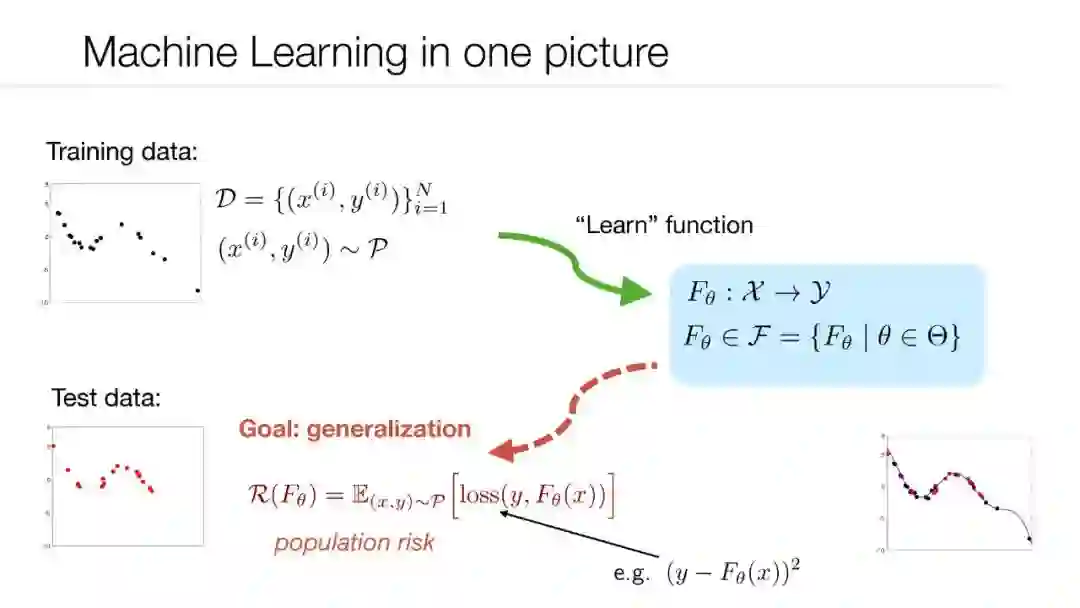

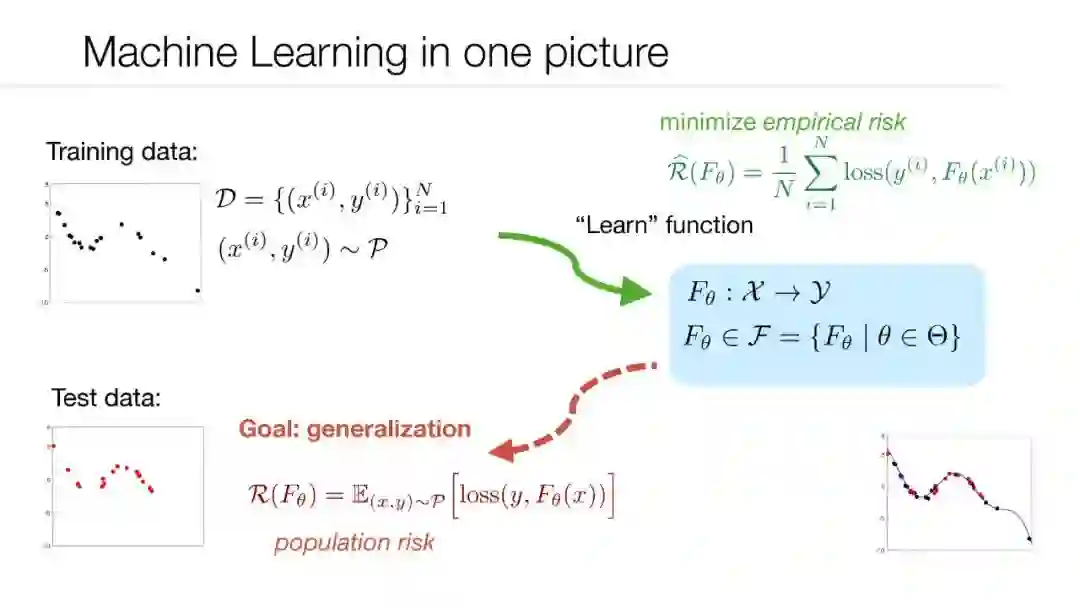

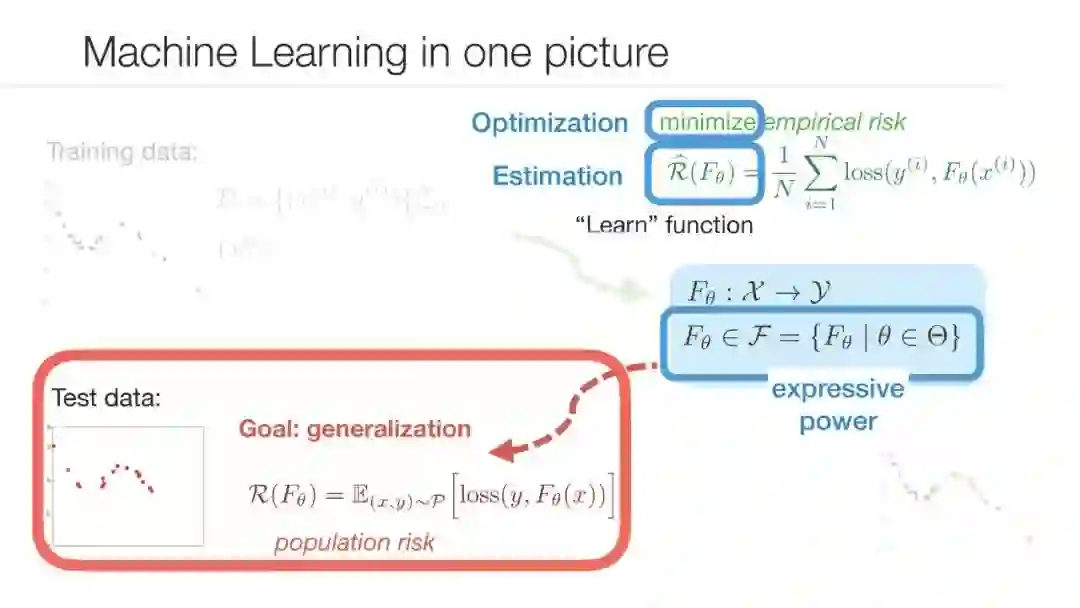

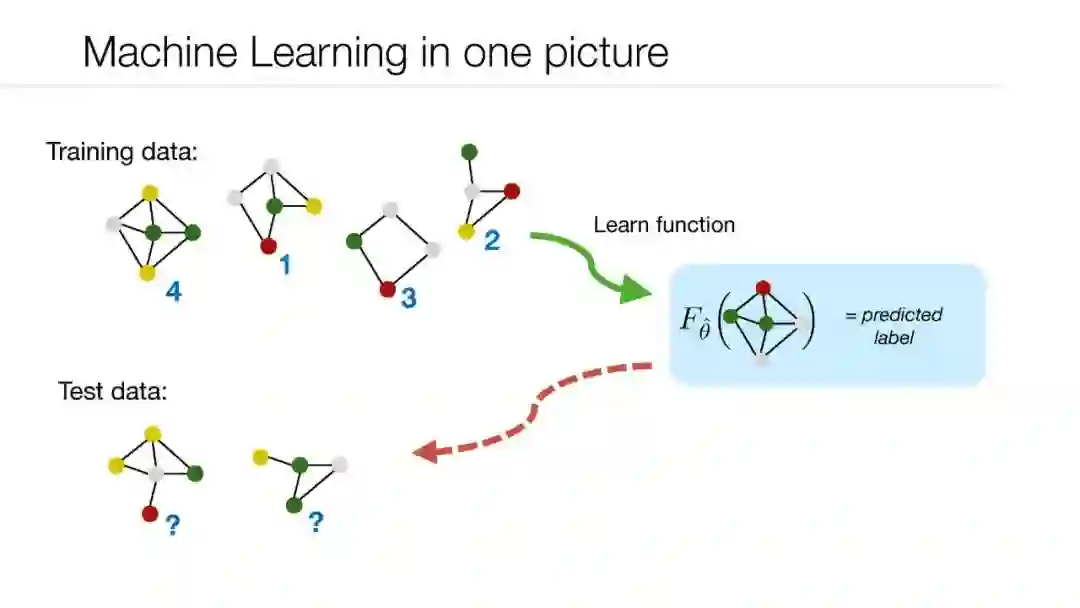

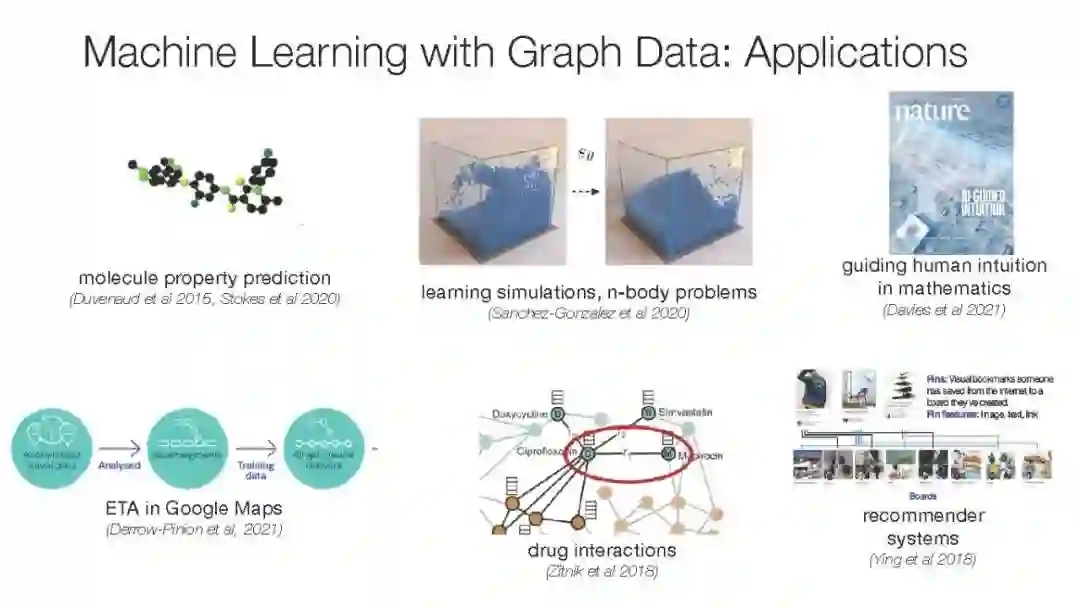

图神经网络(GNNs)是一种神经网络架构,旨在学习从图到向量空间的映射。由于它们在实践中的成功,它们已经成为节点、图和点配置预测任务的流行机器学习模型。在本次演讲中,我们总结了关于广泛使用的消息传递GNN和高阶GNN的近似和学习特性的最新理论成果,重点关注函数近似、估计和泛化以及外推。一路上,我们接触了各种各样的联系,包括图同构、等变函数、局部算法和动态规划。

https://www.youtube.com/watch?v=W4-K9-wZkVA

Stefanie Jegelka是麻省理工学院EECS系X-Window联盟职业发展副教授,也是计算机科学和人工智能实验室(CSAIL)的成员。在加入麻省理工学院之前,她是加州大学伯克利分校的博士后研究员,并在苏黎世联邦理工学院和马克斯普朗克智能系统研究所获得博士学位。Stefanie曾获得斯隆研究奖学金、国家科学基金会职业奖、DARPA青年教师奖、德国模式识别奖和ICML最佳论文奖。她的研究兴趣横跨算法机器学习的理论和实践,包括离散和连续优化,离散概率和结构化数据学习。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2022年12月22日