1 引言

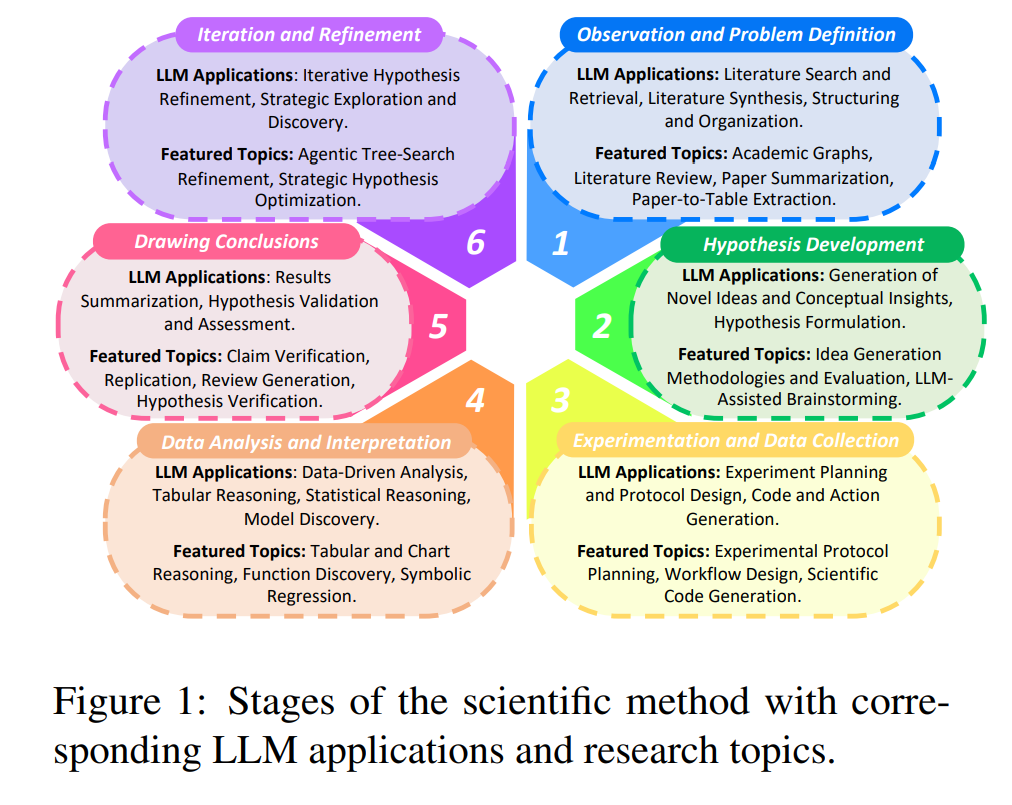

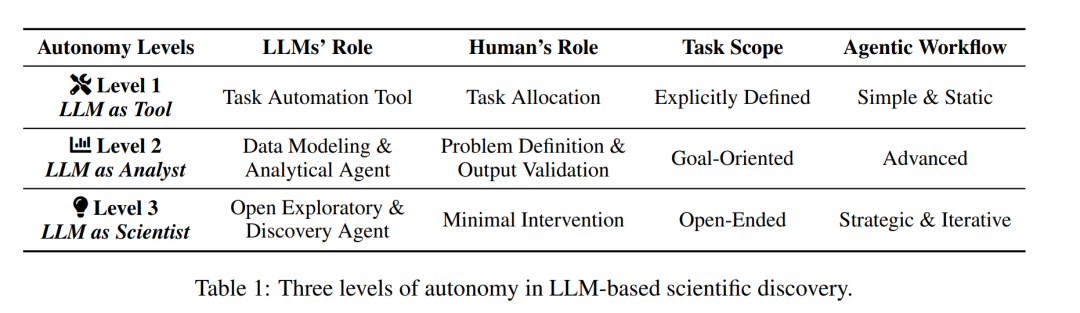

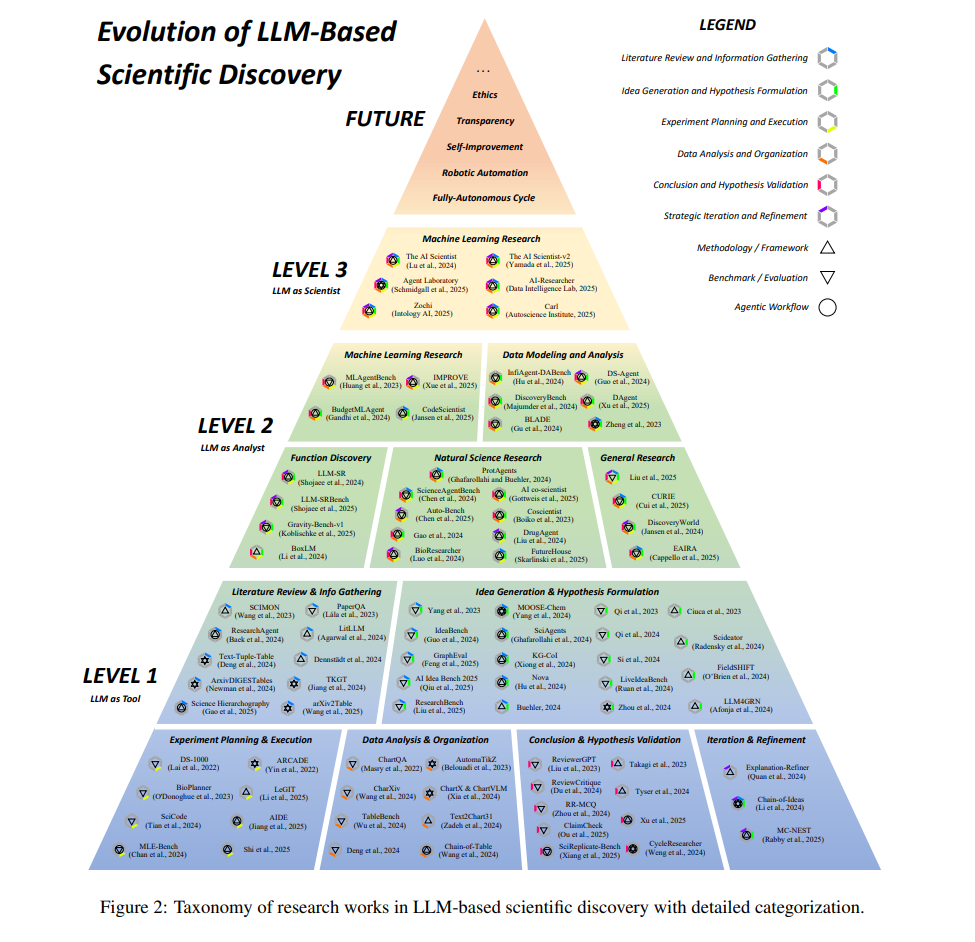

大型语言模型(LLMs)的持续进步催生出一系列新兴能力,如规划(Huang 等,2024b)、复杂推理(Huang 和 Chang,2023)以及指令遵循(Qin 等,2024)。此外,将代理型工作流(agentic workflows)整合进来,使得基于LLM的系统能够执行更高级的功能,包括网页导航(He 等,2024)、工具使用(Qu 等,2025)、代码执行(Jiang 等,2024a)和数据分析(Sun 等,2024)。在科学发现领域,这种高级LLM能力与代理机制的融合正推动一场深刻的范式转变。该转变不仅有望加速科研生命周期,还将从根本上改变人类研究者与人工智能在知识探索中的协作关系。 然而,LLM应用的迅猛扩展及其在科学发现中所引发的范式变化,也带来了诸多挑战。LLM演化速度之快,以及其与复杂科研流程的深度融合,使得系统性的评估愈发困难,因此亟需结构化的概念框架来整理当前认知,并指引未来发展方向。尽管现有综述已对LLM在多个科学领域的应用进行了有价值的概览(Zhang 等,2024, 2025),或对科学中的特定AI技术进行了分类(Luo 等,2025;Reddy 和 Shojaee,2025),但它们往往聚焦于特定学科的应用,或仅呈现LLM能力的静态快照。因此,这些综述可能忽略了LLM自主性不断增强的关键趋势,以及其在整个科学方法流程中角色的动态演变,从而未能充分揭示其影响力的广度与未来向更高独立性演进的潜力。 为系统描绘这一演进图景,并弥补上述空白,本文的分析框架以经典科学方法的六个阶段(见图1)为基础(Popper,1935;Kuhn,1962):(1)观察与问题定义,(2)假设提出,(3)实验与数据收集,(4)数据分析与解释,(5)得出结论,(6)迭代与优化。我们对LLM在这些阶段中的应用进行分析,发现一个显著趋势:LLM正从在单一阶段执行离散的、面向任务的功能,逐步发展为能贯穿多个阶段的复杂代理型系统。值得注意的是,最新研究(Schmidgall 等,2025;Yamada 等,2025)正在探索几乎能够自主完成整个科学流程的LLM系统。 为了更有效地捕捉与描述LLM能力与独立性日益增强的演化路径,本文提出一个基础性的三层级分类框架(见表1),用于定义LLM在科学发现中的不同角色:(i)工具型LLM(LLM as Tool):模型在直接监督下完成具体、明确的任务,辅助人类研究者;(ii)分析者型LLM(LLM as Analyst):模型具备更高的自主性,能够处理复杂信息、执行分析并提供洞见,减少人工干预;(iii)科学家型LLM(LLM as Scientist):代表更高级阶段的系统,能够自主执行从假设构建到结果解释及提出后续研究方向等主要科研流程。 在此分类体系基础上,我们进一步识别出当前研究格局中的关键空白,并提出未来发展的核心挑战与方向,包括:(1)实现无需人工干预的全自主科学发现流程;(2)将机器人自动化引入实验室,实现物理世界的交互与操作;(3)基于以往研究经验实现持续的自我改进与适应;(4)提升LLM主导科研的透明度与可解释性;(5)建立符合伦理与社会价值的治理机制。解决上述多维挑战,将是实现AI作为科学探索变革性合作伙伴的关键。

本文聚焦于LLM系统在科学发现中的应用,特别是其不同层级的自主性。虽然我们承认LLM在科学中的广泛影响,但本文有意缩小研究范围,不涵盖通用科学LLM或面向特定领域的知识获取与推理模型——这类内容已在现有综述中有较充分的探讨(Zhang 等,2024, 2025)。本文其余部分结构如下:第2节介绍我们的分类框架及其与科学方法的对应关系;第3节分析“工具型LLM”的应用,按科学方法各阶段分类;第4节探讨“分析者型LLM”的应用,按科学领域划分;第5节聚焦于“科学家型LLM”的研究,分析其创意生成与优化机制;第6节讨论未来面临的挑战与发展方向。