机器学习需要多样化的训练数据集才能取得良好效果。在不同国家/公司之间共享数据集往往涉及法律和隐私问题。联邦学习是一种学习框架,其中的数据集分布在不同的智能体上,可以在不集中数据的情况下对复杂数据集进行训练。每个智能体根据自己的数据集进行本地训练,模型更新则集中进行。尽管这一过程看似安全,但由于每个智能体都可以任意操纵更新,因此引发了许多安全问题。目前的文献强调了攻击最终模型的可能方法。本论文主要关注有针对性的攻击,其目标是对数据集中的选定标签进行错误分类。论文将研究主要的攻击和防御策略,最后提出一种基于通用对抗网络(GAN)的新攻击。GAN 攻击可以破坏并穿过服务器防御机制,这说明了在实施这些机制时可能出现的问题。最后,研究并讨论了提高联邦学习安全性的可能思路。

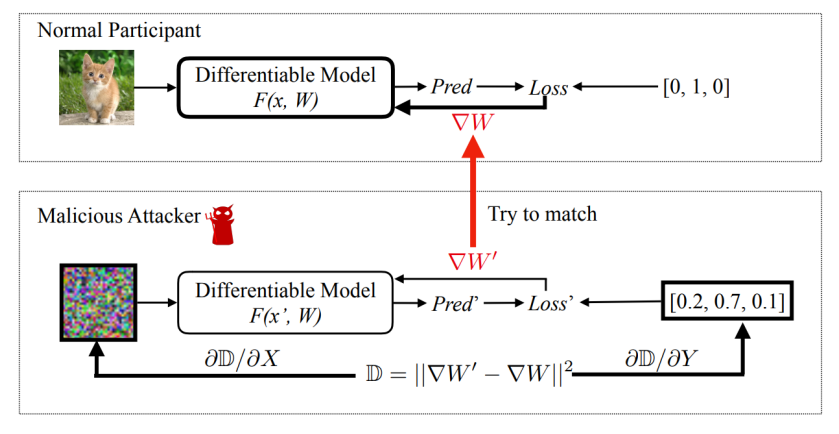

图 2.1: 梯度深层渗漏(DLG) 算法概览。需要更新的变量用粗体边框标出。正常参与者使用其私人训练数据计算 W 以更新参数,而恶意攻击者则更新其虚拟输入和标签,以最小化梯度距离。优化结束后,恶意用户可以从诚实的参与者那里获得训练集。[1]

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2023年12月9日

Arxiv

223+阅读 · 2023年4月7日