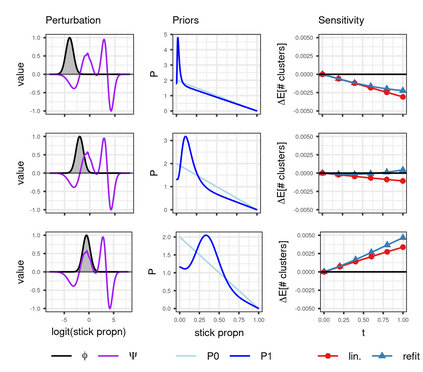

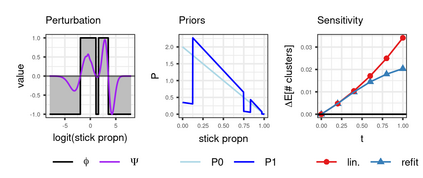

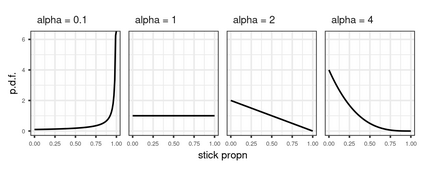

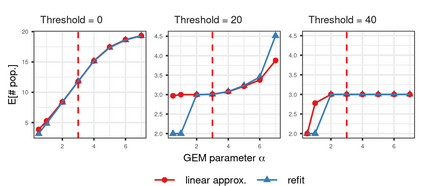

Bayesian models based on the Dirichlet process and other stick-breaking priors have been proposed as core ingredients for clustering, topic modeling, and other unsupervised learning tasks. Prior specification is, however, relatively difficult for such models, given that their flexibility implies that the consequences of prior choices are often relatively opaque. Moreover, these choices can have a substantial effect on posterior inferences. Thus, considerations of robustness need to go hand in hand with nonparametric modeling. In the current paper, we tackle this challenge by exploiting the fact that variational Bayesian methods, in addition to having computational advantages in fitting complex nonparametric models, also yield sensitivities with respect to parametric and nonparametric aspects of Bayesian models. In particular, we demonstrate how to assess the sensitivity of conclusions to the choice of concentration parameter and stick-breaking distribution for inferences under Dirichlet process mixtures and related mixture models. We provide both theoretical and empirical support for our variational approach to Bayesian sensitivity analysis.

翻译:根据Drichlet进程和其他破碎的前题,提出了基于Drichlet进程和其他前题的Bayesian模型,作为集群、专题建模和其他不受监督的学习任务的核心要素。然而,先前的规格对于这些模型来说比较困难,因为其灵活性意味着先前选择的后果往往相对不透明。此外,这些选择可对后推推推产生重大影响。因此,对稳健性的考虑需要与非对称模型相结合。在本文件中,我们通过利用以下事实来应对这一挑战:变异的Bayesian方法,除了在适当的复杂非参数模型中具有计算优势外,还产生对Bayesian模型的参数和非参数方面的敏感度。特别是,我们展示了如何评估结论对选择浓度参数的敏感性,以及如何在Drichlet工艺混合物和相关混合物模型下对误判的误判分配。我们对Bayesian敏感度分析的变异方法提供理论和经验支持。