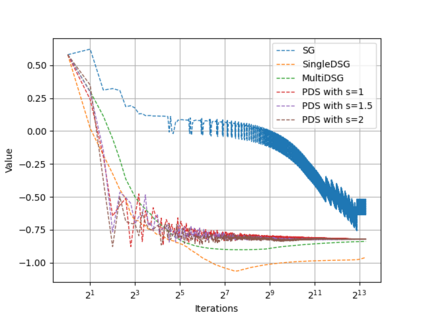

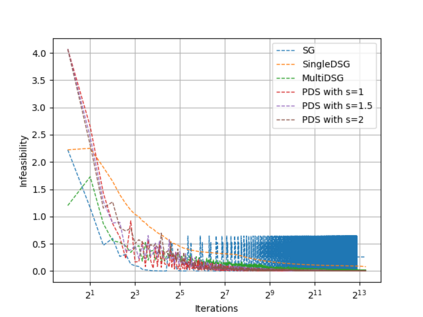

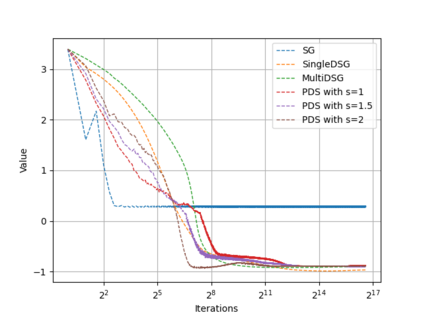

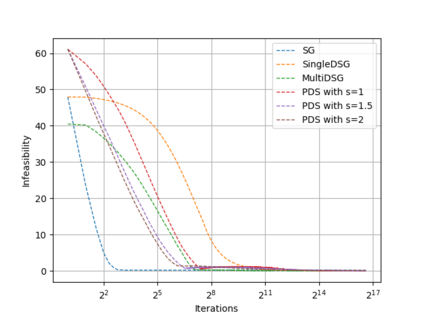

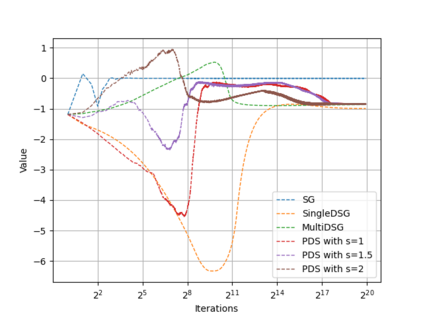

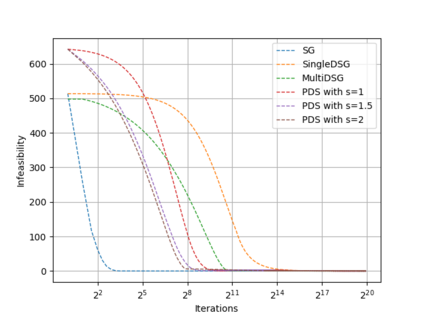

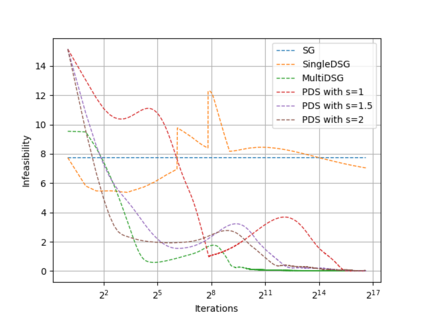

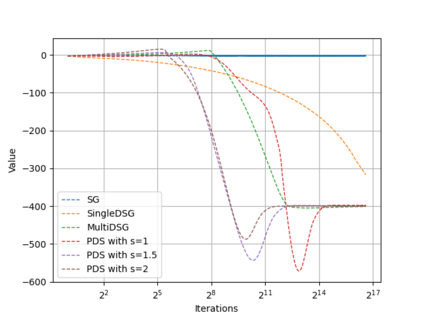

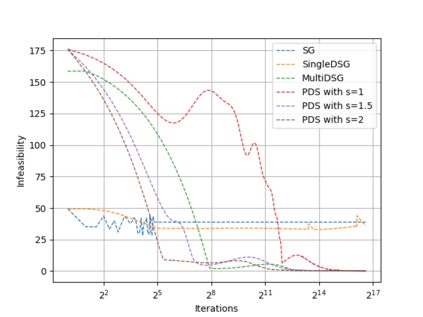

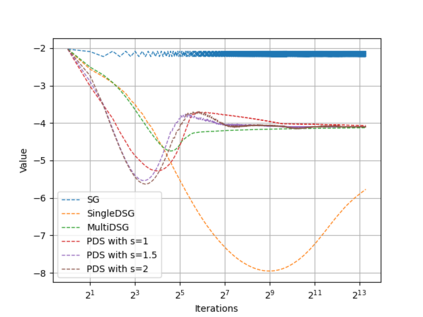

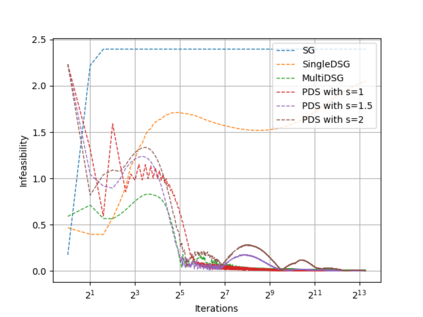

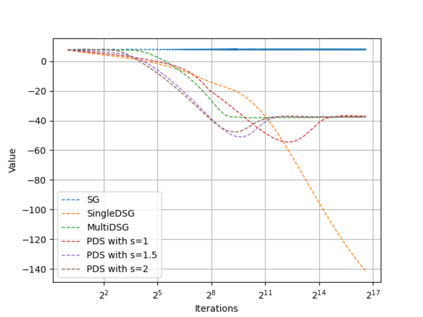

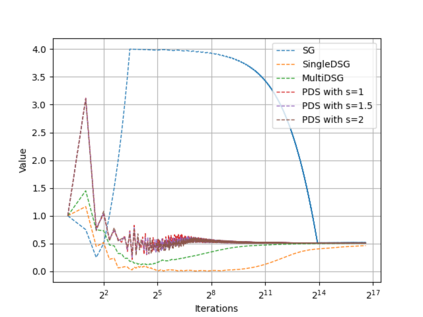

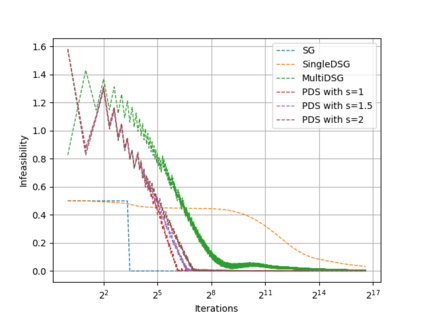

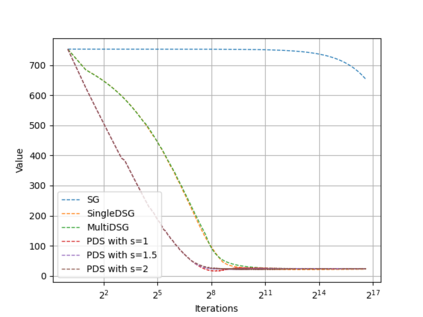

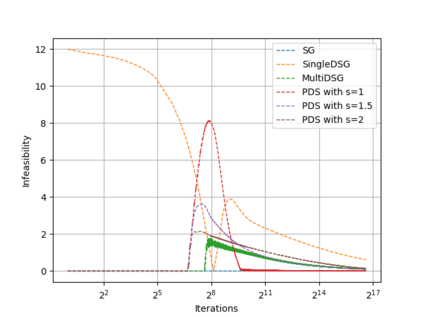

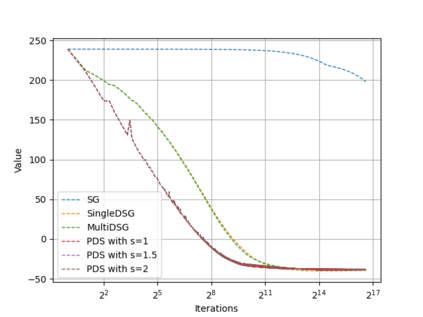

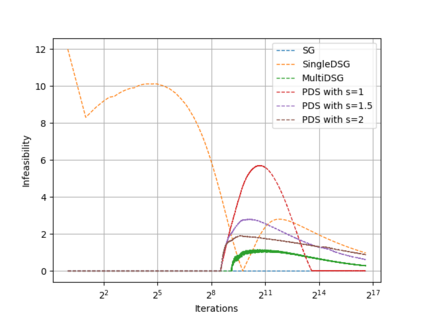

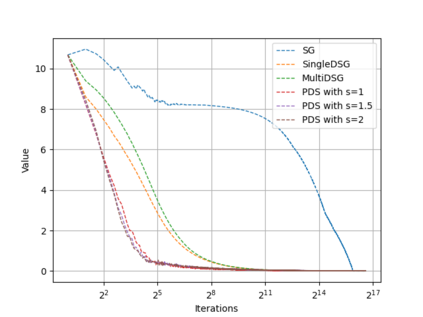

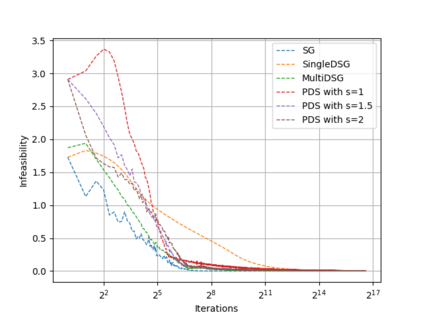

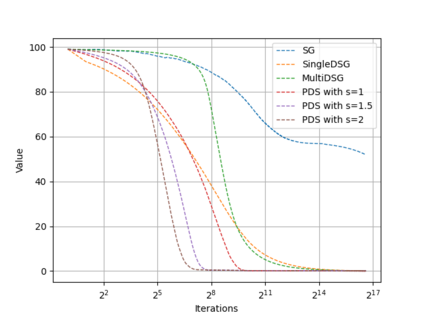

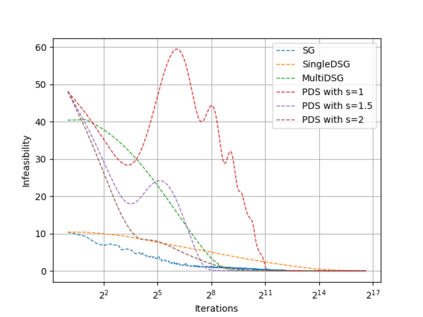

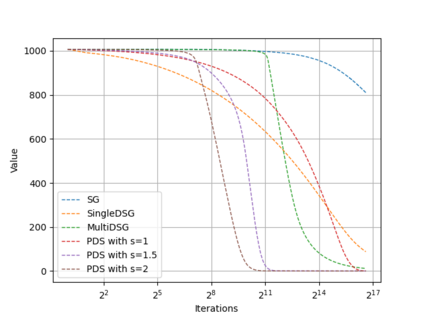

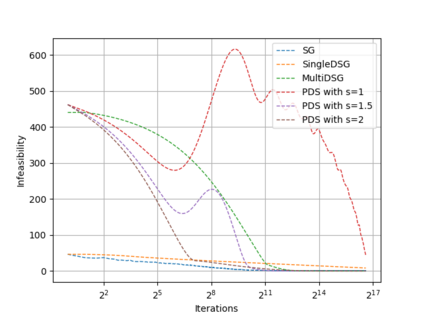

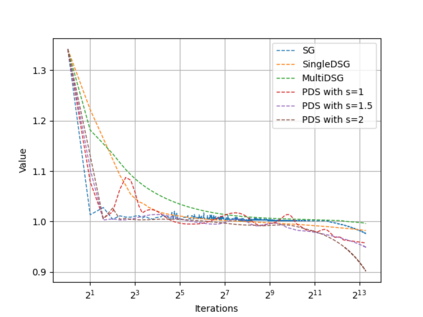

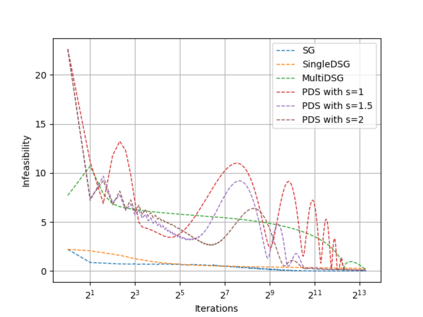

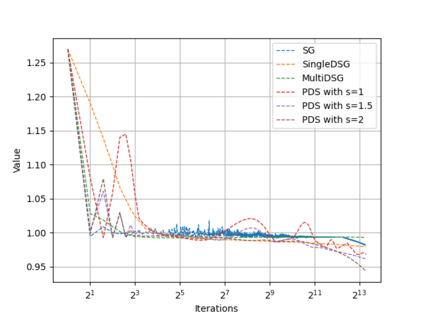

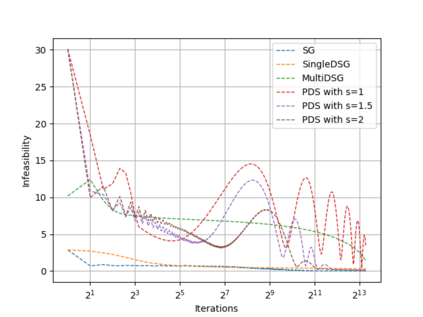

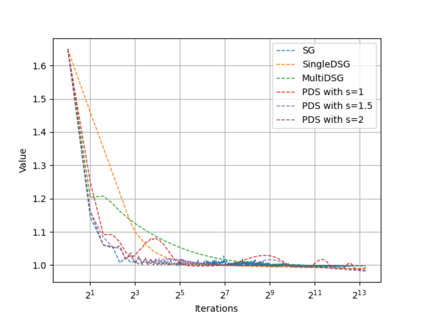

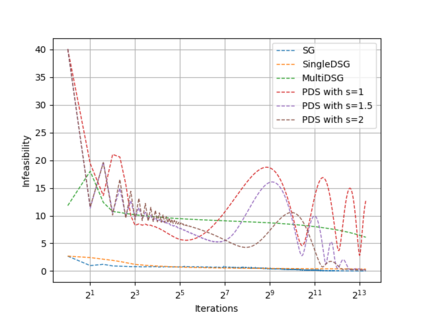

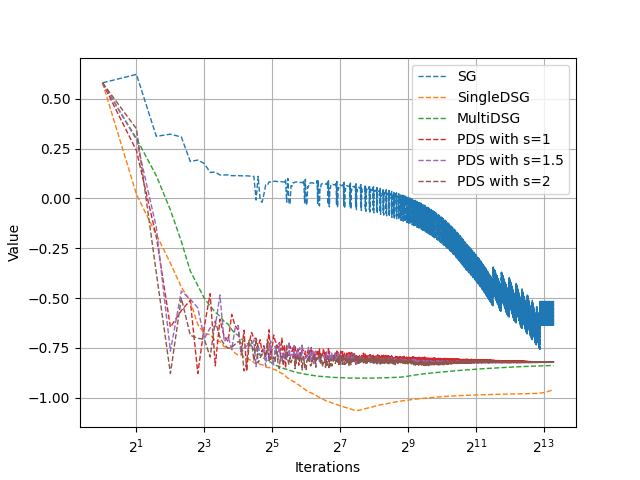

We provide a dual subgradient method and a primal-dual subgradient method for standard convex optimization problems with complexity $\mathcal{O}(\varepsilon^{-2})$ and $\mathcal{O}(\varepsilon^{-2r})$, for all $r> 1$, respectively. They are based on recent Metel-Takeda's work in [arXiv:2009.12769, 2020, pp. 1-12] and Boyd's method in [Lecture notes of EE364b, Stanford University, Spring 2013-14, pp. 1-39]. The efficiency of our methods is numerically illustrated in a comparison to the others.

翻译:我们提供了一种双子梯度法和一种初等二元次梯度法,分别用于处理复杂度为$\mathcal{O}(varepsilon}-2})美元和$\mathcal{O}(varepsilon}-2r})美元的所有1美元的标准二次方位优化问题。这些方法基于Metel-Takeda最近在[arXiv:2009.12769,2020,pp.1-12]和Boyd的方法,载于[EE364b的注释,斯坦福大学,2013年春季-14,第1-39页]。我们的方法的效率在数字上与其他方法的比较中作了说明。

相关内容

专知会员服务

11+阅读 · 2020年1月17日

专知会员服务

28+阅读 · 2019年11月23日

Arxiv

0+阅读 · 2021年2月28日