【DeepMind硬核课】深度学习自然语言处理前沿进展,附103页ppt

【导读】DeepMind开设了一系列深度学习课程。本次课讲述了深度学习自然语言处理。

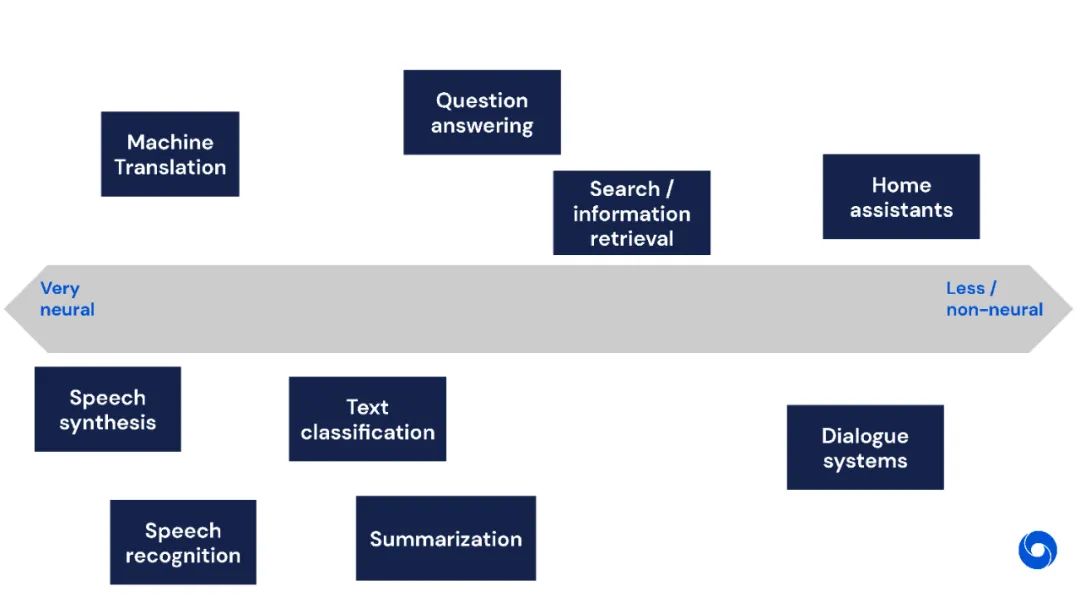

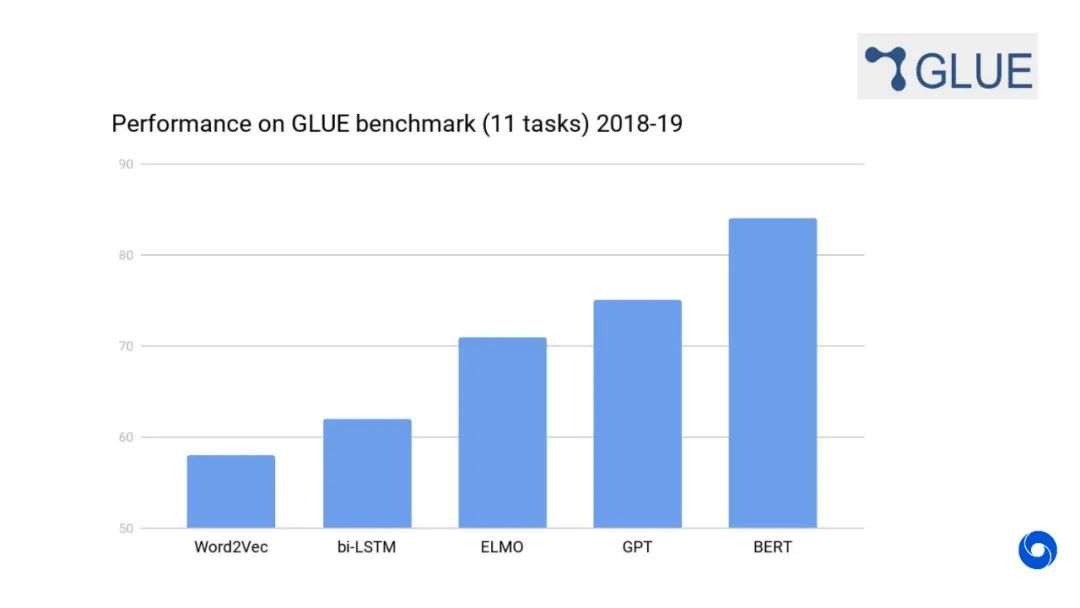

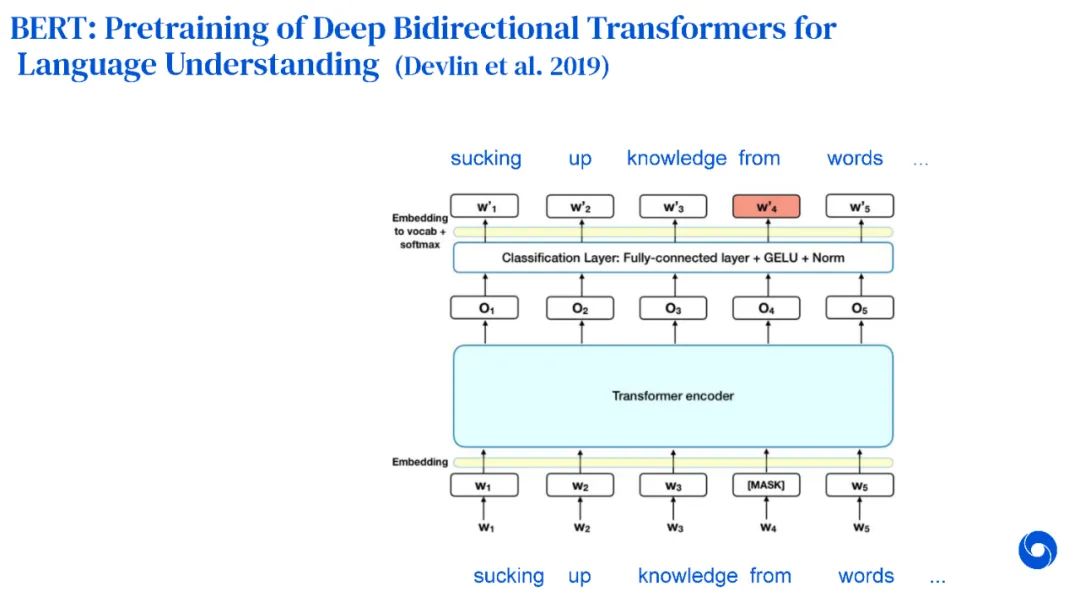

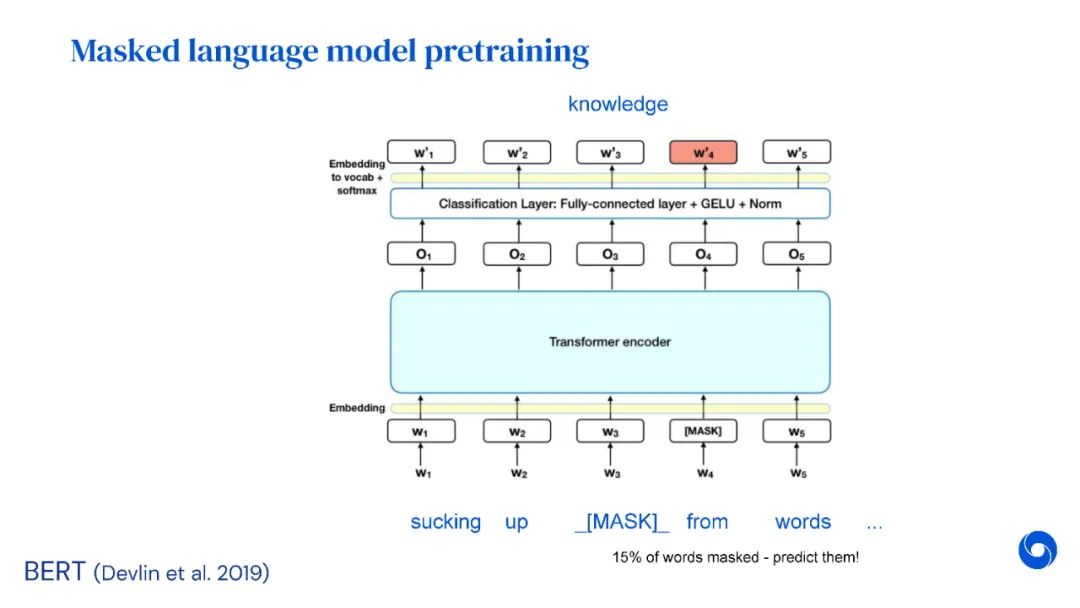

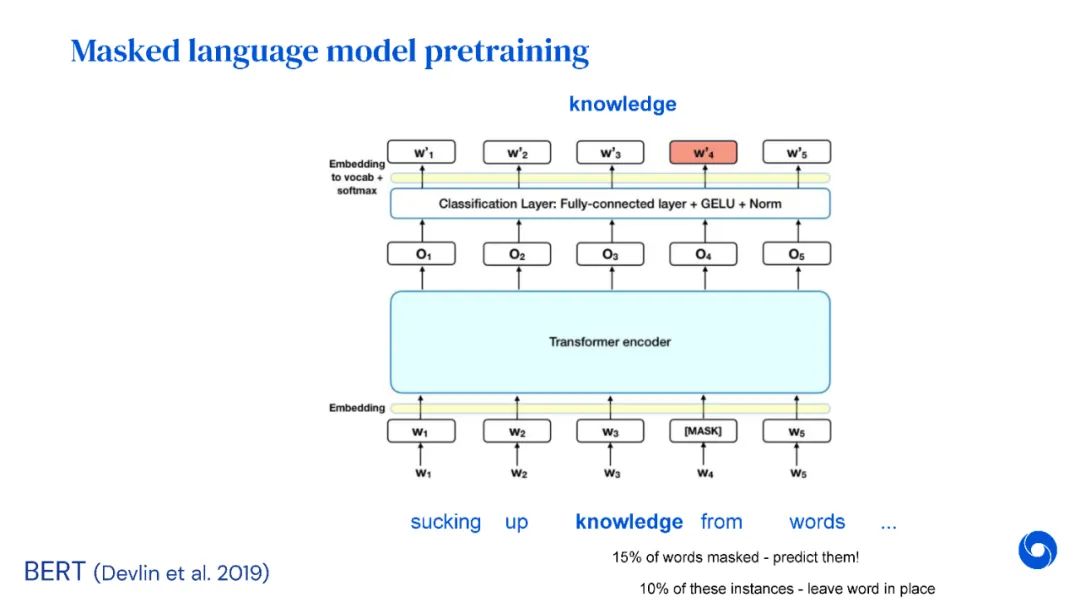

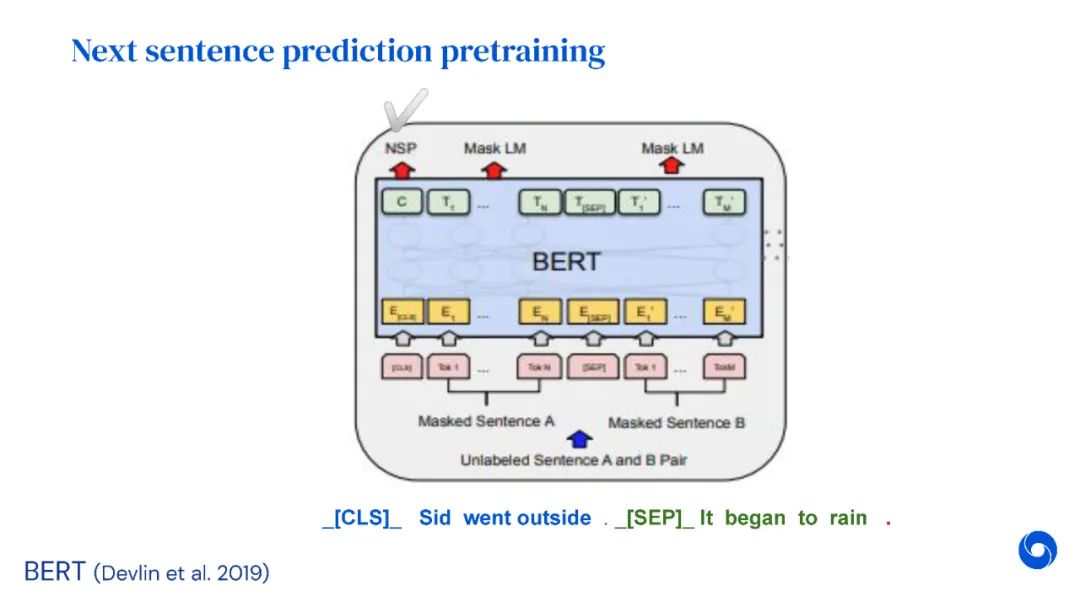

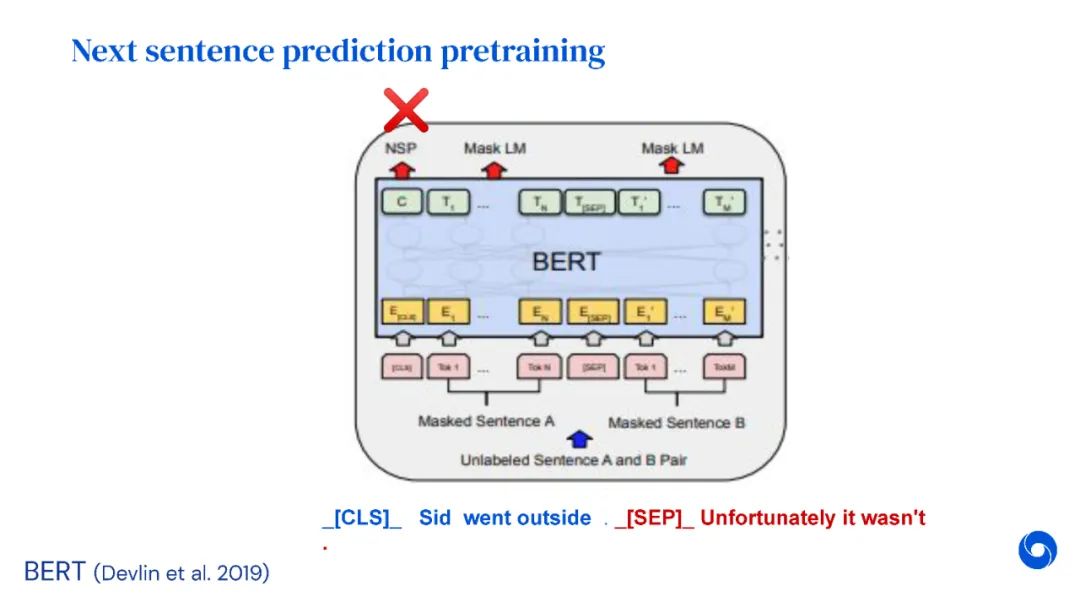

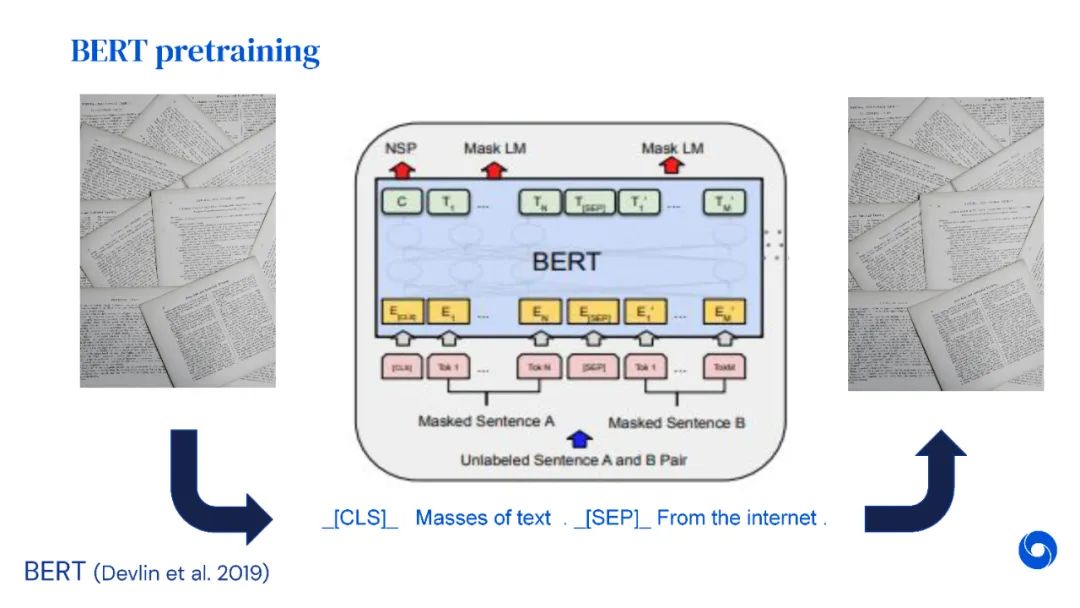

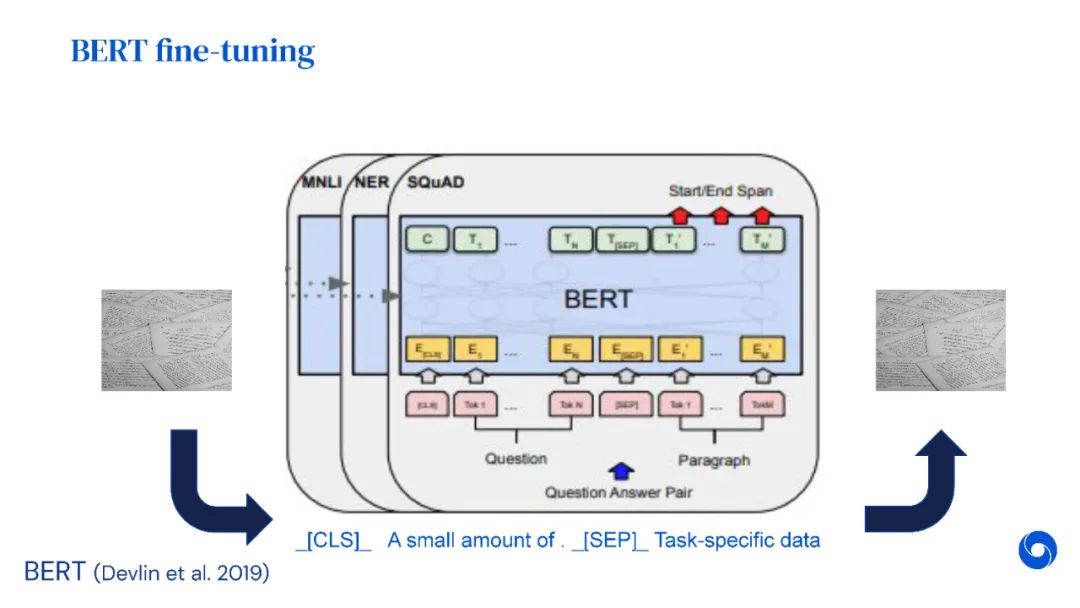

这个报告由DeepMind研究科学家菲利克斯·希尔(Felix Hill)主持,分为三个部分。首先,他讨论了用ANN建模语言的动机:语言是高度上下文相关的,典型的非组合性的,依赖于协调许多竞争的信息来源。本节还涵盖了Elman的发现结构在时间和简单递归网络,上下文和transformers的重要性。在第二部分,他探索了从Word2Vec到BERT的语言的无监督和表征学习。最后,Felix讨论了情景语言理解,基础和具体化语言学习。

关于讲座系列:

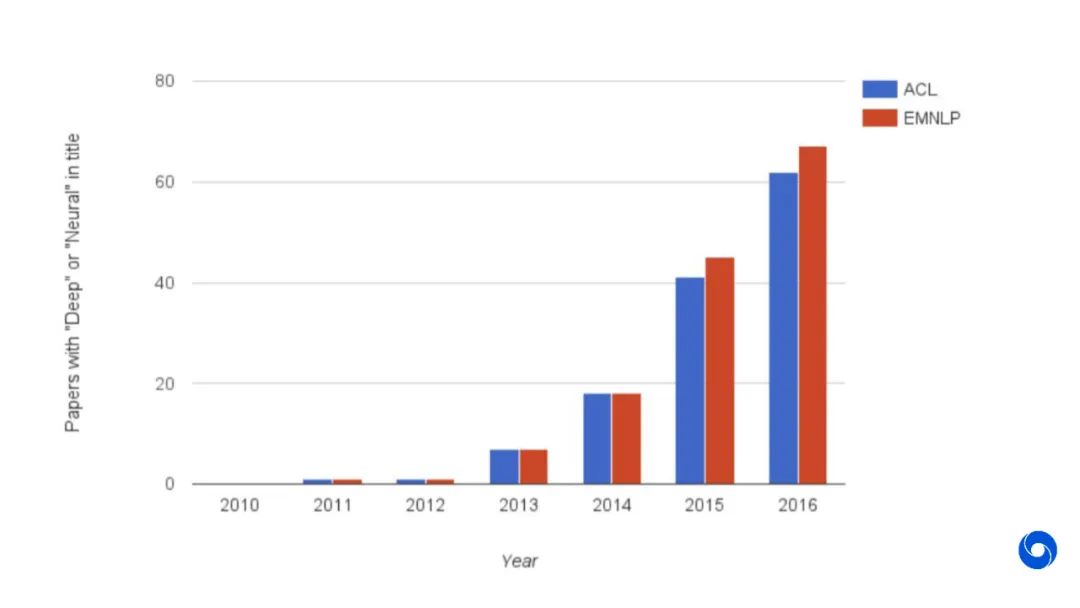

深度学习讲座系列是DeepMind与UCL人工智能中心之间的合作。在过去的十年中,深度学习已发展成为领先的人工智能范例,使我们能够以前所未有的准确性和规模从原始数据中学习复杂的功能。深度学习已应用于对象识别,语音识别,语音合成,预测,科学计算,控制等问题。由此产生的应用程序触及我们在医疗保健和医学研究,人机交互,通信,运输,保护,制造以及人类努力的许多其他领域中的所有生活。认识到这一巨大影响,深度学习的先驱获得了2019年图灵奖,这是计算机领域的最高荣誉。

在本系列讲座中,来自领先的AI研究实验室DeepMind的研究科学家针对深度学习中的一系列令人兴奋的主题进行了12次讲座,内容涵盖了通过围绕记忆,注意力和生成建模的先进思想来训练神经网络的基础知识,以及重要的 负责任的创新主题。

深度学习自然语言处理

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“NLP103” 可以获取《【DeepMind硬核课】深度学习自然语言处理前沿进展,附103页ppt》专知下载链接索引

登录查看更多