【AAAI专题】论文分享:以生物可塑性为核心的类脑脉冲神经网络

与传统人工神经网络相比,脉冲神经网络更接近人脑神经网络的工作机理,因此更适合用于揭示智能的本质。脉冲神经网络不但可以用来对脑神经系统进行建模,而且能够应用于解决人工智能的问题。脉冲神经网络具有更加扎实的生物基础,如膜电势的非线性积累、达到阈值后的脉冲放电以及放电后的不应期冷却等,这些特性在给脉冲神经网络提供了更加复杂的信息处理能力的同时,也为它的训练和优化带来了挑战。

来自网络

近日,中科院自动化所类脑智能研究中心团队在此方面取得一定突破,提出以生物可塑性为核心的类脑脉冲神经网络,在MNIST手写识别任务中正确率与人工神经网络结果可比较,拉近了类脑脉冲神经网络与人工智能应用之间的距离。

来自类脑智能研究中心官网

传统的基于误差反传的学习方法已经被证明可以很好地优化人工神经网络,然而其要求网络和神经元节点处处可微分,因此便不再适用于脉冲神经网络的优化,其原理也与生物脑的学习法则存在差距。目前还没有一套针对脉冲神经网络的通用训练方法。但是考虑到生物系统中自有一套可塑性学习机制指导着生物脉冲网络的学习和训练,因此以生物可塑性原理出发,最终启发得到脉冲神经网络的训练方法,将会是一个可能的途径。

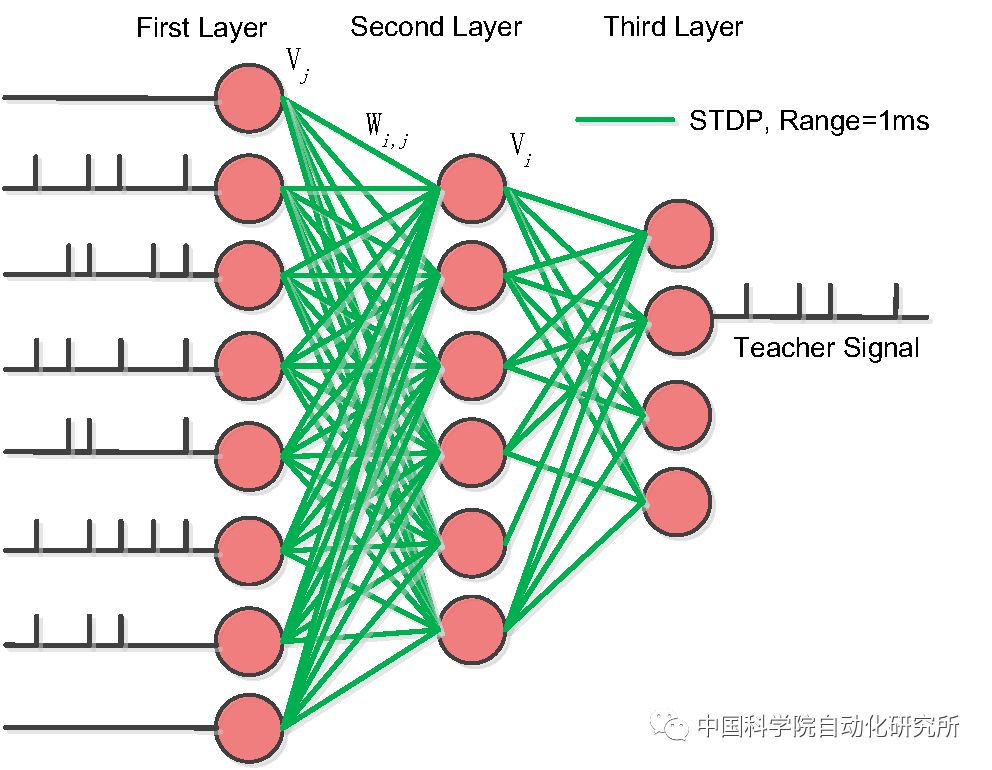

课题组负责人曾毅研究员介绍到:生物脑的可塑性机制是可以总结成一套理论体系的,课题组一直致力于建立受脑启发的脉冲神经网络学习理论。在这项工作中,主要遴选了两条生物可塑性规则作为研究对象:首先,任何的理论优化方法,其最终目的都是为网络实现稳定的功能表达,在微观尺度即是神经元的膜电位改变和输入电流达到平衡,在宏观尺度即是网络功能输出和信息输入达到平衡。其次,生物网络的训练中,突触权值往往是随着突触前后神经元放电的状态变化而被动的更新,如脉冲时序依赖的突触可塑性(Spike-Timing Dependent Plasticity,STDP)。基于上述两点规则的启发,课题组成员将脉冲网络训练方法分为四个步骤:基于前馈的膜电位信息更新;基于输入输出稳态控制的膜电位信息更新;基于一层误差反馈的膜电位更新;基于STDP的由膜电位变化到突触变化的被动更新。

来自网络

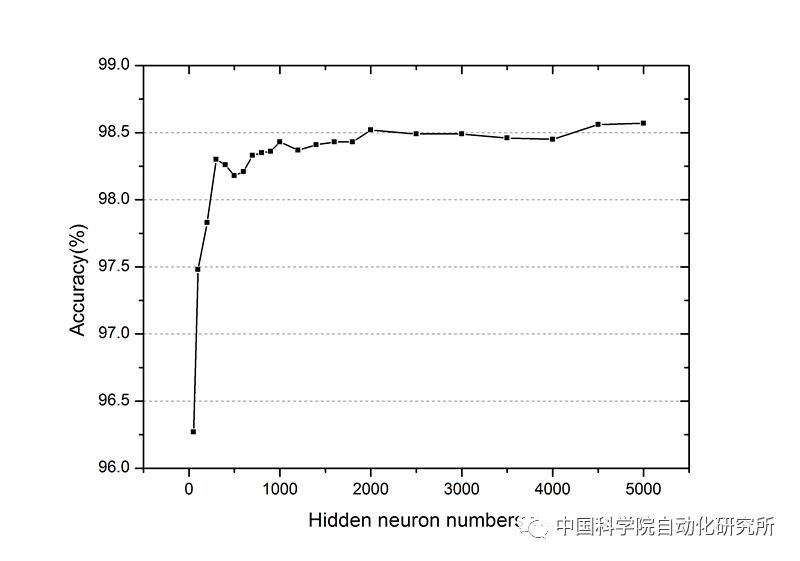

课题组成员张铁林博士介绍到:为了验证上述四个步骤网络训练的有效性,课题组采用最简的三层脉冲神经网络进行测试。图1展示了网络结构,网络训练结果如图2所示,最终在MNIST任务上达到分类正确率为98.52%,据了解,这已是应用生物神经可塑性进行训练的纯脉冲神经网络应用到MNIST数据集上取得的最好结果,之前,最好的是2015年的一个结果,大致在95%左右。

图一:三层脉冲神经网络架构(来自文章)

图二:生物可塑性原理为核心的脉冲网络测试准确率

(来自文章)

曾毅研究员介绍到:“这篇文章使得类脑脉冲神经网络在MNIST手写数字识别问题上基本上具备了与深度神经网络的可比性,然而这甚至不是最重要的。用脉冲神经元替换通过反向传播训练的人工神经网络上的神经元,可以构建卷积脉冲神经网络(Convolutional SNN),正确率甚至还可以进一步达到99.1%,但是这样的学习机制实际上仍然是人工神经网络和反向传播在发挥作用,而不是脉冲神经网络的能力,更不是真正的脑启发的学习机制。我们的正确率虽然没有Convolutional SNN高,但是文章仍然被接收,我觉得原因正在于我们的模型具备相对更全面的生物合理性,因此更能反映智能的本质,揭示了生物脑可塑性的原理应用到人工智能问题上的潜力”。“此外,这其实只是我们围绕生物可塑性体系化研究工作的一个小点,未来的探索将更激动人心!”曾毅研究员对此充满信心。

模型性能的最优化并不是本研究最终追求的目标。文章的特点在于受生物智能形成的启发,提炼可用于脉冲神经网络学习、训练、优化的新方法。由此带来的启发,无论对生物理论的计算理解,还是对人工模型的认识,都将有较为重要的促进意义。

相关研究发表在人工智能领域的顶级会议AAAI 2018上。

A Plasticity-centric Approach to Train the Non-differential Spiking Neural Networks

AAAI 2018

Tielin Zhang, Yi Zeng*, Dongcheng Zhao, Mengting Shi

Many efforts have been taken to train spiking neural networks (SNNs), but most of them still need improvements due to the discontinuous and non-differential characteristics of SNNs. While the mammalian brains solve these kinds of problems by integrating a series of biological plasticity learning rules. In this paper, we will focus on two biological plausible methodologies and try to solve these catastrophic training problems in SNNs. Firstly, the biological neural network will try to keep a balance between inputs and outputs on both the neuron and the network levels. Secondly, the biological synaptic weights will be passively updated by the changes of the membrane potentials of the neighborhood neurons, and the plasticity of synapses will not propagate back to other previous layers. With these biological inspirations, we propose Voltage-driven Plasticity-centric SNN (VPSNN), which includes four steps, namely: feed forward inference, unsupervised equilibrium state learning, supervised last layer learning and passively updating synaptic weights based on spike-timing dependent plasticity (STDP). Finally we get the accuracy of 98.52% on the hand-written digits classification task on MNIST. In addition, with the help of a visualization tool, we try to analyze the black box of SNN and get better understanding of what benefits have been acquired by the proposed method.

更多精彩内容,欢迎关注

中科院自动化所官方网站:

http://www.ia.ac.cn

欢迎后台留言、推荐您感兴趣的话题、内容或资讯,小编恭候您的意见和建议!如需转载或投稿,请后台私信。

来源:自动化所类脑智能研究中心

编辑:欧梨成

中科院自动化研究所

微信:casia1956

欢迎搭乘自动化所AI旗舰号!