阿里实习生突破自动驾驶技术难题,首次实现3D物体检测精度与速度兼得

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

本文转自量子位

最新消息,阿里达摩院又有新的研究进展,这次在自动驾驶3D物体检测领域。

达摩院的研究人员提出一个通用、高性能的检测器,在自动驾驶领域权威数据集KITTI BEV(鸟瞰)上,检测速度达到25FPS ,一举占据榜首,与排名第二的方案相比,减少了一半多,同时精度也远超其他的单阶段检测器。可以说首次实现3D物体检测精度与速度兼得。

达摩院研究团队表示:“检测器是自动驾驶系统的核心组件之一,但该领域一直缺少创新和突破,此次我们实现3D检测精度和速度的提升,将有助于提高自动驾驶系统的安全性。”

从实验结果来看,他们显然取得了良好进展,而且研究的主要完成人员(一作),还是达摩院的实习生。

同时,该研究也得到了同行们的认可,被计算机视觉领域顶级会议CVPR 2020收录。他们是如何做到的呢?我们借助阿里达摩院提供的解读,一一来看。

如何实现精度和速度兼得?

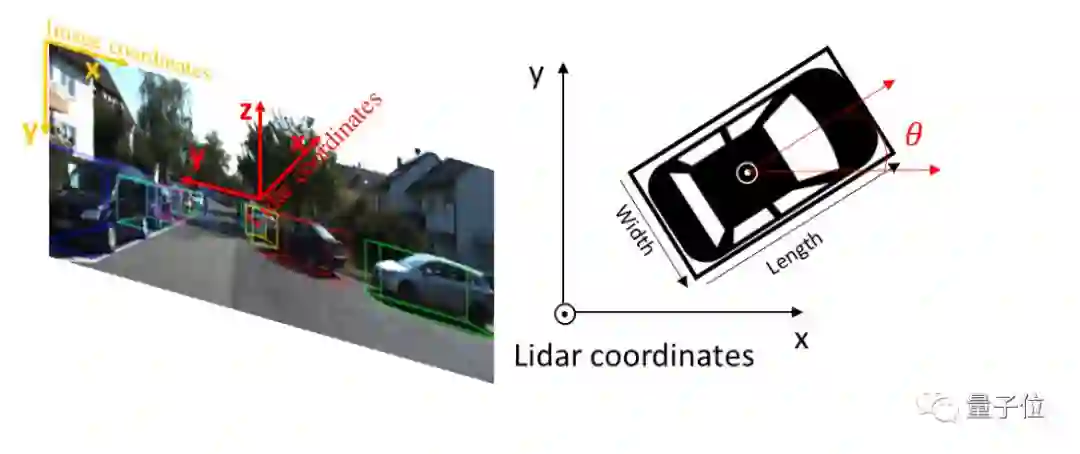

众所周知,与普通2D图像识别应用不同,自动驾驶系统对精度和速度的要求更高,不仅需要快速识别周围环境的物体,还要对物体在三维空间中的位置做精准定位。

仅靠传感器和算法模型,通常无法平衡视觉识别的精度和速度。因此,检测器成为提升自动驾驶系统安全性的一个关键因素。

经过多年研究,当前业界主流的单阶段检测器在检测速度上很好,但在检测精度却差强人意。

这就是达摩院研究的出发点:寻找一种能二者兼得的方法。

他们提出的思路是:将两阶段检测器中对特征进行细粒度刻画的思想,移植到单阶段检测中。

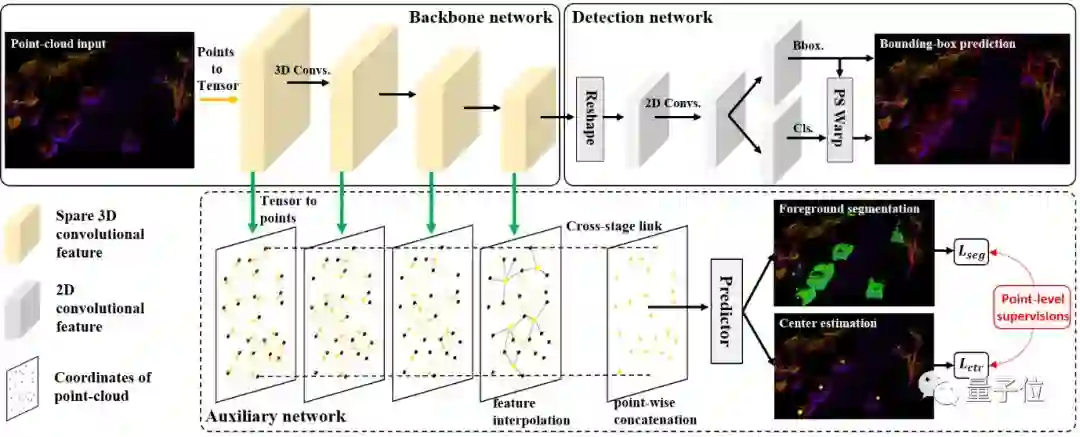

在他们的模型中,用于部署的检测器, 即推断网络, 由一个骨干网络和检测头组成。

骨干网络用3D的稀疏网络实现,用于提取含有高语义的体素特征。检测头将体素特征压缩成鸟瞰图表示,并在上面运行2D全卷积网络来预测3D物体框。

他们在训练中利用一个辅助网络将单阶段检测器中的体素特征,转化为点级特征并施加一定的监督信号。

在实现上,他们将卷积特征中的非零信号映射到原始的点云空间中, 然后在每个点上进行插值,来获取卷积特征的点级表示。使得卷积特征也具有结构感知能力,来提高检测精度。

而在做模型推断时,辅助网络并不参与计算(detached),保证单阶段检测器的检测效率。

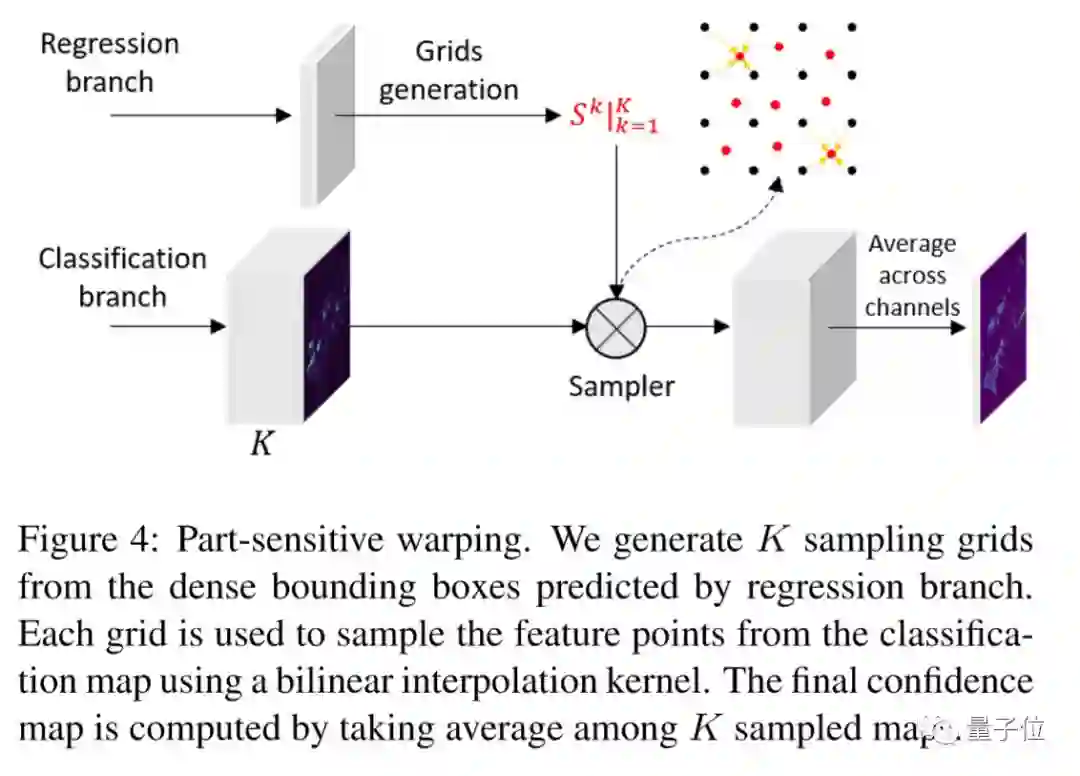

另外,他们还提出一个工程上的改进:Part-sensitive Warping (PSWarp),用于处理单阶段检测器中存在的 “框-置信度-不匹配” 问题。

核心思路是:利用采样器, 用生成的采样网格在对应的局部敏感特征图上进行采样,生成对齐好的特征图。最终能反映置信度的特征图,是K个对齐好特征图的平均。

单阶段方法,能达到两阶段方法精度

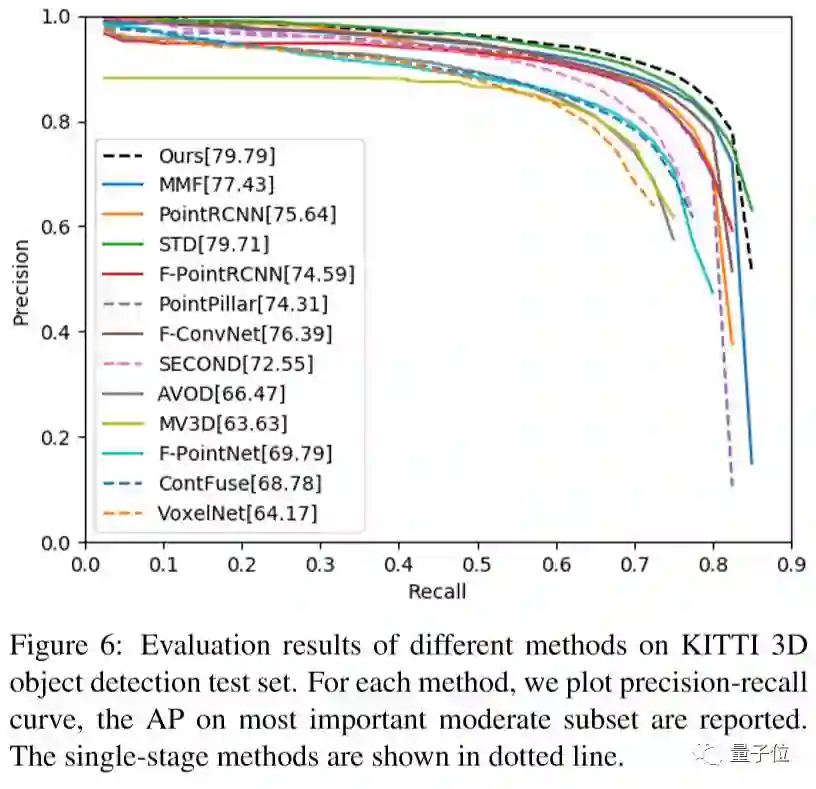

阿里达摩院的研究人员,在KITTI数据集上评估了方法的有效性。下图(PR Curve)中,实线为两阶段方法, 虚线为单阶段方法。

可以看出,达摩院提出的单阶段方法(黑色)能够达到两阶段方法才能达到的精度。

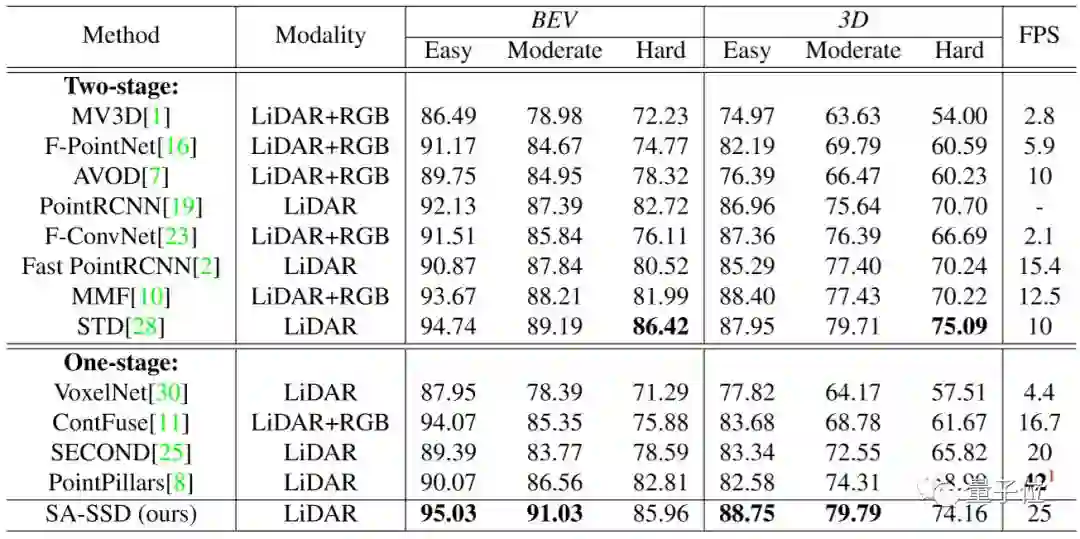

下图展示了他们在KITTI 鸟瞰(BEV) 和 3D 测试集上的结果。

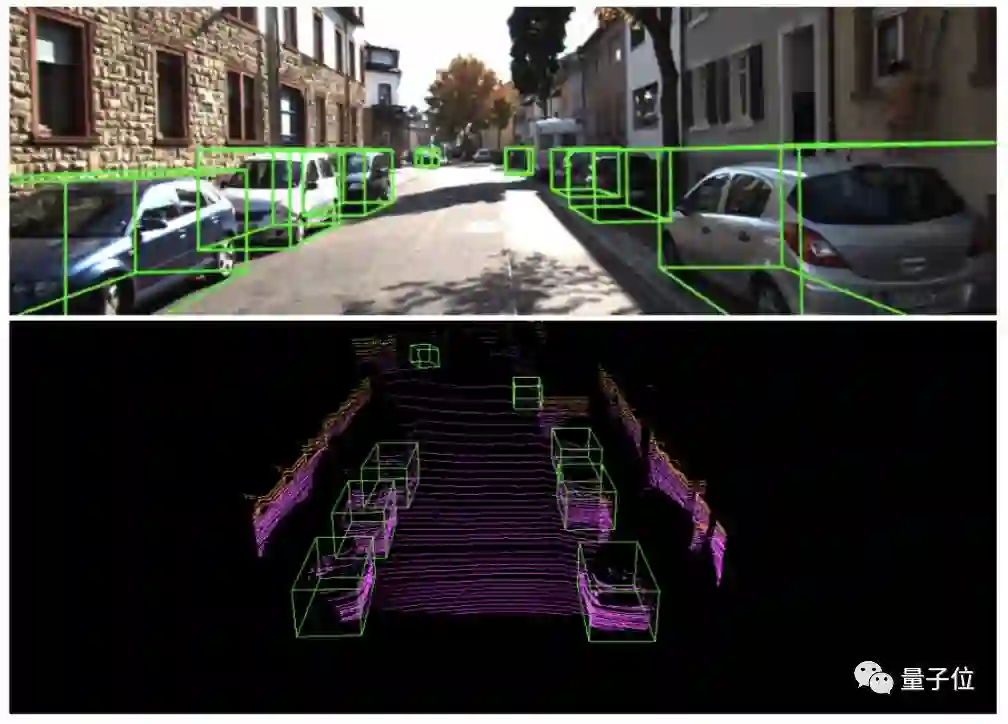

可以看出,他们提出的方法,可以在不增加额外计算量的情况下,达到25FPS 的检测速度,而且还能保持精度。具体的检测效果如下:

两位共同一作,都是达摩院研究实习生

研究论文,标题为“Structure Aware Single-Stage 3D Object Detection from Point Cloud”,共有5名研究人员参与,分别来自阿里达摩院和香港理工大学。

第一作者是Chenhang He,是阿里达摩院的研究实习生,正在香港理工大学读博,预计2022年毕业。

他的导师是达摩院高级研究员、香港理工大学电子计算学系讲座教授、IEEE Fellow张磊,也是这一研究的通讯作者。

另一位第一作者Hui Zeng,也是是阿里达摩院的研究实习生,同样是张磊的博士生,预计在今年毕业。

其他作者,分别是达摩院高级研究员、IEEE Fellow华先胜、达摩院资深算法专家黄建强等。

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

投稿、合作也欢迎联系:simiter@126.com

长按关注计算机视觉life

给优秀的自己点个赞