TKDE 2020 | CTRR:组稀疏约束的紧凑张量环回归

随着数字影像设备的快速普及和发展,涌现了大量高阶数据,如光学视频,医学图像等。高阶数据相关的学习任务中,如何对高阶的回归系数进行高效的近似是一个关键问题。低秩张量近似是其中一个方法。作为一种新的张量分解,张量环已经被证明可以建模更多多维数据的相关信息。但是,其最优的张量环秩通常是未知的,需要从多种组合中进行经验选择。

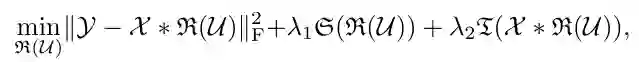

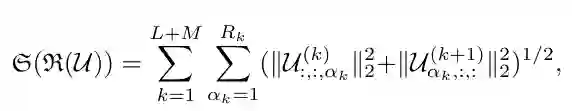

为弥补这一缺陷,我们提出了一种新的张量回归模型。通过对张量环分解的潜在因子施加组稀疏约束,以此来实现张量环秩的自动估计,从而获得高效紧凑的表示。此外,引入总变差约束项确保预测响应的局部一致性,以减少随机噪声所带来的不利影响。

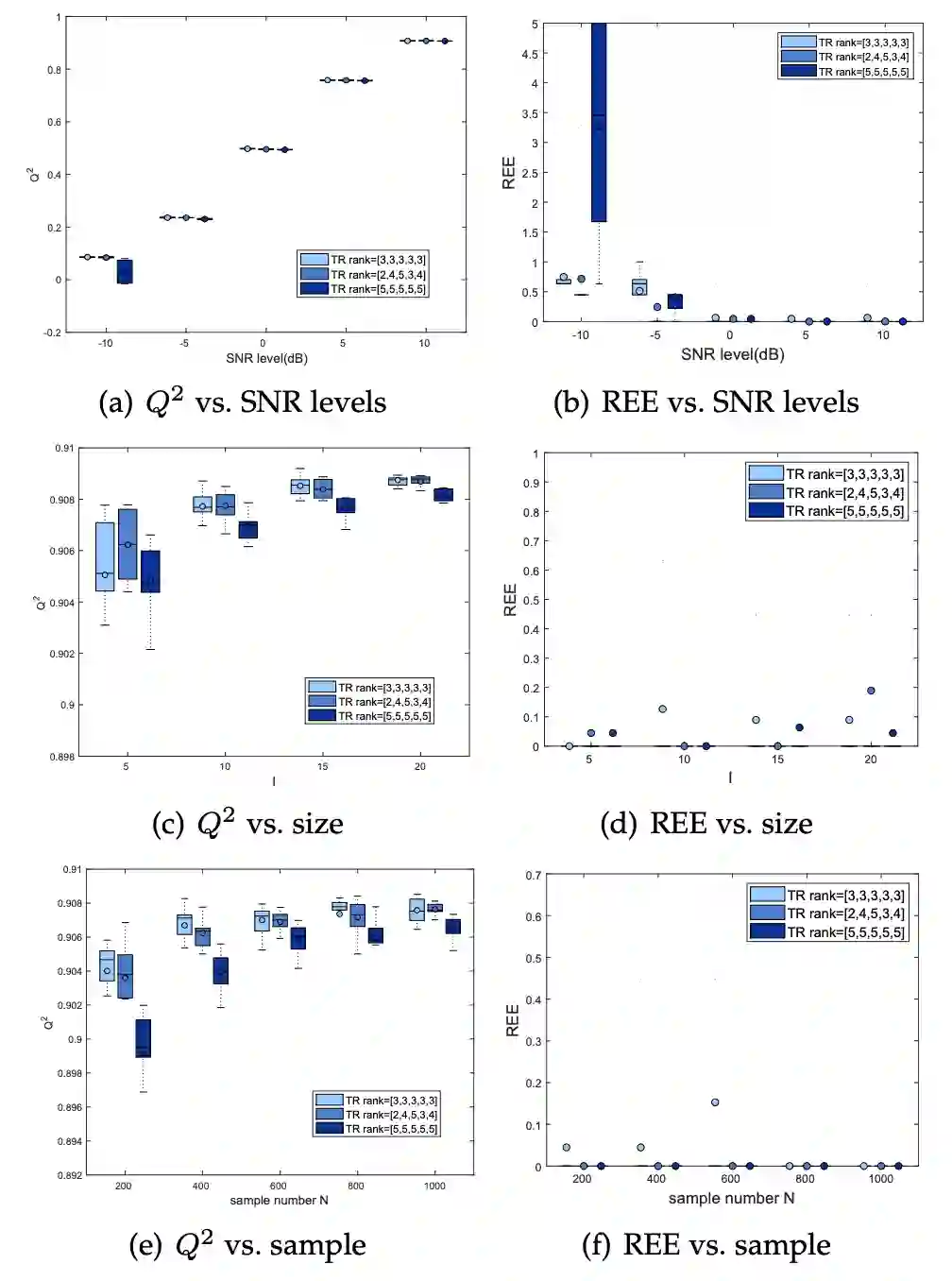

在仿真数据集上的实验表明,该方法能够在学习过程中更准确地推断张量环秩,平衡预测误差和模型复杂性。并且在人体运动轨迹捕捉任务的对比实验进一步验证了该算法的有效性和稳健性。

研究背景

随着大量高维数据的出现,与其相关的数据分析技术逐渐成为了研究热点。多线性回归作为解决涉及高维数据学习任务的关键技术,广泛应用于社会科学、气候科学和神经科学。

多线性回归模型的核心思想是保留数据的原始形式,通过张量积形式反应多维数据之间的相关关系。鉴于数据自身的结构特征,通常假设多维数据之间的回归系数张量满足低秩性或者稀疏性。其通用的优化方案有两种,一种基于秩最小化模型,一种是给定秩的张量因子化模型。

对于给定秩的张量因子化模型,一个最大的挑战便是张量秩的预估。尤其是Tucker 秩,张量链或张量环秩等多线性秩,其预估需要从大量的组合之中进行选取,耗费大量时间。因而,本文以张量环分解为例,引入了一种组稀疏约束项,可以在训练过程中实现对张量环秩的自适应,从而实现模型复杂度和性能的平衡。

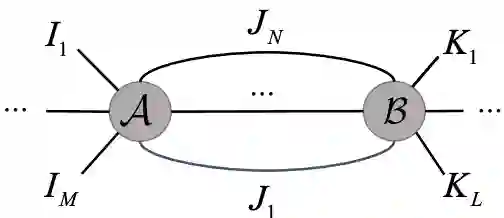

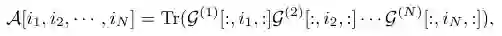

符号定义和描述

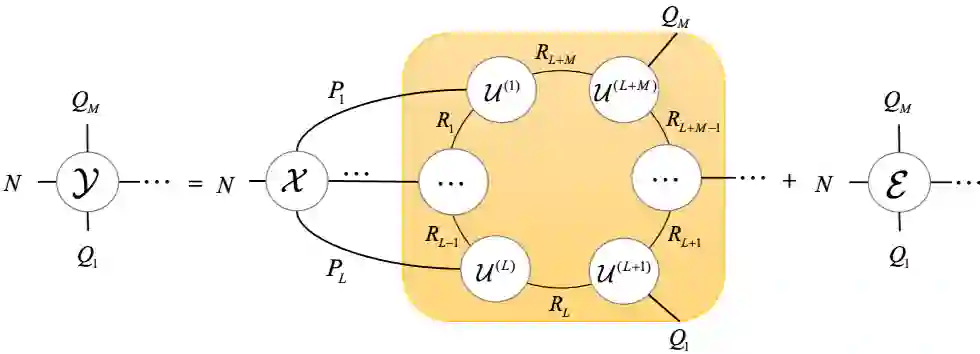

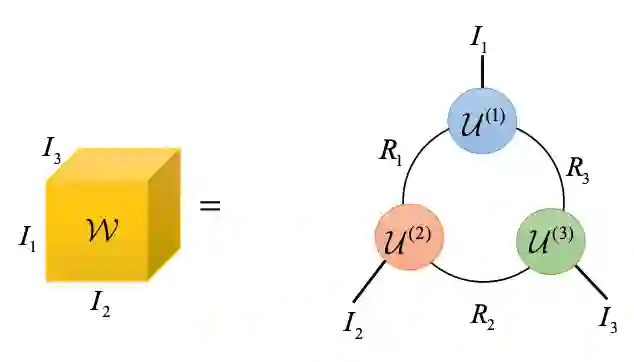

▲ 图1 张量收缩积

▲ 图2 张量环分解

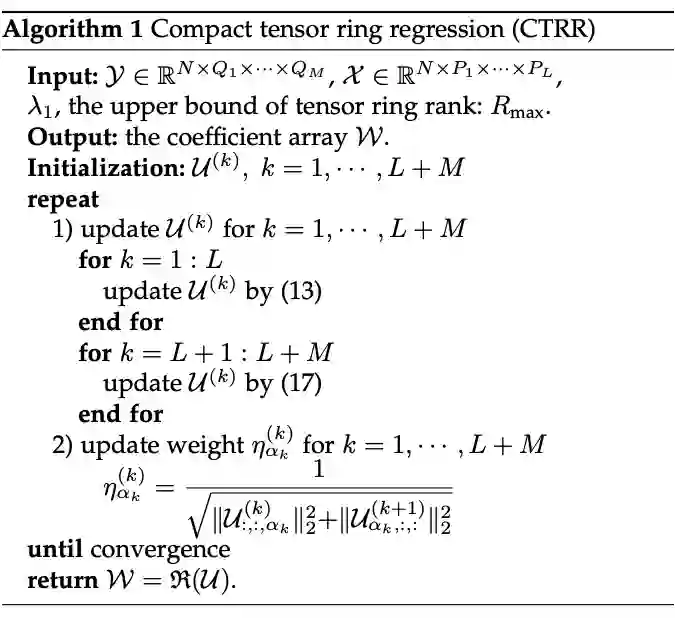

算法描述

为确保张量输出的局部一致性,我们对预测的结果进行全变差约束,如下式所示:

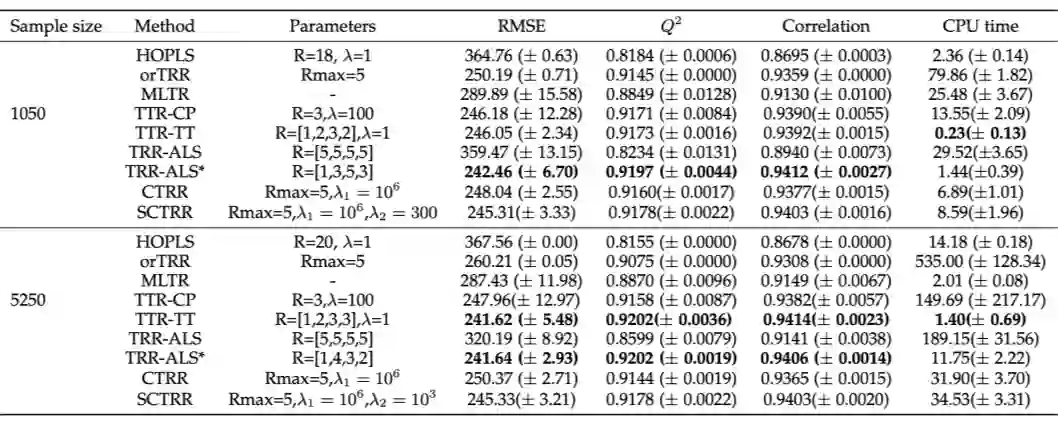

实验

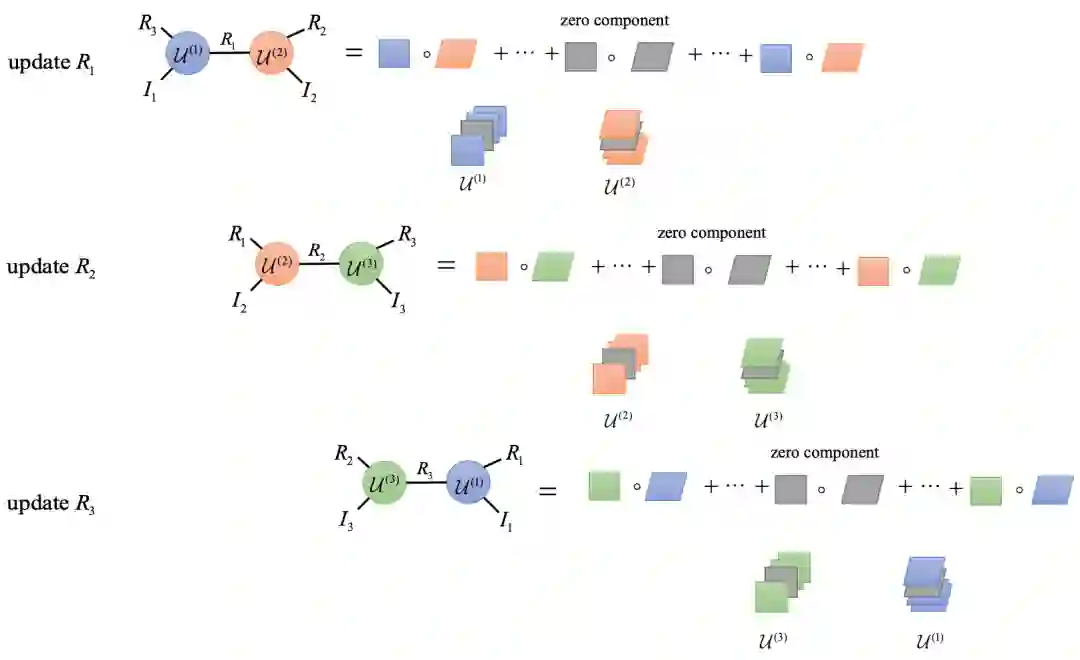

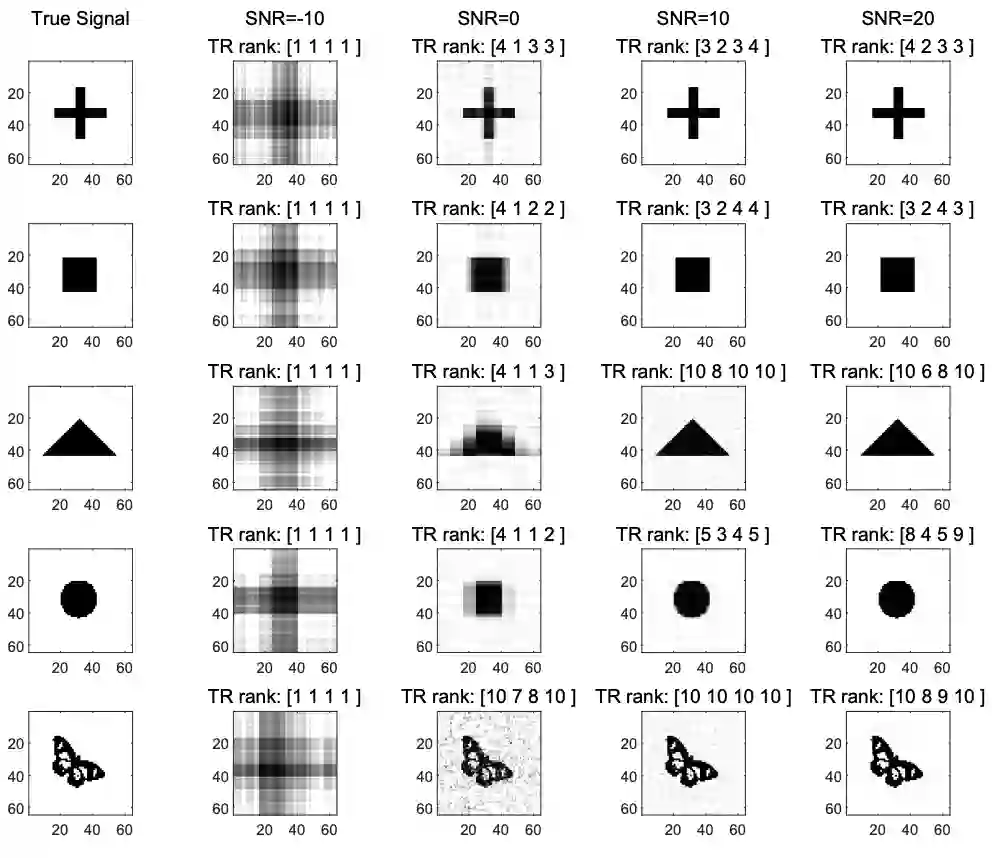

▲ 图7 CTRR在shape数据集上的表现

4.2 人体行为轨迹重建实验

结论

为了克服张量回归中张量环秩估计这一困难,本文提出了一种基于组稀疏约束的紧凑张量回归模型,将张量秩最小化问题放缩为带有组稀疏约束的张量环低秩近似问题。在仿真数据集上的实验验证了 CTRR 可以在训练过程中对回归系数张量的张量环秩进行推断,以获得紧凑的低秩近似。同时,在真实数据集上的实验说明了引入局部平滑约束可以提高模型的预测性能并改善预测的视觉效果。

CTRR 将张量秩推断这一离散参数的调节问题转换为稀疏项的连续参数调节问题,提高了算法的稳健性。未来,我们将进一步探索如何实现该算法参数的自动调节问题,开发更加实用有效的张量学习方法与应用。

参考文献

[1] W. Guo, I. Kotsia, and I. Patras, “Tensor learning for regression,” IEEE Transactions on Image Processing, vol. 21, no. 2, pp. 816–827, 2012.

[2] E. F. Lock, “Tensor-on-tensor regression,” Journal of Computational and Graphical Statistics, vol. 27, no. 3, pp. 638–647, 2017.

[3] J. Liu, C. Zhu, Z. Long, H. Huang and Y. Liu, “Low-Rank Tensor Ring Learning for Multi-linear Regression,” Pattern Recognition, pp. 107753, 2020.

[4] Y. Liu, J. Liu, and C. Zhu, "Low Rank Tensor Train Coefficient Array Estimation for Tensor-on-Tensor Regression," IEEE Transactions on Neural Networks and Learning Systems, 2020.

[5] X. Li, Y. Ye, and X. Xu, “Low-rank tensor completion with total variation for visual data inpainting,” in Thirty-First AAAI Conference on Artificial Intelligence, 2017.

[6] I. Daubechies, R. DeVore, M. Fornasier, and C. S. Gunturk, “Iteratively reweighted least squares minimization for sparse recovery,” Communications on Pure and Applied Mathematics, vol. 63, no. 1, pp. 1–38, 2010.

[7] M. Zhu and T. Chan, “An efficient primal-dual hybrid gradient algorithm for total variation image restoration,” UCLA CAM Report, 08-34, 2008.

更多阅读

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。