Python网络爬虫与信息抽取笔记04 Robots协议

【导读】我们在上一节的内容中已经为大家对HTTP协议进行讨论,这一节将主要讨论Robots协议。本文内容涉及Robots协议的若干主要问题:爬虫引发的问题,网络爬虫的限制方法,Robots协议以及对于Robots协议的理解。话不多说,让我们一起学习这些内容吧。

Python网络爬虫与信息抽取笔记01 课程框架和Python IDE工具

Python网络爬虫与信息抽取笔记02 requests库入门

视频网址:

https://www.bilibili.com/video/av9784617?from=search&seid=240663710546169136

http://www.icourse163.org/course/BIT-1001870001?tid=1001962001

Python网络爬虫与信息抽取04 Robots协议

1.爬虫引发的问题

网络爬虫能给人们提供很多便利,但同样网络爬虫会引发很多问题

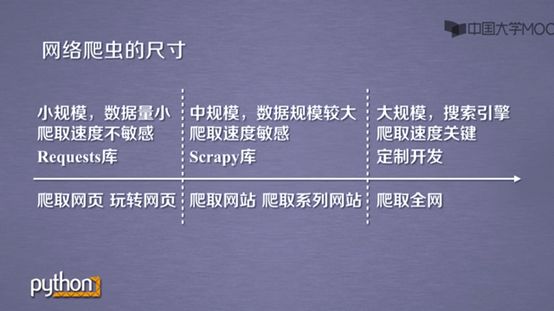

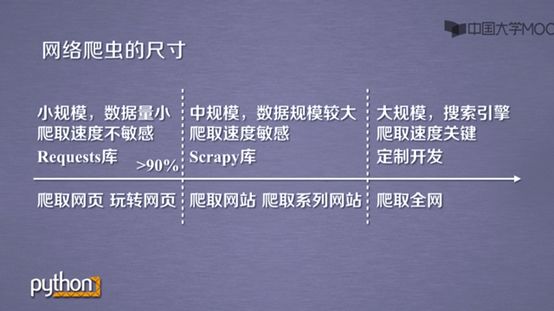

根据网络爬虫的尺寸大致可以分为三种规模,我们使用的爬虫是小规模或者中规模

每种规模都有其对应的工具

如果好多网络爬虫一起爬取数据,会给服务器巨大的资源开销

而且会带来知识产权的风险

还会涉及隐私的问题

所以网络爬虫的问题可以大致概括为三个问题

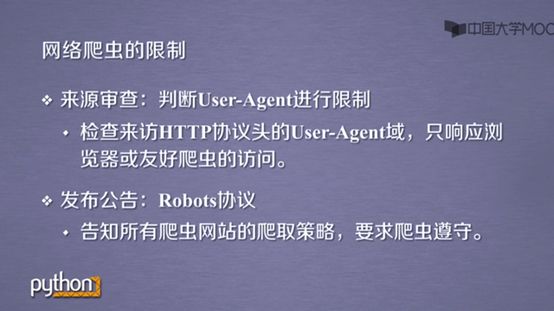

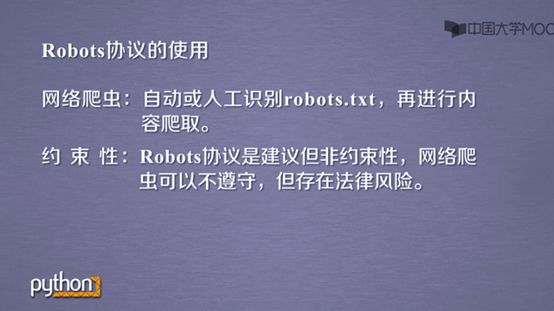

2.网络爬虫的限制方法

对于服务器来说,必须对网络爬虫有所限制,一个方法是来源审查,另一个是发布公告

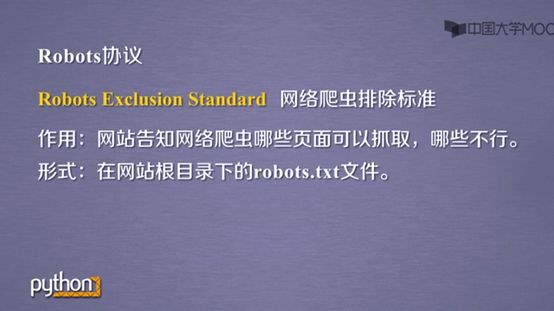

重点讲robots协议,robots协议告诉我们哪些页面能爬,哪些页面不能爬取

3.Robots协议

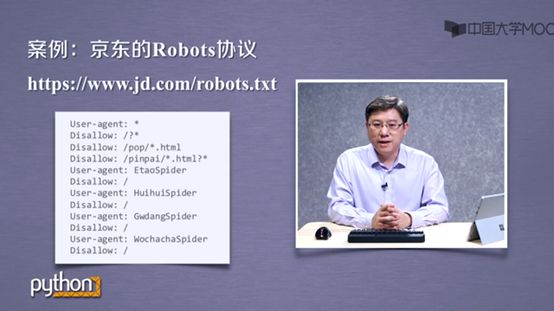

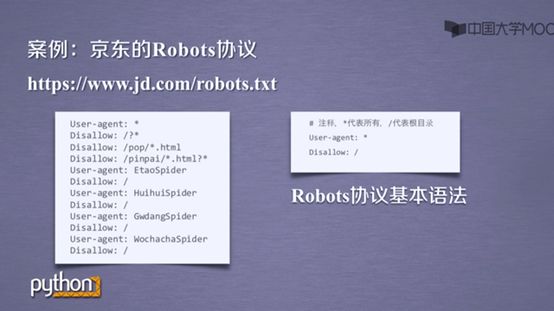

例如查看京东的robots协议,我们可以看其内容

Robots协议基本语法简单

可以打开其他网站,看看其Robots协议

我们在爬取一个网站前,应该能先看其robots协议

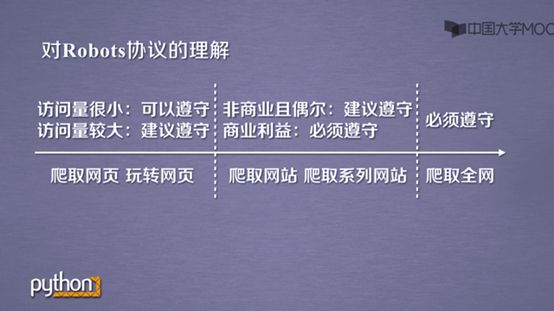

4.对于Robots协议的理解

对于网站的robots的协议,遵不遵守应该视情况而定

因为网站是为人服务的,总的来说,类人行为可以不参考robots协议

参考链接:

http://www.icourse163.org/course/BIT-1001870001?tid=1001962001

更多教程资料请访问:人工智能知识资料全集

-END-

专 · 知

人工智能领域主题知识资料查看与加入专知人工智能服务群:

【专知AI服务计划】专知AI知识技术服务会员群加入与人工智能领域26个主题知识资料全集获取

[点击上面图片加入会员]

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请加专知小助手微信(扫一扫如下二维码添加),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

请关注专知公众号,获取人工智能的专业知识!

点击“阅读原文”,使用专知