唐杰:AI 未来靠迭代

未来十年人工智能将如何发展?

清华大学教授、智源研究院副院长唐杰认为:认知智能将成为一个重要的且可能实现的方向。

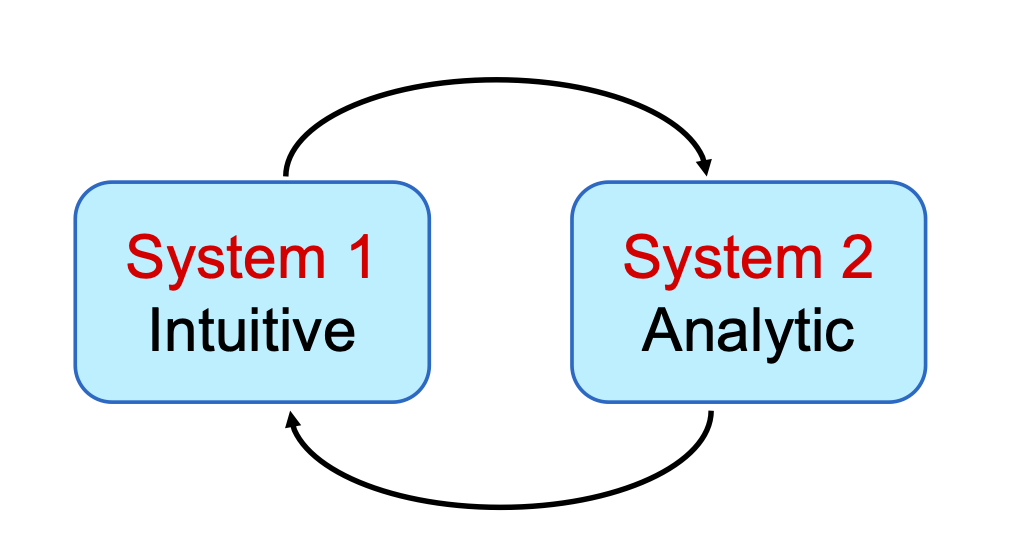

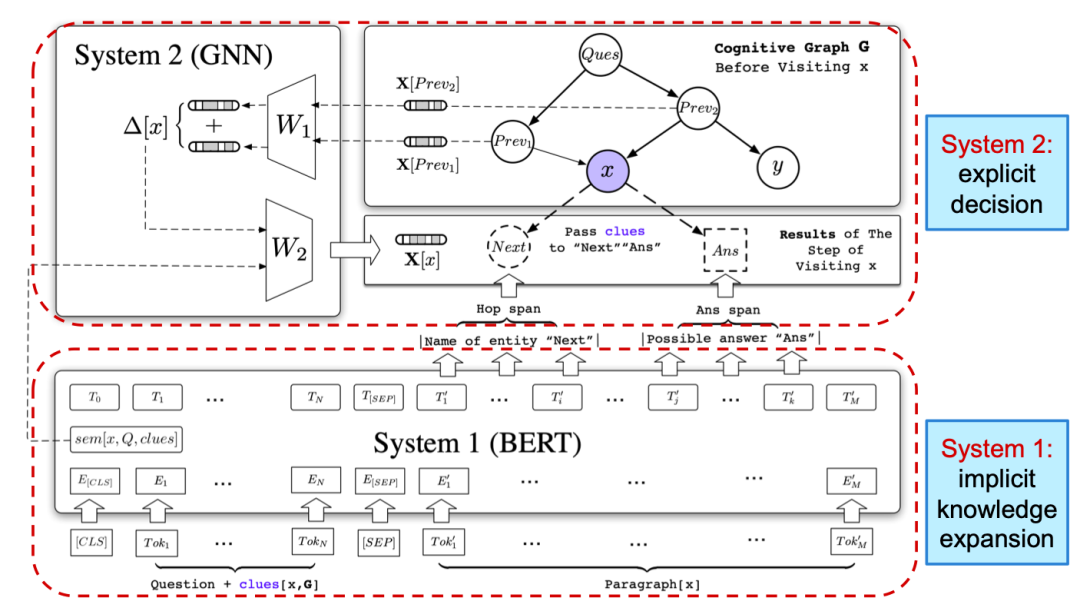

具体来说,便是 System 1 和 System 2 的循环往复,不断迭代,从而打造出具备认知能力的系统——当前基于深度学习的模型作为 System 1,进行信息的抽取、匹配和知识扩展过程;而更具逻辑性和推理性的System 2,将进行判断和推理,输出答案或者将相关知识存储到 System 1 当中。

此外,从更长远的角度,唐杰教授基于认知科学中的全局工作理论(GWT),提出了一个多处理器链接/非链接的全局认知模型。

什么是认知智能?

什么是认知智能?首先用一个例子来说明。

假如我们要解决一个问题:

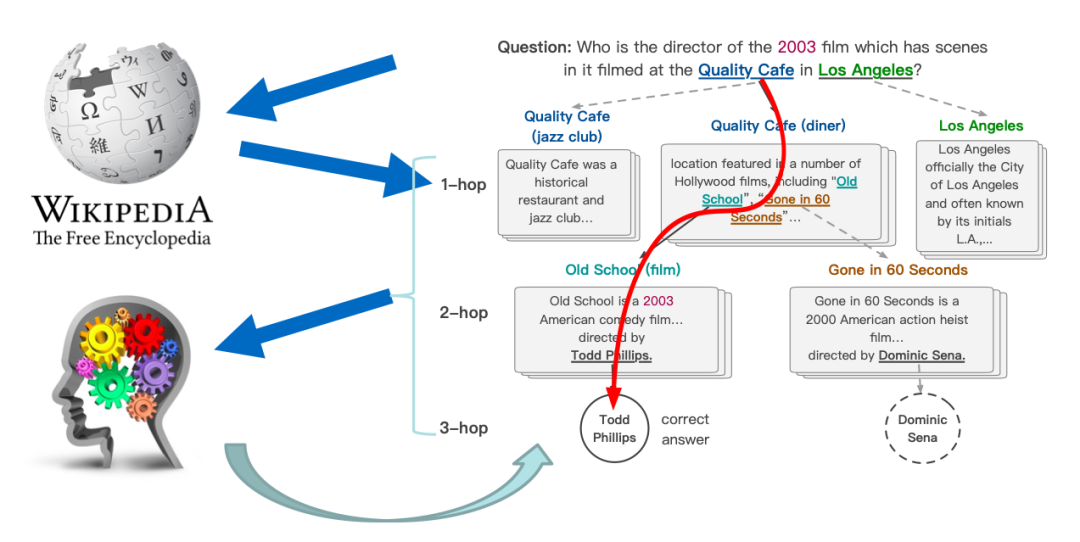

哪个导演于2003年在洛杉矶的Quality咖啡馆拍过电影?

Who is the director of the 2003 film which has scenes in it filmed at The Quality Cafe in Los Angeles?

人类的做法会是,先搜索相关的文档,从中找到相关的电影,在电影的介绍文档里面进一步找到该电影的导演 Todd Phillips ,经过比对电影的拍摄时间(2003年),最终确定答案是Todd Phillips 。

人类大脑思考和解决这个问题的过程为:

1)根据问题解读其中的关键信息;

2)做出判断。如果答案正确,整个推理引擎会输出最终的答案;如果答案不正确,整个过程会继续。

这就是一个经典的带推理的过程。

对于这类问题,机器是怎么做的?简单来说就是:利用 BERT、XLNet 等训练一个模型,然后对给定问题,在长文档中进行匹配。

但,这个过程缺乏可解释性。

对此,最近也有很多相关的工作,试图把知识图谱或知识概念(包括逻辑推理)融入到模型当中。

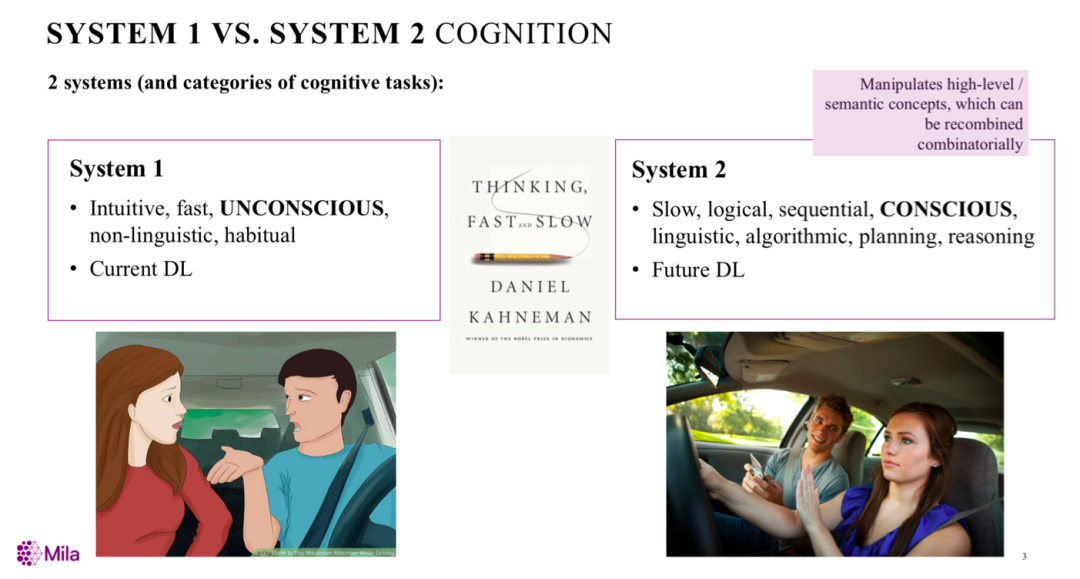

总体来说,可以用 Yoshua Bengio 在 NeurIPS 2019 大会中的主旨报告来总结:所有的这些模型都属于人脑认知中的 System 1。

他认为,在人脑的认知过程中,包括了 System 1 和 System 2。前者更多是做一个快速的、直觉的、无意识的匹配,当给定一个问题时,系统一直接匹配相关的一些答案,并且把这个答案直接输出。但这些答案的匹配缺乏推理过程,而且直接用习惯性的结果进行匹配,目前的深度学习更多的是这种匹配。

作为对比,System 2 相对较慢,没有 System 1 的快速匹配过程,但它带有更多的逻辑推理和序列推理,这是一个有意识的带规划、带认知的过程。

这正是认知智能所要做的事情。

认知图谱的理论基础

重新思考刚才的推理过程。

假如我们用 System 2(认知过程)来做,这个过程应该怎么做?

基于认知科学中的双通道理论,我们可以在求解过程中,先用 System 1 模拟知识扩展过程,即找到关键信息,并对关键信息进行直觉扩展;然后把 System 2 变成一个决策过程,即判断信息是不是我们需要的。

我们把这个工具叫作认知图谱(Cognitive Graph)。

认知图谱更像一个迭代的过程。它里面有两个系统:一个对应 System 1,它会抽出关键词,从外部资源中找到相关的信息,再从里面抽取出重要的信息。另一个对应 System 2,它会判断抽取的信息是否有用,或者是否是最终答案;如果不是,但有用,System 2 就会把这些信息放到 System 1 中。System 1 持续做这种扩展,System 2 持续做判断,最终输出我们需要的答案。

System 1,可以用已有的机器学习模型,如 BERT、XLNet、GPT-3 等,先做一个预训练,然后在预训练模型基础上做匹配,最后从匹配结果来做知识扩展。

有了 System 1 以后,可以参考人类的推理过程做 System 2。人在拿到相关的信息以后会把这些信息建造成一个知识网络,然后在知识网络的基础上做决策,发现最终要的答案。基于这样的思路,我们可以用图神经网络对信息进行建模,然后决策、判断得到的信息是否是我们所要的。

在这方面的研究工作,可以查看唐杰教授近期的研究工作,其报告中这方面的细节,再次不再赘述。

总结来看,整个模型有几个重要的信息:

1)它是一个迭代的框架。它里面包含两个过程,一个是 System 1 的信息扩展或者信息匹配过程,另一个是 System 2 的带决策和推理的过程。

2)它最大的优势是可以从外面不断地获取新的信息,且有很强的可解释性。

3)它利用了双通道理论中的 System 2 的推理过程,从感知过程推进到了认知过程。

我们非常有信心认为,认知智能就是 AI 下一个十年重要的研究方向。

如果追溯 AI 的发展历史,会发现 AI 的发展(甚至包括计算机的整个发展)历程,从早期以存储和计算为主,已经发展到了当下以感知为主,但却没有包含任何认知过程。认知的第一个要务是能够组织和生成知识。

有些同学也许会讲, GPT-3 已经体现了一定的推理和生成。但其实,它离人的推理过程还差得很远。因此,AI 发展的下一步,关键就是认知,怎么把 AI 从感知推进到认知是目前一个非常重要的发展趋势。

第三代 AI

如果回顾一下AI的几个阶段,会发现:

第一代的符号 AI,当时构造了符号模型、规则模型和感知机。

第二代 AI 更多是做感知智能,通过在大数据上做统计学习。目前我们初步实现了这种感知智能,这基本上是 System 1 做的事情。

在此背景下,张钹院士在 2016 年提出了第三代 AI 的雏形,当时的思想是把数据和知识推理两个融合起来,与人脑认知融合,做下一代的AI。

目前这方面急缺的是高质量的、超大规模的知识图谱(这也是 AI 的基础设施),以及面向知识的理解能力(面向认知的深度学习算法)。

那么,AI 未来更多地要做什么呢?

在国际上,Yoshua Bengio 及 DeepMind 的一些人在推动认知过程与深度学习的结合。他们的思路是,把原来的符号系统与深度学习结合,这是超越深度学习的一个最简单的思路。空间非常大,需要研究的东西也非常多。

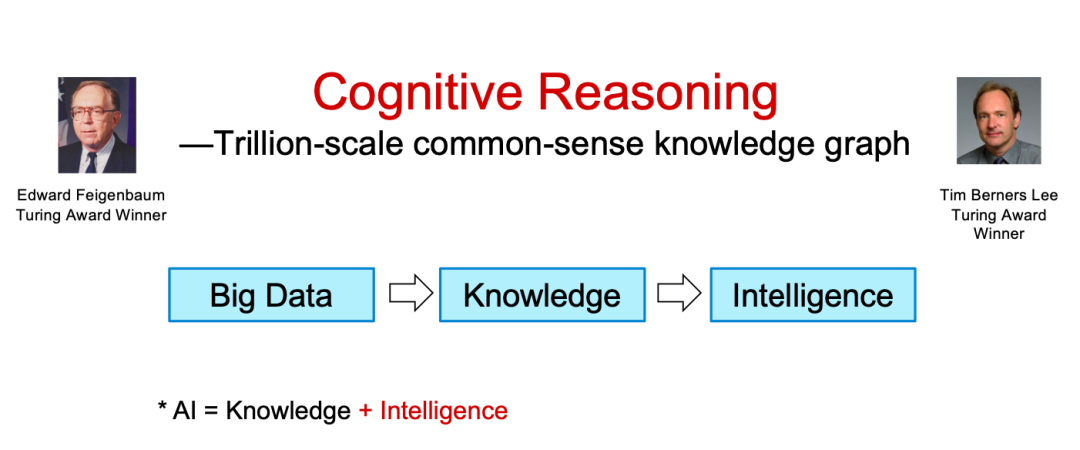

我们认为,下一个十年 AI 最重要的一个方向是做认知推理。它是实现大数据到知识、到智能的一个关键。

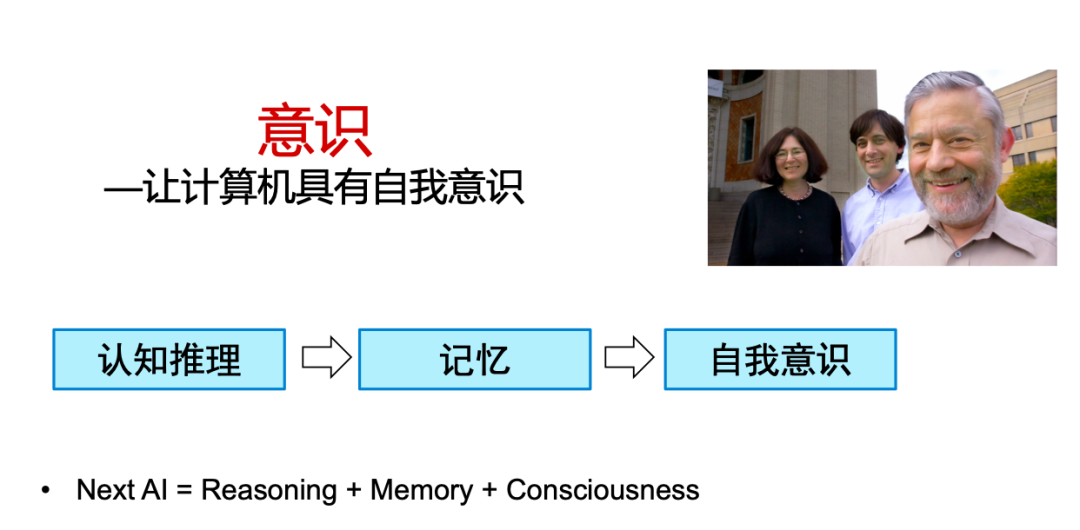

我们再说远一点, 30 年以后的挑战是什么?

我认为,应该是让计算机具有自我意识,我们称其为有意识 AI 。核心内容是,把认知推理跟人的记忆模型、计算机的自我意识联合起来。这种模型借鉴了认知心理学中的全局工作理论(GWT)。

我曾经对 GWT 做过一个解读,放在这里也是合适的:

所谓有意识学习,就是有目标的机器学习,给定数据,训练一个模型,通过模型进行分类(决策)。所以有意识学习输出是一个短期记忆模型,但这个短期记忆模型比较简单:数据有限、无背景知识。

所以无意识就对应着长期记忆模型。长期记忆模型有点类似半监督或者无监督学习模型,或者当下比较流行的预训练和自监督学习。无意识处理对应多种长期记忆,所以无意识可以考虑多个不同的处理器,这些处理器之间可以有链接,也可以没有,很多时候是并行处理。但针对特定任务,比如有意识思考某个问题的时候,形成特定连接,包括无意识处理器(无监督模型)和有意识处理器(有监督模型)之间的连接,这里可以考虑成fine-tune。当然连接权重可以通过外界反馈强化学习来实现。无意识处理器之间的连接以及和有意识处理器之间的连接可以类比为注意力机制。

最后值得注意的是长期记忆的构造和实现,人脑记忆保存的是模型图,而不是概念图。每个长期记忆都可能是一个模型,可以生成样本,具体学习方法,可以想象一下是一个层次聚类。通过这样就可以用有监督、无监督、强化、注意力、fine-tune 来实现 GWT 模型。

这其实相当于用计算机模拟了人的全局工作理论。这个方面的研究工作仍在初期阶段。如果有兴趣,可以加入研究,一起做相关的探索。

点击阅读原文,直达NeurIPS小组~