不到 3 天截稿!NeurIPS 2020 新要求提交的“影响陈述”还不会写怎么办?

评估机器学习研究的影响的七大建议

-

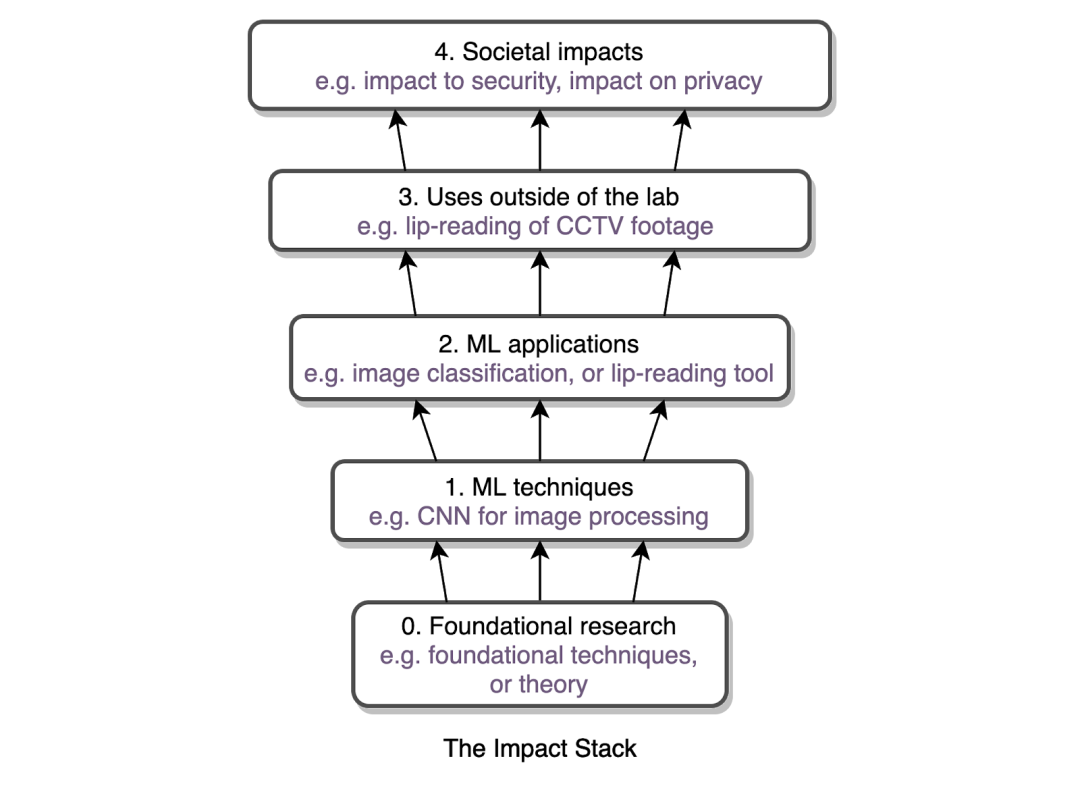

你可能会特意将评估范围限制在那些特别易于分析的影响上,例如最明显的直接影响。但实际上,你可以把重点放在与你的专业知识特别相关的、具有比较优势的影响上。 -

你可以关注那些容易被忽视的影响。对于研究人员来说,覆盖例如视觉系统等可能存在的所有潜在影响,比像其他所有人一样在同一个细节层次上讨论最显而易见的问题(例如众所周知的滥用监视系统的风险),会更有成效。 -

你可以关注那些特别重要的影响,比如那些可能破坏或加强民主制度中的公共审议的应用,即便这些影响的推测成分比较大。

2

“影响陈述”撰写指南

Q1:应用——你的研究会对ML 应用产生怎样的影响?

-

你的研究对已有应用会带来什么影响,以及如何产生影响。例如,你在transformer上的研究成功可能改善各类NLP 应用。 -

你的研究可能会推动哪些新应用的诞生,并解释清楚如何做到? -

可能受你研究影响的应用,都有什么属性?这是考虑到应用了你的研究思路的ML 应用,可能会跟其他应用有所不同。增加可解释性、样本效率和准确性,都会对下游应用产生不同的影响。 -

研究过程中相关的道德考量,比如说使用的数据是否存在隐私或公平性问题。

Q2:影响——这些应用会产生怎样的社会影响?

对于不同实体(企业、政府以及个人)而言可能存在的用途,尤其要考虑到新颖的用处以及恶意的、善意这样的用途。

这些用途造成的社会影响范围,包括对终端用户、企业以及政府等各个群体的预期和非预期、短期和长期影响。在考虑潜在风险时,可以考虑事故、恶意使用和结构性风险。

确定用途的主要属性带来的影响。特别是,需要确定由于失误或局限性(例如隐私、公平、透明)所带来的影响。

Q3:举措——怎样的研究或举措能够提高社会产出?

对ML研究的建议,例如如何让研究转变成有益应用、提高对风险的理解或控制技术(比如诊断工具或让算法更加鲁棒的策略)等方面的思路。

ML 领域以外的研究建议,如心理学、经济学、政治学、哲学等。你提到的想法可能会揭示新的技术可能性,对此就需要更多的社会研究来理解其含义,并设计非技术性的控制机制。

其他举措,包括对其他类型的行为体,如公司、决策者、教育者、监管机构和媒体如何应对研究带来的可能性的建议。

3

案例分析

GNN 可广泛应用于很多领域,包括计算机视觉、自然语言处理、推荐系统、流量预测、生成模型等。我们的研究可用来为这些应用中使用的 GNN 提供解释,提高对单个决策以及底层模型的理解。

一般而言,使用GNN 确实会带来一些比较重要的影响,但在这里,我们着重讨论使用GNN Explainer 为此类系统提供解释会产生的影响。

使用这种工具有许多好处,例如提高决策关键型应用的透明度、降低公平性、隐私和安全风险。不过,增加可解释性反过来也存在潜在风险,而这一点通常较少受到关注。这些潜在风险包括:1)自动化偏差的风险,即对模型过度信任;2)如果使用解释意味着系统现在可能被ML专业水平较低的人使用,而这可能会增加模型或其输出被错误使用的风险;3)如果只在发展阶段使用解释,之后又对模型进行再训练,改变其行为,就可能给人带来错误的“安全感”。

现在,有不少将 GNNExplainer 应用于积极目的的研究,例如研究 GNNExplainer 是否能够提高算法公平。为了降低使用其生成的解释的风险,我们建议研究人员了解在特定真实场景中使用GNNExplainer带来的影响,比方说,在这些场景中,使用者是否了解其给出的解释并做出相应行为而不至于沦为自动化偏见的牺牲品?随着时间的推移,使用这些系统是否能增加或减少人类的领域专业知识。

2、SuperGLUE —NLP 基准

我们提出的新基准,将有助于加速NLP 应用的发展进程,与此同时还能像GLUE一样,推动通用语言系统的开发。这些语言系统可以完成一系列任务,包括从问答、情感分析到诗歌乃至角色扮演游戏等等。

在此基准的支持和推动下,NLP 系统将有助于实现技术的广泛应用,包括客户服务、服务台、零售和销售、医疗服务、金融和法律服务以及营销。

这些应用都有可能产生广泛的社会影响:服务台使用对话系统代替人工,可以节省成本并消除重复性劳动,不过另一方面也可能导致人类失业;搭载于智能家庭设备中的个人语音助理,可以增加老年人行为上的自主性,但也可能会带来一些关于加强性别模式、收集个人数据以及黑客攻占私人信息风险的问题。特别需要注意的是,NLP 模型很可能被一些人恶意利用,来传播错误信息或营造不信任、不确定的信息环境(GPT-2发布之初也引发了相关问题的讨论)。

另外也有一些与基准本身相关的重要考量因素。任何被广泛使用的基准,都有可能在某个方面“扭曲”研究本身。例如,我们的这一基准可能会偏向于在英文语言上表现较好的方法的研究,此外在有偏数据上训练出来的模型,可能会延续这些数据固有的偏见,比如说性别偏见。为了降低这一风险,我们的基准内嵌了Winogender这一分析工具,来说明模型是否体现出了性别偏见。

我们将开展进一步的研究工作,来理解 SuperGLUE 中使用的数据集的偏见和局限性。我们也提倡其他基准也应采取相关举措,包括使用检测性别偏见和其他局限性的分析工具。与此同时,我们也鼓励研究人员开发用于有益任务的NLP 系统,例如基于文本的咨询系统。

我们认为,社区也有必要开展理解和减轻NLP 应用中风险的研究。比如针对机器生成错误信息的问题,此前一个解决方法是开发检测系统来检测错误,然而,随着NLP 技术的改进,这些检测系统的有效性会逐渐降低。因而,我们建议研究人员和政策制定者寻找方法,来利用平台来检测和阻止恶意内容的传播,而不是机器生成的内容。

3、Pluribus — 在多人扑克比赛中战胜人类的AI

对于扑克游戏系统的影响,我们认为应该主要聚焦于开发隐藏信息设置中的策略能力带来的长期影响。这样的能力能够应用于广泛的场景,例如拍卖、匹配、日程安排、定价以及网络安全等。

随着隐藏信息策略游戏中参与者在技能方面的不断优化,可能会对福利产生复合效应,这取决于这些能力的分布方式和策略设置的特征。例如在扑克游戏中,当设置接近零和时,技能的任何变化只可能会将价值转移到那些技能提高得更多的一方身上。如果富人能够获得更多的技能,就有可能促进财富的集中。如果设置为帕累托改进(Pareto Improvement) ,在贸易谈判等场景中,可能会增加总福利。也就是说,最终这项技术能给社会带来有害或者有益的影响,取决于动机不良或动机纯良的公民谁能够利用好这项技术进步。

我们建议社会科学和机器学习领域的研究人员尝试研究如下问题:

从这项研究和相关研究中获得的思路,可以应用到其他哪些应用中?

如果这一系列研究确实提高了特定领域的策略能力,那么这些能力将如何分布?

-

如果这些能力分布不均,总体福利效果如何?如果这些能力均匀分布呢?

其他参考资料:

1、关于 AI 伦理和治理的相关资料,可参考

The Ethics and Governance of Artificial Intelligence,http://blogs.harvard.edu/jzwrites/files/2017/07/1_19_Ethics-and-Governance-of-AI-Syllabus.pdf

The ethics of artificial intelligence: Issues and initiatives,https://www.europarl.europa.eu/RegData/etudes/STUD/2020/634452/EPRS_STU(2020)634452_EN.pdf

AI Governance: A Research Agenda,https://www.fhi.ox.ac.uk/wp-content/uploads/GovAI-Agenda.pdf

The Ethics and Governance of Artificial Intelligence,http://blogs.harvard.edu/jzwrites/files/2017/07/1_19_Ethics-and-Governance-of-AI-Syllabus.pdf

The ethics of artificial intelligence: Issues and initiatives,https://www.europarl.europa.eu/RegData/etudes/STUD/2020/634452/EPRS_STU(2020)634452_EN.pdf

AI Governance: A Research Agenda,https://www.fhi.ox.ac.uk/wp-content/uploads/GovAI-Agenda.pdf

NeurIPS官网,https://neurips.cc/Conferences/2020/PaperInformation/NeurIPS-FAQ

Suggestions for Writing NeurIPS 2020 Broader Impacts Statements,https://medium.com/@BrentH/suggestions-for-writing-neurips-2020-broader-impacts-statements-121da1b765bf

It’s Time to Do Something: Mitigating the Negative Impacts of Computing Through a Change to the Peer Review Process,http://www.brenthecht.com/papers/FCADIscussions_NegativeImpactsPost_032918.pdf

A Framework for Responsible Innovation,https://onlinelibrary.wiley.com/doi/10.1002/9781118551424.ch2

-

RRI,https://www.rri-tools.eu/about-rri

AI 科技评论希望能够招聘 科技编辑/记者 一名

办公地点:北京/深圳

职务:以参与学术顶会报道、人物专访为主

工作内容:

1、参加各种人工智能学术会议,并做会议内容报道;

2、采访人工智能领域学者或研发人员;

3、关注学术领域热点事件,并及时跟踪报道。

要求:

1、热爱人工智能学术研究内容,擅长与学者或企业工程人员打交道;

2、有一定的理工科背景,对人工智能技术有所了解者更佳;

3、英语能力强(工作内容涉及大量英文资料);

4、学习能力强,对人工智能前沿技术有一定的了解,并能够逐渐形成自己的观点。

感兴趣者,可将简历发送到邮箱:cenfeng@leiphone.com