论文浅尝 | 基于知识图谱和注意力图卷积神经网络的可解释零样本学习

论文题目:Explainable Zero-shot Learning via Attentive Graph Convolutional Network and Knowledge Graphs

本文作者:耿玉霞,浙江大学在读博士,研究方向为知识图谱、零样本学习、可解释性

发表期刊:Semantic Web Journal (IF=3.524)

论文链接:http://www.semantic-web-journal.net/content/explainable-zero-shot-learning-attentive-graph-convolutional-network-and-knowledge-graphs-1

零样本学习(Zero-shot Learning, ZSL)近年来引起了广泛关注,它可以将训练类别(Seen Classes)学习到的样本特征迁移到未出现在训练集中的新类别(Unseen Classes)上,有效减少了机器学习模型尤其是深度学习模型对标记数据的依赖。然而,目前大部分的ZSL方法是缺乏可解释性的,其模型预测的结果很容易被人质疑。因此,本文基于知识图谱和注意力图卷积神经网络提出了一个ZSL的可解释性框架,解释ZSL场景中样本特征的可迁移性,以此提升模型的可信赖度。

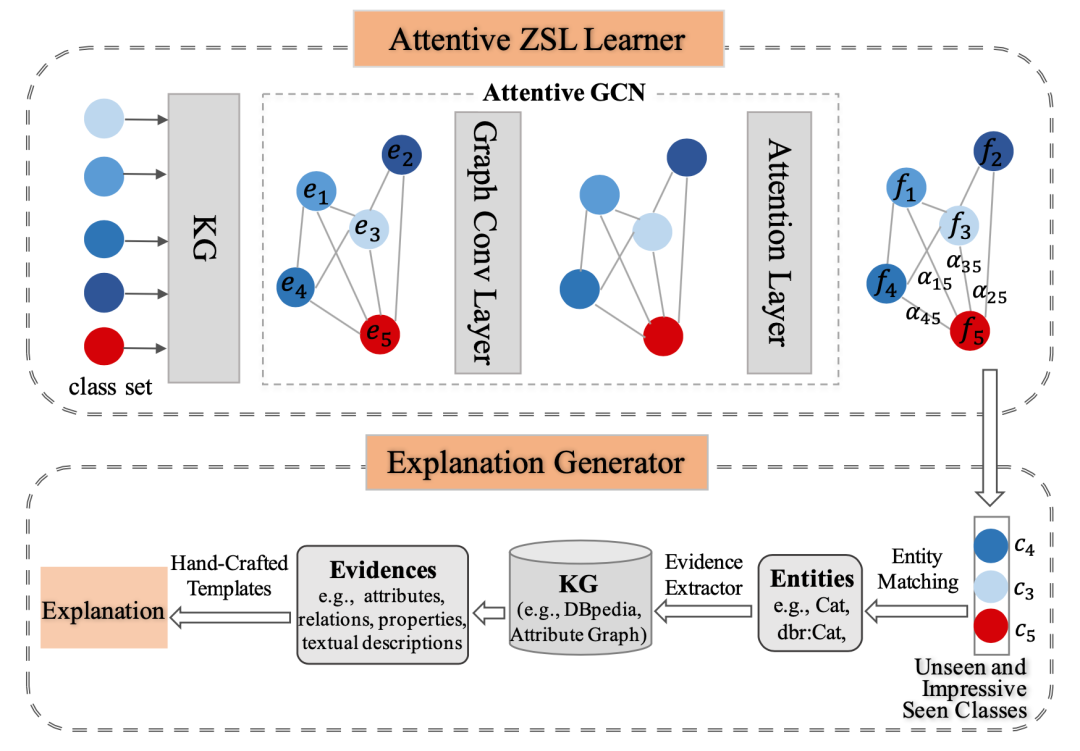

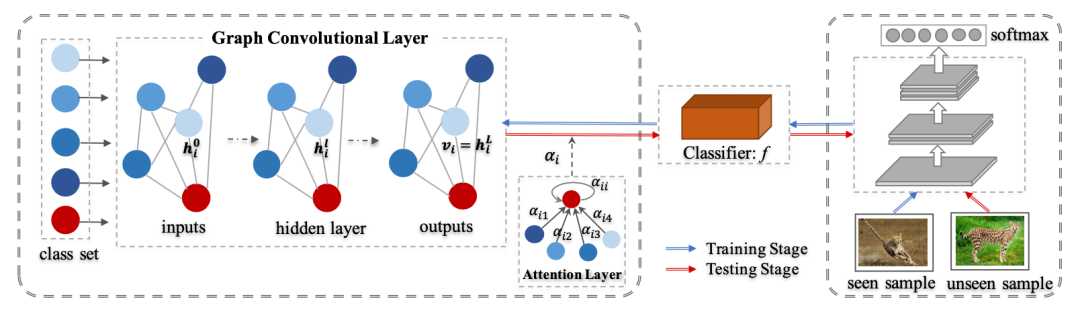

本文提出了一个基于知识图谱的ZSL可解释框架,在使用知识图谱帮助ZSL特征迁移的同时,利用知识图谱中丰富的类别知识,对特征的可迁移性作出解释。框架如图1所示,主要包括两部分:注意力ZSL学习器(Attentive ZSL Learner)和解释生成器(Explanation Generator)。其中:

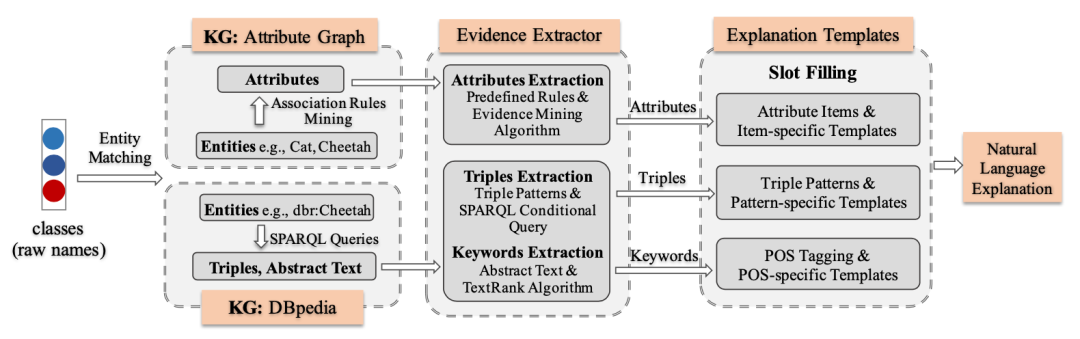

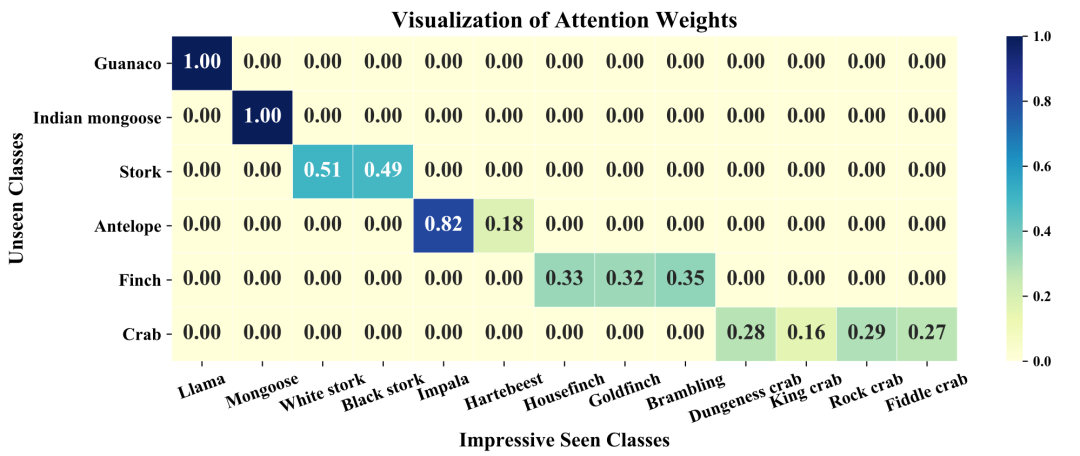

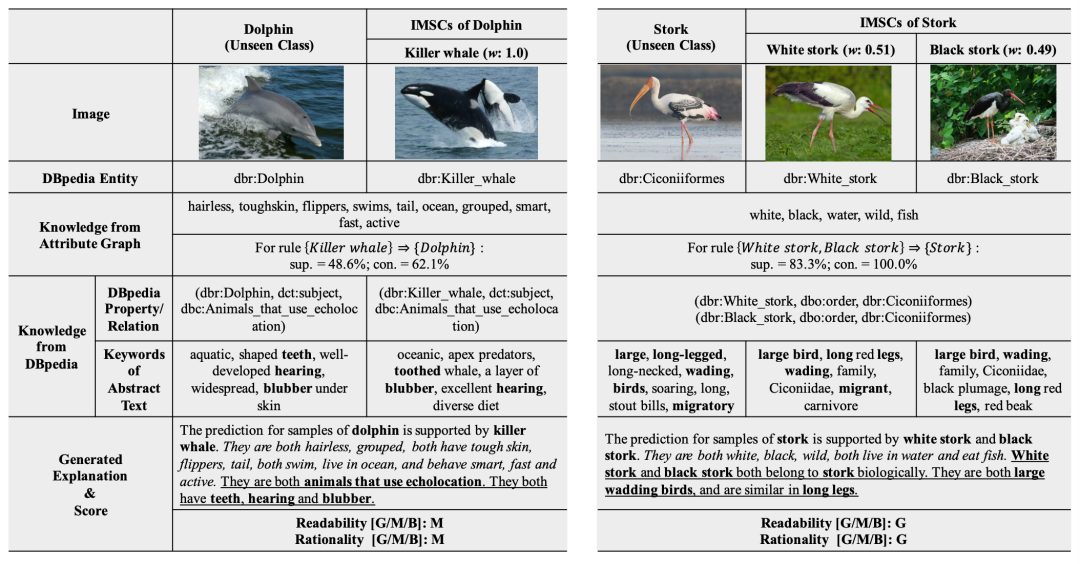

(2) 给定unseen class和它学习到的IMSCs,解释生成器(Explanation Generator)将它们分别对齐到外部知识图谱如Attribute Graph和DBpedia中抽取类别间的共有知识,并生成自然语言的解释,以此验证IMSCs的特征迁移到该unseen class的合理性,对类别间特征的可迁移性作出解释。其中,考虑到不同知识图谱中知识类型的不同,本文设计了三种知识抽取的算法,如基于关联规则挖掘的属性抽取算法、基于三元组模式和SPARQL查询语句的三元组抽取算法、以及基于TextRank的关键词抽取算法分别抽取类别间共有的属性、三元组及关键词。对应地,本文为抽取到的不同类型的知识,设计了不同的模版,以自然语言句子的形式组织这些知识,最终生成人可以理解的解释,生成器的模型结构图如图3所示。

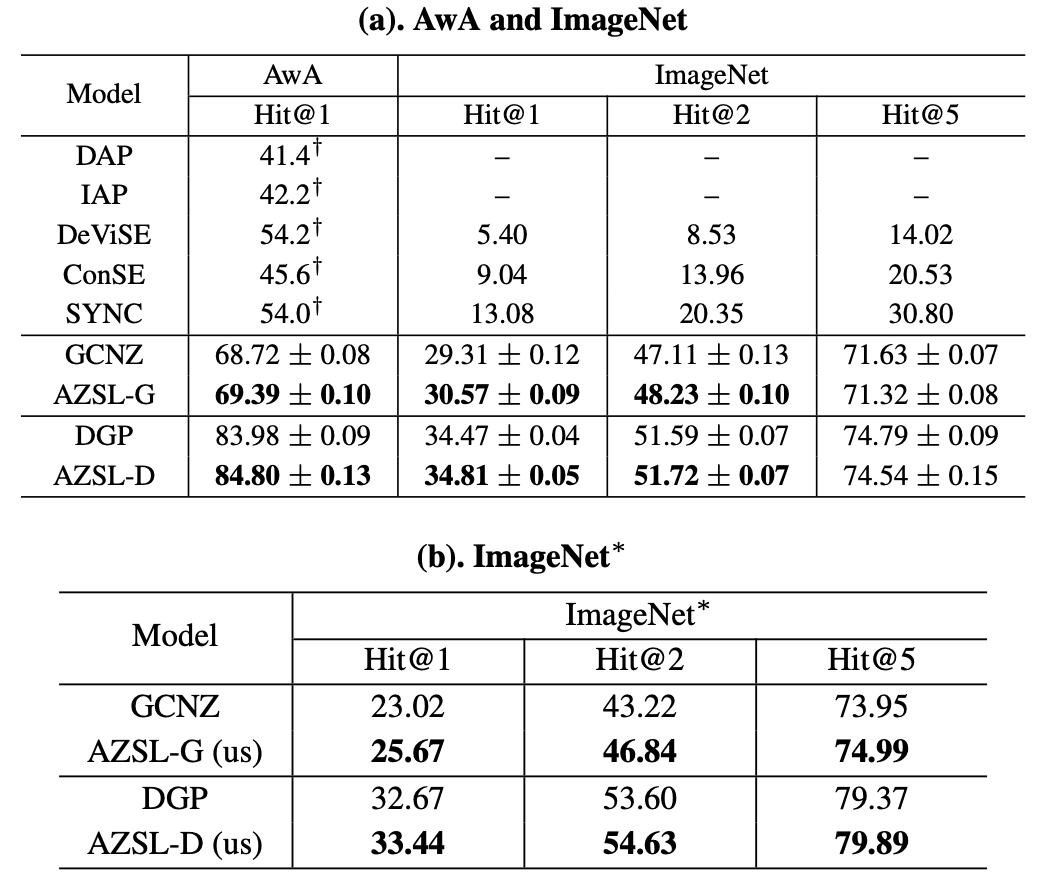

最终,本文在AwA和ImageNet两个数据集以及更稠密的ImageNet*数据集上验证了ZSL学习器的效果,同时邀请志愿者对生成的解释在可信度和可读性两方面进行了评估,并给出了一些案例。基于生成的解释,本文对ZSL模型中特征迁移的情况进行了更深入的讨论。评估结果分别如下:

总而言之,这篇文章研究工作的主要贡献是:

(1) 首次提出了基于知识图谱的ZSL可解释框架,用于解释ZSL中特征的可迁移性;

(2) 提出了一个新的、基于知识图谱和注意力图卷积神经网络的ZSL算法,它利用知识图谱建模类别间的语义关系,并且将样本特征由seen classes迁移到unseen classes,在标准数据集上提升ZSL模型效果的同时,为后面的可解释工作提供了基础;

浙江大学知识引擎实验室