光场显著性检测研究综述

显著性检测一直是计算机视觉领域的关键问题,在视觉跟踪、图像压缩和目标识别等方面有着非常重要的应用。基于传统RGB图像和RGB-D (RGB depth)图像的显著性检测易受复杂背景、光照、遮挡等因素影响,在复杂场景的检测精度较低,鲁棒的显著性检测仍存在很大挑战。随着光场成像技术的发展,人们开始从新的途径解决显著性检测问题。光场数据记录着空间光线位置信息和方向信息,隐含场景的几何结构,能为显著性检测提供可靠的背景、深度等先验信息。因此,利用光场数据进行显著性检测得到了广泛关注,成为研究热点。尽管基于光场数据的显著性检测算法陆续出现,但是缺少对该问题的深刻理解以及研究进展的全面综述。本文系统地综述了基于光场数据的显著性检测研究现状,并进行深入探讨和展望。对光场理论以及用于光场显著性检测的公共数据集进行介绍;系统地介绍了光场显著性检测领域的算法模型和最新进展,从人工设计光场特征、稀疏编码特征和深度学习特征等方面进行全面阐述及分析;通过4个公共光场显著性数据集上的实验数据对不同方法的优缺点进行比较和分析,并结合实际应用指出当前研究的局限性与发展趋势。

http://www.cjig.cn/jig/ch/reader/view_abstract.aspx?file_no=20201201&flag=1

在观测图像时,人类的视觉系统能够快速获取图像中感兴趣的区域和目标,这个过程称为视觉注意力机制。显著性检测是通过智能算法模拟人类视觉注意力机制,提取图像中人类感兴趣的区域(Borji等,2015)。显著性检测一直是计算机视觉领域的研究热点。显著性检测首先检测场景中最引人注意的目标,然后将这类目标作为整体划分出来。准确有效的显著性检测可以为视觉跟踪(Mahadevan和Vasconcelos,2012)、目标检测与识别(Han和Vasconcelos,2014)和视频压缩(Itti,2004)等提供可靠的先验信息。

自Itti等人(1998)提出多尺度显著性检测模型以来,出现了大量各式各样的显著性检测模型,显著性检测算法的性能逐步提升,取得了很大进展(Ju等,2014;Ren等,2015)。但是在复杂场景中,鲁棒的显著性检测仍存在很大挑战,主要表现在:1)场景中存在多个显著目标且尺度变化较大;2)显著区域的颜色或纹理与背景相似;3)场景中光源颜色不一致;4)显著目标被部分遮挡;5)难以提取完整目标。

针对这些难点,研究者提出多种显著性检测算法,根据使用数据来源不同,这些显著性检测算法分为3类:基于RGB图像的显著性检测算法、基于RGB-D(RGB depth)图像的显著性检测算法和基于光场数据的显著性检测算法。其中基于RGB图像的显著性检测算法最多,一个原因是RGB图像是人们生活中最广泛使用且最容易获取的图像。这类算法大多通过计算图像的颜色、形状、方向以及纹理等底层图像特征(Xu等,2013;Zhao和Koch,2012)获取显著线索,或利用特征学习技术如卷积神经网络(Li和Yu,2015a)、稀疏编码(Li等,2013b)或者循环神经网络(Tang等,2016)等方式检测显著性目标。虽然这些方法在显著性检测任务上取得了有竞争力的效果,但是对于挑战性场景,仍然可能出现显著目标检测错误。原因有两个:1)基于深度学习的显著性检测算法受限于RGB图像的特征;2)基于RGB图像的传统算法存在许多先验知识,如显著性区域与其周围环境存在高对比度、背景简单、显著性目标无遮挡、场景光源单一等,而实际上许多真实场景与这些先验相悖,导致基于RGB图像的传统算法性能降低,如图 1(Li等,2014)中基于全局对比度(global contrast,GC)的显著性检测算法(Cheng等,2015)和基于差别区域特征融合(discriminative regional feature integration,DRFI)的显著性检测算法(Jiang等,2013)都无法精准地从背景中分离显著目标。

Poggio和Poggio(1984)表明RGB图像不能完全表示人眼对世界的认识,因为RGB图像忽略了人的双目系统对场景深度的感知。深度信息能够区分位于不同深度层的物体,减少背景干扰(Wolfe和Horowitz,2004)。因此,学者们开始利用双目相机,如Kinect(Zhang,2012)获取含有深度信息的RGB-D图像,结合深度特征和RGB图像中的特征来提高显著性检测的鲁棒性(Lang等,2012;Peng等,2014)。然而,这类算法也存在两方面问题:1)基于RGB-D图像的显著性检测算法严重依赖深度图的质量,当深度图质量较差时,则无法为显著性检测提供有效信息;2)基于RGB-D图像的显著性检测算法常常忽略深度和外观之间的关联,当显著目标与背景有着相似的颜色和深度时,如图 2(Piao等,2019a)所示,基于异性中心-周围特征的深度显著性检测算法(anisotropic center-surround difference,ACSD)(Ju等,2014)也无法精准检测显著目标。

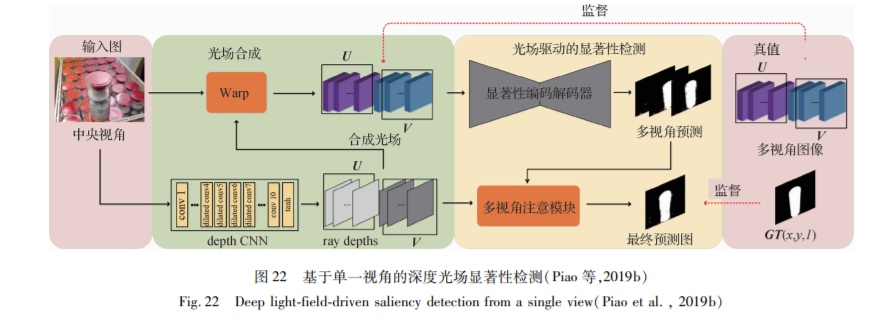

光场成像借助新的成像技术,能够同时记录光辐射在空间中的位置和方向信息(Adelson和Wang,1992),与RGB图像和RGB-D图像相比,光场数据包含了光的颜色、强度、位置和方向,更能反映自然场景的几何和反射特性,已成功用于计算机视觉的许多任务,如材料识别(Wang等,2016)、深度估计(Tao等,2017;Williem等,2018;Jeon,2019)和显著性检测(Li等,2014;Zhang等,2015)等。其中,在显著性检测任务中,相比RGB图像和RGB-D图像,利用光场数据进行显著性检测有以下优势:1)光场数据包含位置信息和角度信息,为获得场景深度信息提供了多视角几何信息;2)数字重聚焦技术(Ng等,2005)可以将光场数据合成一系列聚焦在不同深度层的焦点堆栈图像,显著目标个体通常处于同一深度面,利用这些焦点堆栈图像的聚焦区域线索,能够提供背景线索,更完整地检测显著目标;3)光场数据记录不同方向的光线信息,可以从多个角度描述场景,提供了有效的显著目标遮挡信息;4)从光场数据中能生成全聚焦图像,全聚焦图像中的每个像素都是清晰的,有更清楚的颜色、纹理等。从这些方面来看,光场数据可以为显著性检测提供更多信息以及解决检测难题的途径,有利于处理相似的前景和背景、显著目标被部分遮挡、多个显著目标等难点场景,如图 1所示,相比基于RGB图像的算法,光场显著性检测方法(light field saliency,LFS)(Li等,2014)更能应对复杂场景。

自Li等人(2014)利用光场数据进行显著性检测后,基于光场数据的显著性检测迅速发展,出现了很多基于光场数据的显著性检测算法(Zhang等,2015;Li等,2015b;Zhang等,2017;Wang等,2018b;Zhang等,2020),但是一直没有完整的关于光场显著性检测进展的文献综述和详细调查,目前,基于光场数据的显著性检测研究在该领域内仍然存在很大的进步空间,因此有必要进行全面综述和讨论。本文系统描述了基于光场数据的显著性检测研究进展和面临的挑战,希望能为进一步研究显著性检测提供帮助,并期待能启发更多的创新型工作。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“光场检测” 可以获取《光场显著性检测研究综述》专知下载链接索引