论文浅尝 - AAAI2020 | 基于知识图谱进行对话目标规划的开放域对话生成技术

论文笔记整理:张傲,天津大学硕士。

Knowledge Graph Grounded Goal Planning for Open-Domain Conversation Generation

来源:哈工大SCIR

动机

让机器生成有内容并且主题连贯的多轮开放域对话,是人工智能公认的关键任务之一。针对这一任务,研究人员尝试了一些基于端到端的生成模型,但模型生成的回复内容丰富性较低。有效聊天话题管理技术的实现目前主要面临两个挑战,1. 高层级对话目标(Gonversational Goal,聊天话题)序列的规划,其困难在于对话系统既要保持对话主题的连贯性,也要兼顾用户的兴趣,以免机器单方面的自说自话;2. 如何基于一个对话目标生成内容丰富的深入对话,此技术可以支持许多实际的对话应用场景,例如多个知识点的持续推荐、某个物品的推荐等。

为了解决以上两个问题,本文中提出了一个基于知识图谱的层次化强化学习框架(KnowHRL),进行多粒度回复指导信息的选择。

亮点

KnowHRL的亮点主要包括:

(1)该工作首次将多轮开放域对话拆解为两个子任务,即对话目标序列的规划及给定对话目标的深入对话;

(2)借助于知识图谱,该工作为对话策略(Dialog Policy)学习引入了显示的、可解释的对话状态与动作,不仅便于设计对话目标相关的Reward因子,还可使用对话目标以及细粒度话题指导回复生成;

(3)实验结果验证了KnowHRL模型在多个指标下的有效性,包括话题连贯性、用户兴趣一致性、知识准确率等;

概念及模型

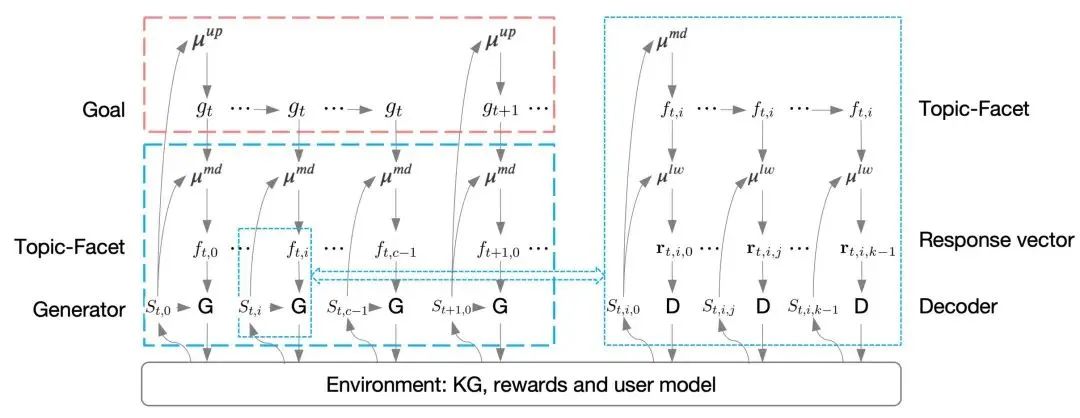

KnowHRL是一个基于知识的三层强化学习模型。具体来说,对于第一个子任务,上层策略学习遍历知识图(KG),以规划显式目标序列,从而在对话一致性、主题一致性与用户兴趣之间取得良好平衡。对于第二个子任务,中间层策略和下层策略协同工作,借助目标完成机制,围绕给定话题的同用户进行深入聊天。

KnowHRL具体由三层决策模块构成:

上层决策模块是第一个多层感知网络,负责通过在知识图谱中选取实体类节点,以规划一个主题连贯、多样、可持续的聊天话题序列(即图谱中的实体节点)。考虑到用户兴趣的建模,研究人员在 RL Reward中添加了回复句与用户话题一致性的度量因素。Combiner:多个成分利用 component-level attention 进行加权融合。

中层决策模块是第二个多层感知网络,负责从实体节点的邻居中选取一个节点(通常为实体属性),作为细粒度子话题。由于将对话目标是否完成形式化为SMDP中的Option,本文设计了另外一个模型,可以在中层Policy的每一步决策之后,都去判断当前对话目标是否完成。

下层决策模块是第三个多层感知网络,负责选取一个回复向量

RL Reward设计:

针对上层决策模块,本文中提出了五个因子,包括对话目标序列的主题连贯性、对话目标与用户话题的一致性、围绕当前对话目标的对话轮数、当前对话目标的可持续性(实体节点的Pagerank)以及来自中层决策模块的Reward打分。

针对中层决策模块,本文中设计了两个因子,一个是话题内的连贯性,另一个是来自下层决策模块的Reward打分。

针对下层决策模块,本文中提出了三个因子,包括回复句的相关性、回复句的信息丰富度以及回复句中是否提及了中层决策模块选择的细粒度话题(即实体属性名)。

实验

实验设置

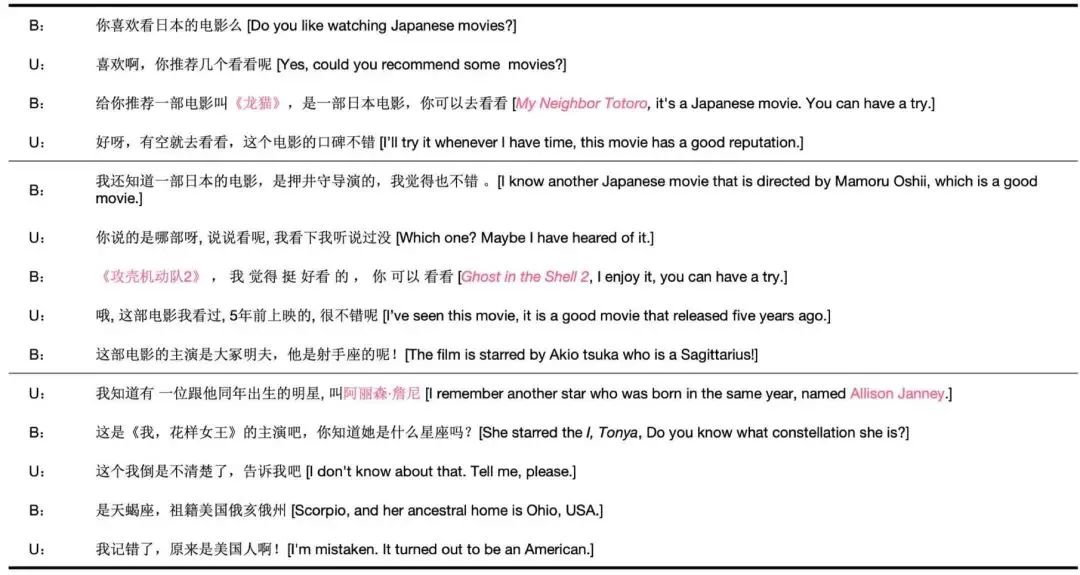

数据集:DuConv数据集包含30k对话Session,其中对话轮数为120k。本文将数据切分为训练集(100k轮对话)、开发集(10k 轮对话)以及测试集(10k轮对话)。该数据还提供了电影、明星领域的知识图谱,由人工进行标注,每个对话Session最终需要引导到一个预先给定的实体,并且对话需要围绕知识图谱中的相应知识进行。

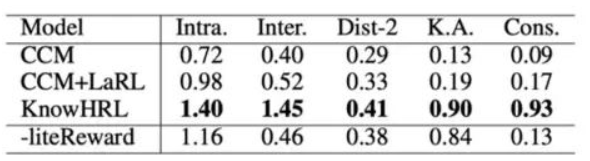

Baseline模型:1. CCM:基于图注意力机制的知识对话模型;2. CCM+LaRL:本文对一个基于隐变量以及RL的对话模型(LaRL)进行了改进,使用了CCM中的两个图注意力机制使得LaRL可以充分利用知识图谱。

评估指标:主题间连贯性(Inter-topic Coherence)、主题内连贯性(Intra-topic Coherence)、用户兴趣一致性(User Interest Consistency)、知识准确率等四个人工指标,同时使用Distinct指标评估回复多样性。

实验结果

实验样例

总结

本文中提出了一个基于知识图谱的层次化强化学习框架,该框架展示了如何基于知识图谱进行层次化的话题内容规划,从而进一步辅助聊天话题管理以及回复生成。在公开数据集上的实验表明,文中提出的方案在主题连贯性、用户兴趣一致性、知识准确率等指标上大幅超越基线。未来可能的改进工作是提升知识图谱的内容覆盖,例如可以在图谱中引入开放域对话的内容。

OpenKG

开放知识图谱(简称 OpenKG)旨在促进中文知识图谱数据的开放与互联,促进知识图谱和语义技术的普及和广泛应用。

点击阅读原文,进入 OpenKG 博客。