【EACL2021教程】无监督神经机器翻译,125页ppt

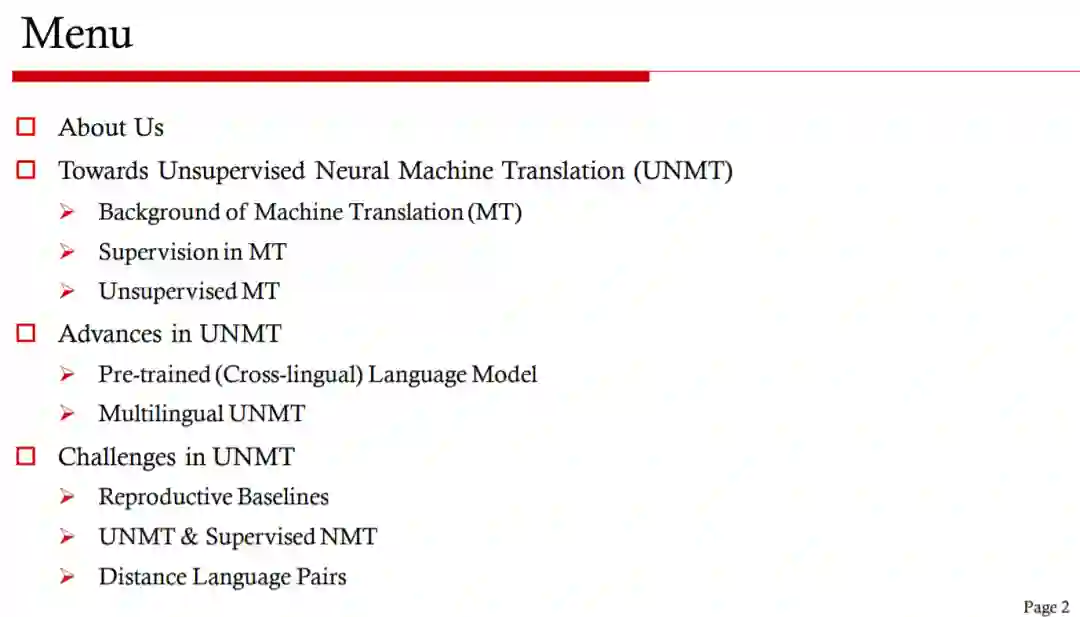

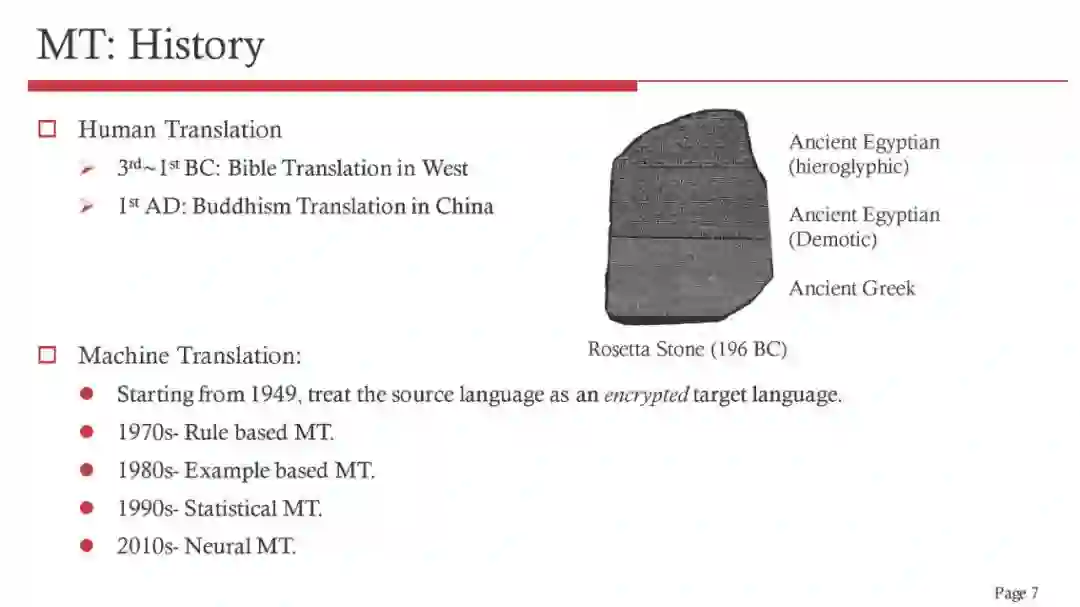

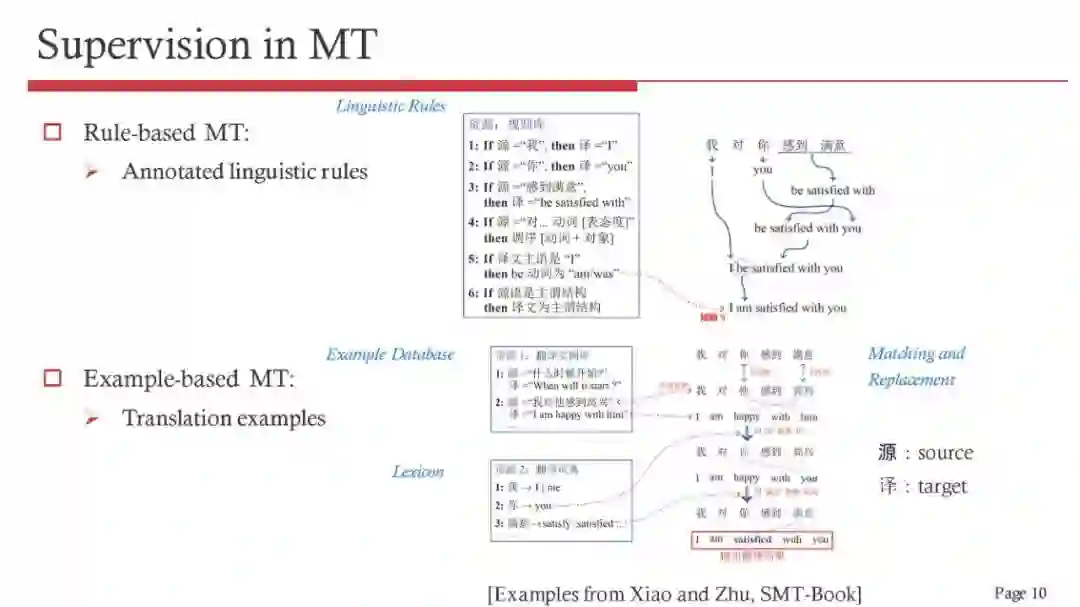

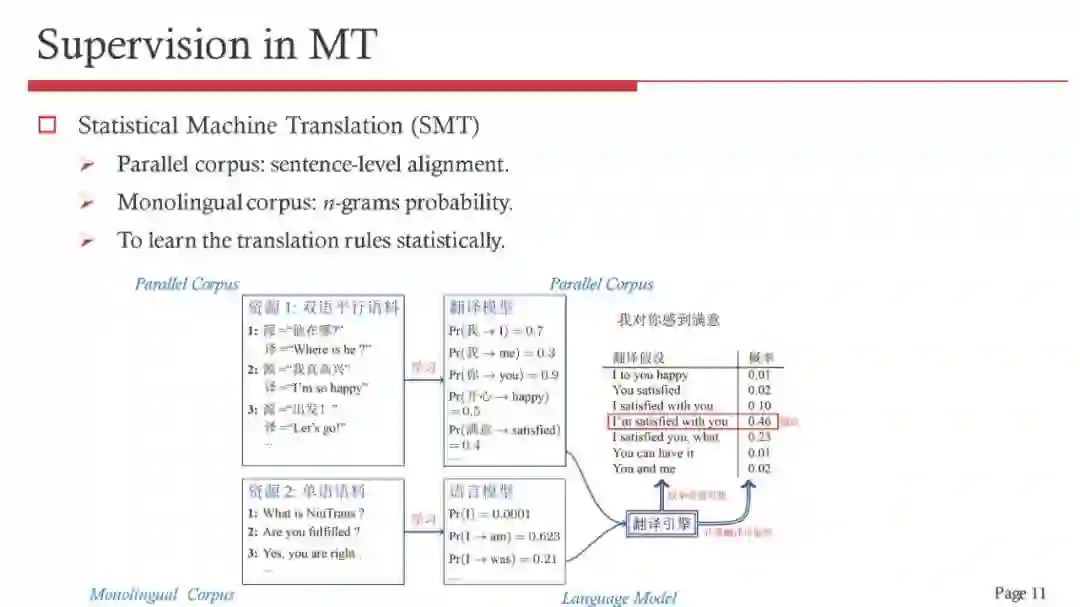

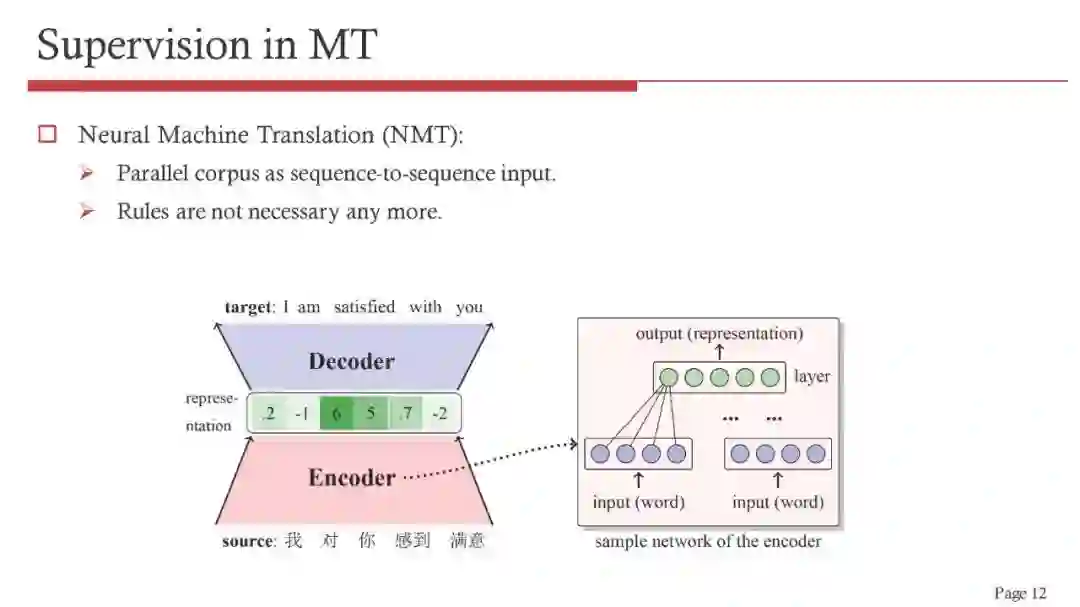

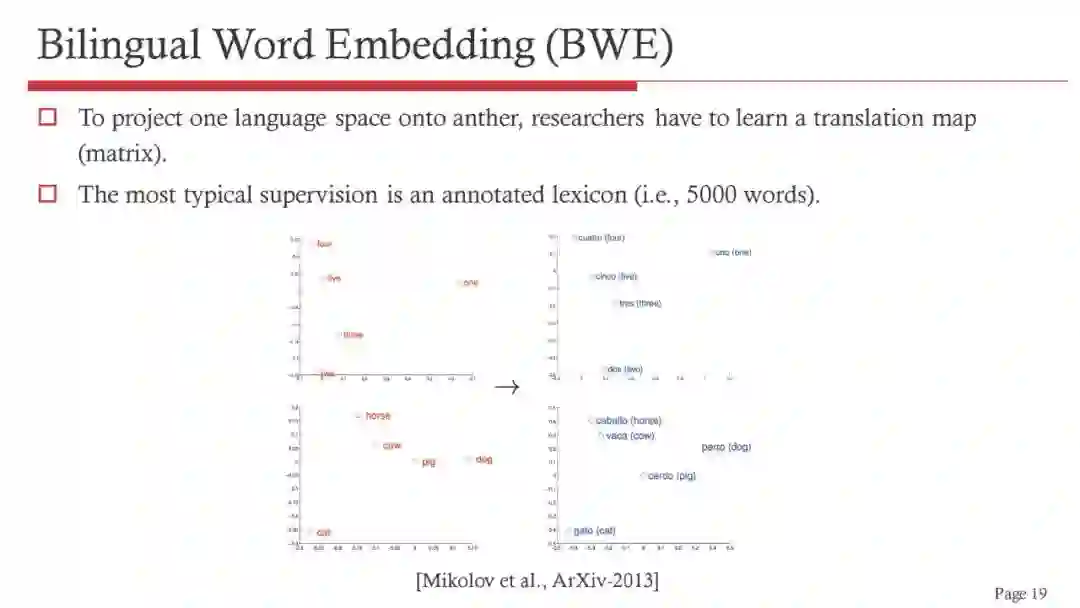

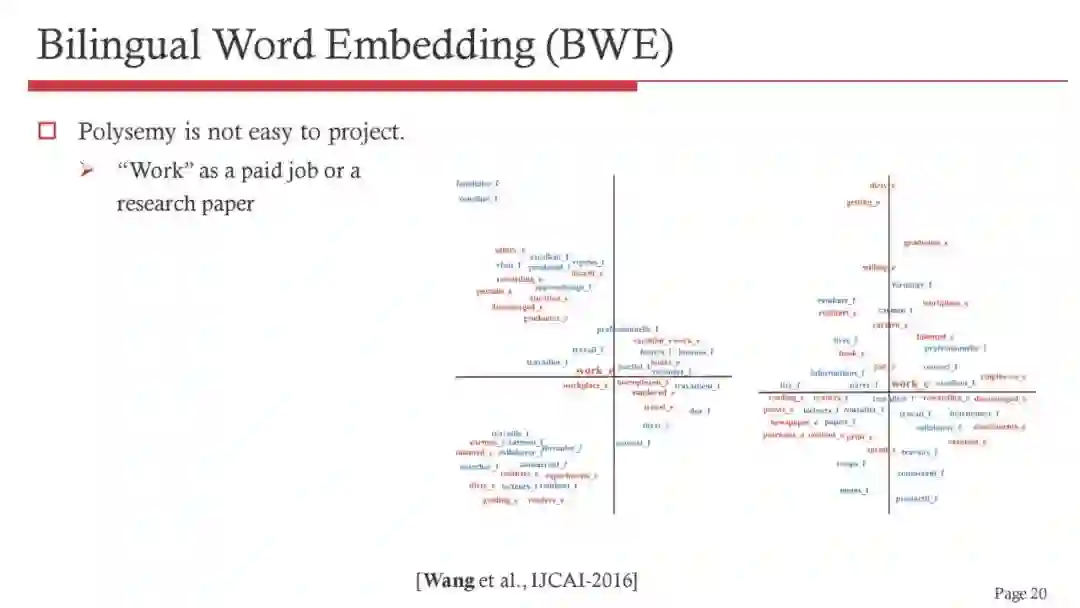

无监督跨语言表示初始化方法与去噪、反翻译等机制一起,发展了无监督神经机器翻译(UNMT),取得了令人印象深刻的效果。与此同时,UNMT仍面临若干挑战。本教程首先介绍UNMT的背景和最新进展。然后,我们审查了UNMT面临的一些挑战,并就该技术目前的表现给出了实证结果。

https://2021.eacl.org/downloads/tutorials/Advances-in-UNMT.pdf

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“UNMT” 就可以获取《【EACL2021教程】无监督神经机器翻译,125页ppt》专知下载链接

登录查看更多