【ECIR2021】信息检索技术进展: 从词袋到BERT,230页ppt

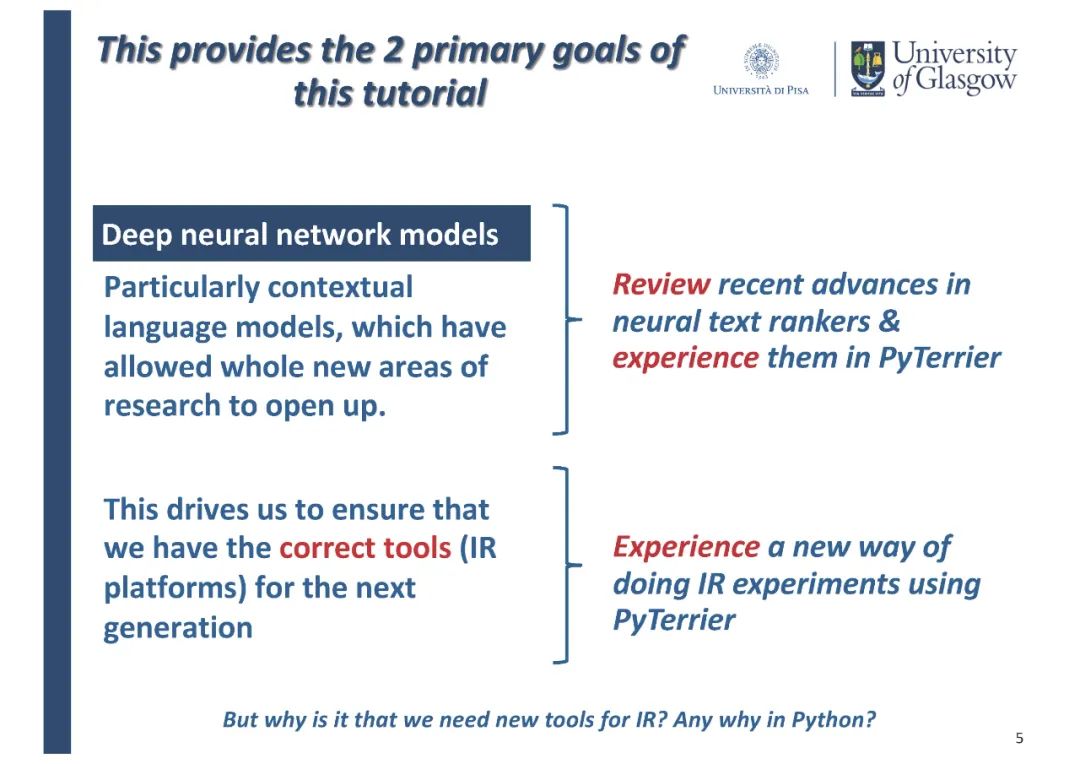

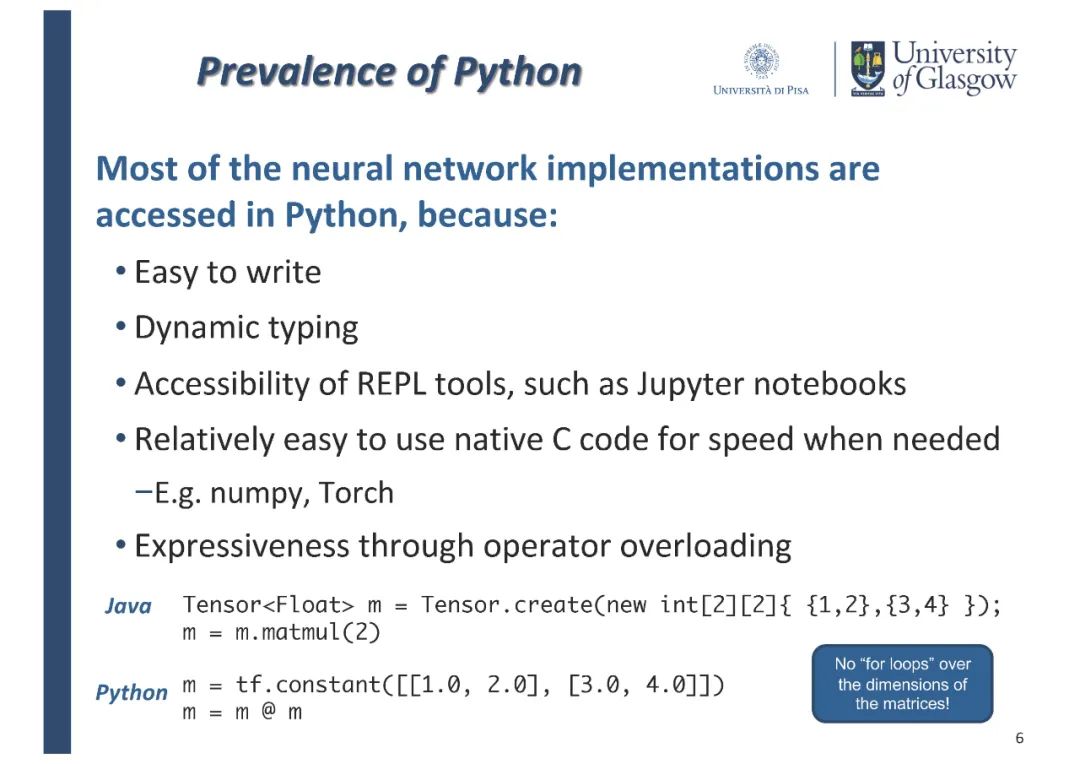

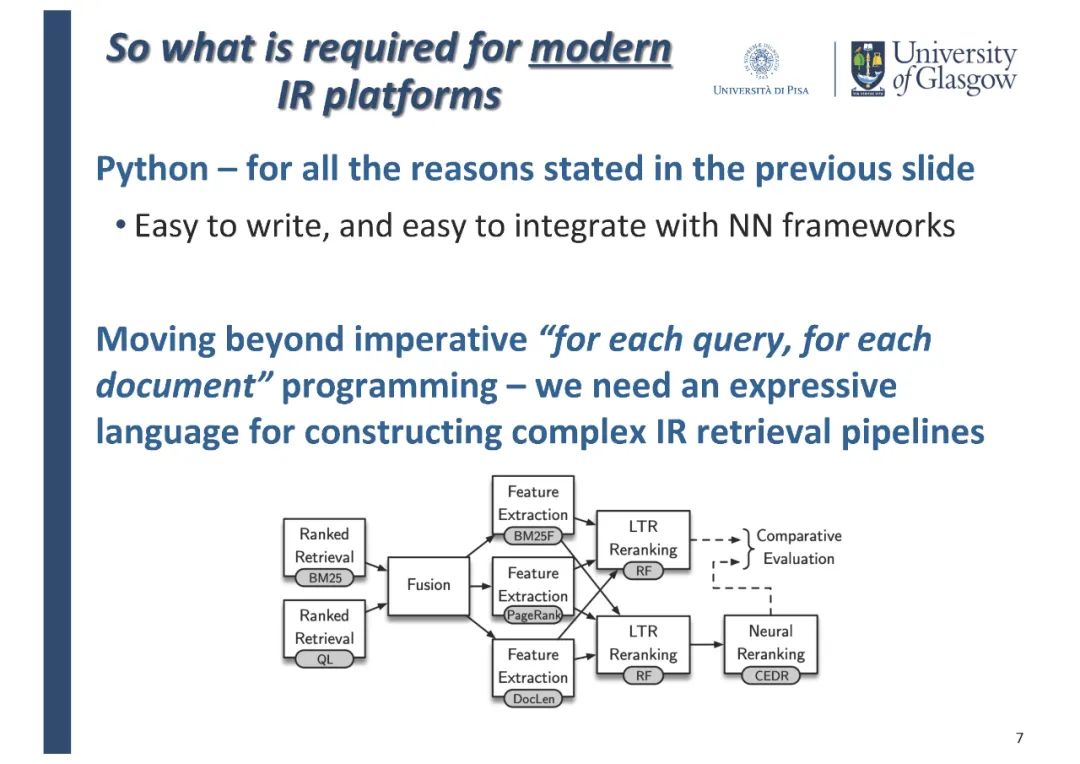

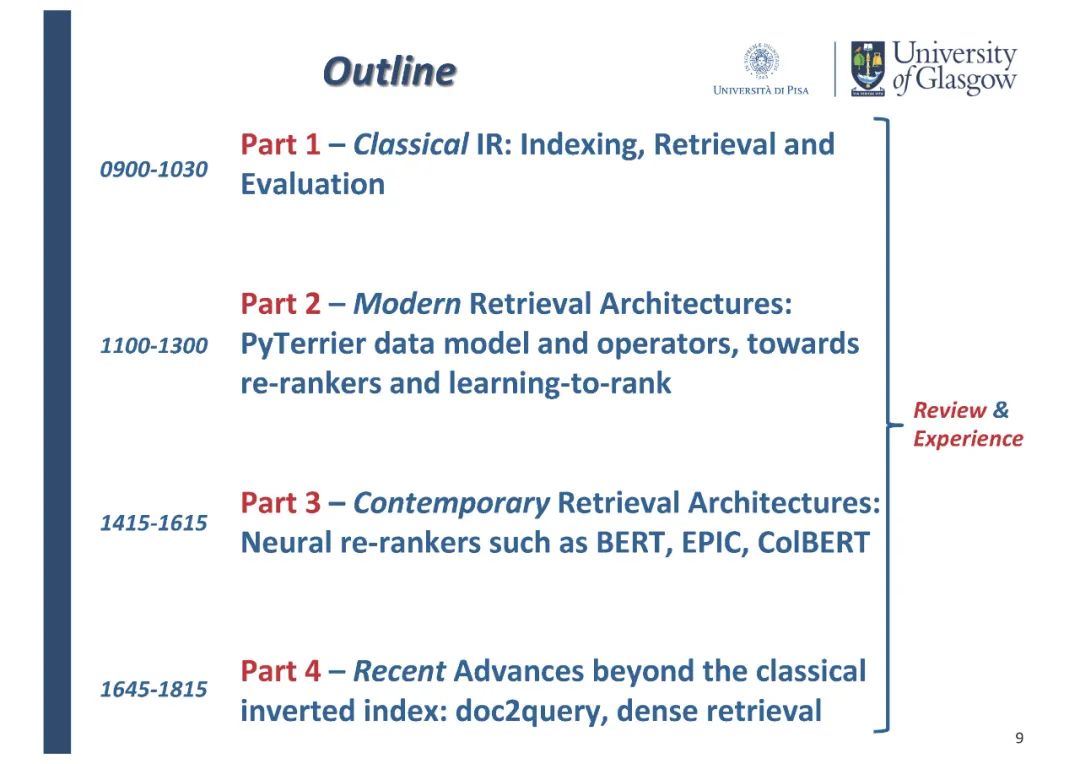

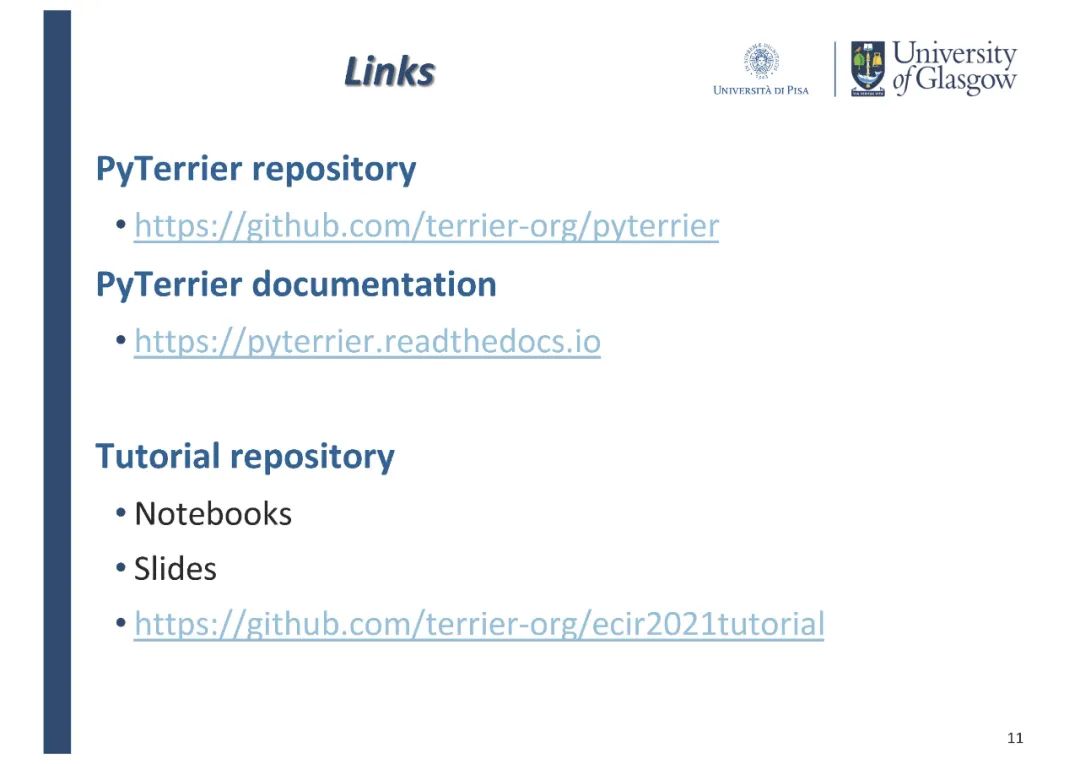

最近,自然语言处理领域的进步引发了adhoc搜索任务的复兴。特别是,大型上下文化语言建模技术,如BERT,已经为排序模型配备了比以前的单词袋(BoW)模型更深入的语言理解能力。将这些技术应用到新任务中是很棘手的,需要深度学习框架的知识,以及重要的脚本和数据分析。在这个搜索教程中,我们将从基本的检索原则建立到最新的神经排序技术。我们提供古典(例如,BoW),现代(例如,排序学习)和当代(例如,BERT搜索排名和重新排名技术的背景。进一步,我们详细说明并演示了如何以一种新的声明式的实验风格,以PyTerrier和OpenNIR搜索工具包为例,轻松地实验性地将这些方法应用到新的搜索任务中。

本教程对参与者来说是交互式的;它被分成几个部分,每个部分都是使用在谷歌协作平台上运行的准备好的Jupyter进行解释性演示和实践活动。

在本教程结束时,学员将能够轻松地访问经典的倒排索引数据结构,构建声明式检索管道,并使用最先进的神经排序模型进行实验。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“IR230” 就可以获取《【ECIR2021】信息检索技术进展: 从词袋到BERT,230页ppt》专知下载链接

登录查看更多

相关内容

欧洲信息检索会议(ECIR)是展示信息检索领域原创研究成果的欧洲主要论坛。ECIR在检索、表示、管理和使用文本、可视化和多模态信息的理论、实验和实践方面寻求高质量和原创的提交。ECIR强烈支持用户、系统、应用和评估重点论文。

官网地址:http://dblp.uni-trier.de/db/conf/ecir/

Arxiv

4+阅读 · 2019年9月11日

Arxiv

16+阅读 · 2019年5月24日