学界| ICLR 论文评选吃力不讨好? arxiv-sanity上有新发现

AI 科技评论按:ICLR 2017 将于4月24-26日在法国土伦举行,届时雷锋网AI科技评论的编辑们也将前往法国带来一线报道。在这个深度学习会议举办之前,AI科技评论也将围绕会议议程及论文介绍展开一系列的覆盖和专题报道,敬请期待。

Andrej Karpathy 认为,把每篇论文在 ICLR 2017 (International Conference on Learning Representations,一个广受欢迎的深度学习会议)的入选情况(分为4种:口头报告 (oral) ,海报展示 (poster) ,进一步研讨 (workshop) ,被拒 (reject) ),和该论文被添加到 arxiv-sanity 网站的 library 的次数进行交叉比较,是一件很有趣的事情。某篇论文是否能入选 ICLR 2017 ,是由几个相应领域的领头人和审稿人,经过几个月时间的审阅后才能决定的。而在 arxiv-sanity 上参与决定的人,只有每月为此投入总共2个小时的原作者,当然还有应对投稿洪流的若干网站工作人员。现在让我们来看看这场自上而下、自下而上的战役会发生什么。

投稿论文在 ICLR 2017的入选情况可以参看OpenReview.net的情况,投稿论文共计491篇,其中15篇(3%)论文将在会上做口头报告,183篇(37.3%)论文将被制成海报在会上展览,48篇(9.8%)论文被建议进一步研讨,245篇(49.9%)论文被拒绝。 ICLR 2017将于4月24日至27日在土伦举办,届时入选的论文将在会议上进行展示。期待一睹土伦这个美丽的城市:

法国 土伦

扯远了,让我们言归正传回到文章主题上。

另一方面,作者一方的 arxiv-sanity 网站具有library功能。换言之,任何注册用户都可以在该网站上他们的 library 里添加论文,然后基于所有收藏论文全文的二元 tf-idf 特征, arxiv-sanity 将为每位用户训练出个性化的支持向量机 (Support Vector Machine) ,提供基于内容的论文推荐。例如在网站里的 library 收藏一些关于加强学习 (Reinforcement Learning) 、生成模型 (Gnerative Models) 、计算机视觉 (Computer Vision) 的论文,无论网站何时出现关于这些主题的新论文,它们都将出现在“推荐”标签中的最上方。现在 arxiv-sanity 网站上的审查池 (review pool) 总共有3195个用户——他们是 library 里收藏至少一篇论文的用户,这些用户迄今共收录了55671篇论文,平均每人17.4篇。

arxiv-sanity 网站一个很重要的特征是,用户赞同 (upvote) 一篇论文后,会产生相应的影响。因为用户收录论文的动机暗示着此论文对用户来说非常重要,所以当用户收录一篇论文时,该论文会增加该文章方向上的推荐权衡,进而影响推荐给用户的论文。

实验

长话短说, Andrej 对 ICLR 中的所有论文进行了循环,然后在 arxiv-sanity 网站上,通过尝试对收录的论文的标题进行全字符匹配,把相同的论文找出来。论文没法匹配的原因可能是,有些 ICLR 论文没有被网站收录,有些论文因为作者重命名后与原题目不匹配,或者因为题目中包含不能匹配的奇特字符等。

例如,对 ICLR 2017进行口头报告的论文进行匹配,作者得到的结果是:

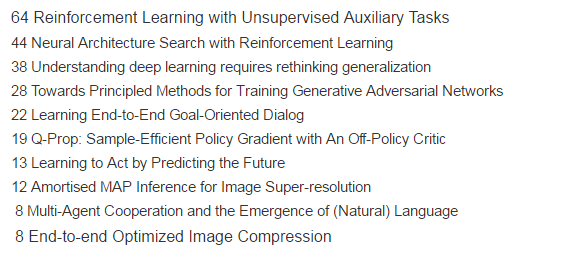

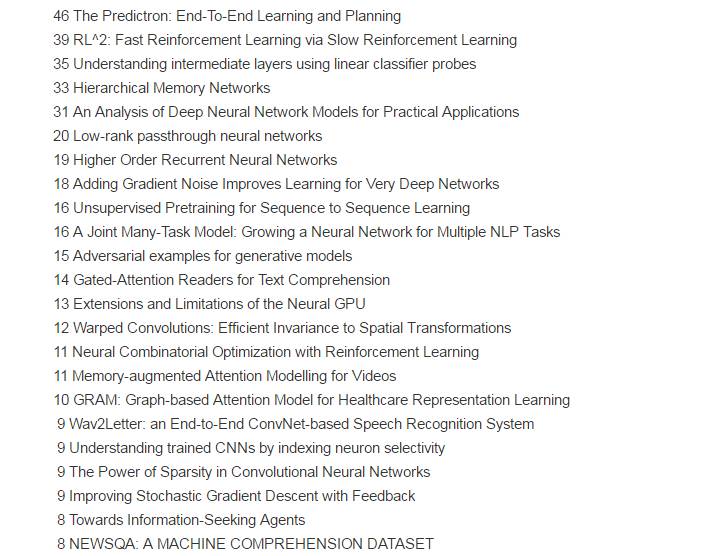

15篇进行口头报告的论文,在 arxiv-sanity 网站上找到了以下10篇,附带网站里的 library 收藏数:

这里看到,在 ICLR 做口头报告的15篇论文, arxiv-sanity 收录了10篇,题目左边的数字是网站里将这篇论文添加到 library 的用户数,例如, "Reinforcement Learning with Unsupervised Auxiliary Tasks" 被64个 arxiv-sanity 用户添加到了 library 。

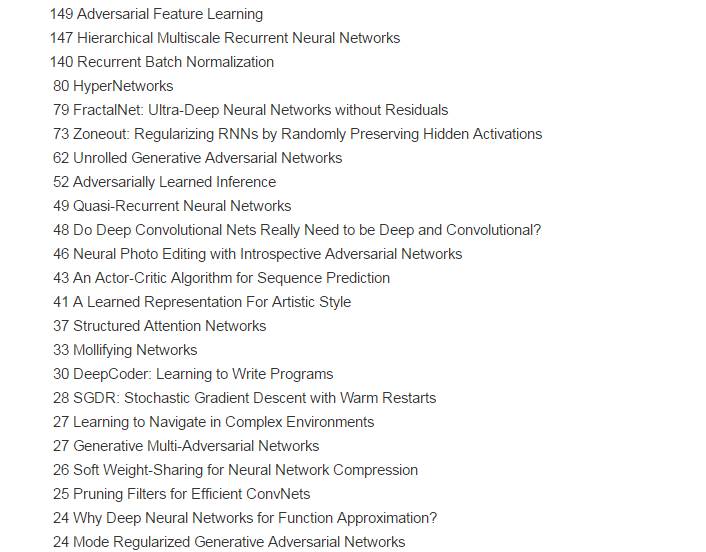

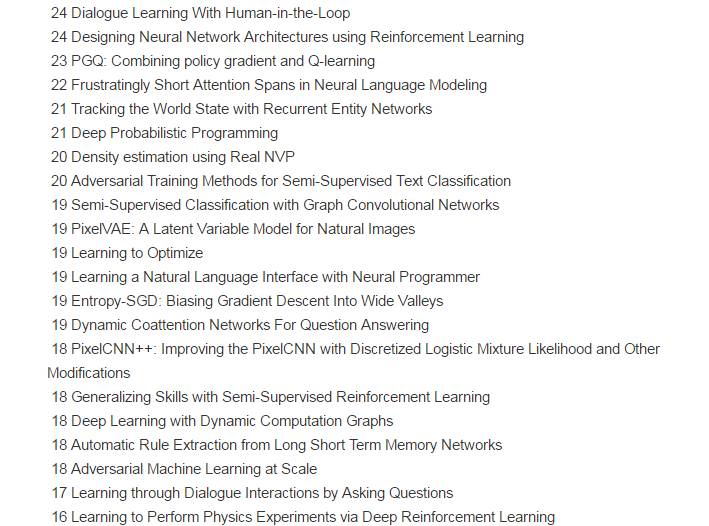

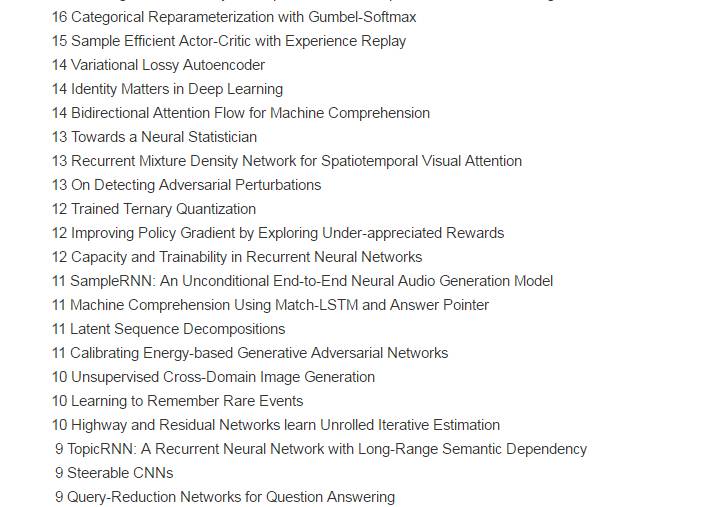

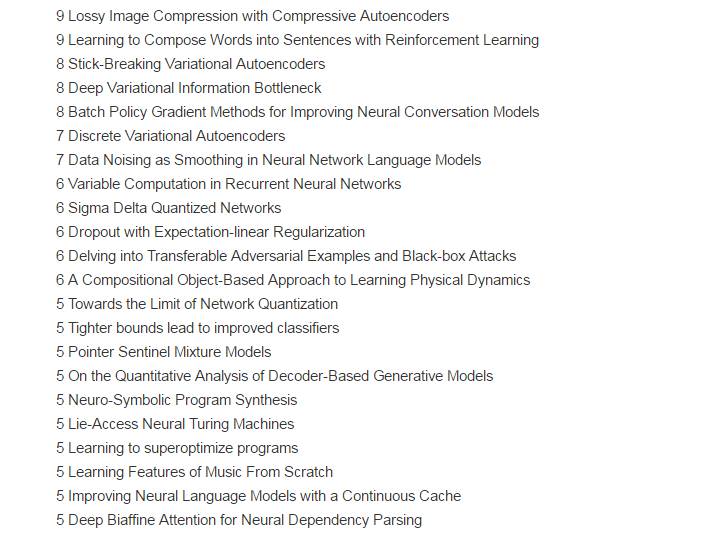

183篇制成海报展览的论文,在 arxiv-sanity 网站上找到了以下113篇,附带网站里的 library 收藏数:

某些论文得到了很多人的青睐,最多达到149人!然而收藏某些论文的人一个也没有。

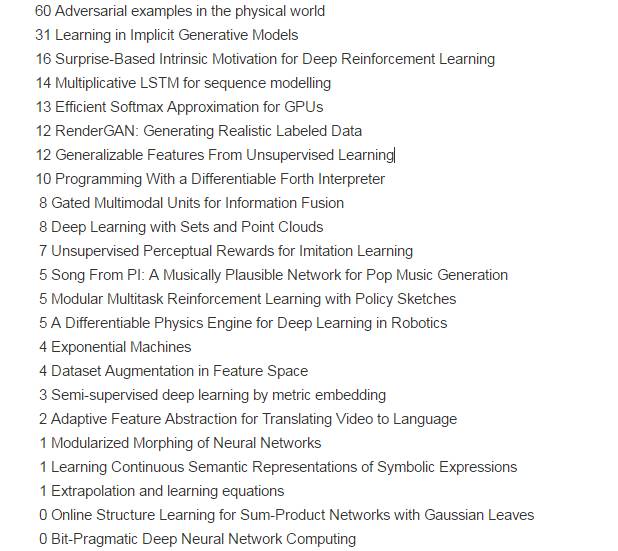

建议进一步研讨的论文,结果如下:

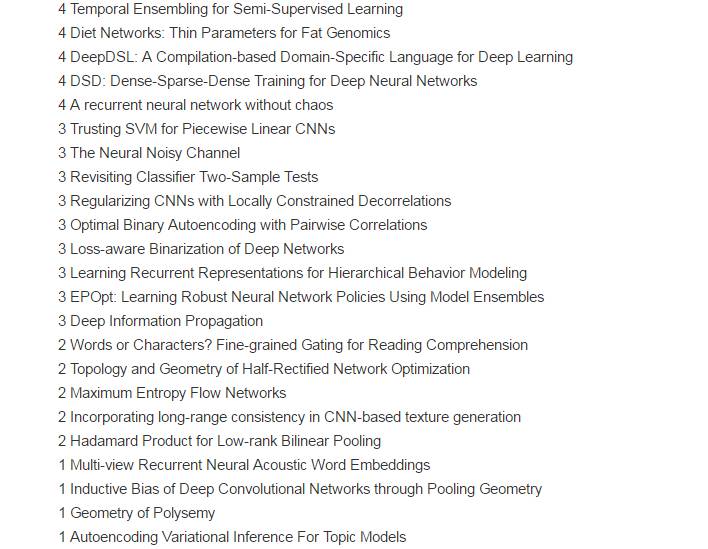

48篇建议进一步研讨的论文,在 arxiv-sanity 网站上找到了以下23篇,附带网站里的 library 收藏数:

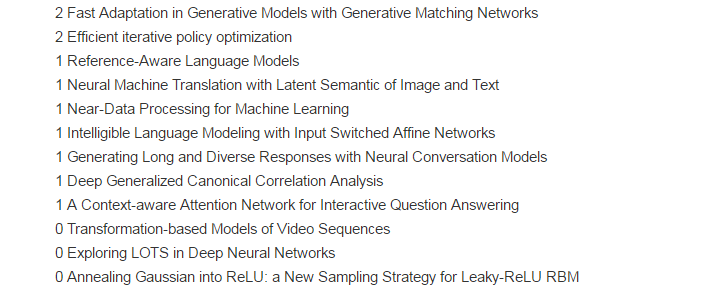

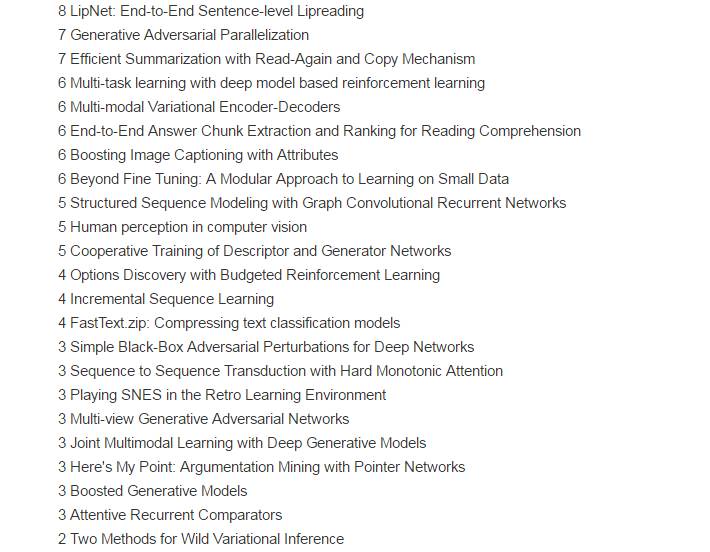

作者不打算列出总计200篇被拒绝的论文, Arxiv-sanity 用户真的非常喜欢其中一些论文,但是 ICLR 会议涉及领域的领头人和审稿人一点也不喜欢:

245篇被拒绝的论文,在 arxiv-sanity 网站上找到了以下58篇,附带网站里的 library 收藏数:

以上所列论文的前几篇,投稿遭到拒绝这一结局对它们来说可能不太公平。

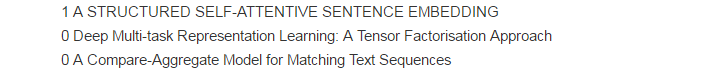

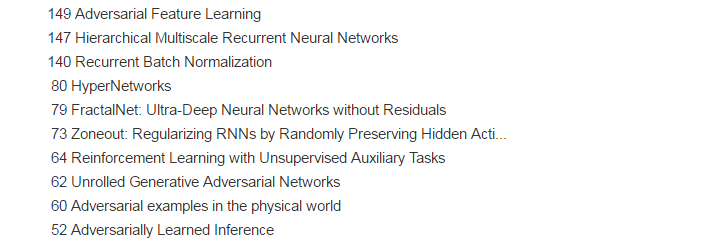

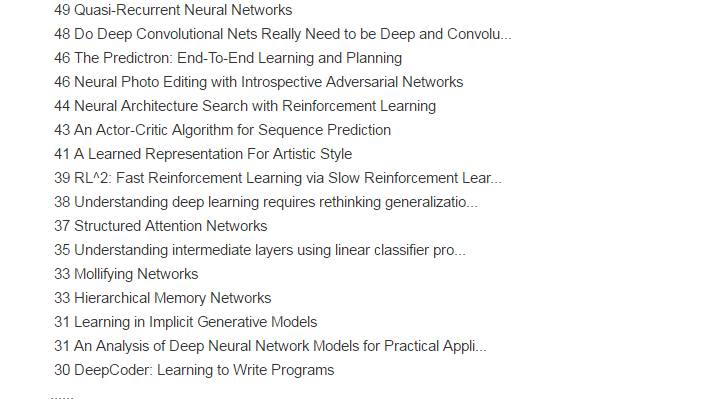

现在另一个问题是—— ICLR 2017的投稿论文如果只由 arxiv-sanity 用户投票评选(可以在 arxiv 上找到的论文),结果会是怎么样子的呢? 这是投票结果的一个摘录:

做头口报告的论文:

制成海报展览的论文:

由 arxiv-sanity 用户投票评选的完整列表可以看这里(https://cs.stanford.edu/people/karpathy/as2017.txt)。请注意,基于 arxiv-sanity 用户的投票评选结果,一些被拒绝的 ICLR 2017投稿论文,几乎优秀到可以进行口头报告,特别是以下这几篇:

"The Predictron: End-To-End Learning and Planning"

"RL^2: Fast Reinforcement Learning via Slow Reinforcement Learning"

"Understanding intermediate layers using linear classifier probes"

"Hierarchical Memory Networks"

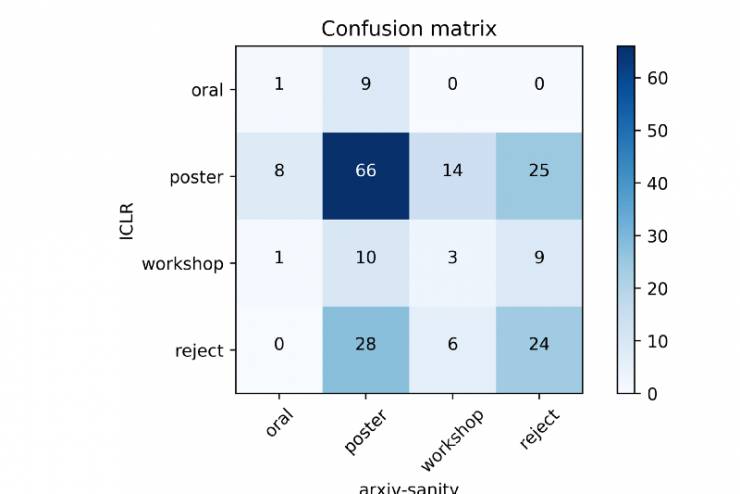

相反地, arxiv-sanity 用户对一些入选的论文并不太喜欢,以下是完整的混乱矩阵:

这是文本形式的混乱矩阵,每一栏还附带了论文的标题。这矩阵看起来不太糟糕,只是双方在评选进行口头报告的论文上面分歧很大;同意制成海报展览的论文,双方分歧相对少很多;最重要的是,进行口头报告与被拒绝的论文之间的分歧非常小,同时制成海报展览的论文与被拒绝的论文之间的分歧也非常少。此外,祝贺 Max 等 ,因为 "Reinforcement Learning with Unsupervised Auxiliary Tasks" 是唯一一篇双方都同意应该进行口头报告的优秀论文:)

最后,几天前作者在媒体上看到以下这篇由卡洛斯·佩雷斯 (Carlos E. Perez) 撰写的文章 :"Ten Deserving Deep Learning Papers that were Rejected at ICLR 2017",似乎 arxiv-sanity 用户的看法与这篇文章的意见不谋而合。包括 LipNet ,在这篇文章里列出的所有论文(同样可以在 arxiv-sanity 上找到)应该成为入选论文,和 arxiv-sanity 用户的看法出奇一致。

讨论

注意:这里存在几个使结果有所偏斜的因素。例如, arxiv-sanity 用户群的大小随着时间的推移而增大,所以这些结果可能稍微偏向于后期收录在 arxiv-sanity 的论文,因为越往后收录进网站的新论文越容易引起更多用户的关注。除此之外,论文被看到的频率并不相同。例如,如果论文被有名人士转发,看到论文的人会更多,将论文添加到他们 library 的人也会更多。最后,另一个更好地说明倾斜存在的理由是,在 arxiv-sanity ,好论文的曝光率会更多,因为收录在 arxiv-sanity 的论文不是匿名的,好论文当然会得到更多的关注,在 ICLR 同样存在这种特殊情况,所以在这一点上双方没有区别。

终上所述, Andrej Karpathy从这个实验得出的结论是:哪些投稿论文可以入选 ICLR 的征兆很多。而且结果是从互联网这个自下而上的评选过程中“免费”获得的,而不用几百人用几个月时间才能得出结果。作者想对被拖延几个星期或者几个月,长时间处于巨大压力下,忍受来回辩驳痛苦的提交方或者审查方说:也许你们不需要这么痛苦。或者至少,改进的空间很大。

报名 |【2017 AI 最佳雇主】榜单

在人工智能爆发初期的时代背景下,雷锋网联合旗下人工智能频道AI科技评论,携手《环球科学》和 BOSS 直聘,重磅推出【2017 AI 最佳雇主】榜单。

从“公司概况”、“创新能力”、“员工福利”三个维度切入,依据 20 多项评分标准,做到公平、公正、公开,全面评估和推动中国人工智能企业发展。

本次【2017 AI 最佳雇主】榜单活动主要经历三个重要时段:

2017.4.11-6.1 报名阶段

2017.6.1-7.1 评选阶段

2017.7.7 颁奖晚宴

最终榜单名单由雷锋网、AI科技评论、《环球科学》、BOSS 直聘以及 AI 学术大咖组成的评审团共同选出,并于7月份举行的 CCF-GAIR 2017大会期间公布。报名期间欢迎大家踊跃自荐或推荐心目中的最佳 AI 企业公司。

报名方式

如果您有意参加我们的评选活动,可以点击【阅读原文】,进入企业报名通道。提交相关审核材料之后,我们的工作人员会第一时间与您取得联系。

【2017 AI 最佳雇主】榜单与您一起,领跑人工智能时代。