斯坦福学生攻破两个约会软件!用GAN模型「女扮男装」骗过人脸识别系统

![]()

新智元报道

新智元报道

编辑:LRS

【新智元导读】人脸识别技术最近又有新的破解方式!一位斯坦福的学生使用GAN模型生成了几张自己的图片,轻松攻破两个约会软件,最离谱的是「女扮男装」都识别不出来。

真的有人能模仿你的脸,还绕开了人脸识别系统!

最近斯坦福大学的研究人员在arxiv上发布了一篇论文,虽说是斯坦福CS236G的课程作业,不过论文中提出了一个非常有趣的思路,用对抗生成网络GAN生成一个面部图像来模仿目标人脸,看看人脸识别系统能否正确验证。

因为人脸的关键特征信息都保留了下来,所以论文的结果显示,生成的人脸图像仍然可以通过人脸验证,对于那些仅靠平面图像识别的系统来说,简直破大防。

论文链接:https://arxiv.org/pdf/2203.15068.pdf

研究人员在两个约会app的人脸验证系统中黑盒测试了一下,轻松攻克面部验证过程,甚至在把女性人脸转换为男性之后,仍然可以通过人脸验证。

据作者称,这项工作是首次尝试利用生成的图像绕过面部验证,原始的人脸图像拥有特定的识别特征,但另一个、经过大幅改变的身份也能通过验证。

这是谁的脸?

这是谁的脸?

在线验证系统被攻破后,各种欺诈行为都会带来非常负面的后果,所以人们对检测和打击冒名顶替者尤其感兴趣。

与普通的身份验证不同的是,人脸验证涉及到根据人脸图像验证声明的身份,人脸和身份都是一对一的匹配,但一旦有另一张完全不同的人脸可以和你打开同一把锁,那你该如何证明「我是我」?

目前很多手机app都声称人脸验证技术很安全,可以保护用户的身份,比如Bumble和Tinder等约会软件的识别流程就是用户使用应用内置的相机拍摄一张照片,然后与用户个人资料中的照片进行对比。

这类使用照片进行人脸检测存在一个很大的问题:用一张能绕过人脸识别系统的假照片就可以通过验证。

想要一张人脸特征和原始人脸相同,但看起来又不同的话,对抗生成网络模型就再合适不过了。

但自GAN诞生以来,如何控制生成图像与预期一致,或者通过一个特征向量来引导GAN模型的生成过程,一直是关于GAN潜空间的主要挑战。

虽然诸如梯度加权类激活映射(Grad-CAM)等技术和工具可以帮助建立类之间的潜在方向,并实现转换,但如果进一步观察生成图像的话,就可以发现这类模型对于转换的精细程度的控制十分有限。

实验方法

实验方法

作者使用了两个数据集作为实验基础:

一个是人类用户数据集,由310张论文作者的脸部图像组成,时间跨度为四年,光线、年龄和视角各不相同,通过Caffe提取了剪裁后的脸部;

另一个是FairFace数据集中类别平衡后的108501张图像,同样进行了提取和剪裁。

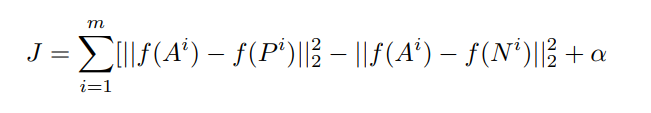

为了在本地验证实验效果,研究人员在本地建立了一个面部验证模型,主要就是在FaceNet和DeepFace的基础上使用了一个ConvNet Inception预训练模型,图像向量的训练使用三元组损失,其中A是anchor图像,P是正例,N是反例,α为间隔。

这个验证模型使用了来自FairFace的训练子集的面部图像,为了通过面部验证,输入图像与数据库中的目标用户之间计算Frobenius norm距离,任何低于0.7阈值的图像都等同于相同的身份,否则验证就被认为是失败的。

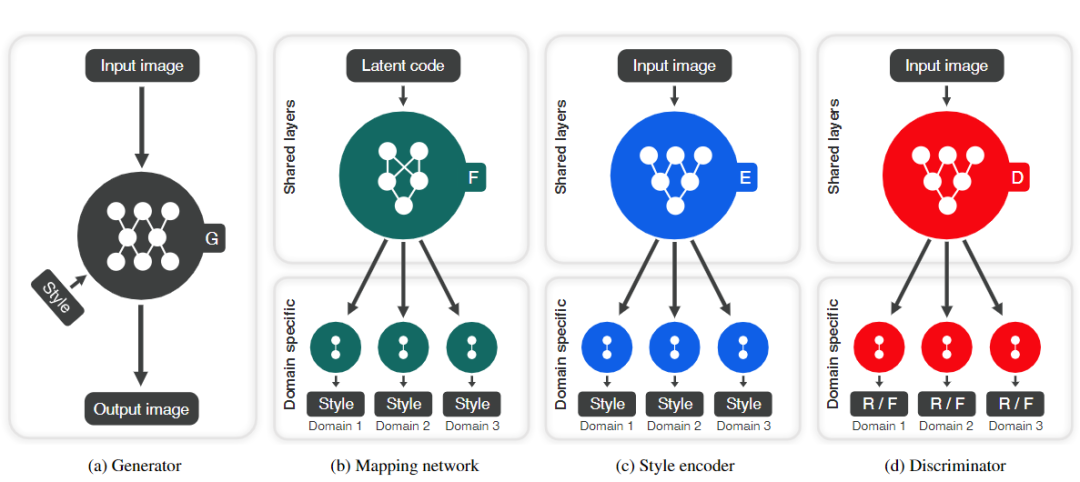

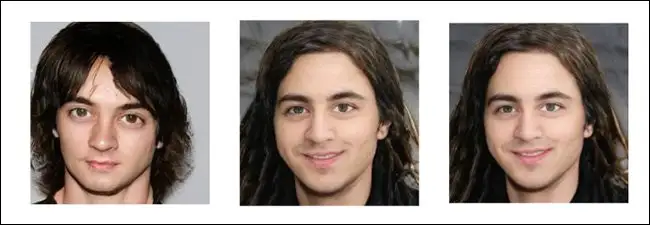

图像生成模型,作者直接使用StyleGAN模型,在个人数据集上微调了一下,随机生成的图像可以直接通过本地的人脸验证系统,并且图片看起来和训练数据集中的图片确实不一样。

微调时将前四层的权重进行冻结,以避免数据的过度拟合生成与训练数据集过于相似的人脸图像。

尽管用基本的StyleGAN模型可以获得不同于原始人脸的图像,但基线模型的结果从质量上看与训练数据集的图像比较相似(多样性较差),而且分辨率较低(保真度低)。

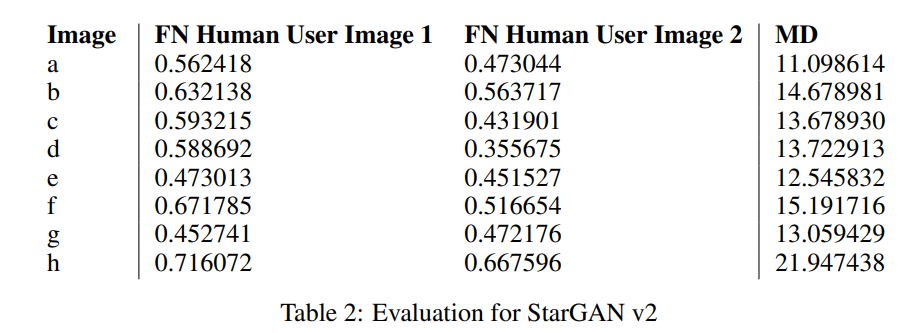

作者第二次尝试使用StarGAN v2模型,可以针对目标脸部训练种子图像。

为了防止过拟合,StarGAN v2模型使用FairFace验证集进行了大约10个小时的预训练。为了生成图像,作者还尝试使用训练数据作为种子图像(reference),以人类用户数据集的处理过的图像作为源图像(source)。

作者还尝试使用个人用户数据集的处理过的图像作为种子图和源图像,但结果提升不大。

到了验证环节,作者先是随机挑了1000个人脸图像,找出哪些在本地测试验证通过的人脸,然后再测试使用GAN生成的图像能否再匹配成功。

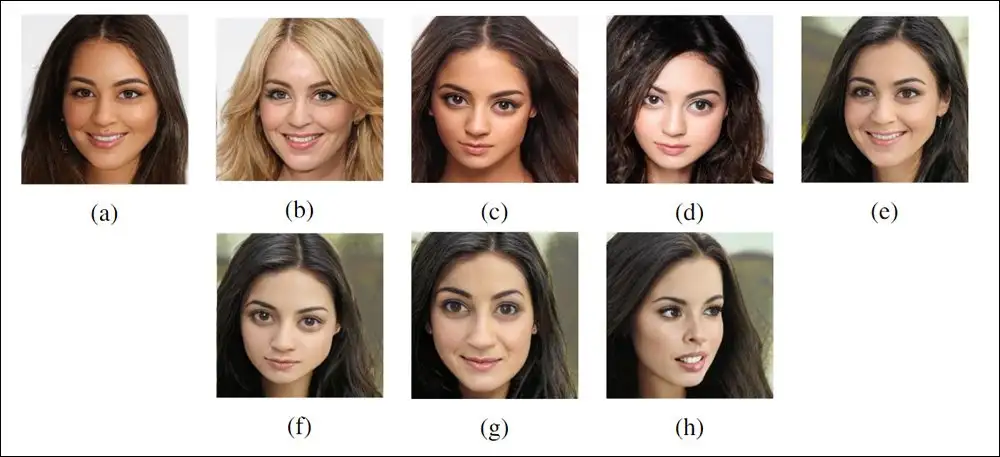

下图左为作者照片,中间为验证失败的照片,右为验证成功的照片。

实验的目的是在保留目标身份的决定性特征的同时,在感知的视觉身份之间创造尽可能大的差距,使用Mahalanobis距离作为评估指标,也是图像处理中常用于模式和模板搜索的一个指标。

对于基线生成模型,尽管通过了局部面部验证,但获得的低分辨率结果显示出多样性比较低,而StarGAN v2则能够创建更多样化的验证通过图像。

生成的图像在约会软件Bumble和Tinder的面部验证系统进行了测试,以作者的身份图像为基线,并成功通过了验证。

作者脸部的「男性」版本也通过了Bumble的验证过程,尽管在生成的图像中必须调整光线才能被接受,而Tinder则比较聪明,没有被骗。

这些都是在GAN潜空间操作的背景下进行的身份投射的开创性实验,这在图像合成和深度伪造研究中仍然是一个非凡的挑战。这项工作也开辟了在不同的身份中持续嵌入高度具体的特征的概念,以及创造「替代」身份来「阅读」别人的身份。

魔高一尺,道高一丈

魔高一尺,道高一丈

如今,在人们的日常生活中,「刷脸」非常普遍,比如商铺的客流统计、无人售货柜的刷脸支付、单位门禁、家庭门锁、公交/道路的安全监控、公司人脸识别考勤、快递包裹取件、银行开卡、网上支付、入住酒店等领域都在广泛运用「人脸识别」技术,且呈扩大趋势。

而人脸识别技术目前可以分为两大类:基于2D人脸图像和基于3D人脸图像。2D人脸识别通过2D摄像头拍摄平面成像,所以即使算法和软件再先进,在有限的信息下,安全级别终究不够高,通过照片很容易被破解。

早在2019年,就有小学生手举照片「破解」了丰巢的人脸识别系统。

安全级别较高的3D人脸识别系统通过3D摄像头立体成像,一般会有4个探头,其中两个大的是摄像头,另外两个一个是红外线探头,用于补光,一个是可见光探头,两个摄像头互相配合形成3D图像,从而复原完整的三维世界。目前3D人脸识别功能技术可以准确分辨出照片、视频、面具和双胞胎。

目前普遍应用的人脸识别身份认证系统中还有一项至关重要的技术——活体检测,即系统摄像头在正确识别人脸是否本人的同时,检验是否有人利用照片等手段冒充合法用户。这也是为什么在银行「刷脸」时候,经常要让用户完成「左看右看」、「眨眨眼」等动作。

魔高一尺,道高一丈,只有不断的对抗,技术才会持续向上发展。

参考资料:

https://www.unite.ai/creative-facial-verification-with-generative-adversarial-networks/