【导读】近日,自然语言处理顶会EMNLP 2019 在中国香港落下帷幕。大会颁发了最佳论文奖等多个奖项。来自约翰·霍普金斯大学的研究团队摘得最佳论文奖,其一作为华人学者。

![]()

本次大会吸引了国内外众多自然语言处理领域的专家学者参加,参会人数达到了 1920 多人。大会共举办了 18 场 Workshop、多个 Tutorial 和多场主题演讲,涵盖自然语言处理、社会计算学、计算机社会科学、AI 系统和深度学习等话题。

https://www.emnlp-ijcnlp2019.org/program/award/

![]()

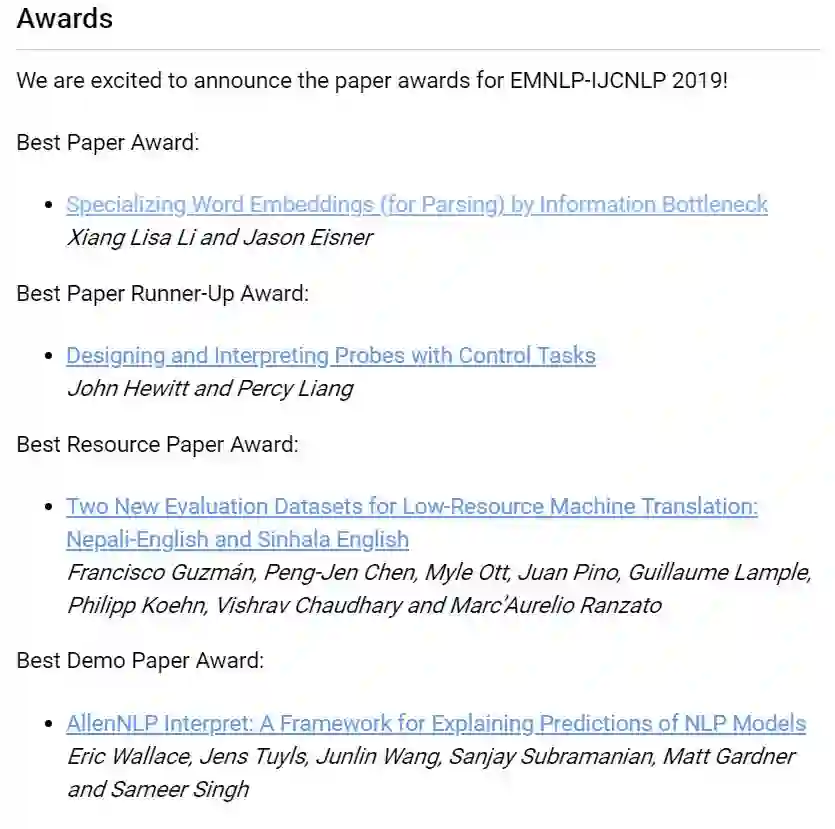

本次 EMNLP-IJCNLP 大会颁发了最佳论文奖、最佳资源奖、最佳 Demo 奖等多个奖项,以下是具体的获奖信息。

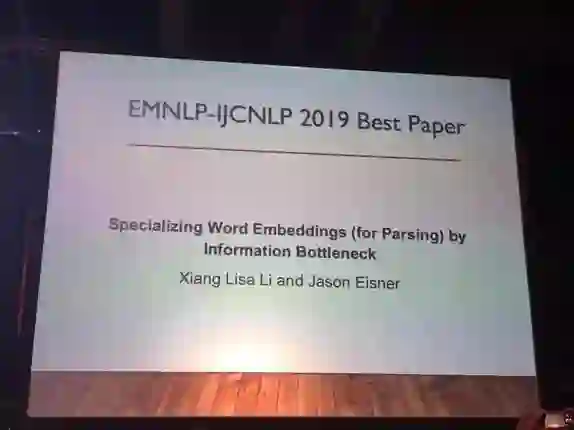

今年的最佳论文奖颁给了约翰·霍普金斯大学的研究团队,他们的论文题目是《Specializing Word Embeddings(for Parsing)by Information Bottleneck》,其一作 Xiang Lisa Li 是约翰·霍普金斯大学的大四学生,是一位华人学者,其导师是著名 NLP 学者 Jason Eisner。

论文链接:

https://www.aclweb.org/anthology/D19-1276.pdf

摘要:

预训练词向量,如 ELMo 和 BERT 包括了丰富的句法和语义信息,使这些模型能够在各种任务上达到 SOTA 表现。

在本文中,研究者则提出了一个非常快速的变分信息瓶颈方法,能够用非线性的方式压缩这些嵌入,仅保留能够帮助句法解析器的信息。

研究者将每个词嵌入压缩成一个离散标签,或者一个连续向量。

在离散的模式下,压缩的离散标签可以组成一种替代标签集。

通过实验可以说明,这种标签集能够捕捉大部分传统 POS 标签标注的信息,而且这种标签序列在语法解析的过程中更为精确(在标签质量相似的情况下)。

而在连续模式中,研究者通过实验说明,适当地压缩词嵌入可以在 8 种语言中产生更精确的语法解析器。

这比简单的降维方法要好。

EMNLP-IJCNLP 2019 最佳论文第二名

今年最佳论文奖的第二名颁给了斯坦福大学的研究团队,他们的论文题目是《Designing and Interpreting Probes with Control Tasks》。

作者为 John Hewitt、Percy Liang。

https://www.aclweb.org/anthology/D19-1275.pdf

摘要:

训练有素的监督模型可以根据表达形式(如 ELMo)预测属性(如词性),探测器在一系列语言任务上均具有很高的准确性。

但这是否意味着这些表达形式对语言结构进行了编码,或者只是探测器已经学习了语言任务?

在本文中,研究者提出了控制任务,将词的类型与随机输出联系起来,以辅助语言任务。

按照设定,这些任务只能由探测器来学习。

因此选择一个合适的探测器(能反映该表达形式的探测器)很重要,以实现较高的语言任务准确性和较低的控制任务准确性。

探测器的选择性将语言任务的准确性与自身记忆词类型的能力相关联。

研究者提出了用于英语词汇标注和依赖边缘预测的控制任务,并且展示了基于表达形式上的探测器是不可选择的。

同时他们还发现,通常用于控制探测器复杂性的滤除对提高 MLP 的选择性是无效的,但是其他形式的正则化是有效的。

最后,他们发现,尽管 ELMo 的第一层探测器比第二层探测器的词性标注精度高一些,但是第二层上的探测器更具选择性。

引出了以下问题:

究竟哪一层可以更好地代表词性。

今年的最佳资源奖颁给了 Facebook、美国索邦大学和约翰·霍普金斯大学的研究团队,他们的论文题目是《The FLORES Evaluation Datasets for Low-Resource Machine Translation: Nepali–English and Sinhala–English》。

作者为 Francisco Guzmán、Peng-Jen Chen、Myle Ott、Juan Pino、Guillaume Lample 等

https://www.aclweb.org/anthology/D19-1632.pdf

https://github.com/facebookresearch/flores

摘要:

在机器翻译领域,很多语言对的可用对齐语料都非常稀少。

除了在技术上要面临有限制的监督学习挑战外,评估这些在低资源语言对上训练的方法也存在困难,因为可用的基准非常少。

在本文中,研究者介绍了一个用于尼泊尔语-英语、僧伽罗语-英语的 FLORES 评估数据集,该数据集基于维基百科上翻译过的句子。

与英语相比,这些语言在形态学和句法学上都存在很大差异。

对于这些语言,很少有领域外的平行语料可用,但它们的免费可用单语数据非常丰富。

研究者描述了收集和交叉验证翻译质量的过程,并使用几种学习方法报告基线性能,包括完全监督、弱监督、半监督和完全无监督。

实验表明,当前最佳的方法在这些基线上表现都非常差,这给研究低资源语言机器翻译的社区带来了很大挑战。

EMNLP-IJCNLP 2019 最佳 Demo 奖

今年的最佳 Demo 奖颁给了加州大学伯克利分校、艾伦人工智能研究所、加利福尼亚大学尔湾分校的研究团队,他们的论文题目是《AllenNLP Interpret: A Framework for Explaining Predictions of NLP Models》。

作者为 Eric Wallace、Jens Tuyls、Junlin Wang、Sanjay Subramanian、Matt Gardner、Sameer Singh 等人

https://www.aclweb.org/anthology/D19-3002.pdf

https://allennlp.org/interpret

摘要:

神经 NLP 模型正变得越来越精确,但它们远非完美,而且是不透明的。

这些模型以违反直觉的方式崩溃,使得用户摸不着头脑。

模型解释方法通过为特定的模型预测提供解释来减轻它们的不透明性。

然而,现有的解释代码库使得这些方法在新模型和新任务中难以应用,这阻碍了从业者采用这些方法,同时也给可解释性研究带来负担。

为此,来自艾伦人工智能研究所等机构的研究者开发了一个灵活的 NLP 模型解释框架——AllenNLP Interpret。

它可以为所有的 AlenNLP 模型和任务提供解释原语(如输入梯度)、一系列内置解释方法一级一个前端可视化组件库。

参考链接:

1. https://mp.weixin.qq.com/s/IKREAyWcTH-jp8plTcAR5A

2. https://mp.weixin.qq.com/s/WVhDCfYJcG58tkycCLSgvw

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎注册登录专知www.zhuanzhi.ai,或者点击“阅读原文”使用,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),

获取专知VIP会员码

,加入专知人工智能主题群,咨询技术商务合作~