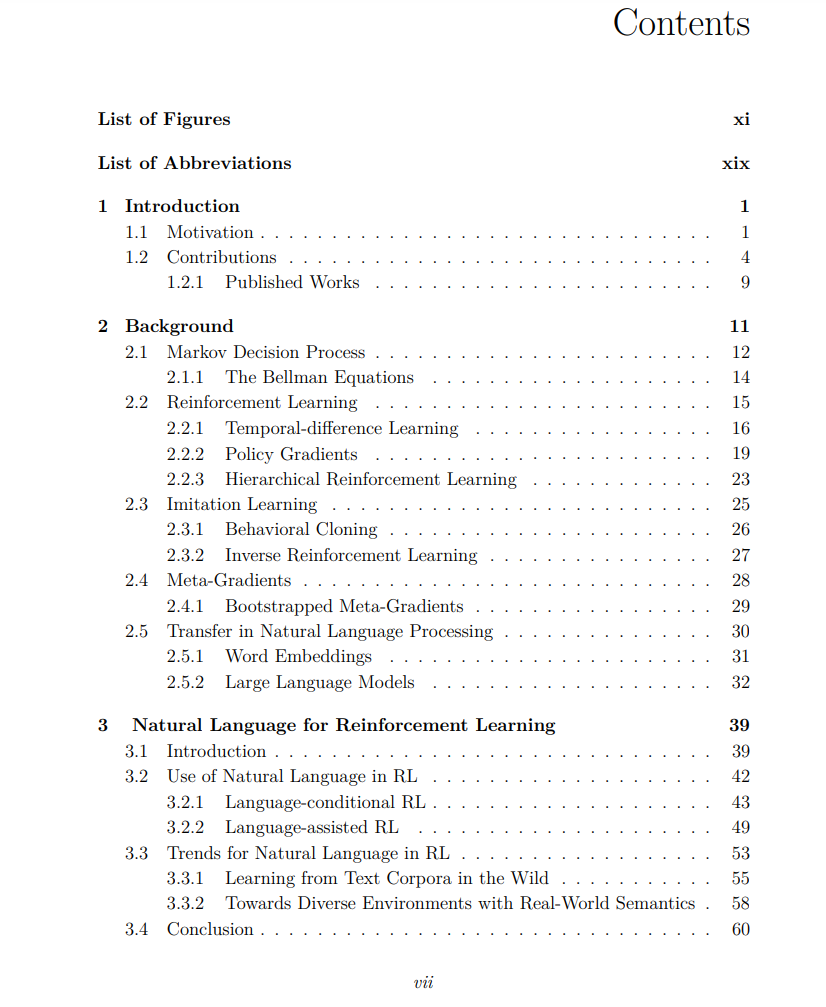

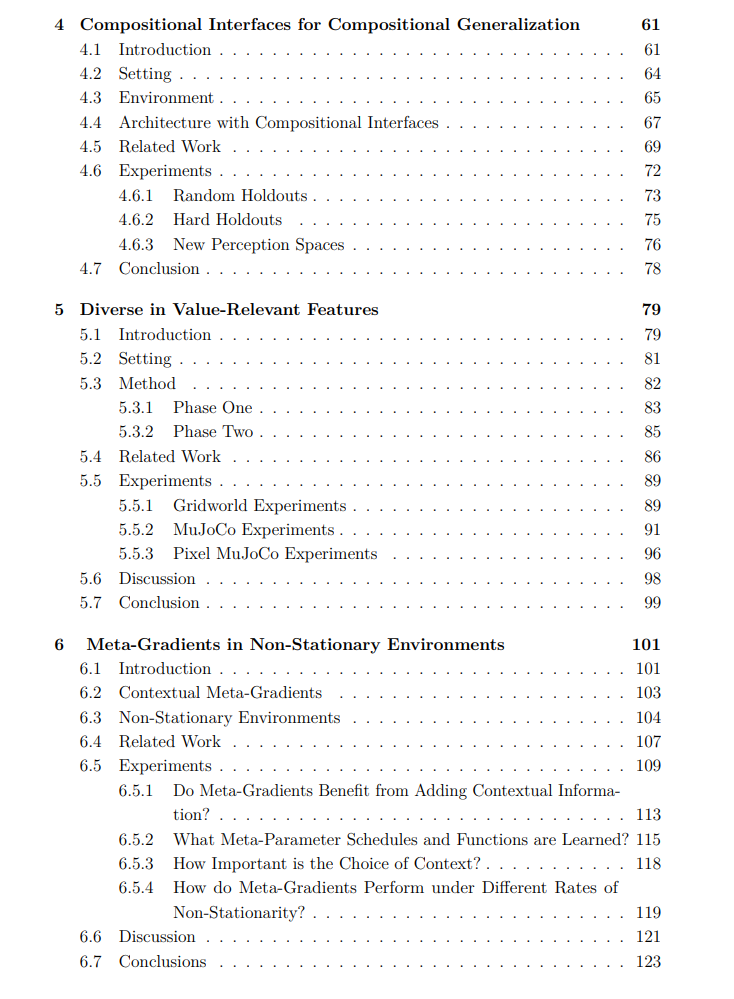

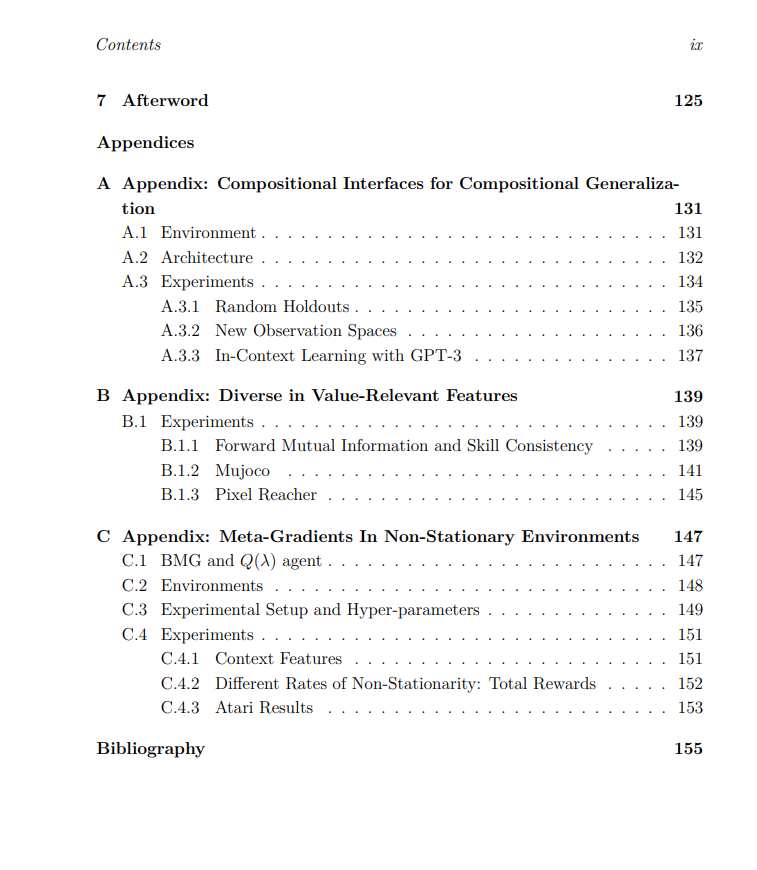

迁移学习对于提高深度学习模型在序列决策任务中的数据效率和适用性至关重要。然而,确定哪些知识可以迁移以及如何有效利用它仍然是一个尚未解决的难题。近年来在表示学习方面的突破,尤其是在语言和视觉领域,展示了从大规模数据集迁移知识的强大能力。同时,仿真平台和环境设计的进步也为收集多样化、逼真的训练数据开辟了新的可能性。在此背景下,本论文包含的四项研究工作探讨了序列决策任务中不同方面的迁移技术。 首先,我们对先前在序列决策中整合自然语言数据和表示的研究进行了全面综述。我们的综述揭示了尚未解决的挑战,并规划了有前景的研究方向,主张更广泛地利用大型语言模型,并开发语义复杂性更高的环境。其次,我们提出并研究了一种用于多模态多任务设置的模块化架构设计,以实现组合泛化。受控实验表明,该设计在观察、动作和指令空间的未见组合上实现了零样本迁移,并有效整合了新的观测模态。第三,我们提出了一种方法,通过迁移源任务中与价值相关的状态特征知识,来引导无监督技能发现,以生成更有用的行为。在连续控制领域的实验表明,我们的方法在状态空间的相关维度上实现了更优的覆盖,并提升了下游任务的表现。最后,我们对非平稳环境中元梯度的分析表明,将优化器作为上下文特征的函数进行学习,可以实现更快的适应速度和更高的整体表现。 总的来说,本论文为在序列决策任务中实现有效知识迁移提供了新颖的见解和策略。研究工作展示了整合语言、针对性归纳偏差、适度监督以及元学习自适应带来的优势。

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

224+阅读 · 2023年4月7日