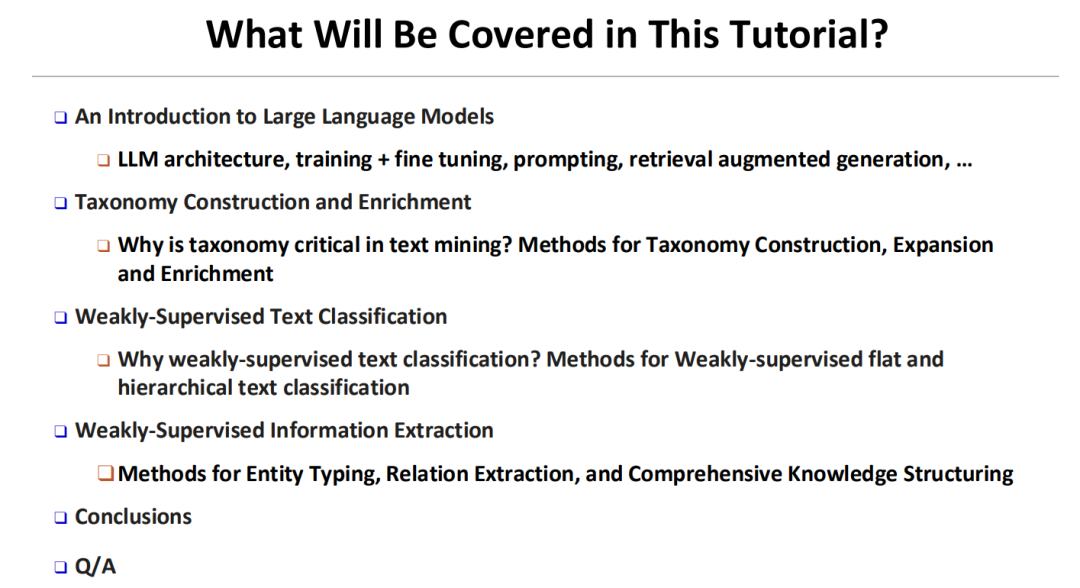

- 大语言模型的介绍,它是近期文本挖掘任务的基础;

- 本体构建,自动从海量语料库中丰富本体;

- 在平面和层次化标签空间中的弱监督文本分类;

- 弱监督信息抽取,提取实体和关系结构。https://yzhan238.github.io/kdd24-tutorial/ 幻灯片

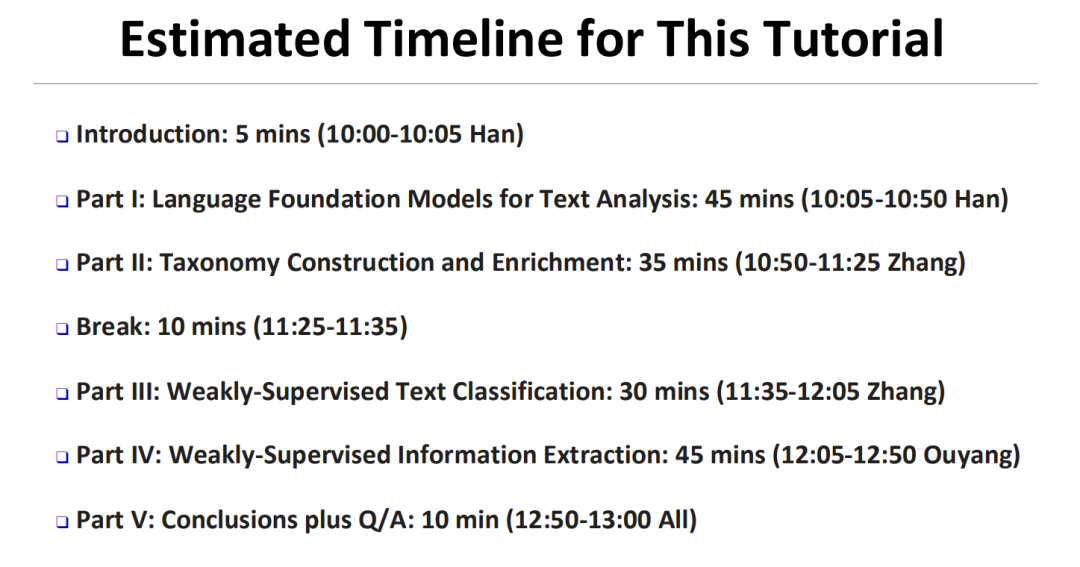

- 介绍

- 第一部分:文本分析中的语言基础模型

- 第二部分:分类体系的构建与丰富

- 第三部分:弱监督文本分类

- 第四部分:弱监督信息抽取

- 结论

成为VIP会员查看完整内容

相关内容

Arxiv

223+阅读 · 2023年4月7日

Arxiv

152+阅读 · 2023年3月29日

Arxiv

85+阅读 · 2023年3月21日