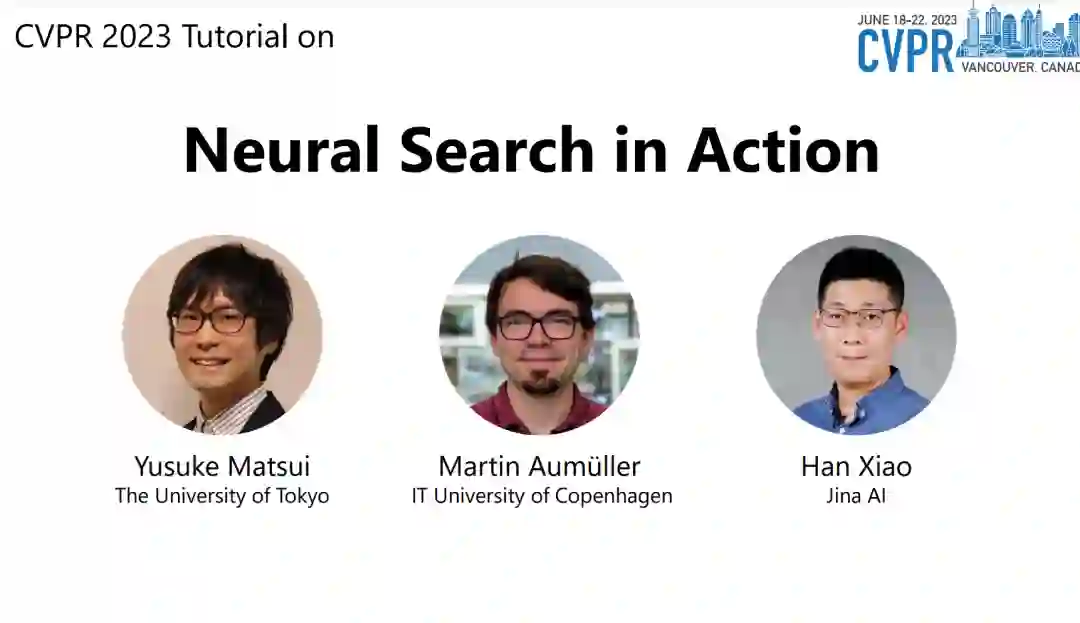

来自东京大学、哥本哈根信息技术大学、Jina AI给出了《神经搜索实战》教程,值得关注!

神经搜索,一种在深度嵌入空间中高效搜索相似项的技术,是处理大型多模态集合的最基本技术。随着基础模型和提示工程等强大技术的出现,高效的神经搜索变得越来越重要。例如,像CLIP这样的多模态编码器允许我们将各种问题转化为简单的嵌入和搜索。另一个例子是将信息输入到LLM中的方式;目前,向量搜索引擎是一个有前途的方向。尽管有上述关注,但如何为给定数据设计搜索算法并不明显。在这个教程中,我们将关注“百万规模搜索”、“十亿规模搜索”和“查询语言”,以展示如何解决现实世界的搜索问题:

首先,我们概述基于图的最近邻搜索方法的理论和应用。基于图的方法是当前内存(百万规模)搜索的事实标准,但由于其具有许多启发式方法的复杂结构,它们难以理解。我们将解释其基本的数学概念,总结最近的改进,并为选择算法提供实用的指南。 本教程的第二部分将涵盖十亿规模近似最近邻搜索的当前方法和基准测试工作。它将扩展第一部分教程的讨论到这个规模,并概述一般的搜索流程和不同方法(基于图的/基于集群的/量化)的适用性。最后,它总结了有趣的研究方向。 最后,我们将对神经搜索的查询语言进行概述,包括其语法、语义和应用。查询语言是神经搜索的一个关键方面,它允许用户以系统可以理解和执行的结构化和组成的方式表达他们的信息需求和约束。我们将讨论如何将查询语言与向量相似度搜索和BM25结合以提高信息检索性能。我们还将覆盖该领域的常见挑战和最近的发展,并为设计和实现神经搜索系统的查询语言提供指导。这个教程旨在面向对在他们的工作中使用神经搜索的查询语言感兴趣的研究者和实践者。

成为VIP会员查看完整内容

相关内容

CVPR 2023大会将于 6 月 18 日至 22 日在温哥华会议中心举行。CVPR是IEEE Conference on Computer Vision and Pattern Recognition的缩写,即IEEE国际计算机视觉与模式识别会议。该会议是由IEEE举办的计算机视觉和模式识别领域的顶级会议,会议的主要内容是计算机视觉与模式识别技术。

CVPR 2023 共收到 9155 份提交,比去年增加了 12%,创下新纪录,今年接收了 2360 篇论文,接收率为 25.78%。作为对比,去年有 8100 多篇有效投稿,大会接收了 2067 篇,接收率为 25%。

Arxiv

225+阅读 · 2023年4月7日

Arxiv

85+阅读 · 2023年3月21日