https://www.zhuanzhi.ai/paper/f89bf5e9ab6b630c51edddff406566f4

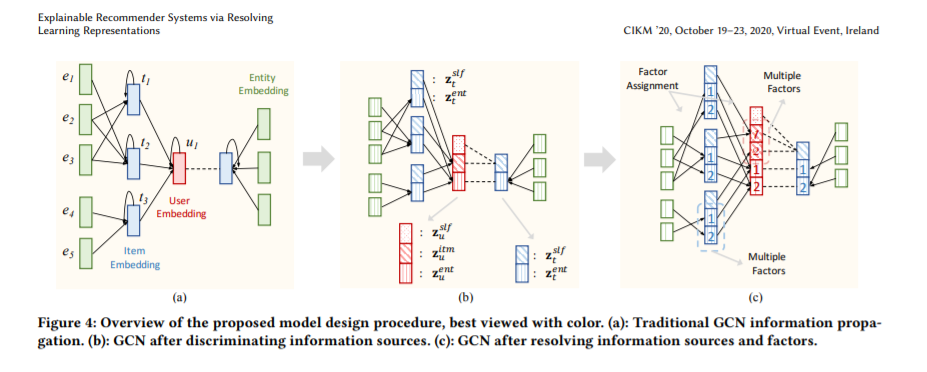

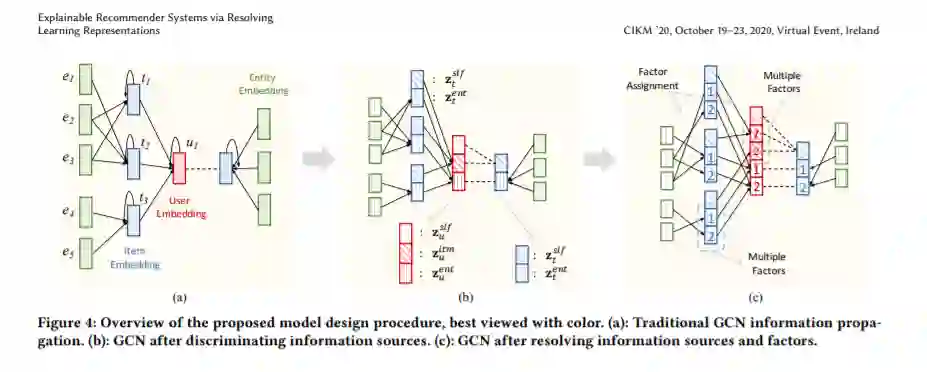

推荐系统在web应用中扮演着过滤大量信息和匹配用户兴趣的基础角色。虽然许多人致力于开发各种场景下更有效的模型,但对于推荐系统可解释性的探索却处于滞后状态。解释可以帮助改善用户体验和发现系统缺陷。本文在正式引入与模型可解释性相关的要素后,通过提高表示学习过程的透明度,提出了一种新的可解释推荐模型。具体地说,为了克服传统模型中的表示纠缠问题,我们修改了传统的图卷积来区分不同层次的信息。此外,每个表示向量被分解为若干段,其中每个段与数据中的一个语义方面相关。与之前的工作不同,在我们的模型中,因子发现和表示学习同时进行,我们能够处理额外的属性信息和知识。通过这种方式,该模型可以学习对用户和项的可解释和有意义的表示。与传统方法需要在可解释性和有效性之间进行权衡不同,我们所提出的可解释模型在考虑了可解释性后,其性能没有受到负面影响。最后,通过综合实验验证了模型的性能和解释的可信度。

成为VIP会员查看完整内容

相关内容

表示学习是通过利用训练数据来学习得到向量表示,这可以克服人工方法的局限性。 表示学习通常可分为两大类,无监督和有监督表示学习。大多数无监督表示学习方法利用自动编码器(如去噪自动编码器和稀疏自动编码器等)中的隐变量作为表示。 目前出现的变分自动编码器能够更好的容忍噪声和异常值。 然而,推断给定数据的潜在结构几乎是不可能的。 目前有一些近似推断的策略。 此外,一些无监督表示学习方法旨在近似某种特定的相似性度量。提出了一种无监督的相似性保持表示学习框架,该框架使用矩阵分解来保持成对的DTW相似性。 通过学习保持DTW的shaplets,即在转换后的空间中的欧式距离近似原始数据的真实DTW距离。有监督表示学习方法可以利用数据的标签信息,更好地捕获数据的语义结构。 孪生网络和三元组网络是目前两种比较流行的模型,它们的目标是最大化类别之间的距离并最小化了类别内部的距离。

Arxiv

5+阅读 · 2018年7月5日