斯坦福大学 CS224N 深度学习自然语言处理 2022 冬季课程即将开课!

自然语言处理(NLP)或者计算语言学是信息时代最重要的技术之一。从网络搜索、广告、电子邮件到客户服务、语言翻译、虚拟代理、医疗报告等,NLP 的应用几乎无处不在。近年来,深度学习(或神经网络)在许多 NLP 任务上达到了非常高的性能,使用单个端到端神经模型就能完成许多任务,不再需要特定于任务的特征工程。

而提及入门自然语言处理,想必大家都非常熟悉斯坦福大学的公开课 CS224N,它与计算机视觉方面的课程 CS231n 堪称绝配。CS224N 是一门关于自然语言处理的专项课程,非常系统地介绍自然语言处理任务等相关知识。

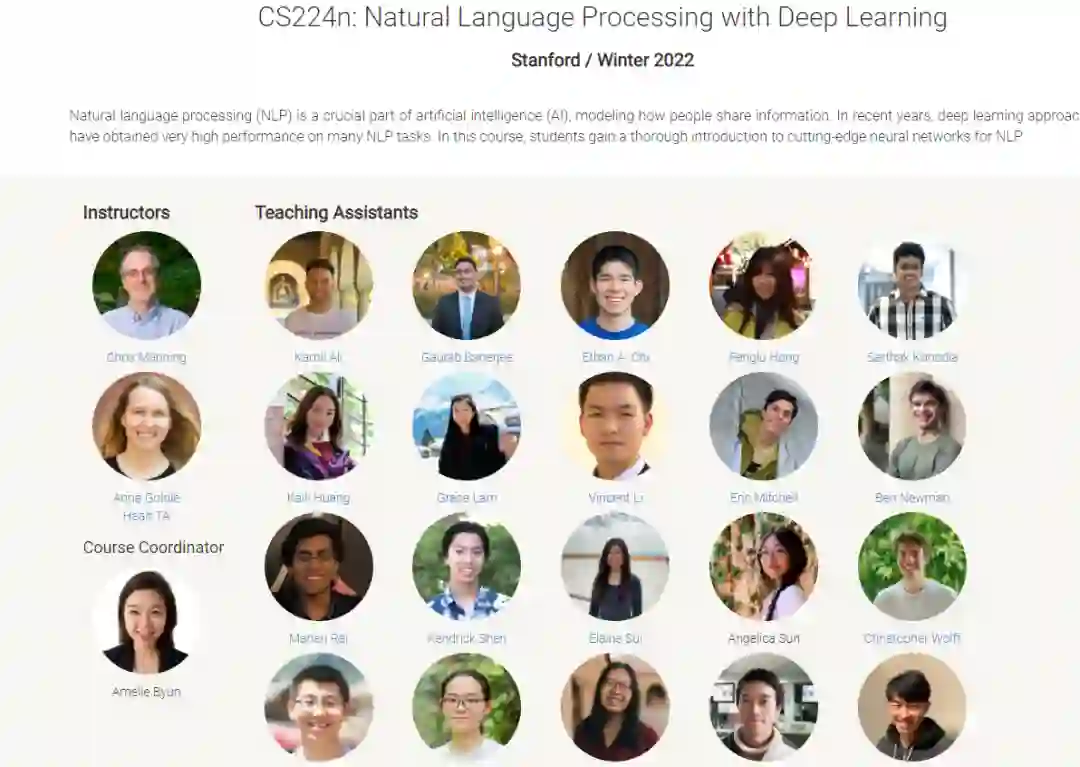

斯坦福 NLP Group 的 CS224N 深度学习自然语言处理 2022 冬季课程将于当地时间 1 月 4 日开课,授课讲师为斯坦福大学教授 Christopher Manning 以及他的三年级博士生 Anna Goldie。

课程链接:http://web.stanford.edu/class/cs224n/

该课程全面介绍了 NLP 深度学习的前沿研究。通过讲座、作业和结课项目,学生将学到设计、实现和理解各自的神经网络模型等必要技能。本年度的 CS224n 课程依然使用 PyTorch 授课。

预备知识

熟练使用 Python:所有课程都需要用到 Python(具体来说,使用 NumPy 和 PyTorch)。如果需要重温一下 Python 的内容或者熟悉 NumPy,学生可以学习第一周的 Python 复习部分。

大学微积分和线性代数:该课程的学生应该掌握(多变量)导数、矩阵 / 向量符号和运算的知识。

概率论与统计的基本知识:该课程的学生应该了解概率、高斯分布、均值、标准差等知识。

机器学习的基础知识:模型构建过程涉及设计代价函数(cost function)、求导数并通过梯度下降进行优化。如果你已经掌握了机器学习或深度学习的基础知识,这门课程的学习将变得容易很多。

课程安排

2022 年 CS224N 冬季课程将于 1 月 4 日正式开课,并于 3 月 14 日结束。课程 PPT 将于每节课之前提供,课堂笔记则通常在课程结束后几天上传。

在 1 月份的课程安排中,学生将学习到词向量、Gensim 词向量示例、 词窗口分类、Python 知识回顾、反向传播和神经网络、依存句法分析、PyTorch 知识回顾、梯度消失、Fancy 循环神经网络和 Seq2Seq 等。

1 月部分授课内容。

在 2 月份的课程安排中,学生将学习到Transformer 和预训练、问答系统、自然语言生成 和大型语言模型、卷积神经网络(ConvNet)、基于树形结构的 RNN、深度学习中选区解析和语言结构扮演的角色、语言模型中的知识集成等。

在 3 月份的课程安排中,学生将学习到 NLP 和深度学习的未来发展等。

讲师介绍

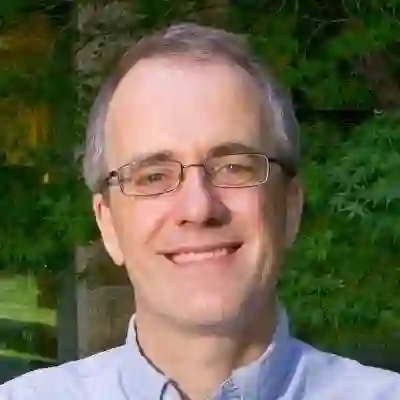

Christopher Manning 于 1989 年在澳大利亚国立大学取得三个学士学位(数学、计算机和语言学),并于 1994 年获得斯坦福大学语言学博士学位。他曾先后在卡内基梅隆大学、悉尼大学等任教,1999 年回到母校斯坦福,就职于计算机科学和语言学系,是斯坦福自然语言处理组(Stanford NLP Group)的创始成员及负责人。

Manning 的研究目标是以智能的方式实现人类语言的处理、理解及生成,研究领域包括树形 RNN 、情感分析、基于神经网络的依存句法分析、神经机器翻译和深度语言理解等,是 NLP 领域的深度学习开拓者。他是国际计算机学会 (ACM)、国际人工智协会(AAAI)和国际计算语言学会(ACL)等国际权威学术组织的 Fellow,曾获 ACL、EMNLP、COLING、CHI 等国际顶会最佳论文奖,并著有《统计自然语言处理基础》、《信息检索导论》等自然语言处理著名教材。

图片