AI玩起音乐来“天赋”惊人,新版加州旅馆听过没?还是熟悉的老鹰乐队嗓音

赖可 发自 凹非寺

量子位 报道 | 公众号 QbitAI

AI把一首歌重新唱一遍,会是什么感觉?还是那个歌手,还是那个歌词,却是全新的旋律,全新的风格。

先试听一下吧。

Eagles乐队的Hotel California,第一段还是原调,唱着唱着就突然变了:

第一遍听没有听歌词,真的以为变成了另一首歌,最后还加了一段纯乐器:

On a dark desert highway,cool wind in my hair

Warm smell of colitas, rising up through the air

Up ahead in the distance, I saw a shimmering light

My head grew heavy and my sight grew dim(开始变调)

I had to stop for the night

There she stood in the doorway

I heard the mission bell

And I was thinkin’ to myself

‘This could be heaven or this could be hell

(music……)

虽然不熟悉,还真的蛮好听,这个AI乐感不错呀!(反正超过我了)

最新的合成器:Jukebox

AI科学家一直在尝试,用神经网络合成语音和音乐。

上面的歌曲你也听过了,它是Open AI 最新研究出的神经网络:Jukebox。

它将乐器和人声的混合的复杂音频,进行再处理,尽可能追求顺畅效果。

我们之所以选择音乐工作,是因为我们希望继续突破生成模型的界限。

它是怎么实现的呢?

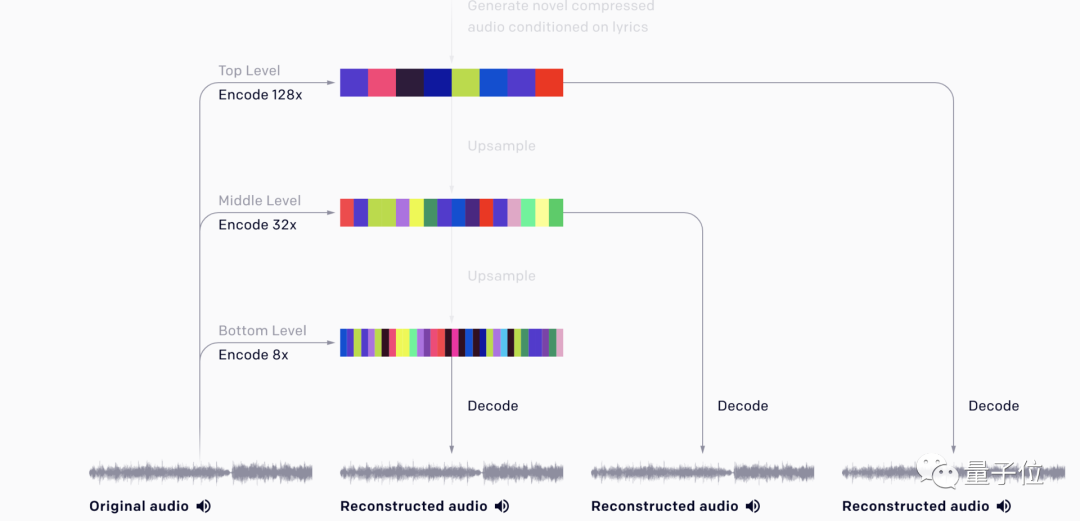

Jukebox使用了一种称为VQ-VAE的量化方法,将音频压缩到离散空间。

分层VQ-VAE可以从几个演奏的样本中生成简短的乐器片段。

分层处理

所谓的分层方法,就是分为三层将44kHz原始音频压缩为8x,32x和128x。

主要有两个步骤。

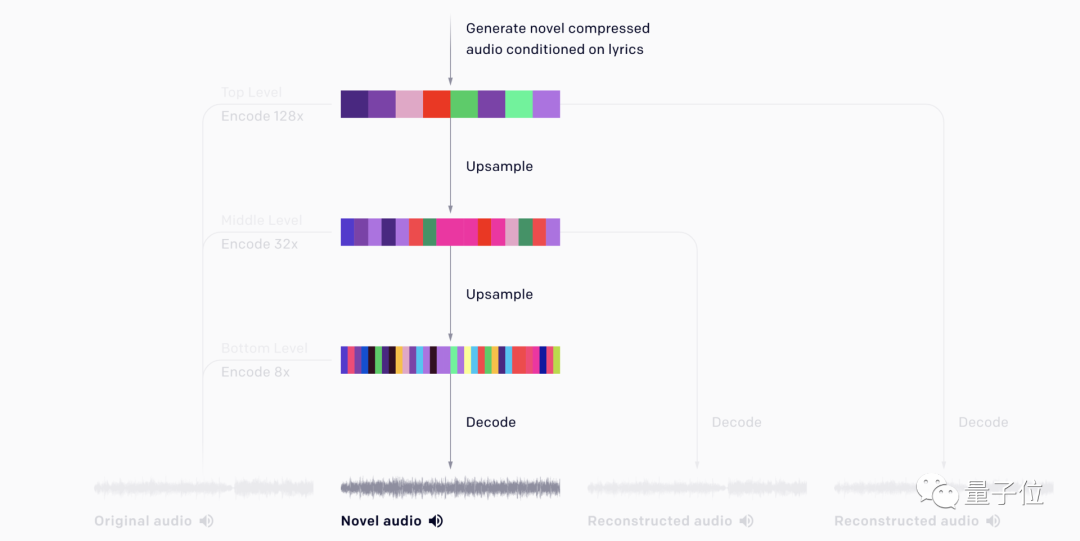

压缩:每层都独立地进行编码。底层编码进行重构,而顶层编码只保留了基本的音乐信息。

生产:也是分层进行,一系列的transformers会从上到下生成代码,最后,下层的解码器将它们转换为原始音频。

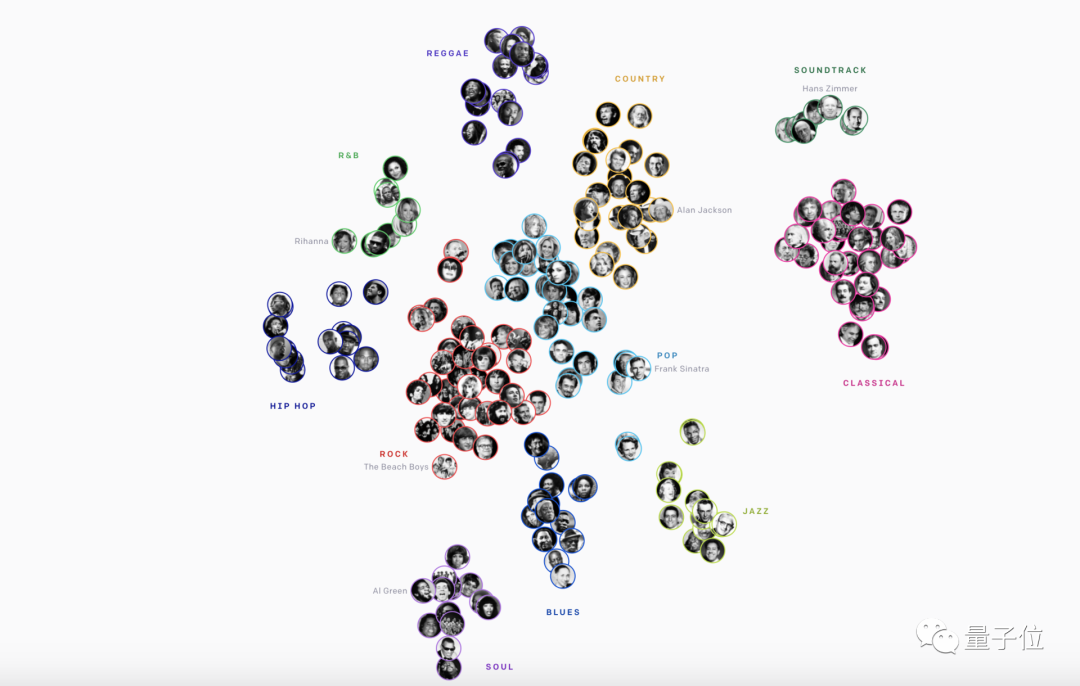

当然,能生成目前效果的歌曲,也是因为数据库足够丰富,看一眼就知道了:

传送门

目前这个神经网络也有局限,产生不了常见大型音乐结构,例如和声和重复。科学家还在进一步努力中。

如果你想听更多其他AI制作的音乐样本,可以去官网试试:

https://openai.com/blog/jukebox/#rf7

一个小彩蛋:发现了一首深度学习之歌

Deep learning ,deep learning

The deeper you learn, the smarter your A. I.

Deep learning, big data

Big model, accuracy

We must, we must,

we must go deeper

…………

作者系网易新闻·网易号“各有态度”签约作者

— 完 —

如何关注、学习、用好人工智能?

每个工作日,量子位AI内参精选全球科技和研究最新动态,汇总新技术、新产品和新应用,梳理当日最热行业趋势和政策,搜索有价值的论文、教程、研究等。

同时,AI内参群为大家提供了交流和分享的平台,更好地满足大家获取AI资讯、学习AI技术的需求。扫码即可订阅:

了解AI发展现状,抓住行业发展机遇

AI社群 | 与优秀的人交流

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态

喜欢就点「在看」吧 !