史上最全场景文字检测资源合集(70篇重要论文 + 15个开源代码 + 176个实验结果 + 1305个统计信息)

点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达

本文授权转载自:CSIG文档图像分析与识别专委会

一、前言

本文总共整理了21个场景文本检测数据集,根据数据集的形式和应用场景可以按如下标准划分:

详细对比内容如表1所示,其中包括语种、图片以及文本数量(训练/测试)、标注类型等,更多内容详见资源链接。

表1 场景文本检测数据集对比

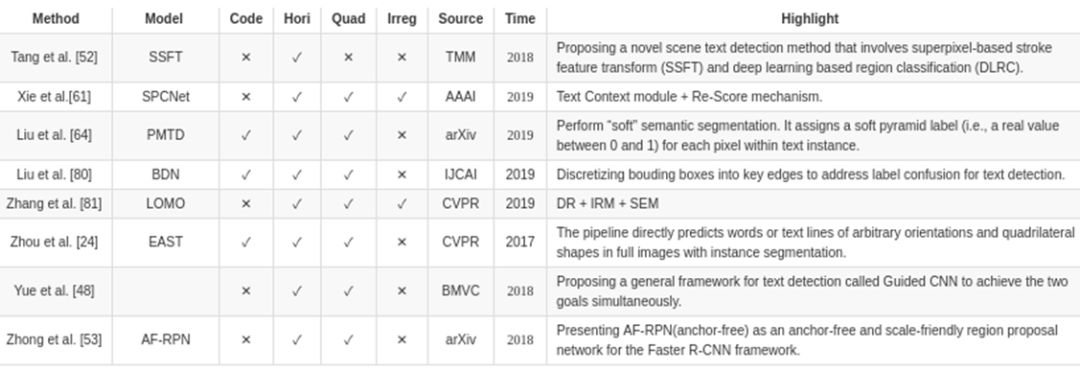

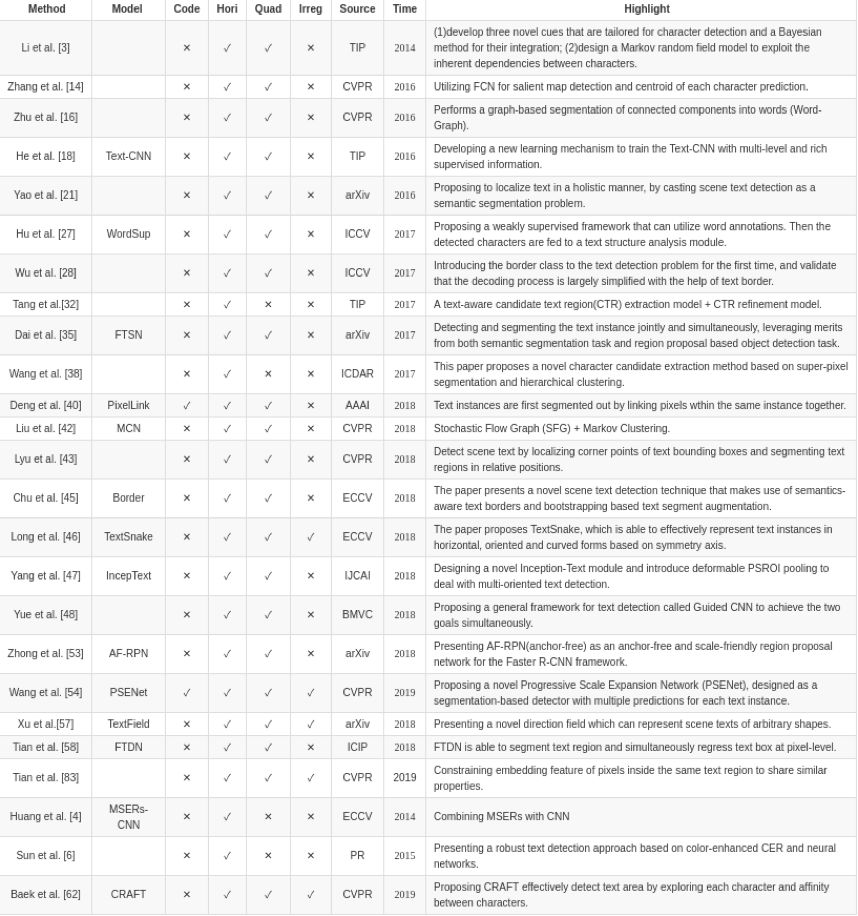

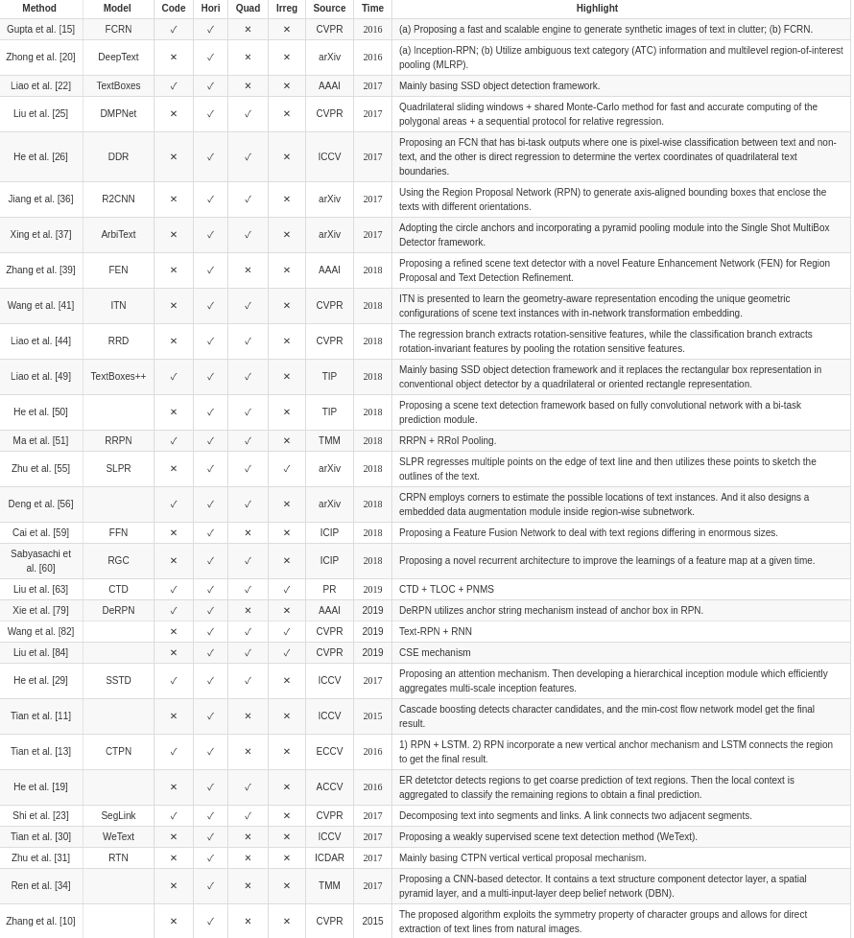

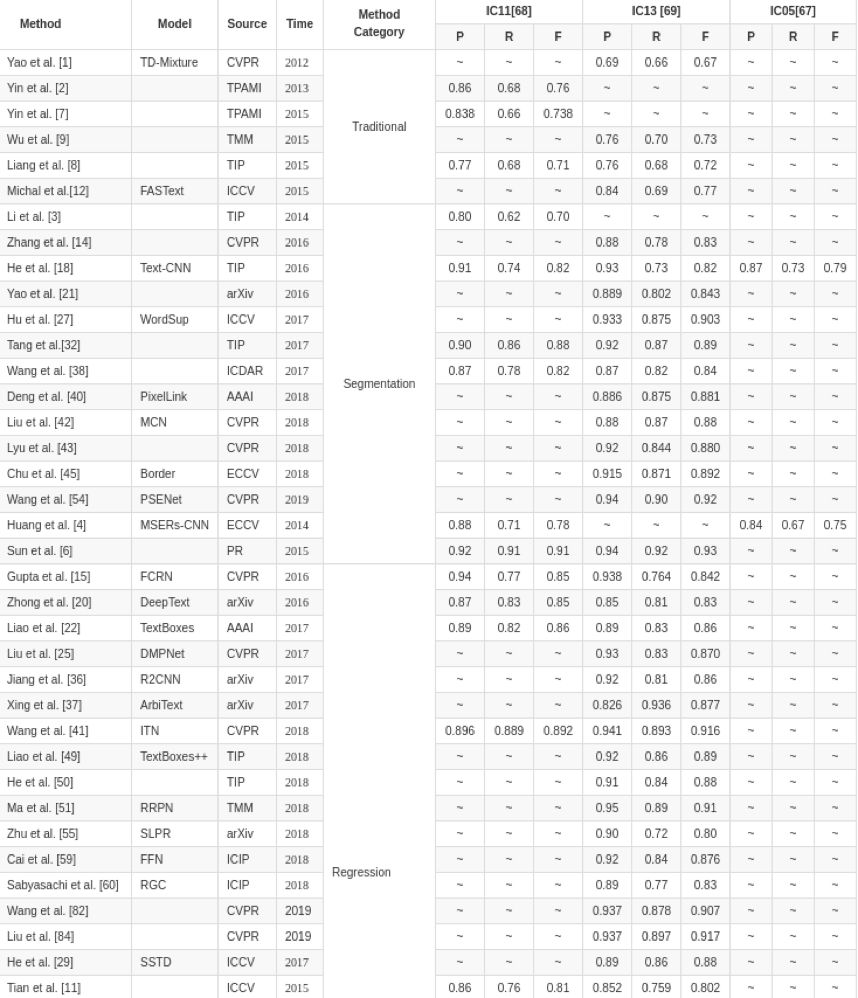

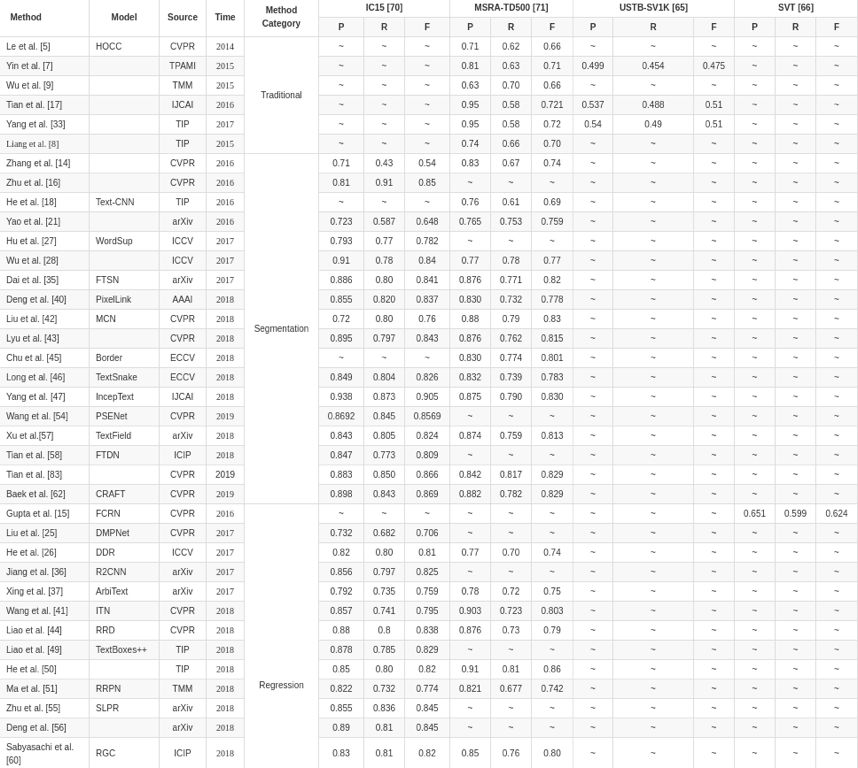

本小节整理并对比了场景文本检测中70篇重要论文(发表于TPAMI、TIP等期刊以及CVPR,ICCV等CCF A类会议),对比内容包括代码是否开源、方法分类、适用场景、出处、时间以及创新点等。

本文将场景文本检测方法分为四类:

(a) Traditional methods;

(b) Segmentation-based methods;

(c) Regression-based methods;

(d) Hybrid methods.

详细对比见表2-5以及资源链接。注:表格中Hori,Quad和Irreg分别代表水平文本,任意四边形文本以及不规则文本。

表2 传统场景文本检测方法对比

2. Segmentation-based methods

表3 基于分割的场景文本检测方法对比

表4 基于回归的场景文本检测方法对比

4. Hybrid methods

表5 场景文本检测的集成方法对比

2. Detection Results on Arbitrary Quadrilateral Text Datasets

本文总结了2012年以来在场景文本检测领域的70篇重要论文、21个常用数据集、15份论文开源代码、176个实验结果以及超过1300条统计信息。此外,我们还总结了近年来场景文本检测评估标准的相关论文和部分企业提供的OCR服务。详细内容见下面的Github链接。

Scene Text Detection:

https://github.com/HCIILAB/Scene-Text-Detection

作者及资源整理者介绍:刘崇宇,华南理工大学电子与信息学院在读硕士生。

免责声明:本文仅代表作者观点,不代表本公众号立场。

重磅!CVer-场景文本检测交流群成立啦

扫码添加CVer助手,可申请加入CVer-场景文本检测学术交流群,同时还可以加入目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测和模型剪枝&压缩等群。一定要备注:研究方向+地点+学校/公司+昵称(如场景文本检测+上海+上交+卡卡)

▲长按加群

▲长按关注我们

麻烦给我一个在看!