使用人工智能增强人类智能(下)

编者按:本周一,Google Brain的Shan Carter和YC Research的Michael Nielsen发表了一篇讨论AI(人工智能)和IA(智能增强)关系的长文。当前有一种传统观点认为AI将全面超越人类,另一种传统观点则认为随着AI的发展,人类将对自己进行“硬件层面”的修改,例如通过神经接口或者模拟大脑改造自己。Carter和Nielsen提出了第三种观点,AI将在“软件层面”增强人类的智能,改变人类的思维方式,拓展人类创造性的范围。昨天我们接上了本文的上半部分:使用人工智能增强人类智能(上),今天为大家带来第二部分。

交互式生成对抗模型

我们来看另一个使用机器学习模型来增强人类创造性的例子,2016年Zhu等人4提出的交互式生成对抗网络,即iGANs。

论文中的一个例子是使用iGAN生成鞋子之类的消费品的图像的界面。传统上,这样的界面会要求程序员编写一个包含大量关于鞋子的知识的程序:鞋底、鞋带、鞋跟,等等。 论文并没有这样做,而是使用一种生成模型来训练从Zappos下载的5万张图片。接着,使用这个生成模型构建了一个界面,让用户粗略地勾勒出鞋子的形状、鞋底、鞋带等等:

视觉效果很差,部分原因是,按照现代(2017)标准,zhu等人使用的生成式模型已经过时了——更现代的模型,视觉效果会好很多。

但视觉效果不是重点。这个原型能做许多有趣的事情。例如,注意鞋子的整体形状在鞋底填充时发生的明显变化——它变得更狭长、更优美。许多小细节出现了,比如白色鞋底顶上的黑色滚边,鞋面上到处出现了红色。这些和其他的事实都是从底层的生成模型中自动推导出来的,下文我们将简要描述其方式。

相同的界面可以用来绘制风景。唯一的区别是,底层的生成模型在风景图像而不是鞋子图像上进行训练。在这一案例中,可以仅仅绘制与风景相关的颜色。例如,这里有一位用户正勾勒一些绿草、山的轮廓、一块蓝天和山上的雪:

这些界面中使用的生成式模型与我们的字体模型不同。它们没有使用变分自动编码器,而是基于生成对抗网络(GAN)5。但是其基本想法仍然是找到一个可以用来表示(举例来说)所有风景图像的低维潜空间,并将该潜空间映射到相应的图像上。同样,我们可以把潜空间中的点看作是描述风景图像的一种紧凑的方式。

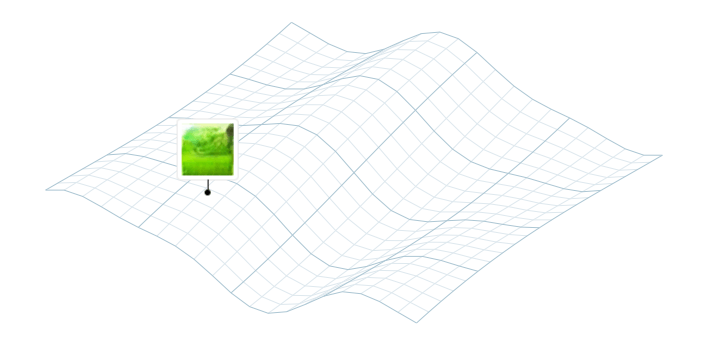

粗略地说,iGAN的工作方式如下。无论现在的图像是什么,它都对应潜空间中的某一点:

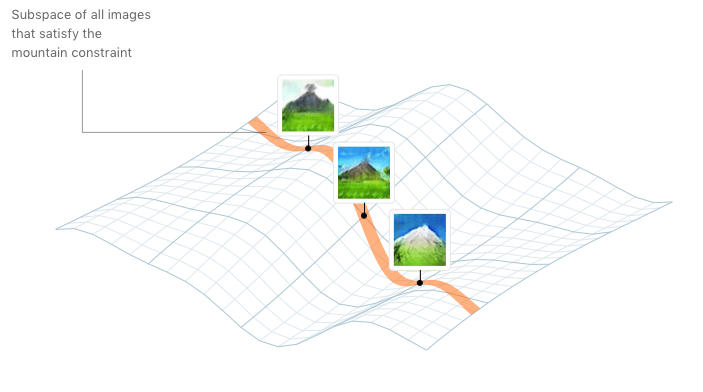

假设用户现在勾勒出山形的轮廓,就像前文的视频中那样,我们可以将用户勾勒的笔画视为图像的一个约束,从而挑选出潜空间的一个子空间,该子空间由潜空间中所有表示与轮廓相匹配的图像的点组成:

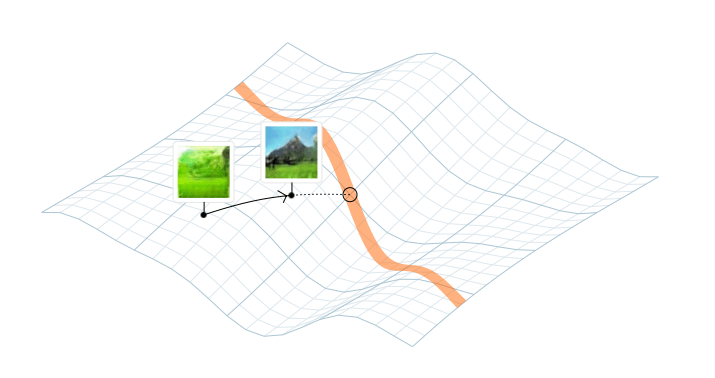

界面的工作方式是找到接近当前图像的潜空间中的一个点,所以图像在接近满足所施加的约束的情形下,不会改变太多。这是通过优化一个目标函数来完成的,该目标函数组合了到每个施加约束的距离和从当前点移动的距离。如果只有一个约束,比如,对应于山的笔画,这看起来大概是这样子的:

那么,我们可以这么概括这种方法,将约束应用到潜空间,从而以有意义的方式移动图像。

iGAN与我们之前展示的字体工具有许多相通之处。不管是学习如何理解一座山的样子,还是推断加粗字体时应该保留围起来的负空间,它们都提供了编码世界的许多微妙知识的操作。iGAN和字体工具都提供了理解和导航高维空间的方式,将我们留在字体、鞋子或风景的自然空间中。正如Zhu等人所言:

对我们大多数人来说,即使在Photoshop中进行简单的图像处理也会出现难以克服的困难……任何不够完美的编辑立刻使图像看起来完全不真实。换句话说,经典的视觉操作范式并不能阻止用户跌出自然图像的流形。

像字体工具一样,iGANs是一种认知技术。用户可以将界面操作内化为思维中的新原语。例如,在鞋子的案例中,他们可以基于他们想要应用的差异进行思考,增加鞋跟,一个更高的鞋面,或者一个特别的亮点。这比非专家对鞋子的传统思维方式(“11号、黑色”等)丰富得多。非专家一旦以更复杂的方式思考——“鞋面稍微高一点、狭长一点”——他们几乎没有尝试过这种思维方式,也几乎不曾见过他们的选择的结果。拥有这样的界面可以让他们更轻松地进行探索,赋予他们开发惯用法的能力,赋予他们计划的能力,赋予他们与朋友交换想法的能力,等等。

两种计算模型

回顾一下文章开头的问题:计算机是做什么的,这与智能增强有什么关系。

一个普遍的关于计算机的概念是,它们是解决问题的机器:“计算机,在这样和那样的风向和风速(以及其他条件)下发射这枚炮弹的结果是什么?”;“计算机,东京5天以内的最高气温是多少?”;“计算机,当围棋棋盘处于这个状态时,在哪里落子最好?”;“计算机,这个图像如何归类?”;等等。

从将计算机视为数值运算设备的早期观念,到历史上和现在的AI的许多成果,这一概念一脉相承。这是一种将计算机视为认知外包方式的模型。在对未来可能的AI的推测性描述中,这种认知外包模型通常表现为将人工智能视为神谕,能够以超出人类的表现解决一大类问题。

但是,关于计算机是做什么,一个很不一样的概念是可能的,这个概念与智能增强的成果要一致得多。

要理解另一种观点,想想我们思维的主观体验。对于很多人来说,这个经历是口头的:他们用语言思考,在脑内形成一系列的词汇,类似于言语中或书面的句子。对于其他人来说,思考是一种更加视觉化的体验,包含图形和地图等表示。还有一些人将数学融入他们的思维中,使用代数表达式或图解技术,例如费曼图和彭罗斯图。

在每种情况下,我们都使用其他人发明的表示:单词、图形、地图、代数、数学图表等等。在成长的过程中,我们内化了这些认知技术,并将它们用作我们思维的底物。

就大部分历史时期而言,可供选择的认知技术的范围发生了缓慢的扩大。引入了一个新词,或者一个新数学符号。发展出一种全新的认知技术的情形则罕见得多。例如,1637年Descartes出版了《Discourse on Method》,解释如何使用代数来表示几何概念,以及如何用几何来表示代数概念:

x2+y2=1

这使我们思考几何和代数的方式发生了根本性的变化和扩展。

历史上很少发明持久的认知技术。但现代计算机是一种元媒介,许多新认知技术籍此得以快速发明。考虑一个相对平凡的例子,比如Photoshop。内行的Photoshop用户通常有以往不可能会有的想法,例如:“让我们将克隆图章应用于这个和那个层。”一个更通用的思维类型的例子:“计算机,【新的行动类型】这个【对新想象的对象类别的新型表示】。”当这种事情发生时,我们正使用计算机扩大我们的思维范围。

这种认知转向(cognitive transformation)正是智能增强最深入的基础之一。不是外包认知,而是改变我们思维的运算和表示,改变思维本身的底物。所以,尽管认知外包很重要,这种认知转向的视角却提供了一个更加深刻的智能增强模型。在这一视角下,计算机是改变和扩展人类思维本身的手段。

历史上,从苏美尔和中美洲的文字,到Douglas Engelbart、Alan Kay等现代界面设计师,认知技术都是由人类发明的。

本文提到的例子表明,AI系统能够提供创造新认知技术的机会。字体工具之类的东西不仅仅是你想要新字体时需要询问的神谕。相反,它们可以用来探索和发现新东西,提供新的表示和运算,这些可以内化为用户自身思维的一部分。虽然这些例子还处于早期阶段,但它们表明AI不仅仅是认知外包。AI的另一种视角是可能的,在该视角下,AI可以帮助我们发明新认知技术,这些技术将改变我们的思维方式。

本文只关注了很少几个例子,主要涉及对潜空间的探索。还有许多其他人工智能增强的例子。为了让你有点印象,我们给出一个很不全面的列表:神经网络辅助绘画的sketch-rnn、使用户能够快速创建新乐器进行艺术创作的Wekinator6系统、通过探索潜空间来开发动画的TopoSketch7、用于设计整体版面布局的机器学习模型、以及能够插入乐句的生成式模型8。在每个案例中,系统都使用机器学习激活了可融入用户思维的新原语。更宽泛地说,人工智能增强将利用计算创造性9和交互式机器学习10等领域的成果。

寻找强大的新思维原语

我们主张,机器学习系统可以帮助创建作为人类新思维原语的表示和运算。我们应该在这样的新原语中寻找什么样的属性?这是一个很大的问题,大到无法在这样一篇短文中全面回答。但是我们会简单地探讨一下。

历史上,重要的新媒介形式刚推出时常常看起来很奇特。流行文化中有很多这样的例子:Stravinsky(斯特拉文斯基)和Nijinksy的《春之祭》首演时爆发了骚动;早期的立体主义绘画令人震惊,连《纽约时报》都评论道:“这是什么意思?画画的人是不是发狂了?这是艺术还是疯狂?谁知道呢?”

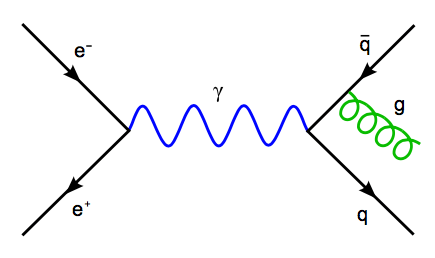

另一个例子来自物理学。20世纪40年代,物理学家Julian Schwinger、Shin’ichirō Tomonaga和Richard Feynman(费曼)独立发展了量子电动力学理论的不同形式化表述。在他们的工作中,Schwinger和Tomonaga采用了和物理学的其他部门类似的传统代数方法。费曼采用了更激进的方法来刻画光与物质的相互作用,这一方法现在被称为费曼图:

图片来源:Joel Holdsworth,基于cc-by-sa 3.0许可

最初,Schwinger-Tomonaga对其他物理学家来说更容易理解。当Feynman和Schwinger 在1948年的研讨会上展示他们的工作时,Schwinger当即受到赞誉。相反,费曼让他的观众们困惑不已。正如James Gleick在费曼的传记中所描述的:

让费曼饱受打击的是,每个人都有一个偏爱的原理或定理,而他全部违反了……费曼知道他失败了。当时,他很痛苦。后来他只是说:“我的东西太多了。我的机器来自太远的地方。”

当然,就奇特本身而言,奇特是没用的。但是这些例子表明,表示的突破刚开始常常显得很奇特。这背后是不是有什么深层的原因?

部分原因是,如果是某个真正全新的表示,那么它会不同于你以前见过的任何东西。费曼图、毕加索的绘画、斯特拉文斯基的音乐都揭示了真正的建构意义的新方法。好的表示使这样的洞见更清晰,省去了熟悉性以尽可能生动地揭示新东西。不过,由于强调陌生性,这种表示看起来会很奇特:它显示了你从未见过的关系。从某种意义上说,设计师的任务就是要辨别出这个核心的奇特性,并且尽可能地放大它。

奇特的表示往往难以理解。起初,物理学家选择了Schwinger-Tomonaga方法,而没有选择费曼的方法。但是随着费曼的方法逐渐被物理学家所理解,他们意识到,尽管Schwinger-Tomonaga方法和费曼方法在数学上是等效的,费曼方法却更加强大。正如Gleick所说:

Schwinger在哈佛的学生在竞争上有劣势,至少在其他地方的研究人员看来是这样的,这些研究人员怀疑Schwinger在哈佛的学生其实偷偷使用这些图表。有时候,这怀疑没错……Murray Gell-Mann后来在Schwinger的房子里呆了一个学期,后来很喜欢说他到处搜寻费曼图。他没有找到费曼图,但有一个房间被锁上了。

这些想法不仅在历史上的表示上是成立的,而且在计算机界面上也是成立的。然而,我们倡导的表示上的陌生性与有关界面的传统智慧相矛盾,特别地,界面应该是“用户友好”的,即界面应该是简单的,应该让新手可以立即使用,这是一个普遍持有的信念。大多数情况下,这常常意味着界面是陈旧的,由传统元素组合而成。然而,尽管使用一个陈旧的界面可能轻松有趣,但这是一种类似于阅读套路化的言情小说的轻松。这意味着界面没有揭示任何关于其主题的真正令人惊讶的东西。因此,它在深化用户理解,或改变用户的思维方式方面,都起不了什么作用。对于一些平常的任务,这挺不错的。但是,就长期而言,深层次的任务需要更好的接口。

理想情况下,界面将呈现主题背后最深刻的原理,向用户展现一个新的世界。当你学习这样一个界面时,你内化这些原理,从而获得更强大的对于这个世界的推理方式。这些原则是你理解的diff(译注:diff原指文件之间的差异,可用于更新文件,这里借指理解的差异,可用于深化和改变你的理解)。它们都是你真正想看到的,其他一切东西充其量不过是一些支持,甚至其中最差的部分是无关紧要的糟粕。最好的界面的目的不是很肤浅的那种用户友好。而是远为强大的意义上的用户友好,具体化关于世界的深刻原理,使其成为用户生活和创造的工作条件。到那时,曾经显得奇特的东西将变得舒适和熟悉,将成为思维模式的一部分。(这些想法的一个强有力的例子是界面具体化了通用原理。例如,作者之一根据能量守恒原理开发了一个界面。这样的通用原理在一个主体的实体之间生成了多个预料之外的关系。同时,在界面中具体化后,这样的通用原理也成为一个特别丰富的洞见来源。)

对用于智能增强的AI模型而言,这意味着什么?

正如我们所看到的,我们的机器学习模型将雄心勃勃地帮助我们构建将深层原理以对用户有意义的方式具体化的界面。为了实现这一点,模型必须发现关于世界的深刻原理,辨识那些原理,接着以一种用户可理解的方式,在界面中尽可能生动地展现出来。

当然,这是一个离谱的要求!我们所展示的例子仅仅是一个开始。确实,我们的模型有时会发现相对深刻的原理,比如在加粗字体时保留包围的负空间。但是这仅仅是模型隐含的。尽管我们已经建立了一个利用这些原理的工具,但是如果模型能自动推断出所学的重要原理,同时找到通过界面明确展现它们的方法,那就更好。 (InfoGAN11使用信息论思想来发现潜空间中的结构,是这一方向上一个令人鼓舞的进展。)理想情况下,这样的模型将开始具备真正的说明,这些说明将不仅仅会是静态形式,还会是可由用户操作的动态形式。不过,要达到这个目标,我们还有很长的路要走。

这些界面是否会抑制创造性?

前文所述的界面的表达能力很有可能会让人起疑心。如果一个界面限制我们只探索图像的自然空间,那么这是否意味着我们做的都是可预期的?这是否意味着这些界面只能用于生成视觉上的陈词滥调?它是否阻碍我们通过真正的创造性工作产生真正新的东西?

分辨两种不同的创造性模式有利于回答这个问题。这个双模式模型过度简化了:创造性并不能完美地分为不同的两类。然而,这个模型仍然澄清了新界面在创造性工作中的角色。

创造性的第一种模式是工匠从事他们的工作时的日常创造性。例如,字体设计师的大部分工作都是对现有最佳实践的适当重组。这样的工作通常涉及许多创造性的选择,以达到预期的设计目标,但并没有发展关键的基础性的新原理。

对于这样的工作,我们一直在讨论的生成式界面很有前途。虽然他们目前有很多限制,但未来的研究将识别和修正许多缺陷。随着GAN的发展,这方面很快就取得了很多进展:原来的GAN5有许多限制,但很快出现了更适应图像的模型,分辨率提升了,伪影减少了,(提升分辨率和减少伪影方面有太多的工作,只列出其中一小部分而忽略其余看起来可不公平)等等。在足够的迭代之后,有理由相信,这些生成式界面将成为手工艺工作的强大工具。

第二种创造性模式致力于发展新的原理,这些原理从根本上改变创造性表达的范围。人们在毕加索或莫奈等艺术家的作品中能看到这一点,他们违反了现存的绘画原理,发展出新的原理,让人们以新的方式去看。

使用生成式界面时,是否可能进行这样的创造性工作?难道这样的界面没有将我们限制在自然的图像或自然的字体的空间中,从而积极地阻止我们探索创造性工作中最有趣的新方向吗?

情况比这更复杂。

在某种程度上,这是关于我们生成式模型能力的一个问题。在某些情况下,模型只能生成现有想法的重组。这是一个理想的GAN的限制,因为一个经过完美的训练的GAN生成器将重现训练分布。这样的模型不能直接生成基于新的基础性原理的图像,因为这样的图像看起来不像它在训练数据中看到的任何东西。

像Mario Klingemann和Mike Tyka这样的艺术家现在正使用GAN来创造有趣的艺术品。他们使用“不完美的”GAN模型来进行这些创造,在他们看来,不完美的GAN模型可以用来探索有趣的新原理;也许在这样的情形下,坏的GAN可能比理想的GAN在艺术上更有趣。况且,没有人说过界面只能帮助我们探索潜空间。也许可以加入一些有意把我们带出潜空间的运算,或者把我们带到自然的图像空间中不太可能(同时也是更令人惊讶的)部分。

当然,GAN不是唯一的生成式模型。在一个足够强大的生成式模型中,模型发现的概括可能包含人类未曾发现的概念。在这种情况下,探索潜空间可以让我们发现新的基础性原理。模型会比人类专家发现更强大的抽象。想象一个刚好在立体主义时代之前训练画作的生成式模型,有可能通过探索这个模型发现立体主义吗?这将可以类比前文提到的玻色-爱因斯坦凝聚态的预测。这样的发明超出了今天的生成式模型的能力范围,但看起来是未来模型值得期待的一个方向。

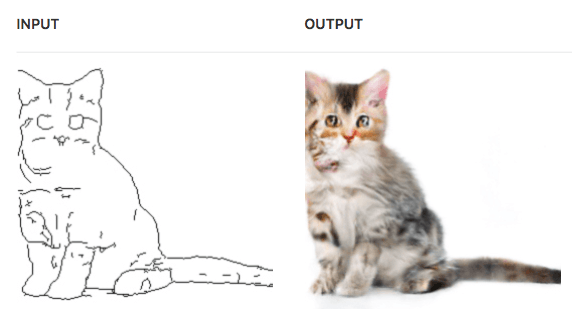

到目前为止,我们的例子都是基于生成式模型的。但是有一些富于启发性的例子并没有基于生成式模型。考虑由Isola等人开发的pix2pix系统。该系统在成对的图像上训练,例如,成对的显示猫的边缘的图像和相应的实际的猫的图像。一旦训练完毕,可以给它展示一组边缘线条,并要求生成相应的实际图像。它经常做得很好:

(Christopher Hesse做了一个在线演示网站)

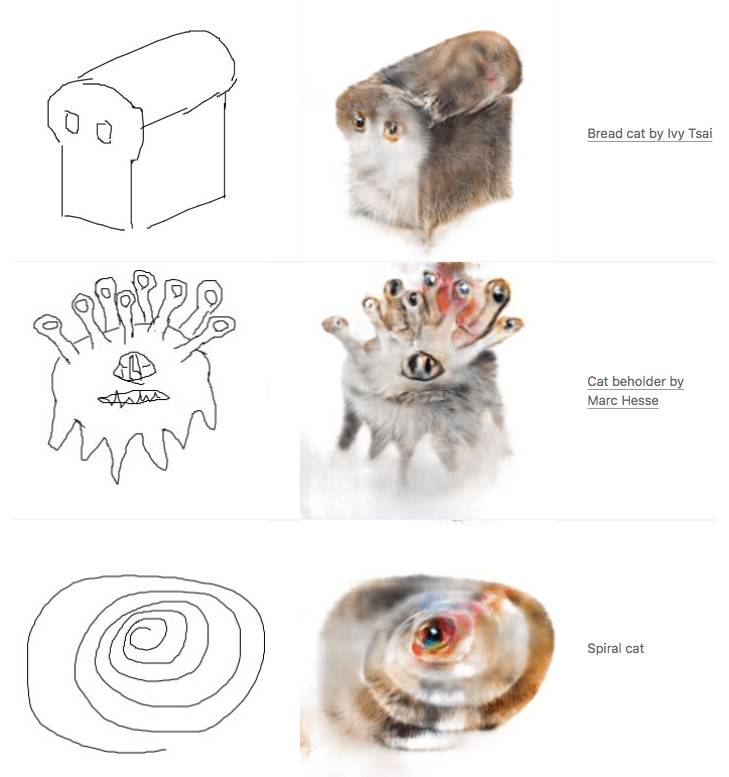

当提供不寻常的约束时,pix2pix可以产生惊人的图像:

这样的创造性也许没有达到毕加索的高度。但它仍然令人惊讶。这绝不像我们曾经见过的图像。pix2pix和它的人类用户如何实现这样的效果?

不像我们以前的例子,pix2pix不是一个生成式模型。这意味着它没有一个潜空间或一个对应自然的图像的空间。相反,它使用了一个神经网络,这个神经网络被称为生成网络,这名称令人混淆,因为这个生成网络和我们之前的生成式模型意义不同,生成式模型接受约束图像作为输入,并生成填充图像作为输出。

生成网络通过和一个判别网络相互竞争进行训练,判别网络的作用是区分来自实际数据的图像和来自生成网络的图像。

虽然这听起来与传统的GAN类似,但是其间有一个关键的差别:没有潜向量输入到生成网络。(事实上,Isola等人尝试将这样一个潜向量添加到生成网络,但结果发现最终生成的图像没什么区别。)相反,只有一个输入约束。当人类输入一个训练中前所未见的约束时,网络被迫进行即兴创作,尽其所能地根据之前学习过的规则来解释这个约束。创造性是从训练数据推断出的知识和用户提供的新颖约束强行合并的结果。因此,即使是相对简单的想法,比如面包猫和观察者猫,也会导向全新的图像类型,这些图像并不属于我们之前考虑过的自然的图像空间。

结论

人工智能将改变我们与计算机进行交互的方式是传统智慧。不幸的是,AI社区中的很多人大大低估了界面设计的深度,往往把它视为一个简单问题,主要是为了美观或易用。在这一视角下,界面设计是一个需要交给别人去处理的问题,艰难的工作是训练某个机器学习系统。

这一视觉是不正确的。最深刻的界面设计意味着发展人类思维和创造的基本原语。这一问题的智能起源可以追溯到字母表、制图学和乐符的发明者,以及Descartes、Playfair、Feynman、Engelbart和Kay等现代巨擘。这是人类需要解决的最困难、最重要、最基础性的问题之一。

如前所述,在AI的通常视角下,我们的计算机将会继续提升解决问题的能力,而人类大体上将保持不变。在AI的另一种通常视角下,人类将在硬件层面上被修改,或许直接通过神经接口接受修改,或者通过全脑模拟接受间接修改。

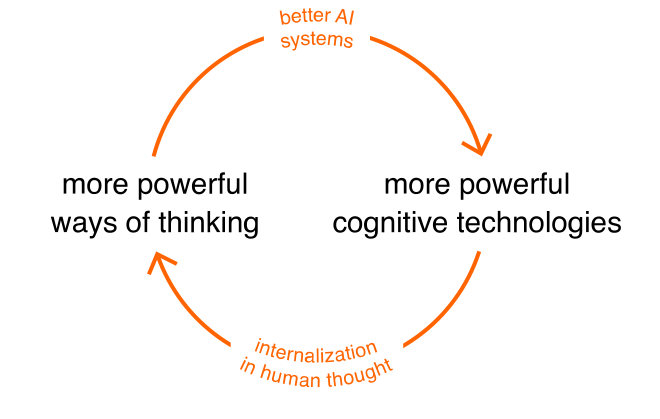

本文描述了第三种视角,在这一视角下,AI实际上改变了人类,帮助我们发明了新的认知技术,这些技术拓展了人类思维的范围。也许有一天,这些认知技术会反过加速AI的发展,形成一个良性的循环:

这将不会是机器的奇点。相反,这将是人类思想范围的奇点。当然,这个循环目前而言基本上只是推测。我们所描述的系统可以帮助发展更强大的思维方式,但是充其量这些思维方式只是在间接的意义上正在被用来开发新的AI系统。

当然,长期而言,机器可能会在所有或大部分的认知任务上超越人类。即便如此,认知转向仍然会是一个有价值的结果,它本身就值得追求。即使机器做得更好,学习下国际象棋和围棋,提高自己下棋的水平,也很有乐趣,很有价值。并且,在讲故事之类的活动中,益处往往更多地来自建构故事和人物关系这一过程,而非最终的产物。除了工具性利益之外,个人的变化和成长具有内在的价值。

我们讨论的面向界面的工作在用来评判人工智能中大多数现有工作的叙事学之外。它不涉及战胜分类或回归问题的某个基准。它不涉及像在围棋之类的游戏中击败人类冠军那样令人印象深刻的功绩。相反,它涉及一个更为主观和难以衡量的标准:它是否在帮助人类以新的方式思考和创造?

这给进行这种工作带来了困难,特别是在研究方面。这样的工作应该在哪里发表?属于哪个社区?应该用什么标准来评判这样的工作?好的工作与坏的工作区别是什么?

我们相信在接下来的几年里会涌现一个回答这些问题的社区。这一社区举办研讨班和会议。它将在Distill等地方发表作品。其标准将来自许多不同的社区:来自艺术、设计和音乐社区;来自数学社区对抽象和好的定义的品味;以及现有的AI和IA社区,包括计算创意和人机交互方面的工作。创作者广泛使用的工具的开发,将是成功的长期检验。艺术家是否使用这些工具发展了非凡的新风格?其他领域的科学家是否使用它们以原本不可能的方式来发展理解?这些都是伟大的志向,这些志向需要一种基于传统AI工作但同时包含了非常不一样的规范的方法。

参考文献

Augmenting Human Intellect: A Conceptual Framework Engelbart, D.C., 1962.

Auto-encoding variational Bayes Kingma, D.P. and Welling, M., 2014. ICLR.

Auto-encoding variational Bayes Kingma, D.P. and Welling, M., 2014. ICLR.

Generative visual manipulation on the natural image manifold J. Zhu, P. Krähenbühl, E. Schechtman, A.A. Efros. European Conference on Computer Vision (ECCV). 2016.

Generative adversarial nets Goodfellow, I.J., Pouget-Abadie, J., Mirza, M., Xu, B., Warde-Farley, D., Ozair, S., Courville, A. and Bengio, Y., 2014. Advances in Neural Information Processing Systems (NIPS), pp. 2672-2680.

Real-time human interaction with supervised learning algorithms for music composition and performance Fiebrink, R., 2011. Princeton University PhD Thesis.

TopoSketch: Drawing in Latent Space Loh, I. and White, T., 2017. NIPS Workshop on Machine Learning for Creativity and Design.

Hierarchical Variational Autoencoders for Music Roberts, A., Engel, J. and Eck, D., 2017. NIPS Workshop on Machine Learning for Creativity and Design.

Computational creativity: the final frontier? Colton, S. and Wiggins, G.A., 2012. ECAI.

Interactive machine learning: letting users build classifiers Ware, M., Frank, E., Holmes, G., Hall, M. and Witten, I.H., 2001. International Journal of Human-Computer Studies, Vol 55, pp. 281-292.

InfoGAN: Interpretable Representation Learning by Information Maximizing Generative Adversarial Nets Chen, X., Duan, Y., Houthooft, R., Schulman, J., Sutskever, I. and Abbeel, P., 2016. NIPS.