大型AI已有自主意识了?LeCun开喷Open AI首席科学家

![]()

新智元报道

新智元报道

编辑:袁榭 好困

【新智元导读】作为AI界的明星研究所,老是搞事情的OpenAI,现在真的搞出通用人工智能(AGI)了么?

「AI会不会变终结者」,这是外行经常会问、内行只有摊手的老套问题。

不过,这话要是让行内大佬一说,效果马上不一样了。

最近,OpenAI首席科学家的一句话,让整个机器学习圈都炸了锅了。

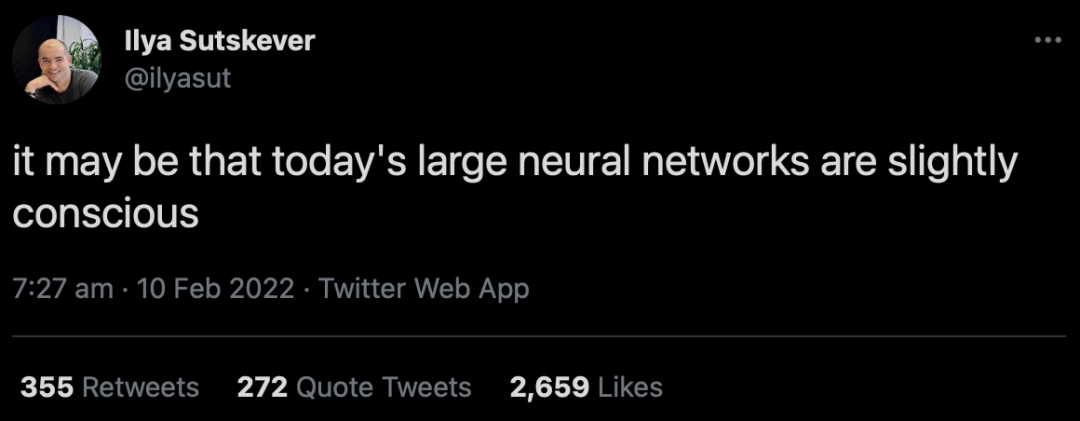

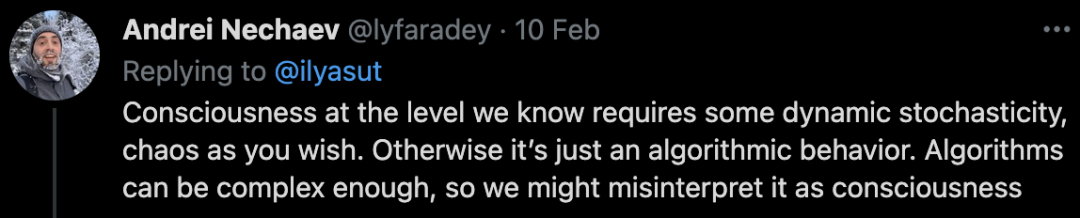

2月10日,伊利亚·萨茨克维尔(Ilya Sutskever)发推表示:「现在的大型神经网络可能已经有微弱自主意识了。」

争论持续了几天之后。

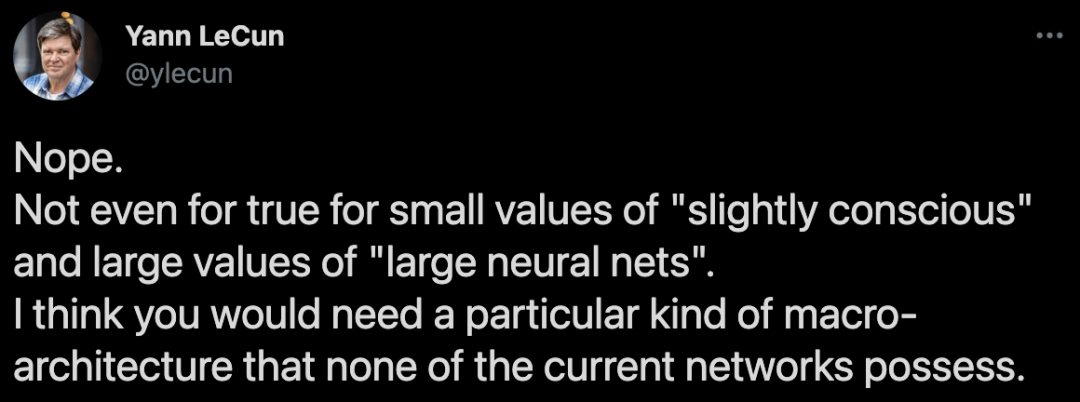

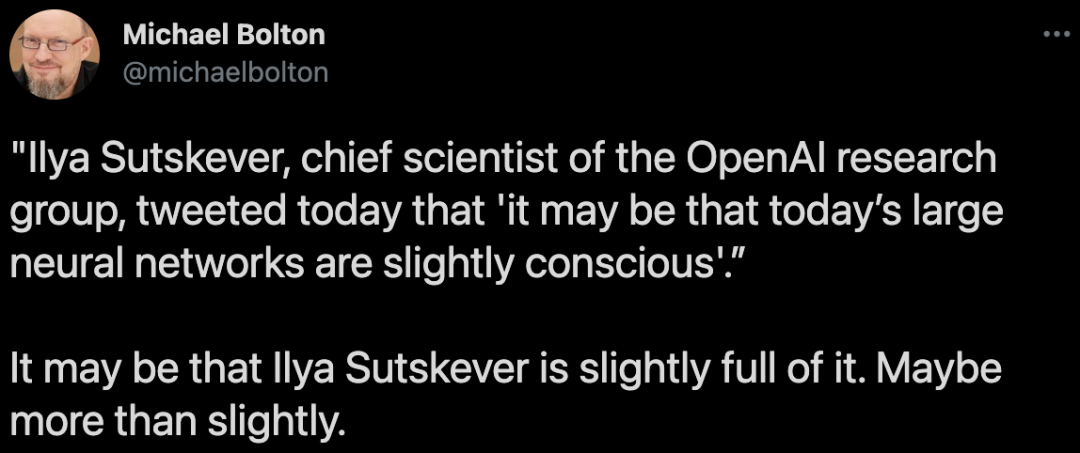

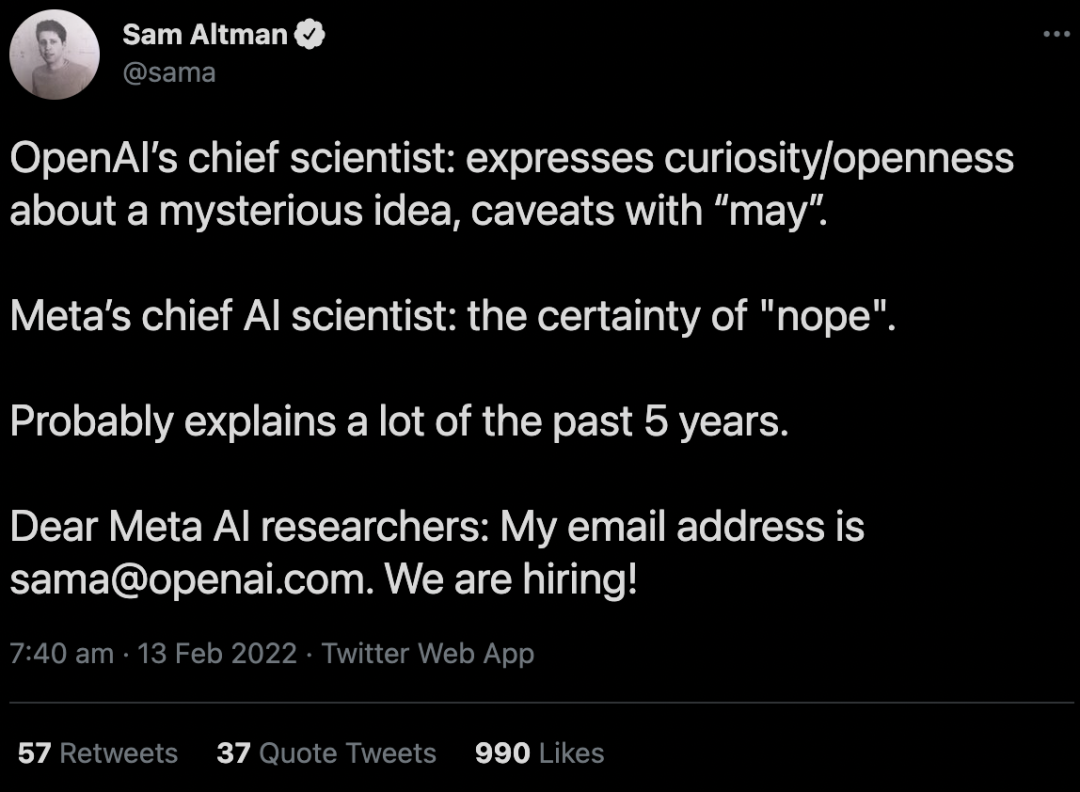

2月13日,LeCun甚至亲自下场,异常坚决且简单明了:

「不对。」

接着便措辞礼貌但尖刻地解释道:

「甚至『微弱意识』里的表微量的形容词,和『大型神经网络』里的表示大型的形容词,都是错的。我认为这需要一种当下所有神经网络都不具备的大型架构来支撑。」

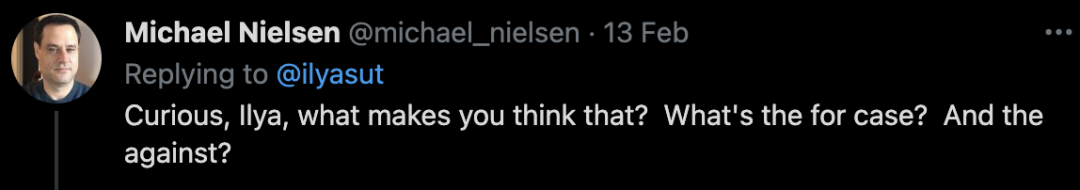

这段时间,伊利亚老师都是一句话冷艳结束,所以现在没人知道他到底具体在讲些什么。

尤其是这句「仓促」得连首字母都没有大写,不由得引人想入非非。

是在说正在开发中的新GPT模型大力出奇迹呢?还是在说自家的现有模型受天启感召已经具有不亚于人的灵智呢?还是重复宣传「通用人工智能」(AGI)很好很强大的观点呢?

真要臆想超级AI,看《疑犯追踪》比看无聊纪录片舒服多了。

大佬们喷成一锅粥

大佬们喷成一锅粥

AI到底有无自主意识?

对此,非盈利研究机构「感知学院」(Sentience Institute)的联合创始人、社会科学家Jacy Reese Anthis在推特贴文中对此进行了深入的探讨。

在为自家的机构打了广告后,Jacy Reese Anthis阐述:

首先,意识的含义在哲学家和科学家中存在很大争议。

对此,可以用3个以上更精确的术语来形容:

思想,通常是一种语义上的字词流

感知,通过五种感官或想象力达到的感知

情感,积极和消极的情绪

然而,甚至这些都是有争议的。

这些是行为吗?过程?功能?二元论?不可言说的?等等。

Jacy认为,应该采取消除主义的观点。因为这些术语是如此模糊,所以意识并不客观存在。

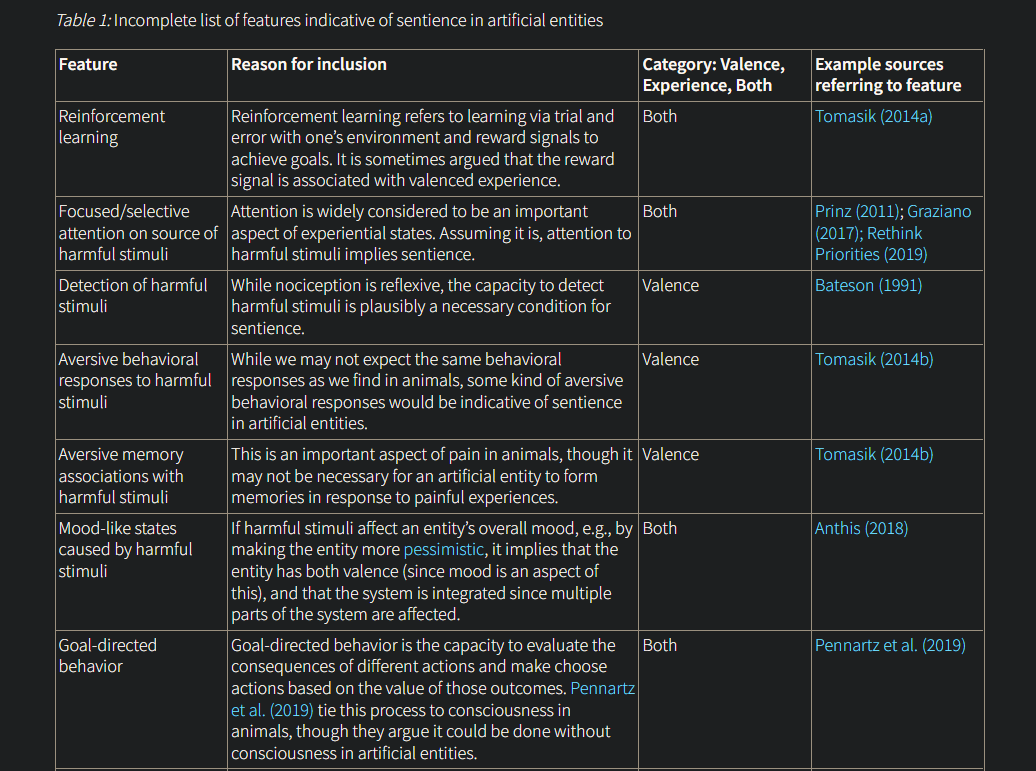

那么,哪些具体特征会表明人工智能中的有知觉或意识?

「感知学院」的研究者认为如果人工智能可以被称为有意识,它可能具备以下特征中的一个或多个:对有害诱导数据的检测及于此可变的注重程度、对此诱因有规避的回应与记忆联想、对此诱因有类似情绪变化的状态变化,加强学习,基于目标而定的行为,对情绪状态的语义表述。

http://sentienceinstitute.org/blog/assessing-sentience-in-artificial-entities

当下如GPT-3等的变换模型,以上特征几近于无。不过,Jacy还是不认为此议题有完全客观的答案。

因为对于意识的定义、比如「此物感觉怎样」或「内在倾听者」等等,用来回答这问题都太过模糊。

如今,在分歧、模糊和不确定的情况下所能做到的最精确回答大概就是:「神经网络可能有了极微的意识,但是比昆虫要少」。

参考资料:

https://futurism.com/the-byte/openai-already-sentient

https://wordpress.futurism.com/conscious-ai-backlash/amp

Ilya Sutskever:https://twitter.com/ilyasut/status/1491554478243258368

LeCun:https://twitter.com/ylecun/status/1492890267468320778

Sam Altman:https://twitter.com/sama/status/1492644786133626882