送AI专栏|深度学习必备的5大知识模块(内附知识卡片)

近年来,随着 AlphaGo 在技术上的步步突破,深度学习成为当之无愧的热门技术。可以说,AlphaGo 的胜利也就是深度学习的胜利。

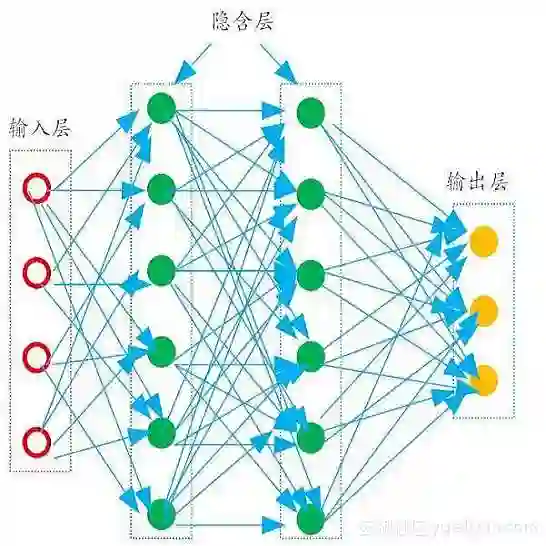

深度学习是利用包含多个隐藏层的人工神经网络实现的学习。想要深入了解深度学习,我们至少需要从以下几个方面入手:深度前馈网络、深度学习中的正则化、深度学习中的优化、自编码器和深度强化学习。

深度前馈网络(deep feedforward network)是具有深度结构的前馈神经网络,可以看成是进化版的多层感知器。与只有一个或两个隐藏层的浅层网络相比,深度前馈网络具有更多的隐藏层数目,从而具备了更强的特征提取能力。

在深度前馈网络的设计中,确定架构是首要考虑的关键问题。架构决定着网络中包含多少基本单元,以及这些基本单元之间如何相互连接。几乎所有前馈网络采用的都是链式架构,即前一层的输出是后一层的输入。在这样的链式架构中,层的数目和每一层中神经元的数目就是网络的主要变量。

关于深度前馈网络存在一些共性问题,要点如下:

正则化(regularization)作为抑制过拟合的手段,是机器学习和深度学习之中必不可少的环节,具有举足轻重的地位。好的机器学习算法不仅要在训练集上表现出色,当推广到未知的测试数据时,其优良的性能依然能够得以保持。正则化就是一类通过显式设计降低泛化误差,以提升算法通用性的策略的统称。由于深度学习中涉及的参数众多,正则化就变得尤为重要。

正则化被定义为对学习算法的修改,这些修改的目的在于减少泛化误差。通常说来,泛化误差的下降是以训练误差的上升为代价的,但有些算法也能兼顾泛化误差和训练误差的良好性能。

正则化处理可以看成是奥卡姆剃刀原则(occam's razor)在学习算法上的应用。奥卡姆剃刀原则的表述是:“当两个假说具有完全相同的解释力和预测力时,以那个较为简单的假说作为讨论依据。”在机器学习中,正则化处理得到的正是更加简单的模型。

从概率论角度看,许多正则化技术对应的是在模型参数上施加一定的先验分布,其作用是改变泛化误差的结构。正则化是对欠拟合和过拟合的折中,在不过度增加偏差的情况下显著减少方差。正则化能够改变数据分布,让通过模型得到的数据分布尽可能和真实的数据生成过程相匹配。

虽然目前在深度学习中应用的正则化方式称得上“八仙过海,各显神通”,却并不存在能够系统描述这些方法、并进一步指导设计的通用主线。因此,要从通观全局的角度看待正则化处理,还是要“不忘初心”,从根本目的着眼。

常用的正则化策略有以下几类:

基于训练数据(data)的正则化

基于网络架构(network architecture)的正则化

基于误差函数(error function)的正则化

基于正则化项(the regularization term)的正则化

基于最优化过程(optimization)的正则化

除了正则化之外,优化也是深度学习需要解决的一个核心问题。由于深度神经网络中的隐藏层数目较多,因而将整个网络作为一个整体进行优化是非常困难的事情,需要花费大量的时间和计算力。出于效率和精确性的考虑,在深度学习的优化上需要使用专门的技术。

出于可解性的考虑,传统机器学习算法往往会小心翼翼地选择代价函数和优化条件,将待优化问题转化为容易求解的凸优化问题。但在神经网络,尤其是在深度神经网络中,更一般的非凸情况是不可避免的,这就给深度学习中的优化带来很多额外的挑战。

深度学习中实现优化的一般思路:

自编码器(auto-encoder)是一类执行无监督学习任务的神经网络结构,它的目的是学习一组数据的重新表达,也就是编码。在结构上,自编码器是包含若干隐藏层的深度前馈神经网络,其独特之处是输入层和输出层的单元数目相等;在功能上,自编码器的目的不是根据输入来预测输出,而是重建网络的输入,正是这样的功能将自编码器和其他神经网络区分开来。由于自编码器的图形表示像极了杂技中使用的道具空竹,因而也得了个“空竹网络”的雅号。

关于深度学习中自编码器的原理与特点,其要点如下:

在 2017 年新鲜出炉的《麻省理工科技评论》十大突破性技术中,“强化学习”榜上有名。如果把时钟调回到一年多之前的围棋人机大战,彼时的深度强化学习在 AlphaGo 对李世乭的横扫中就已经初露峥嵘。而在进化版 AlphaGo Zero 中,“深度强化学习”更是大放异彩,AlphaGo Zero 之所以能够摆脱对人类棋谱的依赖,其原因就在于使用纯粹的深度强化学习进行端到端的自我对弈,从而超越了人类的围棋水平。

强化学习(reinforcement learning)实质上是智能系统从环境到行为的学习过程,智能体通过与环境的互动来改善自身的行为,改善准则是使某个累积奖励函数最大化。具体来说,强化学习是基于环境反馈实现决策制定的通用框架,根据不断试错得到来自环境的奖励或者惩罚,从而实现对趋利决策信念的不断增强。它强调在与环境的交互过程中实现学习,产生能获得最大利益的习惯性行为。

深度强化学习(deep reinforcement learning)是深度学习和强化学习的结合,它将深度学习的感知能力和强化学习的决策能力熔于一炉,用深度学习的运行机制达到强化学习的优化目标,从而向通用人工智能迈进。根据实施方式的不同,深度强化学习方法可以分成三类,分别是基于价值、基于策略和基于模型的深度强化学习。

关于深度强化学习的简单原理与方法分类,总结以下要点:

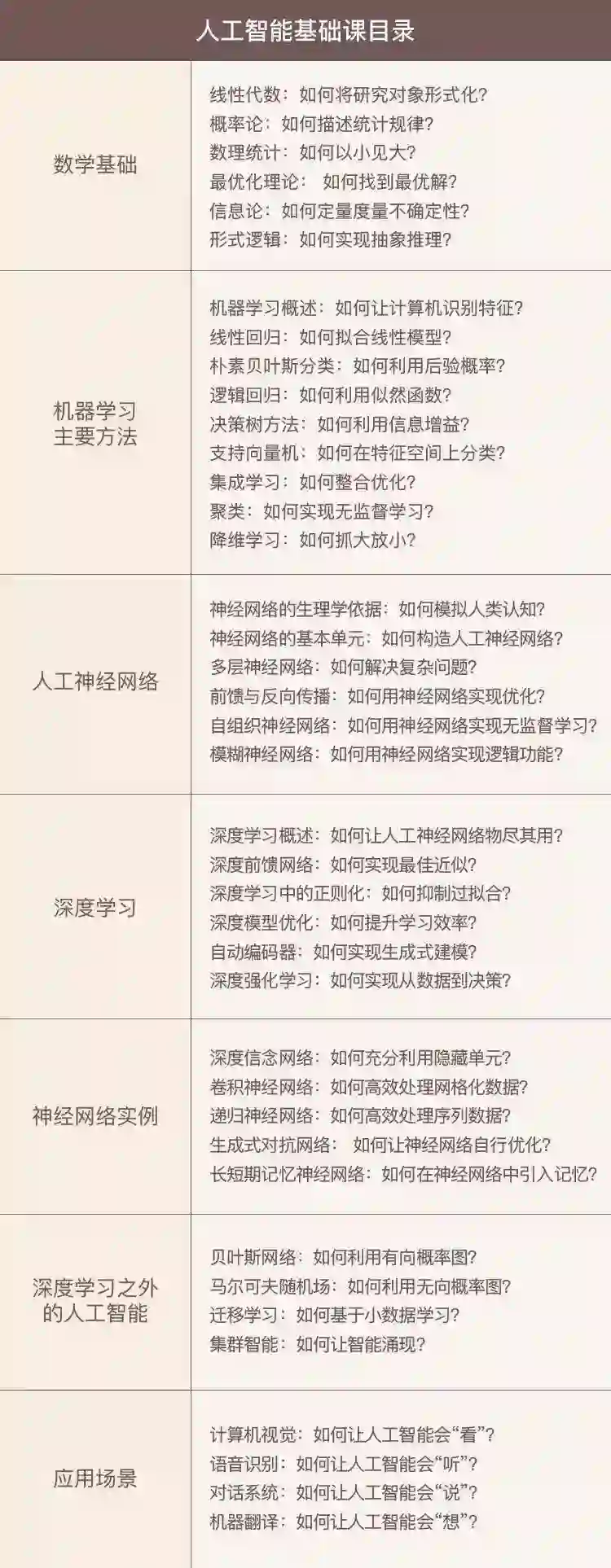

这么干的内容,出自极客时间《人工智能基础课》专栏。

今天,就把这个专栏当作年货送给大家,共 5 个免费名额。

参与活动方法:在留言中聊聊你对人工智能的看法,我们会选取 3 个精选留言和 2 个点赞数最高留言,赠送专栏阅读码,用于免费购买专栏。

留言截止时间: 2 月 12 日 20:00 点。

《人工智能基础课》专栏目录

专栏已经上线「极客时间」App,各位读者可以扫描下方二维码图片进行免费试读专栏。

扫码免费试读专栏,或者点击「阅读原文」查看。

今日荐文

点击下方图片即可阅读

SpaceX “猎鹰”火箭升空:永不放弃的疯子和 NASA 都烧不起的钱