学界 | Hinton提出泛化更优的「软决策树」:可解释DNN具体决策

选自arXiv

机器之心编译

参与:刘晓坤、黄小天

近日,针对泛化能力强大的深度神经网络(DNN)无法解释其具体决策的问题,深度学习殿堂级人物 Geoffrey Hinton 等人发表 arXiv 论文提出「软决策树」(Soft Decision Tree)。相较于从训练数据中直接学习的决策树,软决策树的泛化能力更强;并且通过层级决策模型把 DNN 所习得的知识表达出来,具体决策解释容易很多。这最终缓解了泛化能力与可解释性之间的张力。

深度神经网络优秀的泛化能力依赖于其隐藏层中对分布式表征的使用 [LeCun et al., 2015],但是这些表征难以理解。对于第一个隐藏层我们明白是什么激活了单元,对于最后一个隐藏层我们也明白激活一个单元产生的影响;但是对于其他隐藏层来说,理解有意义变量(比如输入和输出变量)的特征激活的原因和影响就困难重重。由于其边际效应取决于同一层其他单元的影响,使得独立地理解任何特定的特征激活变得举步维艰。

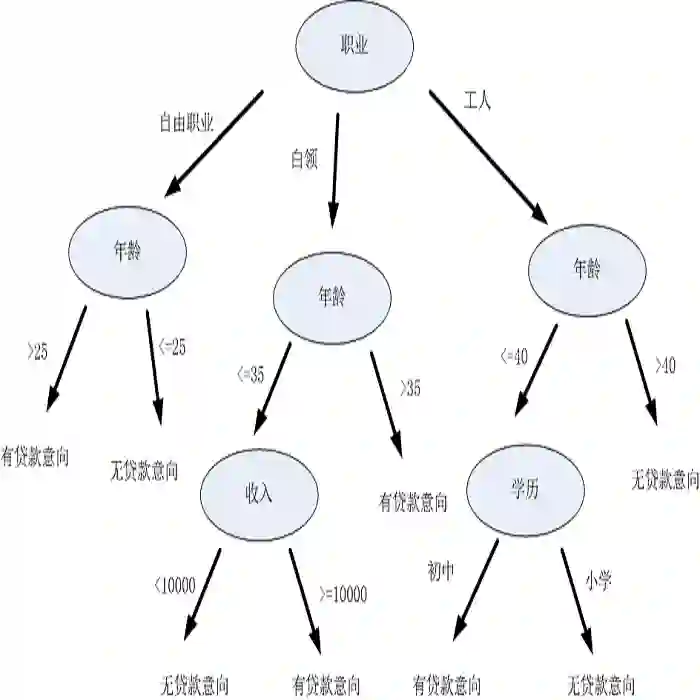

相比之下,很容易解释决策树是如何做出特定分类的,因为它依赖于一个相对短的决策序列,直接基于输入数据做出每个决策。但是决策树并不像深度神经网络一样可以很好地泛化。与神经网络中的隐藏单元不同,决策树较低级别的典型节点仅被一小部分训练数据所使用,所以决策树的较低部分倾向于过拟合,除非相对于树的深度,训练集是指数量级的规模。

在这篇论文中,我们提出了一种新的方法,以缓解泛化能力和可解释性之间的张力。与其尝试理解深度神经网络如何决策,我们使用深度神经网络去训练一个决策树以模仿神经网络发现的「输入-输出「函数,但是是以一种完全不同的方式工作。如果存在大量的无标签数据,该神经网络可以创建一个大得多的标记数据集去训练一个决策树,从而克服决策树的统计低效问题。即使无标签数据是不可用的,或许可以使用生成式建模中的最新研究进展(Goodfellow et al., 2014, Kingma and Welling, 2013)以从一个类似于数据分布的分布中生成合成无标签数据。即使没有使用无标签数据,仍然有可能通过使用一种称为蒸馏法(distillation,Hinton et al., 2015, Buciluˇa et al., 2006)的技术和一种执行软决策的决策树,将神经网络的泛化能力迁移到决策树上。

在测试过程中,我们使用决策树作为我们的模型。该模型的性能可能会略微低于神经网络,但速度快得多,并且该模型的决策是可解释的。

为了简单起见,我们从一类特殊的决策树开始讨论,使深度神经网络的知识能更容易地被提取/蒸馏然后导入决策树中。

2 专家的层次化混合

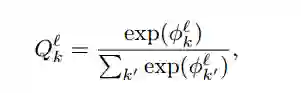

我们使用小批量梯度下降法训练软二元决策树,其中每一个内部节点(inner node)i 有一个学习到的过滤器 w_i 和一个偏置 b_i,每一个叶节点(leaf node)l 有一个学习到的分布 Q_l。在每一个内部节点处,选择最右边的分支的概率为:

其中 x 是模型的输入,σ是 sigmoid logistic 函数。

这个模型是专家的层次化混合(hierarchical mixture of experts,Jordan and Jacobs, 1994),但每个专家实际上都是一个「偏执者(bigot)」,即在训练之后,无论输入是什么都会生成相同的分布。该模型学习到了一个过滤器的分层体系,用于为每个样本分配一个特定的专家以及相关的特定路径概率,并且每个偏执者都学习到了一个简单的、静态的关于所有可能输出类 k 的分布。

其中 Q^l. 表示在第 l 叶的概率分布,Φ^l. 是第 l 叶的学习参数。

图 1:这个示意图展示了一个有单个内部节点和两个叶节点的软二元决策树。

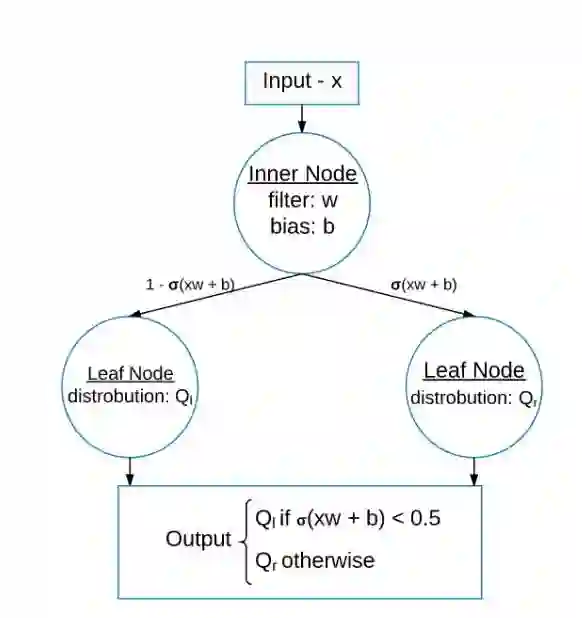

图 2:一个在 MNIST 上训练的 4 层软决策树的可视化。

内部节点中的图像是学习到的过滤器,叶节点中的图像是学习到的类概率分布的可视化。图中标注了每一叶的最终的最大可能分类,以及每一个边的可能分类。以最右边的内部节点为例,可以看到在决策树的当前层次下可能的分类只有 3 和 8,因此该学习到的卷积核只需要简单地学习区分这两个数字就可以了。

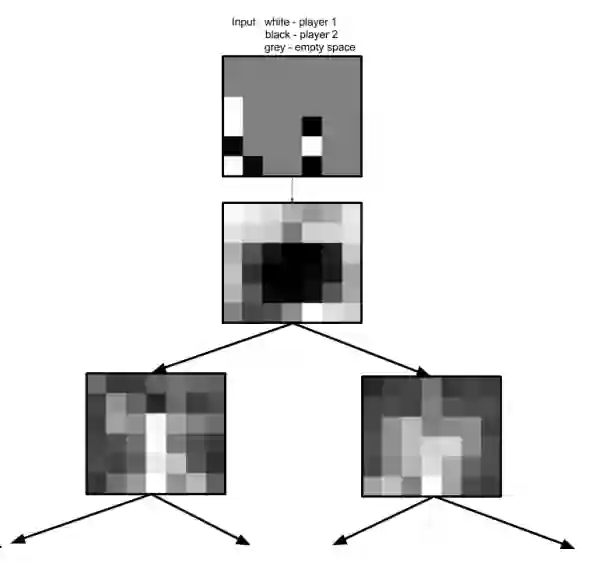

图 3:在 Connect4 数据集上训练的软决策树前 2 层的可视化示例。

通过检查已学习的过滤器,我们可以看到游戏可以分为两种截然不同的子类型:一种是玩家将棋子放在棋盘的边缘,另一种是玩家将棋子放在棋盘中央。

论文:Distilling a Neural Network Into a Soft Decision Tree

论文地址:https://arxiv.org/abs/1711.09784

摘要:深度神经网络已经在分类任务上证明了其有效性;当输入数据是高维度,输入与输出之间的关系很复杂,已标注的训练实例数量较大时,深度神经网络的表现更为突出。由于它们对分布式层级表征的依赖,很难解释为什么一个已学习的网络能够在特定的测试中做出特定的分类决策。如果我们能够获取神经网络习得的知识,并借助依赖于层级决策的模型表达出来,那么解释一个特定的决策将会容易很多。我们描述了一种使用已训练的神经网络创建软决策树的方法,它比直接从训练数据中学习的决策树有着更优的泛化能力。

本文为机器之心编译,转载请联系本公众号获得授权。

✄------------------------------------------------

加入机器之心(全职记者/实习生):hr@jiqizhixin.com

投稿或寻求报道:content@jiqizhixin.com

广告&商务合作:bd@jiqizhixin.com

点击「阅读原文」,在 PaperWeekly 参与对此论文的讨论。