回顾60多种transformer研究,一文总结遥感领域最新进展

机器之心报道

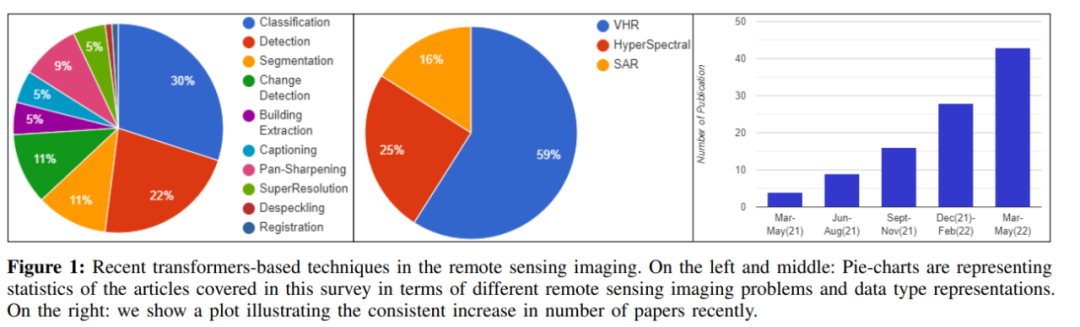

过去十年,基于深度学习的算法在遥感图像分析中得到广泛应用。最初引入到 NLP 领域的 transformer 已经渗透到计算机视觉领域。遥感社区也是如此,他们见证了视觉 transformer 用于各种任务的增加。不过,到目前为止许多调查都集中在计算机视觉中的 transformer,而关于遥感方面的调查却很少。本文系统回顾了遥感中使用基于 transformer 的最新进展,多达 60 多种方法,这些方法可用于解决遥感子领域中不同的遥感问题:超高分辨率 (VHR)、高光谱 (HSI) 和合成孔径雷达 (SAR) 图像。

遥感成像技术在过去几十年取得显着进步。现代机载传感器在空间、光谱和分辨率上的不断提升,已经能覆盖地球表面大部分范围,因此遥感技术在生态学、环境科学、土壤科学、水污染、冰川学、土地测量和分析等众多研究领域发挥着至关重要的作用。由于遥感数据通常是多模态的、位于地理空间(地理定位)中,并且尺度通常是全球范围、数据规模也在不断增长等等,这些特性都为遥感成像的自动分析带来独特的挑战。

计算机视觉的许多领域中,如对象识别、检测和分割等等,深度学习尤其是卷积神经网络 (CNN) 已经是主流。卷积神经网络通常将 RGB 图像作为输入并执行一系列卷积、局部归一化和池化操作。CNN 通常依赖于大量的训练数据,然后将生成的预训练模型用作各种下游应用的通用特征提取器。基于深度学习的计算机视觉技术的成功也启发了遥感界,并且在许多遥感任务中取得重大进展,如高光谱图像分类、变化检测和超高分辨率卫星实例分割。

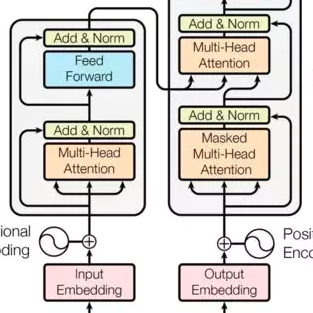

CNN 主要基础之一是卷积运算,它捕捉输入图像中元素(如轮廓和边缘信息)之间的局部交互。CNN 对空间连通性和平移等效性等偏差进行编码,这些特征有助于构建通用高效的架构。CNN 中的局部感受野限制了对图像中的远距离依赖关系(如远距离部分间的关系)的建模。卷积是与内容无关的,因为卷积滤波器的权重是固定的,无论其性质如何,都将相同的权重应用于所有输入。视觉 transfomer (ViTs) 在计算机视觉的各种任务中展示了令人印象深刻的性能。ViT 基于 self-attention 机制,通过学习序列元素之间的关系有效地捕捉全局交互。最近的研究表明,ViT 具有依赖于内容的远程交互建模能力,并且可以灵活地调整其感受野以对抗数据中的干扰并学习有效的特征表示。因此,ViT 及其变体已成功用于许多计算机视觉任务,包括分类、检测和分割。

ViT 在计算机视觉领域的成功,遥感分析中使用基于 transformer 框架的的任务显着增长(见图 1),像超高分辨率图像分类、变化检测、全色锐化 ,建筑物检测和图像字幕都有 transformer 的身影。这开启遥感分析的新纪元,研究者采用各种不同的方法,如利用 ImageNet 预训练或使用视觉 transformer 执行遥感预训练。

类似地,相关文献中也有基于纯 transformer 设计或利用基于 transformer 和 CNN 的混合方法的方法。由于针对不同遥感问题的基于 transformer 的方法的迅速涌现,跟上最新的进展变得越来越具有挑战性。

在文章中,作者回顾遥感分析领域取得的进展,并介绍在遥感领域中流行的基于 transformer 的方法,文章主要贡献如下:

对基于 transformer 的模型在遥感成像中的应用进行整体概述,并且作者是第一个对遥感分析中使用 transformer 进行调研的,弥合了计算机视觉和遥感在这个快速发展和受欢迎的领域的最新进展之间的差距。

对 CNN 和 Transformer 进行概述,讨论它们各自的优缺点。

回顾文献中 60 多种基于 transformer 的研究工作,讨论遥感领域的最新进展。

探讨遥感分析中 transformer 的不同挑战和研究方向。

文章的其余部分安排:第 2 节讨论有关遥感成像的其他相关调研;第 3 节概述遥感中不同的成像模式;第 4 节简要概述 CNN 和视觉 transformer;第 5 节回顾超高分辨率 (VHR) 成像;第 6 节介绍高光谱图像分析;第 7 节介绍合成孔径雷达(SAR)中基于 transformer 的方法进展;第 8 节讨论未来研究方向。

更多细节请参考原论文。

论文链接:https://arxiv.org/pdf/2209.01206.pdf

GitHub 地址:https://github.com/VIROBO-15/Transformer-in-Remote-Sensing

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com