ICDE 2022 | 时空间隔感知的序列POI推荐

©PaperWeekly 原创 · 作者 | Andrew

单位 | 吉林大学

研究方向 | 数据挖掘,推荐系统

论文标题:

Spatial-Temporal Interval Aware Sequential POI Recommendation

ICDE 2022(吉林大学,西北工业大学)

https://ieeexplore.ieee.org/document/9835452

https://github.com/jiangyiheng1/STiSAN.pytorch

引言

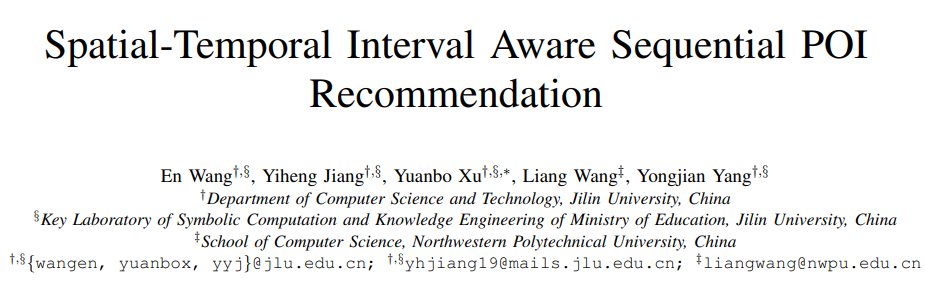

如图所示,如果一个序列模型在建模时仅考虑 POI 和空间信息,则 Fig. 1 中 user 1,user 2 的历史序列在隐空间中的表示会高度相似,并导致有偏差的推荐结果。

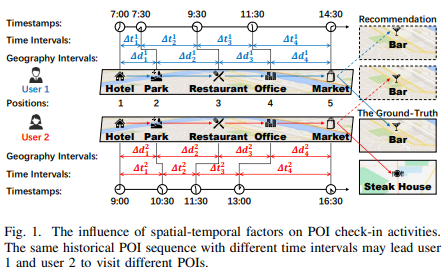

如 Fig. 2 中所示,具有强空间相关性的 POI 在历史序列的短期 check-in 和长期 check-in 中均有分布。但是由于上述 SAN 本身的结构特性,其无法充分考虑这些 POI 之间的空间相关性,并由此导致推荐精度受限。

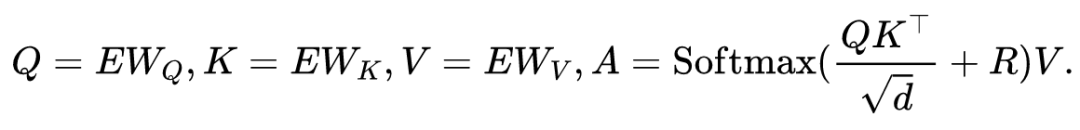

本文针对上述序列中时间间隔表示和序列局部空间信息建模不足的问题,分别提出了两个无需额外参数和高额计算负担的方法,时间感知位置编码器(Time Aware Position Encoder,TAPE)和间隔感知注意力模块(Interval Aware Attention Block,IAAB)。

本文将 TAPE 和 IAA 应用于自注意力网络(SAN),提出了一个端到端的时空间隔感知的序列 POI 推荐模型 STiSAN,以此来实现细粒度的偏好建模以及提供可解释的推荐结果。

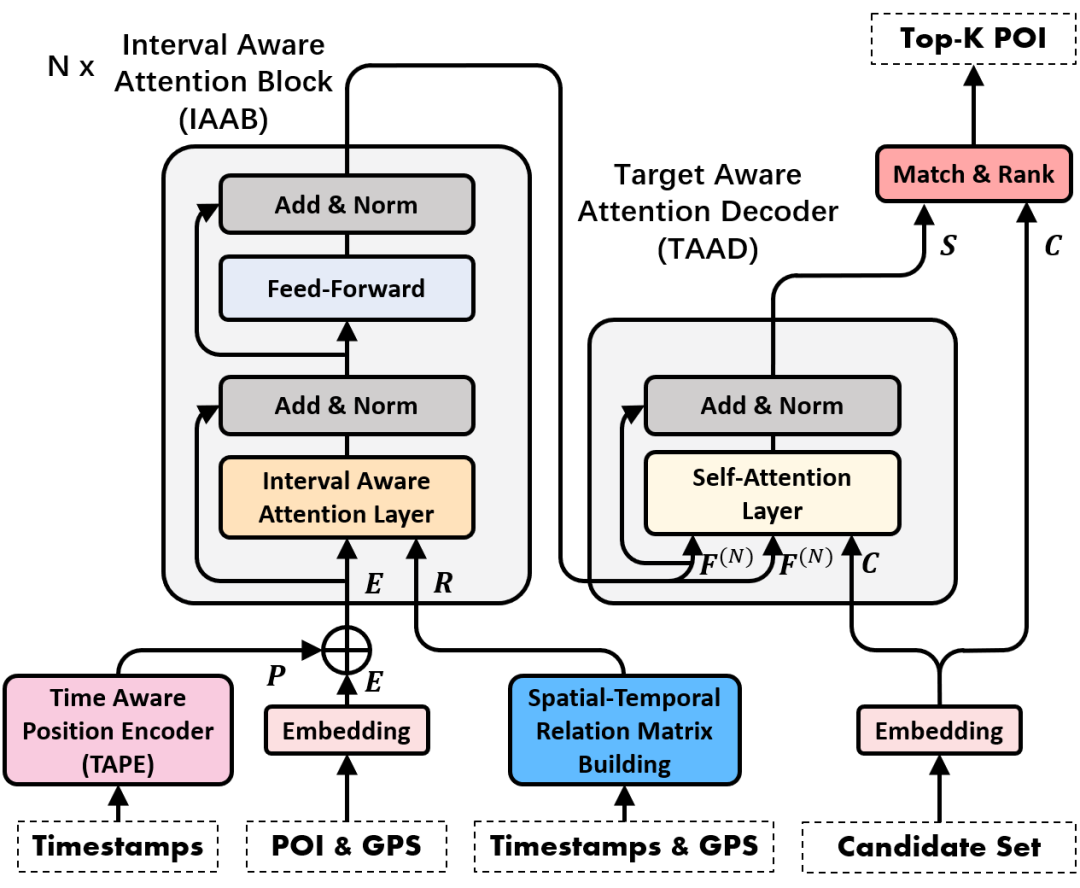

本文在 3 个公开 LBSN 数据集和 1 个真实世界城市交通数据集上进行了大量实验,结果表明 STiSAN 相较于多个 SOTA 模型可以取得 13.01% 的推荐精度提升。消融实验,指标评估以及可视化实验分别验证了 TAPE 和 IAAB 的有效性、可拓展性、可解释性。

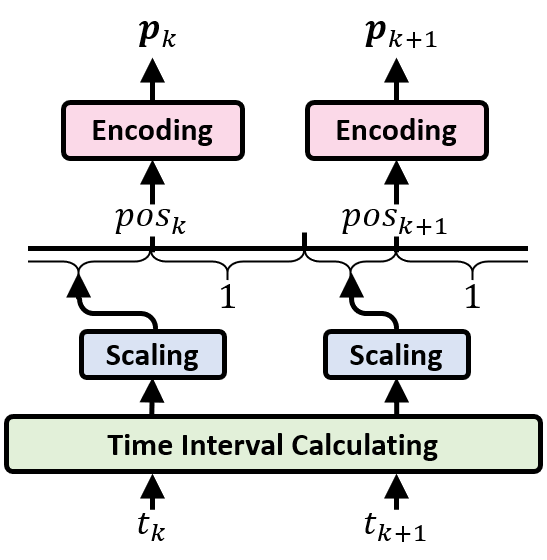

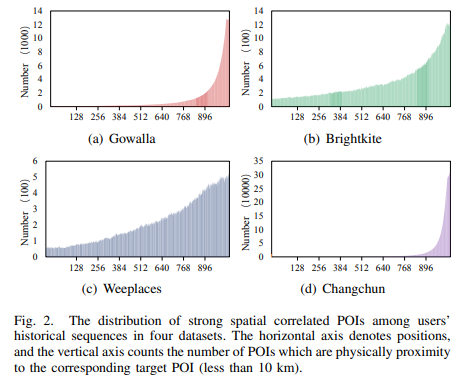

2.1 时间感知位置编码器(Time Aware Position Encoder, TAPE)

class TimeAwarePE(nn.Module):

def __init__(self, d)

super(TimeAwarePE, self).__init__()

self.div_term = torch.exp(torch.arange(d, 2)*-(math.log(10000.0)/d))

def forward(self, x, t):

# x:[n, d], t:[n]

t_ = torch.clone(t)

t_[1:] = t[:-1]

delta_t = t - t_

delta_t /= torch.sum(delta_t)/(x.size(0)-1)

pos = torch.zeros_like(t)

pos[0] = 1.0

for k in range(1, x.size(1)):

pos[k] = pos[k-1] + delta_t[k] + 1

tape = torch.zeros_like(x)

tape[:, 0::2] = torch.sin(pos * self.div_term)

tape[:, 1::2] = torch.cos(pos * self.div_term)

return x + tape

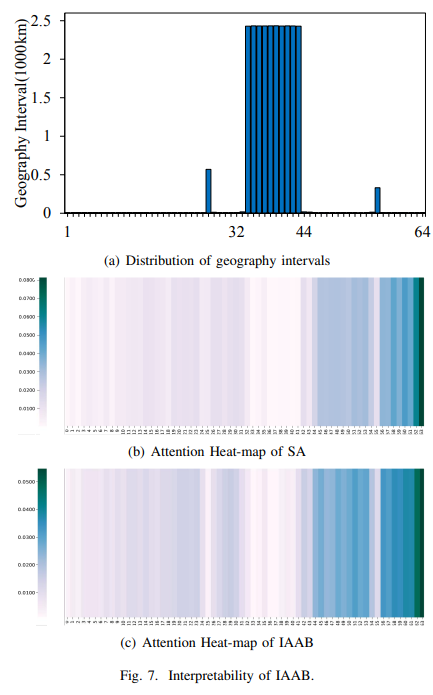

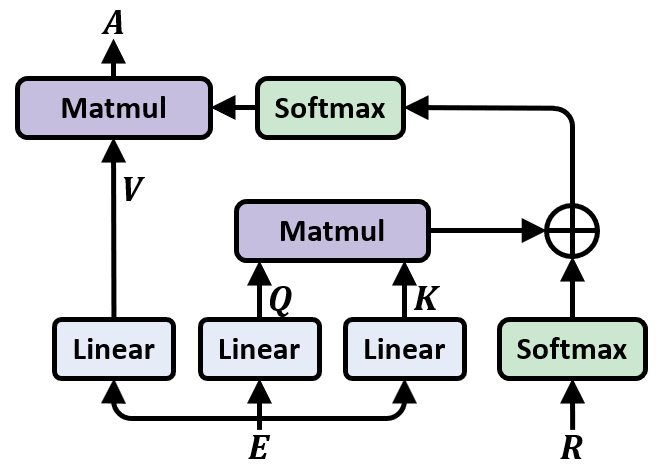

2.2 间隔感知注意力模块(Interval Aware Attention Block, IAAB)

class InrAttn(nn.Module):

def __init__(self, dropout):

super(InrAttn, self).__init__()

self.dropout = nn.Dropout(dropout)

def forward(self, query, key, value, r_mat, mask):

# query, key, value:[n, d], r_mat:[n, n]

# mask: [n, n] where up triangle elements are zeros

r_mat = F.softmax(r_mat, dim=-1)

attn_scores = torch.matmul(query, key.transpose(0, 1))/math.sqrt(query.size(-1))

attn_scores += r_mat

attn_scores = attn_scores.masked_fill(mask == 0, -1e9)

probs = F.softmax(attn_scores)

probs = self.drop(probs)

return torch.matmul(probs, value)2.3 间隔感知序列POI推荐模型STiSAN

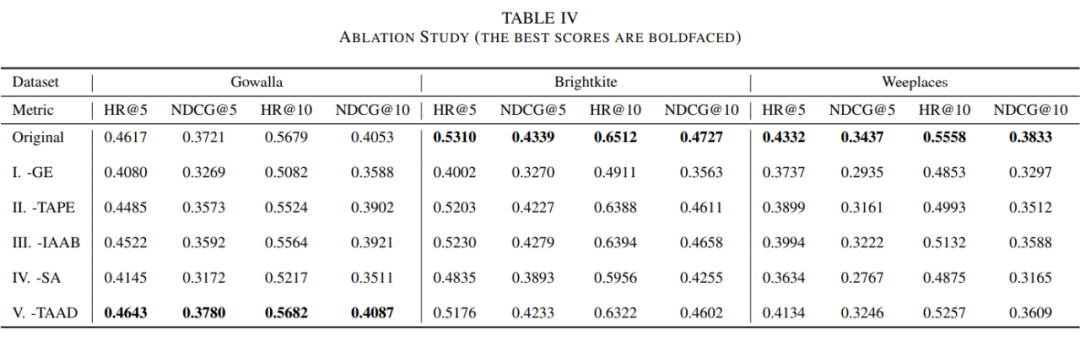

3.2 消融实验

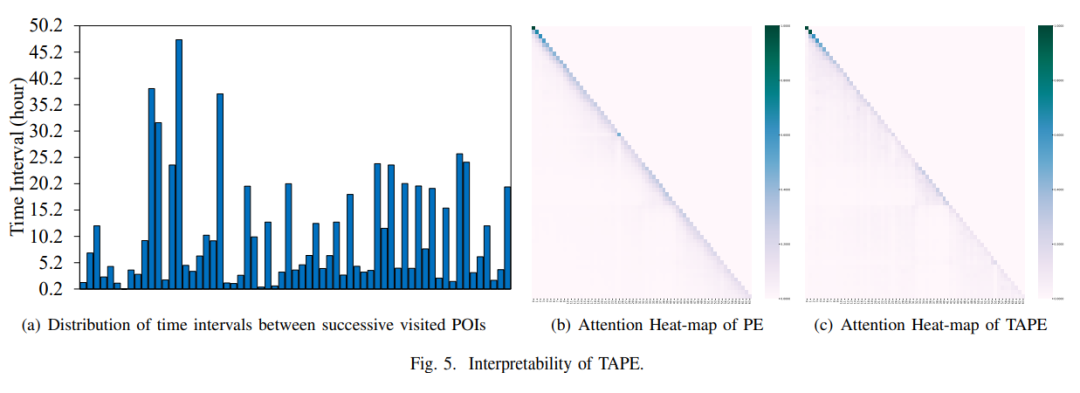

3.3 TAPE的可拓展性以及可解释性分析

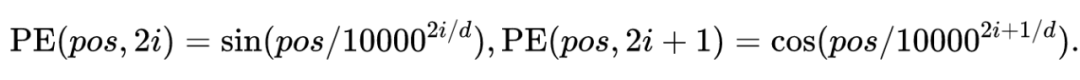

将 TAPE 拓展至基本的 SAN,可以为其带来平均 5.36%HR@10 的性能提升。

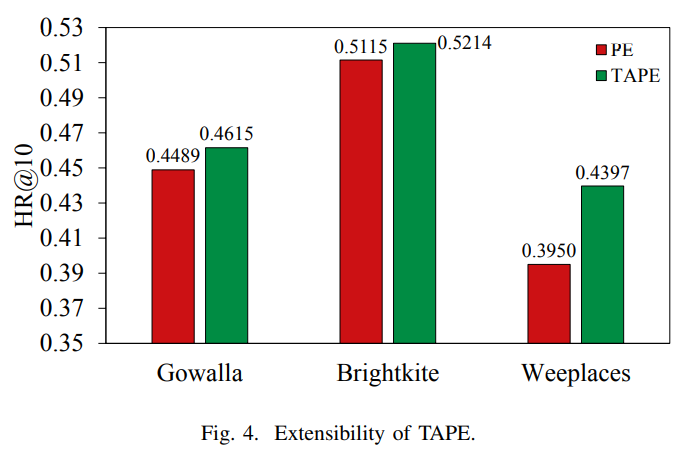

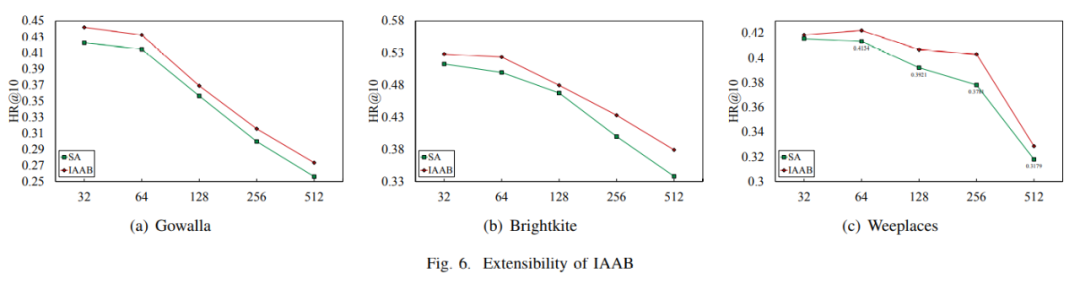

3.4 IAAB的可拓展性以及可解释性分析

更多阅读

#投 稿 通 道#

让你的文字被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学术热点剖析、科研心得或竞赛经验讲解等。我们的目的只有一个,让知识真正流动起来。

📝 稿件基本要求:

• 文章确系个人原创作品,未曾在公开渠道发表,如为其他平台已发表或待发表的文章,请明确标注

• 稿件建议以 markdown 格式撰写,文中配图以附件形式发送,要求图片清晰,无版权问题

• PaperWeekly 尊重原作者署名权,并将为每篇被采纳的原创首发稿件,提供业内具有竞争力稿酬,具体依据文章阅读量和文章质量阶梯制结算

📬 投稿通道:

• 投稿邮箱:hr@paperweekly.site

• 来稿请备注即时联系方式(微信),以便我们在稿件选用的第一时间联系作者

• 您也可以直接添加小编微信(pwbot02)快速投稿,备注:姓名-投稿

△长按添加PaperWeekly小编

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」