【CMU与FAIR】联合发布非局部神经网络,有效提升视频分类、对象分割、姿态估计结果

图:pixabay

原文来源:arxiv

作者:Xiaolong Wang、Ross Girshick、Abhinav Gupta1、Kaiming He

「雷克世界」编译:嗯~阿童木呀

通常来说,卷积和循环操作都是能够一次性处理一个局部邻域的构建快。在本文中,我们提出将非局部操作作为捕获长距离依赖(long-distance dependencies)的通用系列构建块。受计算机视觉中的经典非局部均值方法的启发,我们的非局部操作计算一个位置的响应以此作为全部位置处特征的加权和。这个构建模块可以插入到许多计算机视觉体系结构中。在视频分类的任务上,即使没有任何附加修饰,我们的非局部模型也可以在Kinetics和Charades数据集上比肩甚至超过当前的竞赛获胜者。在静态图像识别中,我们的非局部模型改进了目标检测/分割任务中的性能表现,并可以对COCO系列任务进行姿态估计。

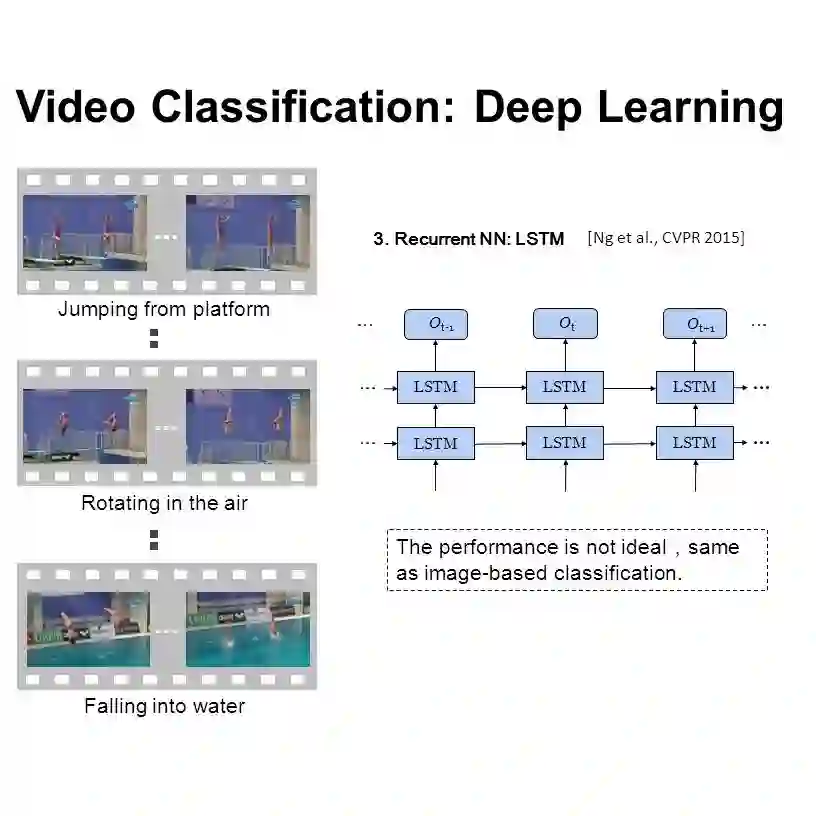

在深度网络中,捕获长距离依赖具有至关重要的作用。对于序列数据(例如存在于语音、语言中的)来说,循环操作是长距离依赖建模的主要解决方案。而对于图像数据来说,长距离依赖是由形成于卷积操作的深度栈中的大型感受野(receptive fields)进行建模的。

无论是在空间还是在时间中,卷积和循环操作都是处理局部邻域的,因此只有在重复应用这些操作,并通过数据不断地传播信号时才能够捕获长距离依赖。一般说来,重复局部操作会存在一些局限性。首先,计算效率低下;其次,将导致产生需要仔细解决应对的优化困难;最后,这些挑战使得产生多跳依赖建模,例如,当消息需要在远距离位置之间来回传送时,这将是一个困难重重的问题。

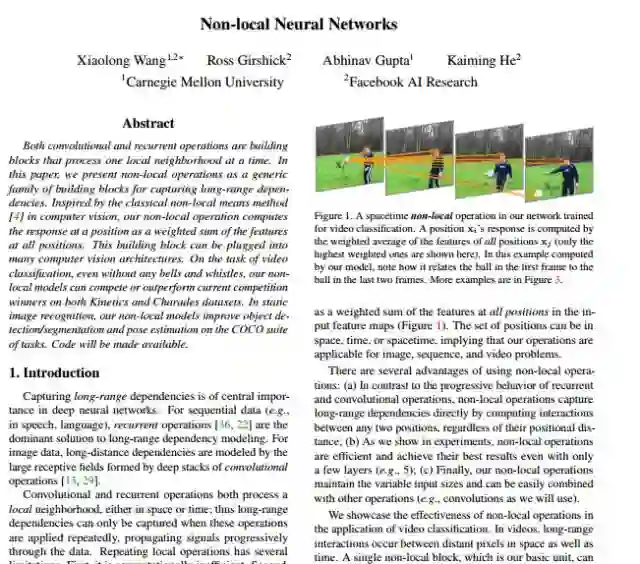

在本文中,我们将非局部操作作为一个高效、简单、通用的组件,用于捕获深度神经网络的长距离依赖。我们提出的非局部操作是计算机视觉中经典的非局部均值操作的泛化。直观地说,非局部操作计算一个位置上的响应,以此作为输入特征映射中所有位置上的特征的加权和(如图1所示)。这些位置可以是在空间、时间或时空中,而这意味着我们的操作可以适用于图像、序列和视频问题。

在我们的网络中,一个时空非局部操作被训练用以进行视频分类。位置xi的响应由所有位置xj的特征的加权平均值进行计算(这里仅显示的是最高的加权值)。在这个由我们的模型进行计算的示例中,注意它是如何将第一个坐标系中的球与后两个坐标系中的球联系起来的。

使用非局部操作具有几个优势:(a)相较于循环和卷积操作的渐进行为,非局部操作直接通过计算任意两个位置之间的交互捕获长距离依赖,而不管它们的位置距离如何;(b)正如我们在实验中所展示的那样,非局部操作较为高效,即使只有很少几层也能达到最好的效果;(c)最后,我们的非局部操作保持变量输入的大小,并且可以很容易地与其他操作(例如,我们将要使用的卷积)相结合。

在视频分类应用中,我们展示了非局部操作的有效性。在视频中,长距离交互发生在遥远的空间和时间中的像素之间。一个单一的非局部块,即我们的基本单元,可以直接以前馈方式捕获这些时空依赖关系。得益于这些非局部块,我们的非局部神经网络的结构要比2D和3D卷积网络(包括变体)更为准确地进行视频分类。另外,非局部神经网络在计算上比3D卷积系列经济上更划算。我们在Kinetics和Charades数据集上进行了全面的消融研究,我们的方法仅使用RGB模式而没有任何其他修饰(例如,光流、多尺度测试),与两个数据集上的最新竞赛获胜者相比,我们的方法所获得的结果可以与其比肩或甚至更好。

为了证明非局部操作的通用性,我们进一步提出了目标检测/分割,并在COCO数据集上进姿态估计实验。在强掩码R-CNN基线的基础上,我们的非局部块可以以较小的附加计算成本提高所有三个任务的准确性。结合在视频分类任务中的证据,这些图像实验表明,非局部操作通常是有用的,并且可以成为设计深度神经网络的基本构建块。

相关研究

非局部图像处理,非局部均值是一种经典的过滤算法,能够计算图像中所有像素的加权平均值。它使得远距离像素在一个基于补丁外观相似性的位置贡献过滤响应。这种非局部过滤的想法后来发展成为BM3D(块匹配3D),它对一组类似的,但非局部的补丁执行过滤操作。与深度神经网络相比,BM3D是一个固体图像去噪基线。此外,非局部匹配也是成功的纹理合成(texture synthesis)、超分辨率和修复算法的本质所在。

图形模型,长距离依赖可以通过诸如条件随机场(conditional random fields)这样的图形模型进行建模。在深度神经网络的上下文中,CRF可以被利用来对网络的语义分割预测进行后置处理。CRF的迭代平均场推理可以转化为循环网络并得到训练。相比之下,我们的方法是一个简单的前馈块,用于计算非局部过滤。与那些开发用于分割的方法相比,我们的通用组件常被应用于分类和检测。而这些方法以及我们的方法也都与一个更为抽象的图形神经网络模型具有莫大关联。

用于序列前馈建模,最近出现了这样一种趋势,使用前馈(即非循环)网络在语音和语言中进行序列建模。在这些方法中,长距离依赖被深度1D卷积所形成的大型感受野所捕获。这些前馈模型是可以并行化实现的,并比广泛使用的循环模型更加高效。

自注意力(Self-attention),我们的研究与最近用于机器翻译的自注意力方法有关。自注意力模块通过关注所有位置并在嵌入空间中对其进行加权平均来计算序列(例如,句子)中的一个位置处的响应。正如我们将在下面讨论的,自注意力可被视为非局部平均值的一种形式,从这个意义上说,我们的研究将用于机器翻译的自注意力转移到更为通用的非局部过滤操作中,而这些操作可以应用于计算机视觉中的图像和视频问题。

我们提出了一类新的神经网络,通过非局部操作捕获长距离依赖。我们的非局部块可以与任何现有的体系结构相结合。我们展示了非局部建模对于视频分类、目标检测和分割以及姿态估计等任务所具有的重要意义。在所有的任务上,非局部块的简单添加便能提供比基线更好的性能改进。我们希望非局部层能够成为未来网络架构的重要组成部分。

点击原文阅读更多

☞ 【最详尽的GAN介绍】王飞跃等:生成式对抗网络 GAN 的研究进展与展望

☞ 【智能自动化学科前沿讲习班第1期】王飞跃教授:生成式对抗网络GAN的研究进展与展望

☞ 【智能自动化学科前沿讲习班第1期】王坤峰副研究员:GAN与平行视觉

☞ 【重磅】平行将成为一种常态:从SimGAN获得CVPR 2017最佳论文奖说起

☞ . 【最新前沿】Facebook何恺明等大神最新论文提出非局部神经网络(Non-local Neural Networks)

☞ 【Ian Goodfellow盛赞】一个GAN生成ImageNet全部1000类物体