如何通过AI自动辨别虚假新闻?计算机科学家Filippo Menczer教你识别互联网虚假信息

【导读】淘宝购物节“双11”已经过去一个多月了,购物过后伙伴们是否也收到自己心仪的商品?狂欢过后,究竟是“买家秀和卖家秀”还是“买到就是赚到”,想必每个购物者都有了自己的见解。

不可否认,网上商城中不乏“物美价廉,货真价实”的商品,但作为网购老手的你,是否曾怀疑网上商城的商品评论区域弥漫着很多的虚假评论信息(要知道评论信息对于商品的销量有多大的影响,难保不会有一些网络“水军”)。就拿美国最大的电子商务公司“亚马逊”来说,亚马逊的虚假评论的问题也越来越为人所知并颇受诟病!

亚马逊评论中的虚假信息问题,参见http://www.brianbien.com/amazons-fake-review-problem/.

很多人从亚马逊购买商品的一个原因是:它有大量的评论可供参考。但是,如果亚马逊的许多热销产品都有虚假的评论,那该怎么办呢?

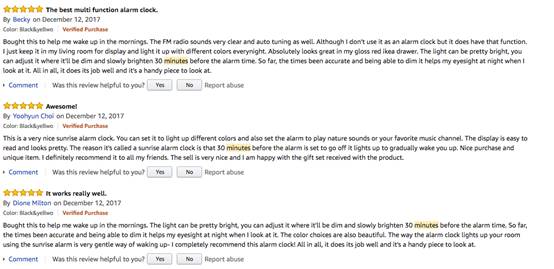

我们来看一个例子:今天早上,我在寻找一个闹钟,并开始在许多评论中搜索,用“分钟”过滤那些评论,因为我想了解这个产品的定时器功能。结果出现了一堆相似的评论:

我们可以看到其中的评论:

“The light can be pretty bright, you can adjust itwhere it’ll be dim and slowly brighten 30 minutes before the alarm time.”——可以很亮,你可以调整它的亮度,让它变暗,在闹铃的30分钟前会慢慢亮起来。

“Becky”和“Dione Milton”两人真的都写了一篇同样的长度的评论吗? 或者更有可能的是,他们只是从一个脚本中得到评论,然后进行草率地粘贴评论(因为他们或许受某种驱使,被要求这样做)。

拥有世界上最先进的ML技术的亚马逊,确实需要加强它对虚假评论的审查力度。想象一下,如果我们能相信它的评论,亚马逊的购物体验会有多棒。像Fakespot这样的第三方评论网站会为我们找出问题并提出相应的解决方法:在这种情况下,产品得到了“F”级。

毫无疑问,这当然不是一个“个别案例”!网络购物评论信息只是网络信息的一个雏形,我们每天都从互联网上浏览信息、广告、发布会、医院简介等等信息,我们有意无意地将这些信息作为我们消费、判断的标准。试想一下,如果你所获取的信息都是虚假的,或者是大部分虚假的,那么你内心世界的判断标准是否会就此崩塌?

社交媒体的迅速发展,为虚假新闻的传播提供了载体,一些不怀好意的传播者,甚至会利用社交媒体传播政治谣言。为此科技的发展能够制止这一切,提供解决方案吗?在Twitter上会有许多恶意的‘机器人’账户,这些账户像是僵尸工具一样自动散布转发一些虚假消息。为此计算机科学家Filippo Menczer以及他的团队开发了一个系统,用来追踪鉴定这些Twitter上的僵尸账户。这项技术也被用在Twitter和Facebook上的推荐系统。除了揭露假的新闻和内容,还需要做的是从文化层面帮助用户评估他们所看到的内容,帮用户区分垃圾信息和有用信息,提供用户甄别真假信息的能力。

▌正文

虚假的新闻信息借助社交媒体病毒式传播,并影响了数以百万计的人。科学和技术可以说明这种现象的原因和方法。但是他们能提供解决方案吗?

背景

2010年,计算机科学家Filippo Menczer在一次会议中听到虚假消息在马萨诸塞州的一次特别参议员选举中肆意传播。“我感到很震惊!” Menczer说。从2005年开始,他和他的团队在印第安那大学布卢明顿分校一直在追踪垃圾邮件的早期形式,主要关注当时新的社交书签网站,如https://del.icio.us/。“我们称之为社交垃圾邮件,”他说。“人们正在创建带有垃圾信息的社交网站,并从其广告中获利。”但是毫无根据的假新闻是不存在的,他仍记得他对自己说,“这肯定不是一个孤立的事件。”当然,事实证明了这一点。到2014年,Menczer和其他社交媒体观察人士看到的不仅仅是假的政治头条,还有关于携带埃博拉病毒的移民的恐怖故事。他认为:“一些政治家想要关闭机场,这大多是源于这些虚假消息造成的恐慌导致的。”

图一:捏造的社交媒体帖子吸引了数百万用户分享挑衅性的谎言。Dave Cutler(艺术家)提供的图片。

在2016年的美国总统大选中,虚假新闻海啸式地猛增。社交垃圾邮件已经演变成“政治谣言”:捏造赚钱的帖子,诱使数百万Facebook,Twitter和YouTube用户分享这些带有挑衅的谎言 - 其中不乏头条新闻声称民主党候选人希拉里•克林顿曾经向伊斯兰国家出售过武器, 弗朗西斯支持共和党候选人唐纳德•特朗普以及(同一天同一来源)教皇支持克林顿这样的政治谣言。

虚假故事和广告旨在破坏大众对美国机构的信任,尤其是在选举方面。而这一切都是通过一个更大的网络传播开来的,这些网络散布了党派间的互相的攻击的消息,并且这些消息完全不考虑事实依据以及编辑校对。 “我把它称为错误的信息生态系统,”马萨诸塞州北安多弗梅里马克学院的媒体学者梅利莎•齐姆达斯(MelissaZimdars)这样说。

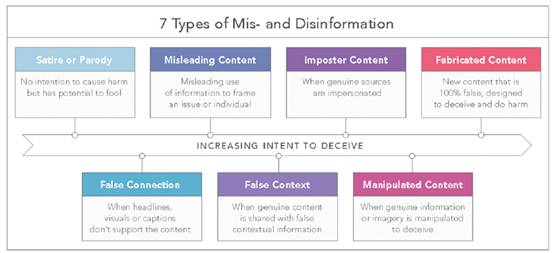

图二:2016年美国总统大选之后,“Fake news(假新闻)”成了常见的说法。但许多研究人员和观察人士认为,这一术语的承载能力和使用程度都很低。不仅美国总统唐纳德·特朗普(Donald Trump)将“假新闻”这个词作为表达他不喜欢的任何报道的内容,而且“这个词实际上并不能解释信息生态系统,”一个名为First Draft的国际组织的研究主管克莱尔·沃德尔(Claire Wardle)说。今年2月,她发表了一份分析报告,找出了表达错误信息的另外六种说法,其中没有一种字面上带有“假的”含义。

把它称为错误信息,假新闻,垃圾新闻或故意的欺骗之类,其实自从第一个人向别人耳语散布恶意的八卦之后,这些东西就已经出现了。但是,如今人们传播消息可以通过上传,评论,点赞和分享这些方式,人们可以肆意滥用这些方式方法,这为散布谣言创造了一个几乎理想的环境。哈佛大学伯克曼克莱恩互联网与社会研究中心的联合主编尤克•本克勒(YochaiBenkler)说,“如果每个人心中都有他们自己所认定的事实,那人们之间将不再有理性的分歧和有效的妥协了,这将会场‘对于谁来决定什么是真相’的权利之争”。

AI技术解决方案

问题虽然很明朗,但是解决方案就不那么简单了。 即使今天的人工智能(AI)算法足够智能可以百分之百地过滤掉明显的谎言,那也是不能够的,因为这些谎言通常是旁观者能看得出来的。这些平台应该如何在宪法上保护言论自由,并决定什么是不能接受的呢?麻省理工学院市民媒体中心的记者兼博主Ethan Zuckerman说,他们不能这样做。 这将是一个灾难尝试。阻止这些东西会给予它们更多的权力。

因此,这些平台正在尝试各种他们能够想到的方法:调整算法,使那些不被信任的网站报道的新闻排名靠后,对于每个新闻故事更多地进行事实核查以验证准确性,发布一些甄别虚假消息的教学视频,这样用户可以自己初步辨别信息。亚利桑那州坦佩亚利桑那州立大学奈特数字媒体创业中心的技术作家丹•吉尔摩(Dan Gillmor)说:“这些都不是容易的事情,但是各大平台以及信息传播学者可以考虑尝试这些方法。”

在2010,Menczer和他的同事们开始抓住潜在的问题,他们开发一个系统,这个系统可以整理并分析每天在Twitter上面发送的推文,从中寻找一种通用的模式。之后这个系统被称为Truthy,它会跟踪#gop和#obama等等这样的主题标签作为主题词,并且跟踪用户名,比如@johnmccain这样的用户名会被跟踪并且会跟踪一段时间以追踪他后续所发的推文以及在Twitter上的互动。

这个系统还包括简单的机器学习算法,试图区分某条病毒信息是真实用户发出的推文还是软件机器人(比如:bots)自动推动的假消息。Menczer说,对于每个Twitter账户,算法都跟踪了成千上万条的特征属性,包括追随者的数量,帐户关联的内容,账户存在的时间长短以及发送推文的频率。这些特征都逐一被检索到了。但总的来说,通过对已知的机器人账户特征的比较和分析,他们让算法在识别这类机器人账户上有一定的优势。 系统显示,这些‘机器人’账户(僵尸工具)加入合法的在线社区,通过点赞和转发来提升某个特定主题的名次,提升或者攻击候选人以及创造假的粉丝。一些‘机器人’账户都被Truthy系统甄别出来了,随后被Twitter关闭了。

印第安那小组最终将Truthy系统付诸于实践,应用到社交媒体上:生成了一套程序,如Botometer,一个用来测量Twitter中‘机器人’用户和真正用户行为相似度的工具,以及一个叫做Hoaxy的工具用来可视化事件的传播以及真实性检查。

社交平台诸如Facebook和Twitter也都提出了希望利用人工智能(AI)技术来解决垃圾邮件问题,以及错误信息的推送和分享。他们都做了各自的努力,例如,在大选一周后,Facebook和谷歌都宣布不再允许公然虚假的新闻网站在他们的平台上通过网络广告赚钱。然后在2017年5月,Facebook宣布将提供消息帖子的低质量信息排名。那么新闻传送算法应该如何识别什么是“低质量”呢?Menczer说,原则上,这些平台可以(也可能是)使用印第安纳小组在Truthy系统中使用的相同类型的机器学习技术来筛选帖子的内容。

培养个人辨别真伪的能力

除了揭露和鉴别假的新闻和内容,还需要做的是从文化层面帮助用户评估他们所看到的内容,帮助人们成为更精明的媒体消费者,从而降低对可疑消息的需求。然而,这种媒体素养不是那么容易培养,这是一种了解媒体如何运作以及如何警惕所有的标准误传的技巧。Menczer认为,平台可以通过在系统中产生一些阻碍来使得分享变得更加困难。 例如,平台可以阻止用户分享文章,直到他们阅读了文章,或者直到他们通过验证码测试以证明他们是合法用户。他说:“这会过滤出大部分垃圾用户以及信息。”

Facebook就一直在把培养新闻素养作为其新闻项目的关键部分,通过为记者提供教育和合作创新新闻产品,加强公司与新闻业的联系。 与此同时,还涌现了许多培养媒体素养的课程,一个广为人知的例子就是华盛顿大学的“胡言乱语”课程(Bullshitcourse),该课程教导学生如何发现那些极具误导性的图形或欺骗性统计数字等陷阱。 同时在意大利,教育部从10月31日开始在8000所高中开展数字扫盲课程,目的是为了帮助学生识别故意欺骗性的新闻。

Rand和Pennycock最近的另一项研究也展示了一些可观的现象。研究人员对他们的研究对象进行了分析性思维的标准测试,即从事实和证据中推理的能力。当研究人员给他们的受试者展示一些实际的新闻标题时,兰德说,“我们发现那些善于分析的人更能辨别出假新闻,即使这与他们现有的信念不相符。”他说,更好的是,无论教育水平或政治面貌如何,这种差异都存在。“如果我们能教会人们更仔细地思考,”兰德在谈到可疑的新闻内容时说,“他们就能更好地分辨出差异。”

参考文献:

http://www.pnas.org/content/114/48/12631.full

http://www.brianbien.com/amazons-fake-review-problem/

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“PANS” 就可以获取 The genuine problem of fake news (假新闻的真正问题) pdf下载~

-END-

专 · 知

人工智能领域主题知识资料查看获取:【专知荟萃】人工智能领域26个主题知识资料全集(入门/进阶/论文/综述/视频/专家等)

同时欢迎各位用户进行专知投稿,详情请点击:

【诚邀】专知诚挚邀请各位专业者加入AI创作者计划!了解使用专知!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请扫一扫如下二维码关注我们的公众号,获取人工智能的专业知识!

请加专知小助手微信(Rancho_Fang),加入专知主题人工智能群交流!

点击“阅读原文”,使用专知!