3天登顶苹果免费榜,“ZAO”作起来会死

8 月 30 日晚,一款名为"ZAO"的 AI 换脸软件在社交媒体刷屏,户只需要一张正脸照就可以将视频中的人物替换为自己的脸。

目前,微信对 ZAO 换脸 App 进行了屏蔽,微信表示存在安全隐患,实际上,面部识别是一项非常重要的安全认证技术,一旦被滥用,后果很严重。

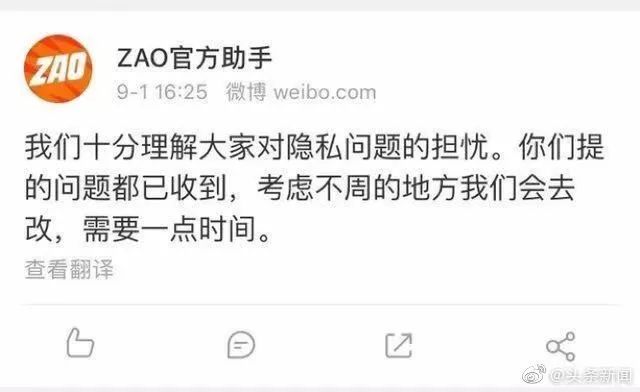

对此,“ZAO”官方微博 9 月 1 日已做出回应称:“我们十分理解大家对隐私问题的担忧。你们提的问题都已收到,考虑不周的地方我们会去改,需要一点时间。”

AI 换脸“ZAO”起来!用户协议细思恐极

该软件介绍称使用 AI 技术,大家只需要在 App 中上传一张照片,就能将自己的脸替换成“小李子”“周润发”“玛丽莲梦露”“绯红女巫”等人的脸。融合效果非常棒,几乎可以以假乱真。

公开资料显示,这款 App于 8 月 11 日开始限量内测,23 日通过苹果商店审核,30 日晚间一夜成名,服务器一度崩溃。

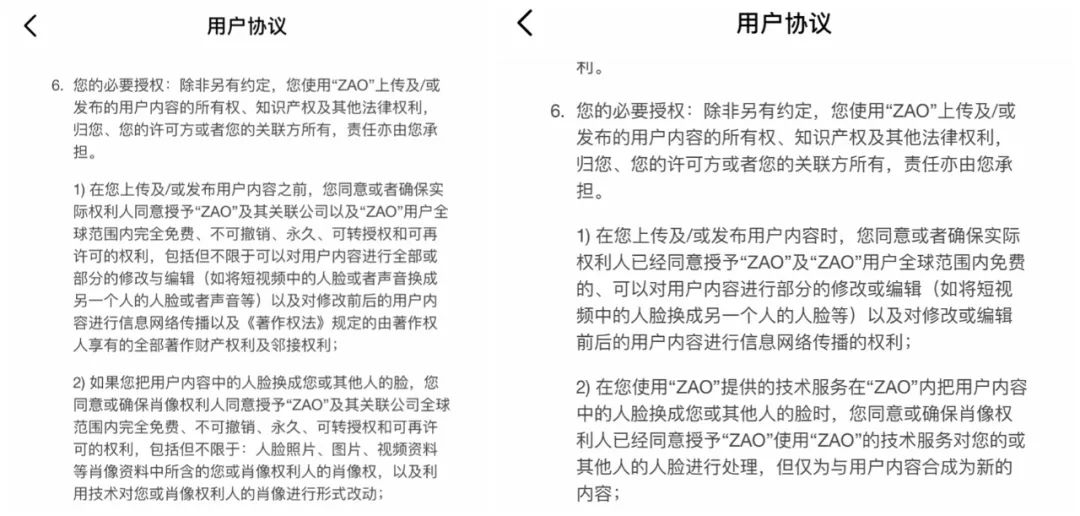

左为引起争议的用户协议,右为新版用户协议

同时,面对换脸是否会产生盗刷的风险,支付宝也第一时间做出回应:

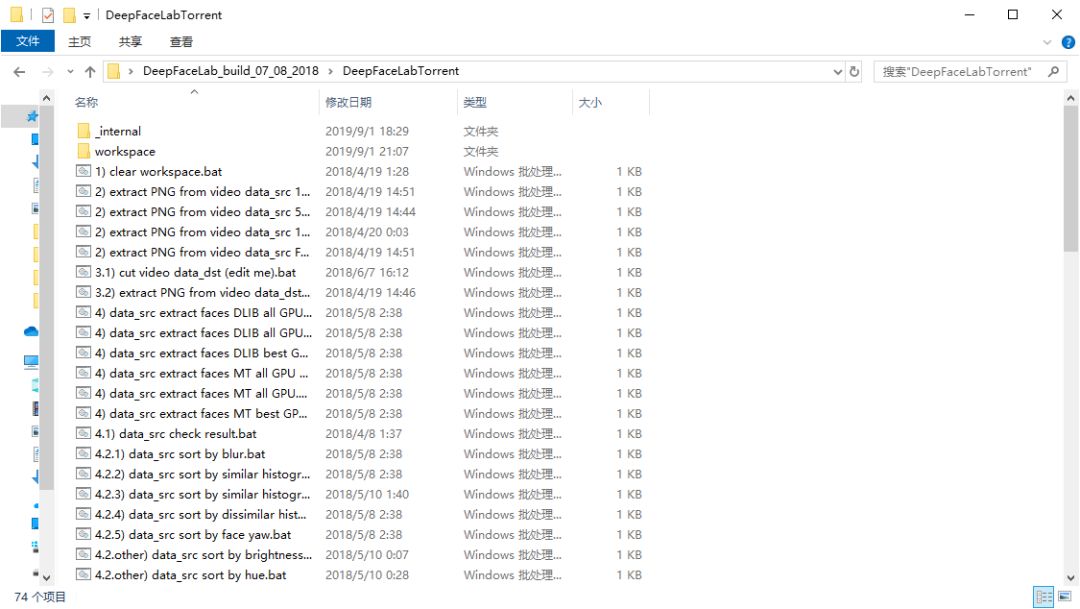

“ZAO”背后究竟是何技术原理?

它能够把照片和视频中的人脸替换成任何想要替换的人脸,且“毫无 PS 痕迹”。

开源后,deepfakes 成了一个公开的软件包,安装简单,菜鸟也能给人“换脸”。

“deepfakes”技术背后是基于人工智能领域的深度学习,通过深度学习技术,任何人只需要一个强大的 GPU 和足够的训练数据就能创作出以假乱真的人脸替换效果。

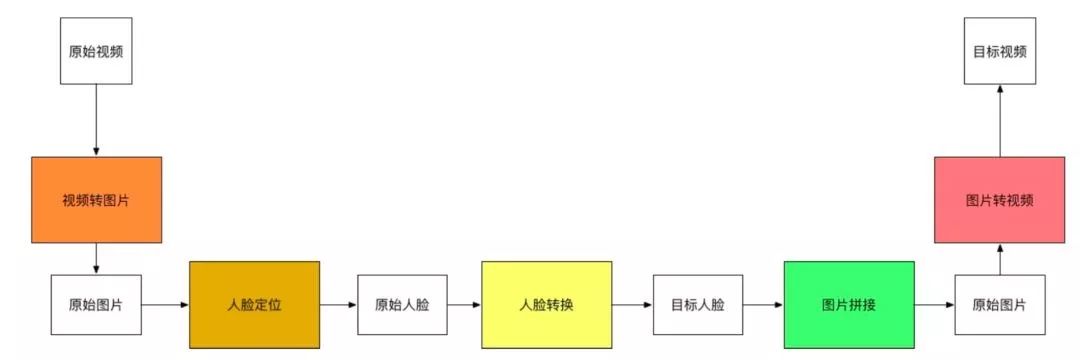

deepfakes 换脸技术基本过程示意图

AI 换脸不同于一般意义上的 P 图,程序找到两个面部之间的共同点,通过搭建神经网络来学习人脸,使替换以后的脸可以生动地模仿原来的表情,以假乱真。如果源素材的质量足够高,面部的转换几乎是天衣无缝的。

网上有妹子表示,要把男友电脑里的小黄片全部换成自己的脸让他无路可走。万万没想到 AI 在搞黄色领域最先进。

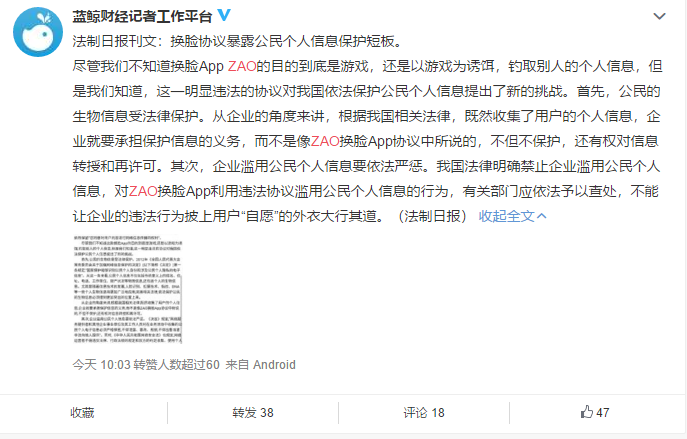

“ZAO”虽被屏蔽:无视用户隐私权值得反思

AI 换脸有风险,使用请谨慎。这款瞬间火爆网络的换脸视频应用,因为在用户“隐私条款”设置上的“大尺度”,反而让质疑声反噬了产品本身的关注度。

尽管目前,用户协议中的相关条款已作出了修正,但事件带来的警示意义不该随着舆论关注的降温而变得“云淡风轻”。

舆论汹汹后,ZAO 用户协议中的“霸道条款”已多有删改和收敛。可如果不是产品大火而引发深度关注,是否意味着这样的“霸道条款”就永久“合理”存在下去?

按理说,尽管当前有关网络用户的隐私保护边界还存有一定的模糊地带,但任何一家企业也不至于对用户隐私保护“无知”到这种地步。

就此而言,这款产品的逻辑或者说背后的盈利模式,恐在一开始就把用户隐私保护丢在了一边。

这些年,媒体也曝光过不少有侵犯用户隐私之嫌的互联网用户协议,但把对用户隐私信息的“觊觎”展现得如此赤裸裸和“底气十足”的恐怕不多见。

一定程度上说,这样的“霸道条款”,其实扮演了测试社会对隐私侵犯的“容忍度”的角色。而从舆论的广泛吐槽、质疑和业内的一致批评来看,答案不言而喻。

其实,对任何新产品来说,有些错误和“测试”本不该一再出现,因为法律规定层面早有“标准答案”。

如《信息安全技术个人信息安全规范》要求,个人信息控制者开展个人信息处理活动时应遵循“最少够用原则”;《网络安全法》也规定,网络运营者收集、使用个人信息,应当遵循合法、正当、必要的原则。

也就是说,在用户隐私保护上心存侥幸,不只是冒犯用户,也是对法律的挑衅。

一般而言,初创公司都会非常注重自己的形象与“合规性”。然而,这家公司的第一步显然迈得“太大”。作为初创公司,如果“第一粒扣子”就系错,未免是对企业前途的“豪赌”。

应该看到,不同于传统行业一般把产品质量、服务态度排在第一位,互联网企业的“隐私观”,某种程度上是决定相关应用市场价值的一个基座,如果这个基座走偏,产品设计再“创新”,恐怕都会被用户抛弃。

一句话,一个致力于在用户隐私信息上“打歪主意”的企业,注定行之难远。

不可否认,面临 AI 等新的个人信息保护环境,对于用户的隐私保护,在法律和制度上,都还有诸多细化、完善空间。

但是,任何一家谋求长远发展的正派企业,都有责任杜绝在“弱隐私保护”上火上浇油,或者把企业的未来建立在弱隐私保护“红利”的基础之上。

这次行业内部出现对“ZAO”的批评与反思,或许也代表了整个行业的一种觉醒。以此为鉴!对于AI换脸,你怎么看?

精彩文章推荐: