通俗易懂!《图机器学习导论》附69页PPT

点击上方,选择星标或置顶,每天给你送干货

阅读大概需要10分钟

跟随小博主,每天进步一丢丢

转载自:专知

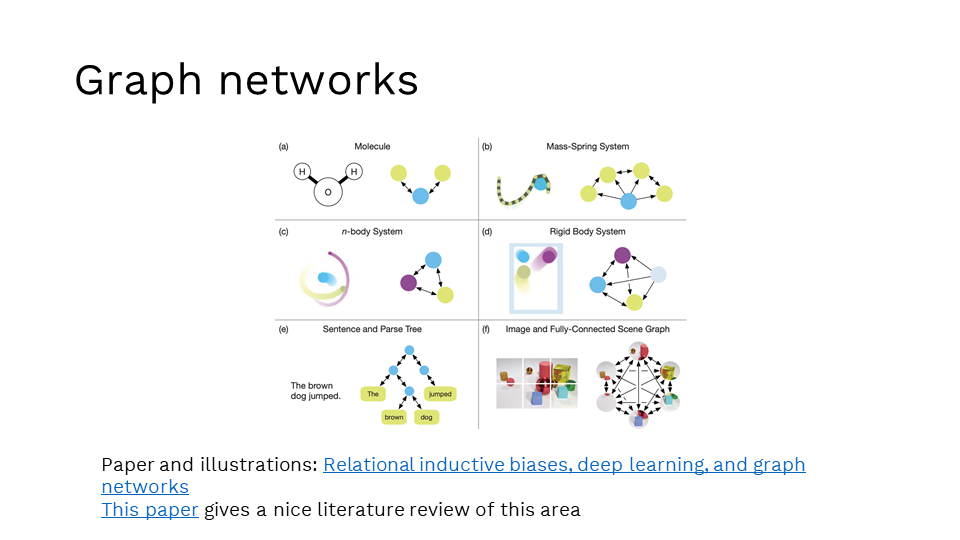

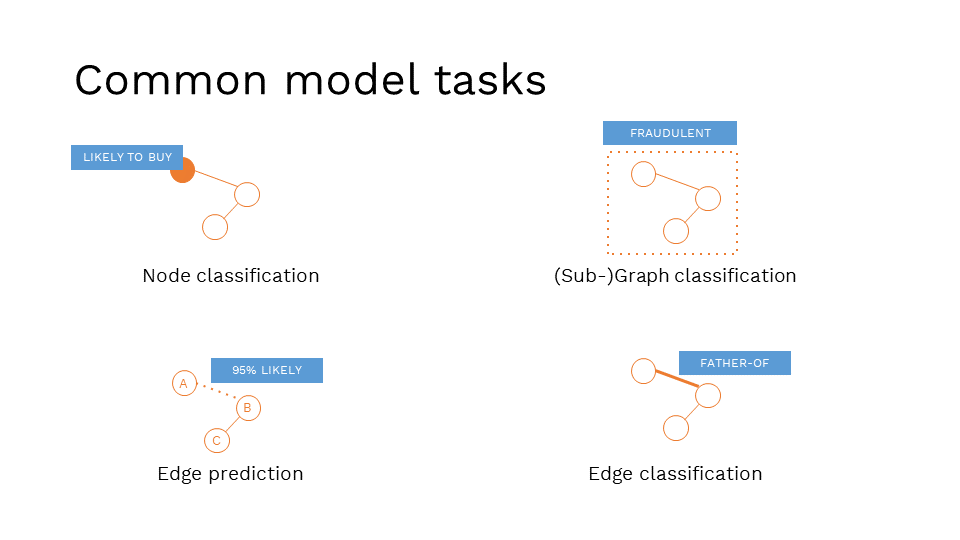

【导读】图是强大的数据结构,可以被用于建模许多真实世界的场景。图可以建模样本之间的关系信息,然而,许多之前的机器学习模型忽略了关系信息或没有很好地方法来建模关系信息。《图机器学习导论》介绍了目前较新的基于图的机器学习方法。

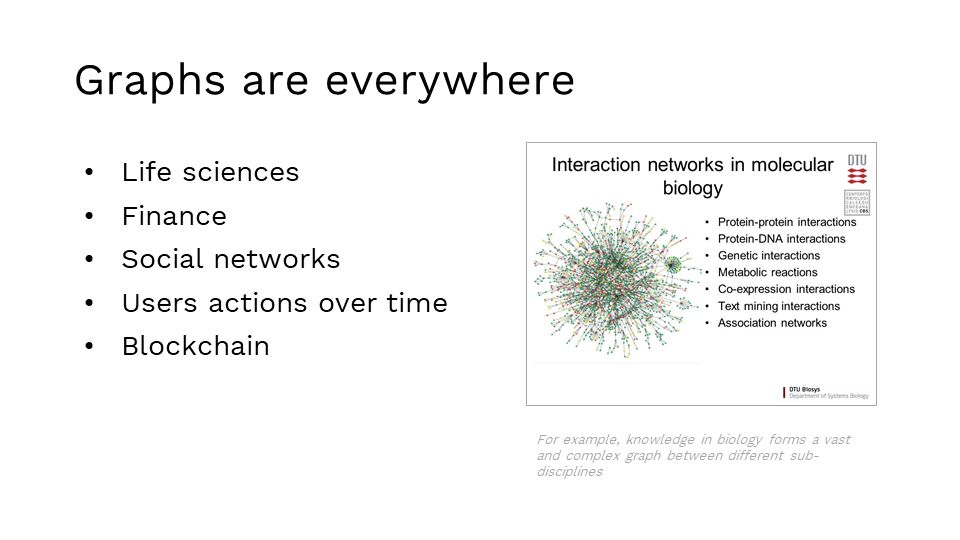

图是强大的数据结构,可以被用于建模许多真实世界的场景。目前,图在生命科学、金融、社交网络、用户行为时序建模、区块链等领域的机器学习应用中都得到了广泛的引用,并取得了非常好的效果。

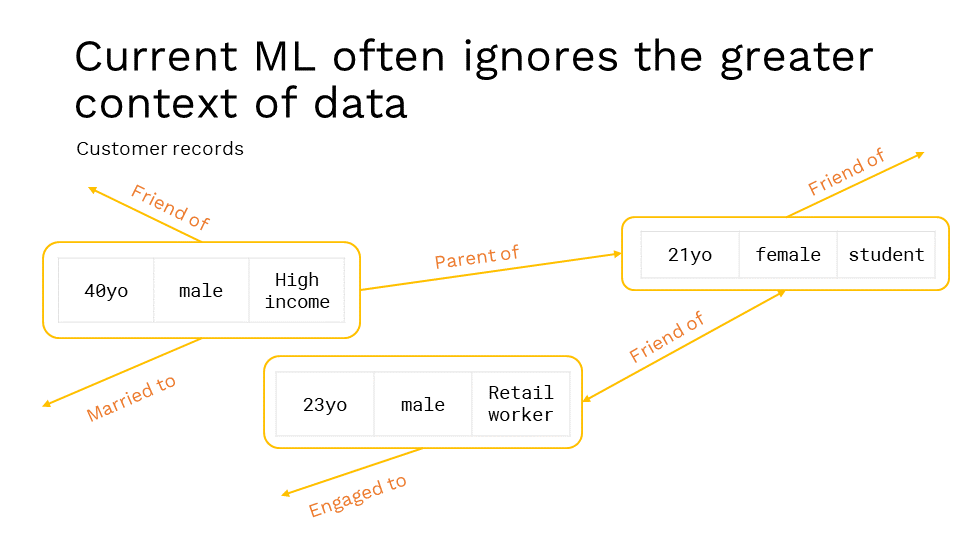

图数据往往会包含大量有价值的关系数据。然而,许多之前的机器学习模型往往只关注每个样本的特征,而没有考虑到样本之间的关系数据或没有很好的方法来利用和建模这些关系数据。

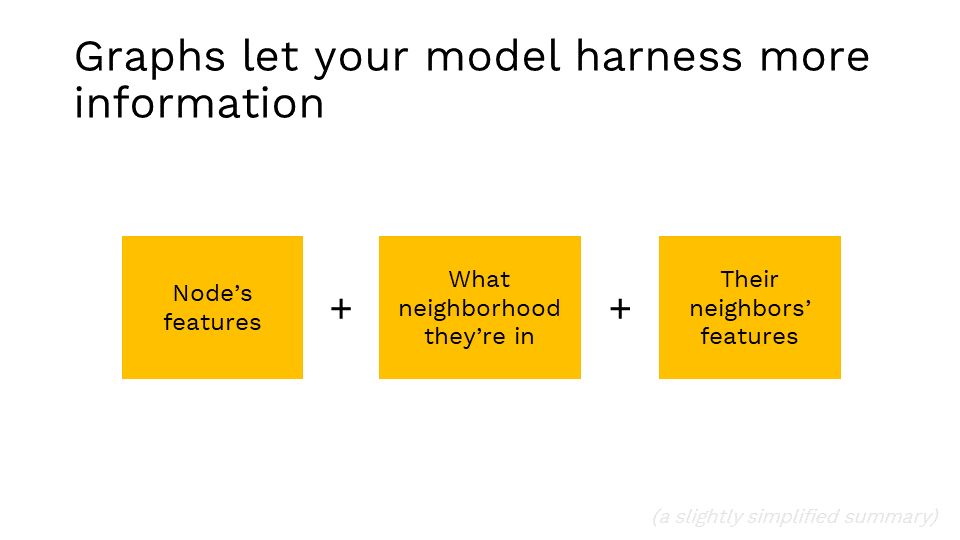

图机器学习为我们提供了利用这些关系数据的方法,它使得我们可以同时考虑图中每个节点的自身特征、邻节点以及邻节点的特征,以获取更好的性能。

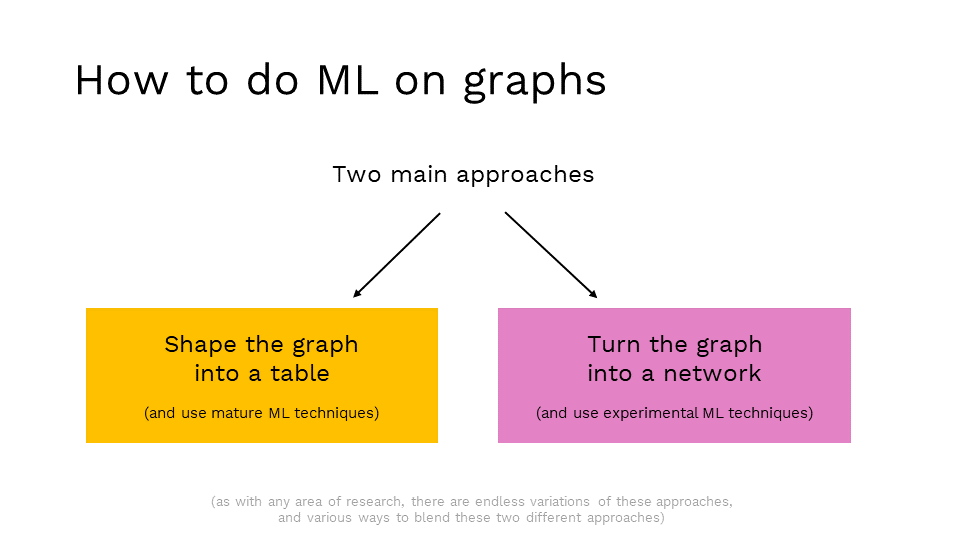

图机器学习的实现一般有两种方法:

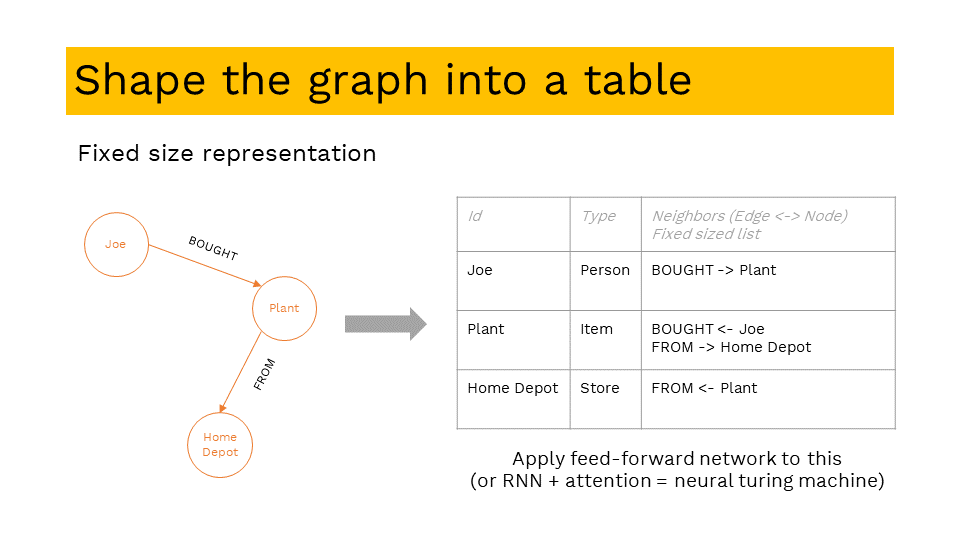

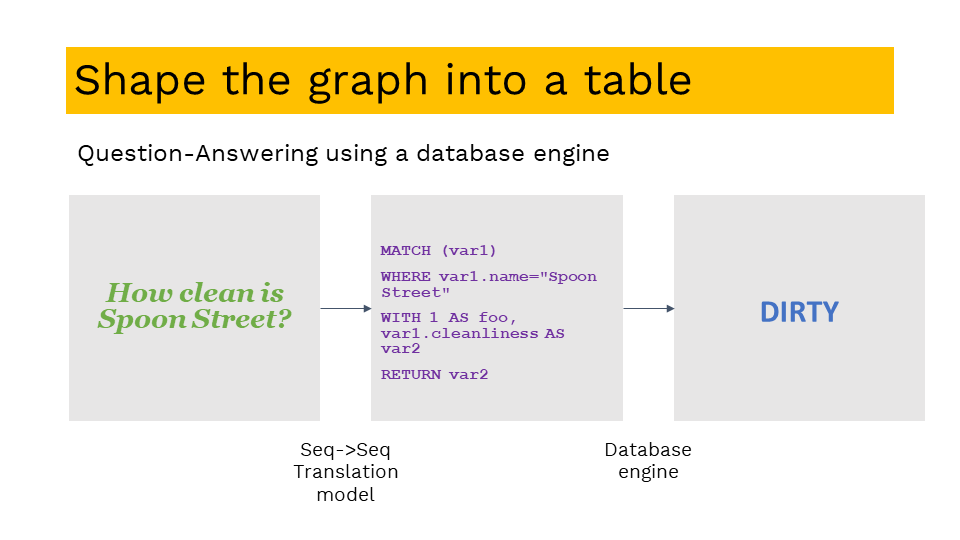

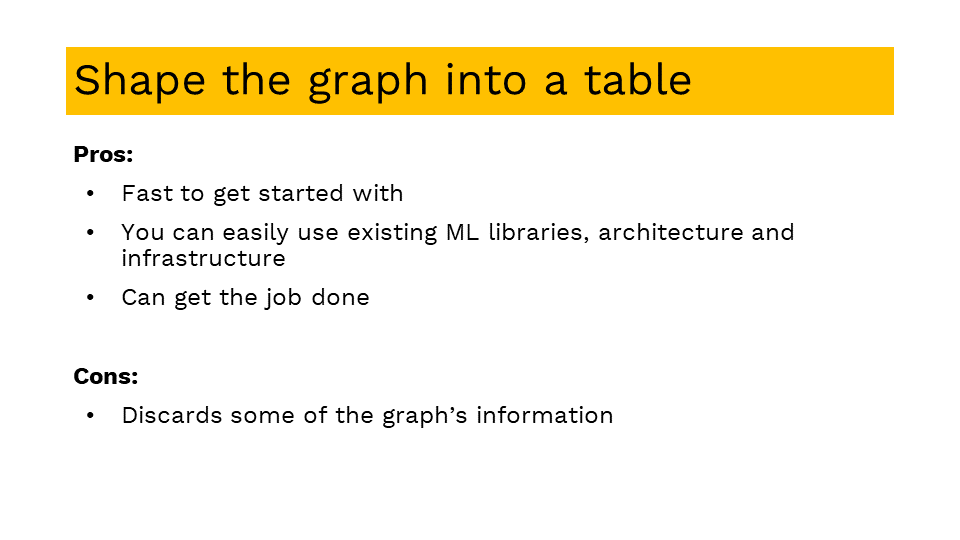

将图转换为表格,用传统成熟的机器学习方法实现

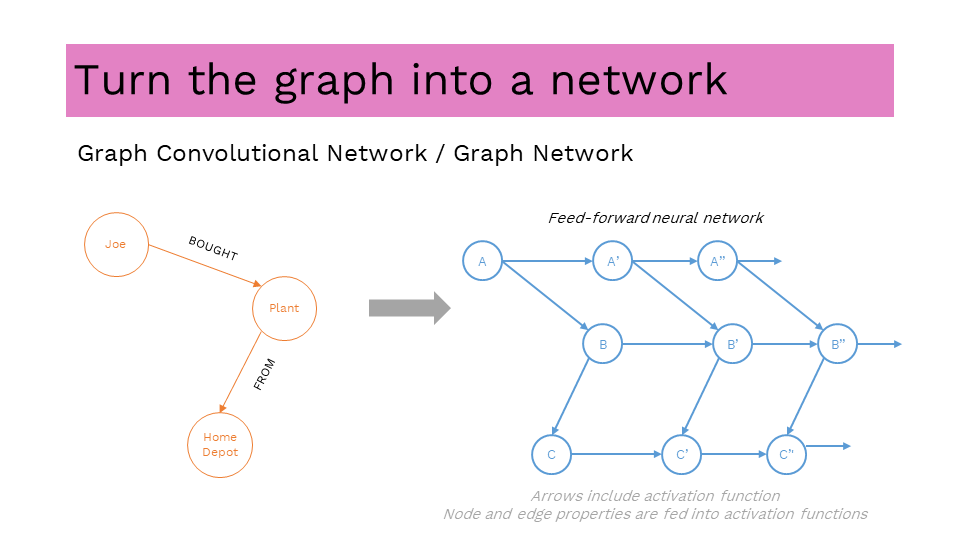

将图建模为网络,用目前较新的基于网络的机器学习方法实现

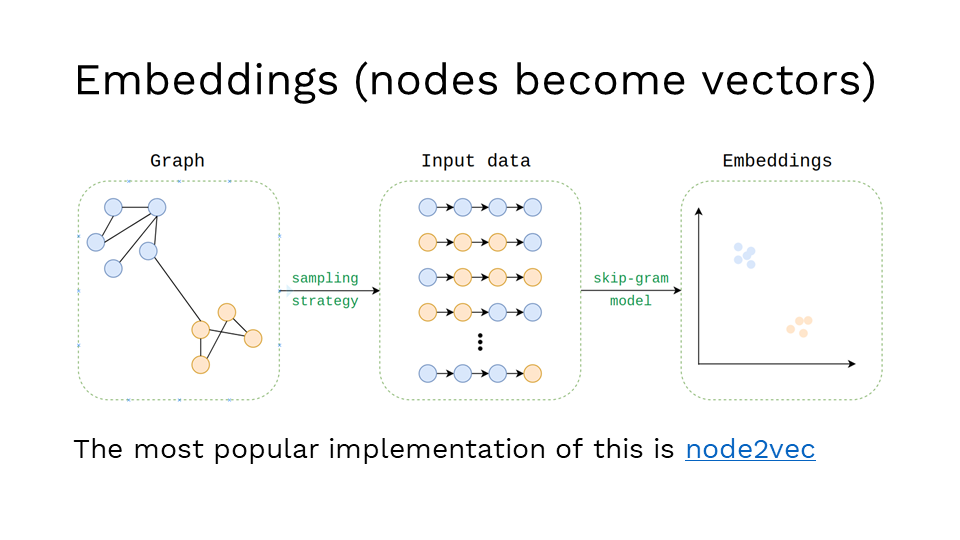

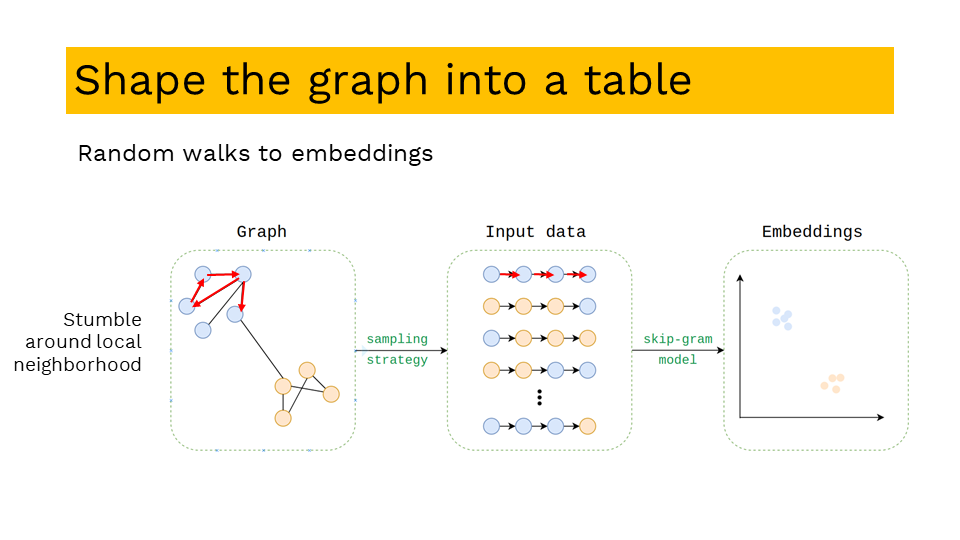

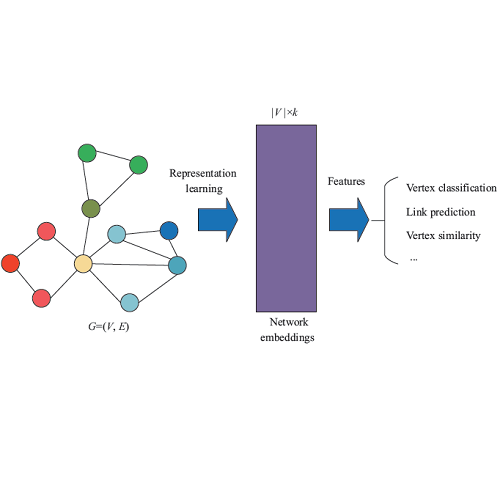

DeepWalk、Node2Vec等基于Random Walk的网络节点表示学习方法,属于上述的第一种方法,它们利用Random Walk将网络结构转换为序列,用成熟的skip-gram方法进行求解。

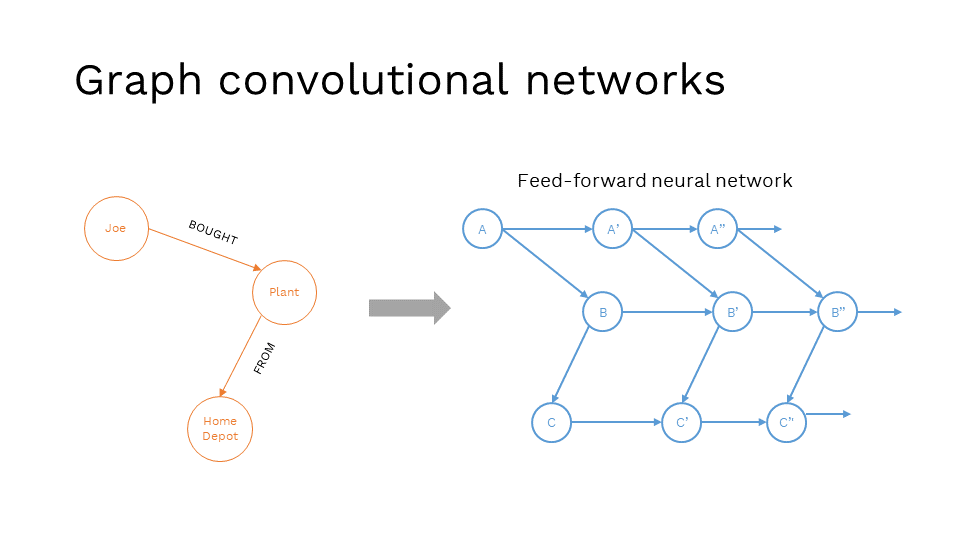

目前较为流行的图神经网络属于第二种方法,直接在网络结构上进行机器学习:

《Introduction to graphs and machine learning》(《图机器学习导论》)为我们介绍了图机器学习的动机与发展,包括网络表示学习、图神经网络等图机器学习方法及其在问答、知识图谱等领域的应用。

-

后台回复“ITGML” 就可以获取完整教程PPT的专知资源下载链接~

教程部分截图如下所示:

参考链接:

https://conferences.oreilly.com/strata/strata-ny-2019/public/schedule/detail/76557