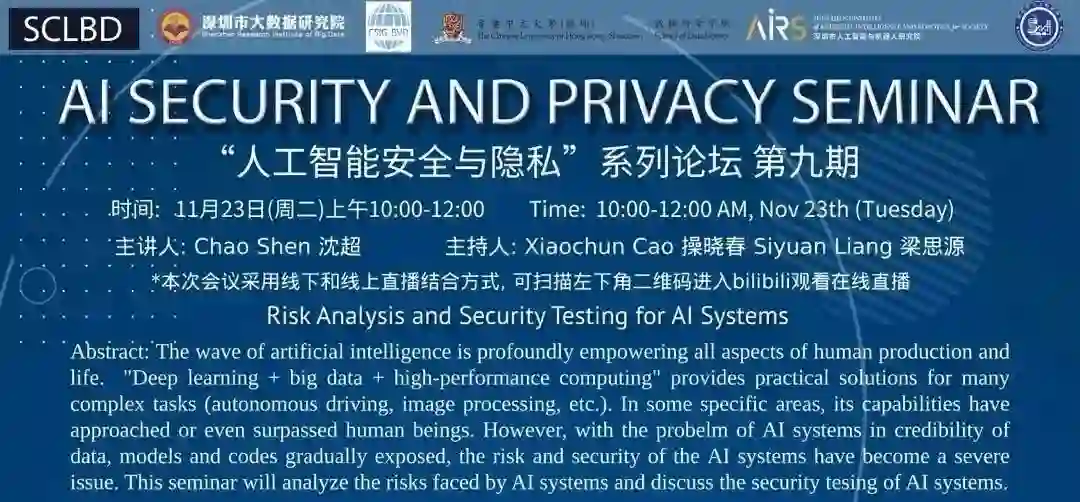

【动态】“人工智能安全与隐私”系列论坛第九期圆满落幕

来源:CSIG视觉大数据专委会

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年4月18日

Arxiv

1+阅读 · 2022年4月18日

Arxiv

0+阅读 · 2022年4月15日