ACL 2019 开源论文 | 使用跨领域语言建模的跨领域命名实体识别

作者丨刘朋伯

学校丨哈尔滨工业大学硕士生

研究方向丨自然语言处理

https://github.com/jiachenwestlake/Cross-Domain_NER

研究背景

相关工作

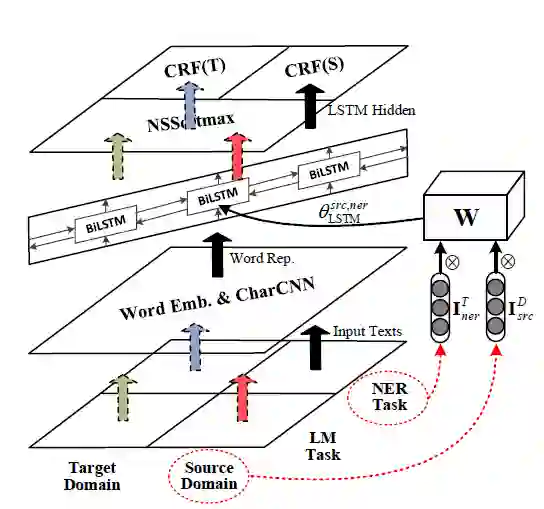

模型

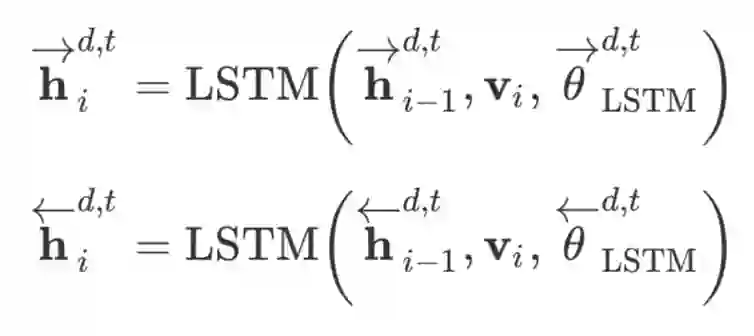

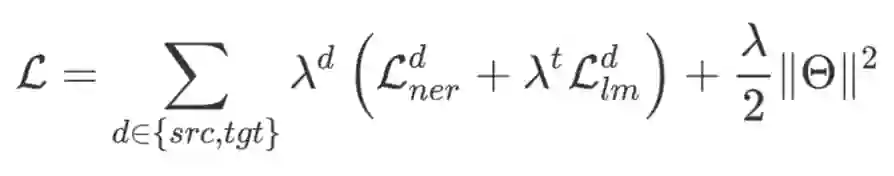

参数生成网络

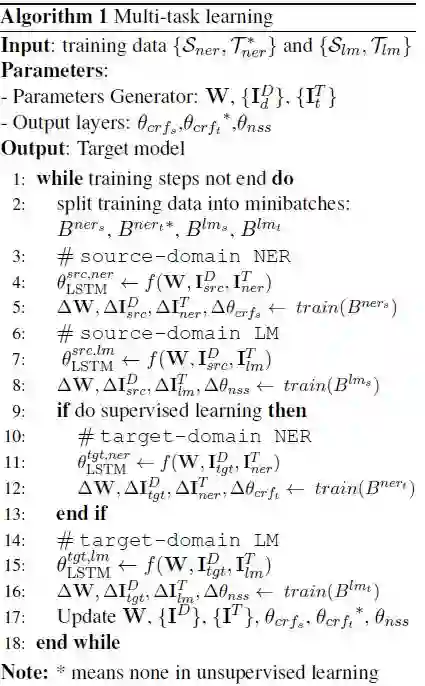

其实文章中的主要模型仍然是 Bi-LSTM+CRF。所以参数生成网络,也就是要动态地生成 Bi-LSTM 的参数,以达到跨领域跨任务地转移知识的目的。

实验

数据

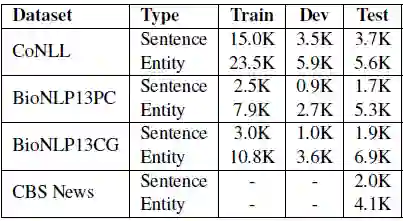

源领域的 NER 数据来自 CoNLL-2003,源领域的语言模型使用来自路透社的 377592 条句子训练。

目标领域的数据来自三部分:生物医药领域的 BioNLP13PC (13PC) 和 BioNLP13CG (13CG) 还有一份自己收集标注的科技领域的数据集。数据集的统计信息如下表所示:

CoNLL-2003 包括了四种实体类型:PER、LOC、ORG、MISC。BioNLP13PC 包括了五种实体类型:CHEM、CC、 G/p、SPE、CELL,BioNLP13CG 包括三种试实体类型:CHEM, CC 和 G/P,目标领域的语言模型直接使用这些数据集的文本训练。

作者团队自己标注的数据集来自 CBS (https://www.cbsnews.com/)。标注规则遵守 CoNLL-2013 标注,也是四种实体,和 CoNLL-2013 不同的是,数据集中科技类型的实体居多,比如“Space X”,“bitcoin“和”IP”。相应的,语言模型使用 398990 条为标注句子训练。

超参数

本文的实验是在 NCRF++(记得也是张岳老师团队出品)基础上进行的,有些参数有改动:batch size 变为 30;单任务使用学习率为 0.001 的 RMSprop 优化器,多任务模型使用学习率为 0.015 的 SGD 优化器。为了能在显存 8GB 的单 GPU 上运行,领域向量和任务向量维度均为 8。词向量使用预训练的 100 维 GloVe 向量,字符向量随机初始化。

实验结果

本文对实验结果的分析还是很周密且详尽的。作者在多任务角度、数据角度都有分析,建议感兴趣的读者看一下原文,更能体会作者的用心。

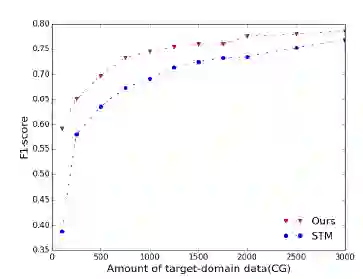

如上图,STM(单任务模型)与文章模型的比较,可以看出,文章模型一直是优于 STM 的,尤其是目标领域数据极少时(也可以看做无监督),依然能保持 60% 左右的 F1-score。

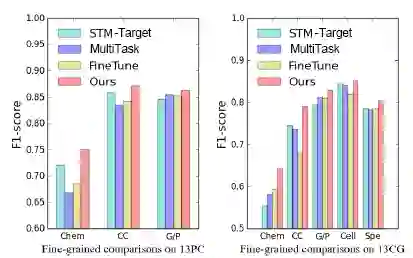

在有监督的领域迁移 NER 上,作者把模型与 STM、多任务(完全共享参数)、fine-tune 方法进行对比,发现一些类型的实体识别直接使用多任务方法效果是非常差的,而本文的方法一直是最优的。可见,同样是多任务学习,参数生成网络带来的提升是巨大的。

总结和思考

点击以下标题查看更多往期内容:

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。

▽ 点击 | 阅读原文 | 下载论文 & 源码