哈佛神经科学博士:自动驾驶汽车不会「读心术」,但人会!| 厚势

厚势按:在先前推送的两篇文章《谷歌自动驾驶前 CTO:从 L2 逐步升级到 L4 + 是行不通的》与《自动驾驶的根本挑战:人类意图识别与人-车博弈难题》中,Chris Urmson 与 Rodney Brooks 都认为,实现全自动驾驶汽车的最大困难之一在于对「人类意图」的准确识别。

哈佛大学神经科学博士生 Sam Anthony 近日在 Quartz Media 上撰文,对这一主题从认知学与行为学的角度进行了讨论。厚势将此文进行了删选整理,译成中文,并在文末从图灵机只解决「可计算问题」的角度作出了点评,供读者参考。

引子

如果向机器人学家或计算机科学家提问,需要具备哪些功能才能让一辆汽车实现自动驾驶?

他们的回答都差不多,比如:

需要知道道路的边界在哪里;

需要能够从纵向和侧向操控汽车(即转向和加减速);

需要知道某段道路的限速是多少;

能够识别并读懂路标代表什么含义;

能够检测交通信号灯是红色还是绿色;

能够快速对行驶路径中出现的意外物体作出反应;

能够实现高精度定位与导航。

上述功能确实是重要,且不可或缺,但却忽略了真实世界驾驶过程中一个重要组成部分:我们的直觉。我们是如此擅长且毫不费力地使用着直觉来确定周围人的动机,以致于自己都没察觉到这个过程,更不用说对其进行编程。

然而,目前自动驾驶汽车缺乏的正是这个能力——看一眼某个人(如行车过程中经常遇见的三类人:行人、驾驶员和骑自行车的人),就知道他们此刻在想什么。事实上,人类驾驶员在开车时的这些即时判断,对自身与他人的行车安全起着至关重要的作用。

来自哈佛大学的自动驾驶初创公司

图 1 脱胎于哈佛大学的自动驾驶软件初创公司 Perceptive Automata

山姆·安东尼(Sam Anthony)是哈佛大学认知学、脑科学与行为学在读博士(PhD Candidate in Cognition, Brain and Behavior),同时也是自动驾驶软件初创公司 Perceptive Automata 的 CTO 兼联合创始人。Perceptive Automata 的成员全部来自哈佛大学,成员的学术背景包括神经科学、计算机视觉与机器学习,致力于开发下一代人工智能技术。

为了弄清人们在开车时唤醒这些潜意识的频率,安东尼曾在自己工作过的哈佛大学实验室附近的一个安静的没有信号灯的十字路口安装了一台相机以记录路口的交通情况。

在想象中,这种较偏僻的十字路口不会像波士顿市中心、曼哈顿或者墨西哥城的那么拥挤或难以通过。但是在短短 30 秒的视频片段间隔中,仍能数出超过 45 个瞬间,是某一人在用直觉读懂另一人内心的想法。

这些非语言的瞬间产生的直觉认知可能是:

「那人不会让步」;

「那人没看到我在这里」;

「那人在遛狗,不会乱穿马路」;

「那两个人在谈话,不会过马路」,等等。

预知心理状态

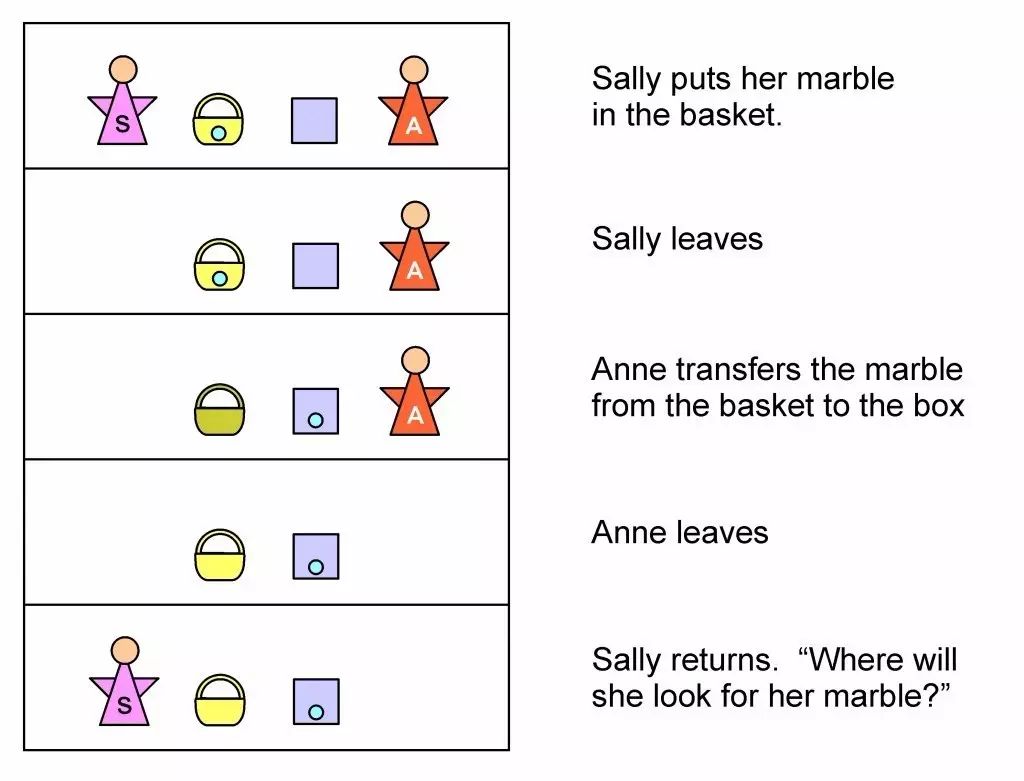

图 2 经典心理学实验:萨莉-安妮测试(Sally-Anne Test)

试想一下,如果自动驾驶汽车也按照自闭症光谱患者的认知模式来行动,那会是一种什么样的场景呢?

计算机不会「读心术」

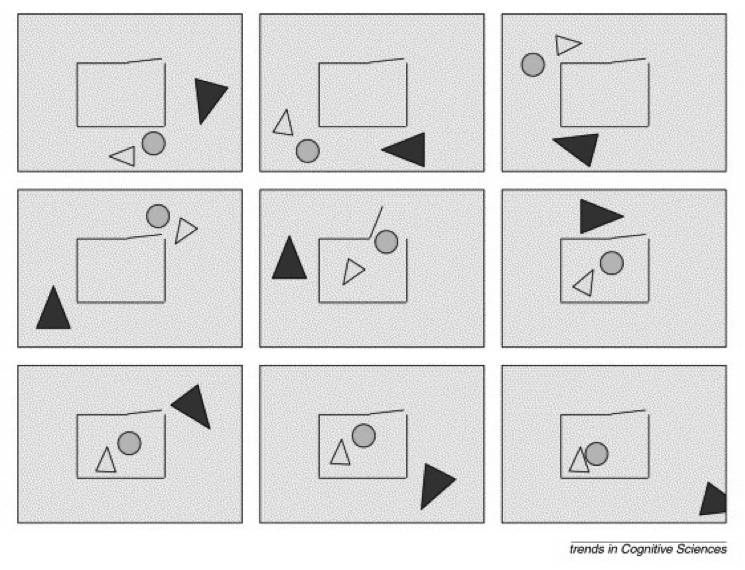

图 3 Heider-Simmel 实验中的场景

但是,截止到目前,计算机还无望如此操控车辆,对心理状态缺乏直觉认知的危险也已经得到了证实。

在自动驾驶汽车发生的第一次交通事故中,谷歌的车错误地认为公共汽车驾驶员会给它让路,误解了驾驶员努力绕过一辆停着的汽车的紧迫性以及方式的灵活性。在另一次交通事故中,优步在亚利桑那州测试的一辆自动驾驶汽车被一个试图转向变道的驾驶员给撞了,后者预计任何后面正在驶来的汽车会注意到自己车道的交通流量已经放缓,相邻车道上的汽车的变道意图会增加。但是,优步的自动驾驶系统并不懂这些。

克服「莫拉维克悖论」

厚势评论

笔者认为,安东尼虽然提出了自动驾驶的一个非常重要的问题,但他似乎忽略了一点——计算机科学的奠基人艾伦·图灵设计图灵机的初衷是解决可计算问题,之后基于冯诺依曼架构设计的计算机都属于图灵机的范畴。

人工智能虽然发展的如火如荼,本质上都是将待解决的问题转化成可计算问题,然后交给计算机去处理。

那么问题来了,人类所拥有的、在解决问题时非常管用的、经过数百万年生物演化而来的「常识」、「直觉」等工具是属于可计算范畴吗?

如果不是,图灵机是无济于事的。那么解决上文中描述的自动驾驶汽车难题似乎就剩下如下两种办法了:

将人类驾驶员剔除出整个交通系统;

发明区别于图灵机的新型计算机。

好像还是第一种办法更简单易行一些。

参考资料

Sam Anthony. Self-Driving Cars Still Can’t Mimic the Most Natural Human Behavior. Quartz Media. 17.08.29

Rodney Brooks. The Big Problem With Self-Driving Cars Is People. IEEE Spectrum. 17.07.27

Chunka Mui. Chris Urmson Reflects on Challenges, No-Win Scenarios and Timing Of Driverless Cars. Forbes. 17.05.08

作者:厚势分析师拉里佩

转载请注明来自厚势和厚势公号:iHoushi

-END-

文章精选

企业家

智能驾驶

测试时间从500年减少到半年,这才是美国联邦自动驾驶法案的本质意义

新能源汽车

项目和评论

这些大神从Google出走,创办了五家(命运各异的)无人车公司

60岁英国传奇创业老兵再战自动驾驶,FiveAI融资2680万英镑

厚

势

汽

车

为您对接资本和产业

新能源汽车 自动驾驶 车联网

联系邮箱

bp@ihoushi.com

点击阅读原文,查看[美国工会牛!成功将「商用车」剔除出了众议院自动驾驶法案]