CVPR 2019 | 最佳论文得主专访:非视距形状重建的费马路径理论

本文来自Robinly,AI 科技评论 获授权转载。Robin.ly 是立足硅谷的视频内容平台,服务全球工程师和研究人员,通过与知名人工智能科学家、创业者、投资人和领导者的深度对话和现场交流活动,传播行业动态和商业技能,打造人才全方位竞争力。

本期Robin.ly CVPR 2019专题访谈特邀大会最佳论文奖获得者辛书冕和Ioannis Gkioulekas教授现场对话,分享他们的研究成果和获奖体会。辛书冕本科毕业于西安交通大学电气工程专业,目前是卡内基·梅隆大学机器人研究所的在读博士生,Ioannis是该所的助理教授。他们合作的论文 “A Theory of Fermat Paths for Non-Line-of-Sight Shape Reconstruction” 获得了本年度CVPR大会的最佳论文奖。

辛书冕(左)和Ioannis Gkioulekas教授(右)在美国长滩CVPR2019大会接受Robin.ly专访

如评选委员会的颁奖词所述:“这篇论文为非视距(non-line-of-sight ,NLOS)重建做出了重大贡献,尤其是赋予了智能体看到角落的能力。这是一篇出色的、鼓舞人心的论文,它帮助我们继续推进计算机视觉领域的探索极限。“

下文为Robin.ly主持人Margaret Laffan与辛书冕和Ioannis Gkioulekas教授的访谈实录。完整访谈视频见文末。

长按二维码

访问Robin.ly获取英文访谈实录

1

获奖论文简介

主持人:书冕和Ioannis教授,感谢两位参与我们的谈话。祝贺你们获得了今年CVPR大会的最佳论文奖。能简单介绍一下自己吗?

辛书冕:

我叫辛书冕,是卡内基梅隆大学机器人研究所的二年级博士生。我跟随Srinivasa Narasimhan和Ioannis Gkioulekas教授一起研究非视距成像问题。这篇论文介绍的也是这方面的一些研究成果。

Ioannis:

大家好,我是Ioannis Gkioulekas,在卡内基梅隆大学机器人研究所担任助理教授,从事计算机成像和计算机视觉方面的工作。

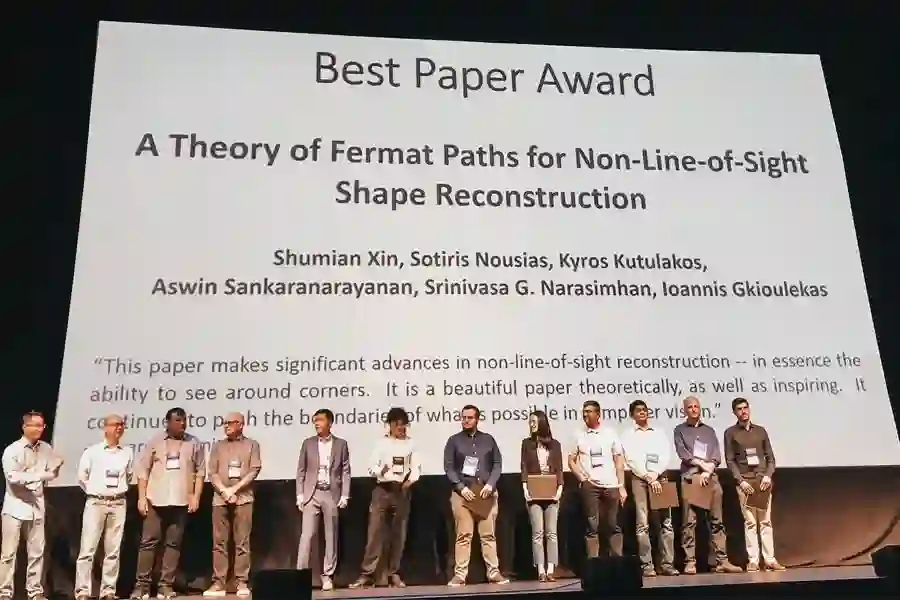

CVPR 2019最佳论文颁奖现场

(来源:卡内基·梅隆大学)

主持人:你能介绍一下这篇获奖论文“A Theory of Fermat Paths for Non-Line-of-Sight Shape Reconstruction”吗?你们团队完成这篇论文大概花了多长时间?

辛书冕:

我们在这项工作中要解决的问题是如何重建被遮挡住的、以及在摄像机或传感器视野之外的物体。我们会观察其他的表面,比如墙壁,反射的一些关于非视距对象的信息,然后使用飞行时间传感器收集这些信息来重建非视距对象的形貌。我做这个课题差不多有两年的时间,这篇文章介绍的是我们尝试过的很多方法中的一种。这个课题我们还会继续做一段时间。

主持人:那么这项研究最重要的贡献是什么?

辛书冕:

我们很高兴看到所重建的非视距对象的质量已经非常接近视距的对象,也就是相机视野范围内的对象。这就好像我们让整个世界变得像镜面一样,这样我们就可以在任何地方重建那里的对象。

主持人:这项研究在实际生活中有哪些应用呢?

辛书冕:

这种NLOS技术有很多重要的应用。例如,在医疗领域,我们可以使用这种技术进行微创手术。医生只需要用光线照射你的喉咙,测量一下从身体内部反射回来的光子,就能了解到你体内大概的情况。在自动驾驶领域,能够提前了解行驶路线的周围环境,特别是位于视线之外的情况。另外,如果发生火灾,这项技术可以帮助救援人员观察到被火挡住的地方,为救援工作提供帮助。

2

选择课题的初衷

主持人:的确都是非常重要的应用场景。你们为什么当初选择了这个课题?

辛书冕:

这个课题本身就很有意思,看不见的地方是什么情况还是很让人好奇的。实际上在2009年的ICCV 大会上,来自麻省理工学院的Ramesh Raskar团队就做了第一个NLOS重建工作,向我们展示了这项技术的可能性。目前整个计算成像领域正在将这种技术推向更高的水平,我希望能见证这项技术的发展,所以就选择了这个课题。

主持人:很多人会用LiDAR来解决类似的问题。你为什么选择了不同的方法?

辛书冕:

实际上我们使用的方法与LiDAR没有显著的差别。因为LiDAR用的是第一个返回的光子来估算深度,但我们使用的是飞行时间传感器收集到的一些后续光子信息来进行NLOS重建。我们观察的是墙,如果像LiDAR那样只使用第一个返回的光子,那重建出来的只能是那堵墙;所以必须收集间接的从这些对象传回传感器的后续光子才能重建被挡住的对象。与LiDAR类似,我们只使用时间信息进行深度估算,因为时间乘以光速就是路径长度,这样就可以直接重建这些对象的形貌。

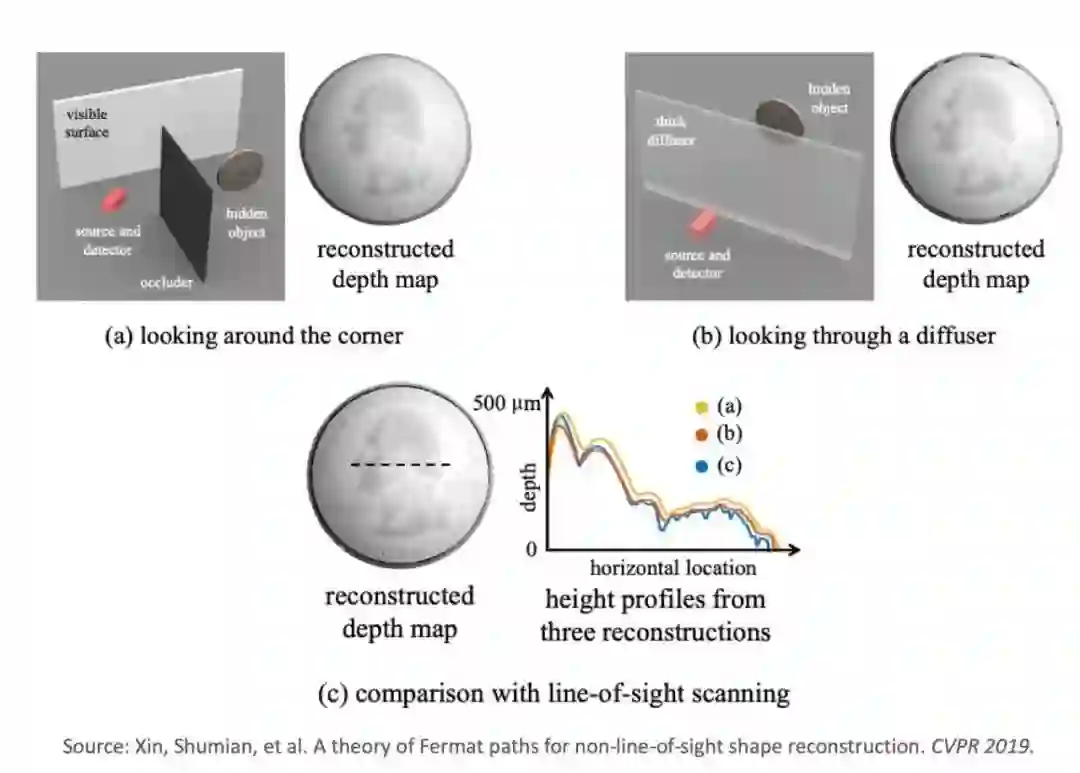

非视距成像示例:被遮光板遮挡(a)和被漫射板遮挡(b)的物体表面重建结果与视距扫描结果(c)对比。详情见论文:http://imaging.cs.cmu.edu/fermat_paths/assets/cvpr2019.pdf

3

NLOS成像领域的展望

主持人:教授,你对这项研究的进展有什么看法?

Ioannis:

做非视距成像方面的研究很有意思,就像书冕说的,计算成像领域有很多人正在研究这个问题。而且有几个团队已经在这个领域取得了一些不错的成绩,比如我们研究所的Matthew O Toole,斯坦福大学的Gordon Wetzstein和威斯康星大学的Andreas Velten。他们的成果为我们继续推进这方面的研究铺平了道路。我很高兴能见证这个领域多年来的发展,也很期待看到我们的文章对这个领域有一定的贡献。

主持人:能不能展望一下这个领域下一阶段的发展?

Ioannis:

NLOS成像中的一个主要的问题是如何提高信噪比。我们一直在尝试测量一些反弹了多次的光子,但这样的光子很少,能测量到的只有十几个,跟噪音水平相当。所以要提高信噪比才能实现书冕刚才提到的那些应用,这也是我们下一步要重点推进的方向。这是第一步,信号增强之后我们会尝试在限制更少的场景中运用这个技术。

辛书冕(右二)、Ioannis Gkioulekas教授(右一)与Robin.ly主持人Margaret在美国长滩CVPR2019现场对话

4

团队合作

主持人:这篇论文有六个作者,分别来自来自三个研究单位。书冕,能不能给我们介绍一下论文背后的这个团队。你们是如何合作的?大家平时怎么沟通?

辛书冕:

Srinivasa Narasimhan (CMU机器人研究所教授)和Ioannis Gkioulekas都是我的导师。我和Ioannis每天都会沟通研究进展。Srinivasa也经常来我的办公室询问实验情况,我会跟他交流当时的进度和下一步的计划。

实际上关于这个课题最初的想法是Ioannis和Aswin Sankaranarayanan(CMU机器人研究所助理教授)提出来的。Kiriakos Kutulakos (多伦多大学教授)在这项研究中也付出了很多心血,他们在多伦多大学为我们提供了初始阶段的硬件设置。早期比较繁琐的实验工作都是Sotiris Nousias (伦敦大学学院博士生、多伦多大学访问学者)做的。有了他们的帮助,我们才能取得今天的成果,朝着正确的方向努力。

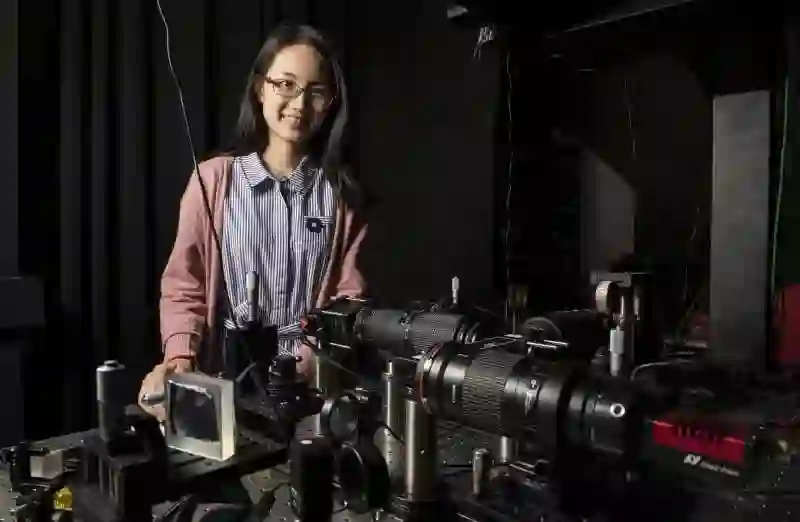

实验室里的辛书冕(来源:卡内基·梅隆大学)

主持人:教授,从你和学校的角度是怎么看待这次合作的?

Ioannis:

这是一次非常有趣的合作。Kyros和Srinivasa都是我们这个领域的资深研究人员,总是会带来很多独特的见解。最初是我和Aswin提出了这样的一个想法。后来我们试着去解决这里面涉及到的一些数学问题,在多伦多大学Sotiris的帮助下,我们获得了第一个实验测量结果,证明了我们的想法是可行的。这是一次非常重要的合作。

主持人:书冕,你下一步有什么打算?

辛书冕:

我非常感谢大会颁发给我这个奖项,这是对我们工作极大的肯定,也鼓励我挑战自己能力极限。我建议对计算成像感兴趣的人都能进入这个领域研究学习。这个领域融合了物理学、光学和计算机视觉,是一个充满挑战、但也非常有趣的研究方向。

主持人:说得太好了。教授,你对书冕和整个团队获奖有什么感想吗?

Ioannis:

这对我们是很大的认可。很高兴看到计算机成像作为计算机视觉领域的一小部分,现在得到了大家的认可,也希望这会鼓励更多的人在这个领域耕耘。有女生获得这个奖项也让我觉得很欣慰,希望以后有更多的女生能学习理工科。

主持人:说得太好了。我很期待你们提到的应用场景能够尽快变成现实。非常感谢你们参与我们的访谈,很荣幸邀请到你们。再次表示祝贺,这是一项非常了不起的成就。(完)

辛书冕和Gkioulekas教授访谈完整视频

关注Robin.ly “Leaders In AI” Podcast

收听完整英文访谈

2019 年 7 月 12 日至 14 日,由中国计算机学会(CCF)主办、雷锋网和香港中文大学(深圳)联合承办,深圳市人工智能与机器人研究院协办的 2019 全球人工智能与机器人峰会(简称 CCF-GAIR 2019)将于深圳正式启幕。

届时,诺贝尔奖得主JamesJ. Heckman、中外院士、世界顶会主席、知名Fellow,多位重磅嘉宾将亲自坐阵,一起探讨人工智能和机器人领域学、产、投等复杂的生存态势。

今日限量赠送7张900元门票优惠码,门票原价1999元,打开以下任一链接即可使用,券后仅1099元,限量7张,先到先得,送完即止。

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e36e5

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e3449

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e314e

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e2e26

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e2b51

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e2787

https://gair.leiphone.com/gair/coupon/s/5d1b08d0e23e7