卡内基梅隆大学(CMU)研究人员做出了最能骗人的Deepfakes

选自VentureBeat

文|KYLE WIGGERS

乌镇智库编译

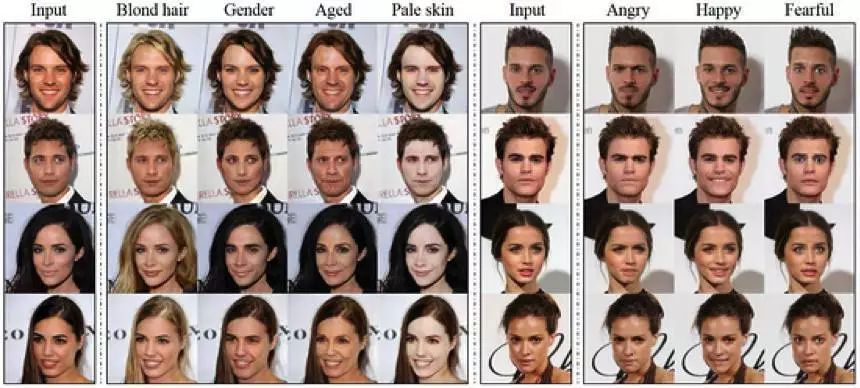

什么是“Deepfakes”(我将其称为深渊假面,可以说很贴切了)。Deepfakes简单来说就是利用人工智能算法,将视频中的一个人脸换成另外一张脸,在无数电影剪辑里就是用这个技术把哈里森福特的脸换成了尼古拉斯凯奇,还有一些更为邪恶且少儿不宜的目的,像将18禁电影换成名人头像,当然我们主张技术无罪。不论好坏,日前,卡内基梅隆大学的研究人员研究出一个比Deepfakes功能更为强大的新版本。

图片|Deepfakes

它叫“Recycle-GAN”,开发团队将其描述为“无人监督,数据驱动”,主要就是将一个视频或者图片的内容转换到另一个视频或图片里。这样的内容转换任务能够支持很多应用,包括从一个人的人体运动和面部表情转换到另一个人(或其他什么)身上,人类亲身演示教授机器人如何工作,还能将黑白视频转换为彩色视频。

目前大多数这种转换技术都只针对人脸,缺乏对其他领域的总结和整合,在实际中若是遇上遮脸的情况,程序就会难以执行,有一些则必须依赖对照组,必须有成对的图像,这就需要劳动密集式的手动标记数据。

相比之下,Recycle-GAN利用生成式对抗网络(GANs)和“时空线索”来学习和寻找图片或视频之间的关联(Gans是两个神经网络——生成器和鉴别器组成的系统,鉴别器的任务是确定给定的图像是否看起来更自然,生成器的任务是创建与原始数据分布类似的自然外观图像。生成器试图蒙骗鉴别器,而鉴别器试图不被生成器蒙骗),当训练人类主体的镜头时,它能够捕捉面部表情一些细微的线条,比如微笑时形成的面部细节。

图片|Recycle-GAN

在没有任何监督和特定场景知识背景的情况下,Recycle-GAN通过公共网站上的视频数据,从一个领域到另一个领域进行重新定位。Recycle-GAN不仅可以捕捉面部的线条,研究人员还用它来修改视频中的天气状况,将无风的日子变成刮风的日子,把一朵垂死挣扎的花变成鲜花,通过网上的视频合成日出,足以以假乱真。

目前的实验成果效果不错,能够在23.8%的时间内骗过15名测试对象,如果他们学会生成输出视频的行进速率,就像人们说话时的抑扬顿挫和不同速率一样,系统的迭代版本会更加准确。

真正的视频风格应该是能够传递语音和内容随时间的变化而变化,更加拟人和场景现实化,研究团队相信更好的时空神经网络架构能够迭代尝试解决这个问题。

Deepfakes目前仍是一个热点话题,附带Deepfakes的工具公开,使得视频内容更加容易被创建,如果因恶意的操纵者生产的视频而受害,也没有相关法律追责。

Reddit、Pornhub和Twitter以及其他平台,都站在反对立场,最近美国国防部的研究人员在寻找检测Deepfakes的方法,但正如圣塔克拉拉大学(加州最老的一所高校)法学院教授兼学院高科技法研究所所长Eric Goldman说:我们最好为一个真假掺杂的世界早做准备,从今以后真假难辨。毕竟但凡呈现出来的都是表象,真真假假,人生本来就是这么一回事。

Oracle开源GraphPipe:几行代码让你在TensorFlow部署PyTorch模型

颠覆arXiv等传统论文平台?谷歌大牛强推的Distill进展如何?

推荐阅读

比人工智能威胁更可怕的是,那些曾被你抛弃的互联网软件

尼克谈人工智能的历史、现实与未来