卖提示词都能赚钱了!预训练模型到底还有多少隐藏彩蛋?

前段时间,一家漂亮国的初创公司刷屏了朕所在的预训练模型QQ群,就是它⬇️

看名字就知道不是外人:PromptBase。Prompt(提示,一般指预训练模型领域人见人爱的Prompt Tuning提示学习。)

这家公司的主营业务正是售卖大模型的提示词。同样是捯饬预训练模型,朕还在苦苦憋论文盼着毕业有个地方打工呢,人家光卖提示词都能赚钱了!

朕心里还是不服气啊,决定一探究竟,发现它这个商业逻辑是:由用户自主创建提示词,允许用户出售在现有大模型上生成效果稳定的提示词串,平台则通过佣金获利。

确实,大模型凭借着空前强大的泛化能力,可以做到同一大模型在多种下游任务上取得很好效果,尤其是在内容生成领域。但问题是『甲方』很难精准找到『大模型这个乙方』能get到的『需求(提示词)』,PromptBase解决的就是这个问题。

所以,人家这个逻辑是通的。我怎么就没想到呢?

输入提示词,获得AI生成的内容

怪不得现在不仅是谷歌、OpenAI、百度、腾讯这种大个子,但凡有点钱的公司和实验室,都在琢磨预训练语言模型(即:大模型)。叫得上名字的模型GPT-3、文心、bert也几乎都是大规模预训练语言模型。这么多聪明的脑袋都往大模型上挤,一定还有很多彩蛋!

冷静下来后,我仔细思考了一番:发现大模型最大的优势是生成能力,也就是AIGC(Artificial Intelligence Generated Content,人工智能生成内容)。内容生成领域我熟悉啊:网络小说、国风漫画、广告媒体,这不几万亿的大市场!

如果我能快速开发一款基于大模型技术的AIGC插件,让AI帮助UP主、漫画和文章作者、设计师进行内容生产(河里摸鱼),那我就是他们的再生父母啊!(赚的盆满钵满)

说干就干,打开浏览器,用我的芊芊玉指输入:大模型API 就找到了可以免费调用的模型和对应中文教程,我可真是个小聪明蛋!(河里白嫖)

传送门

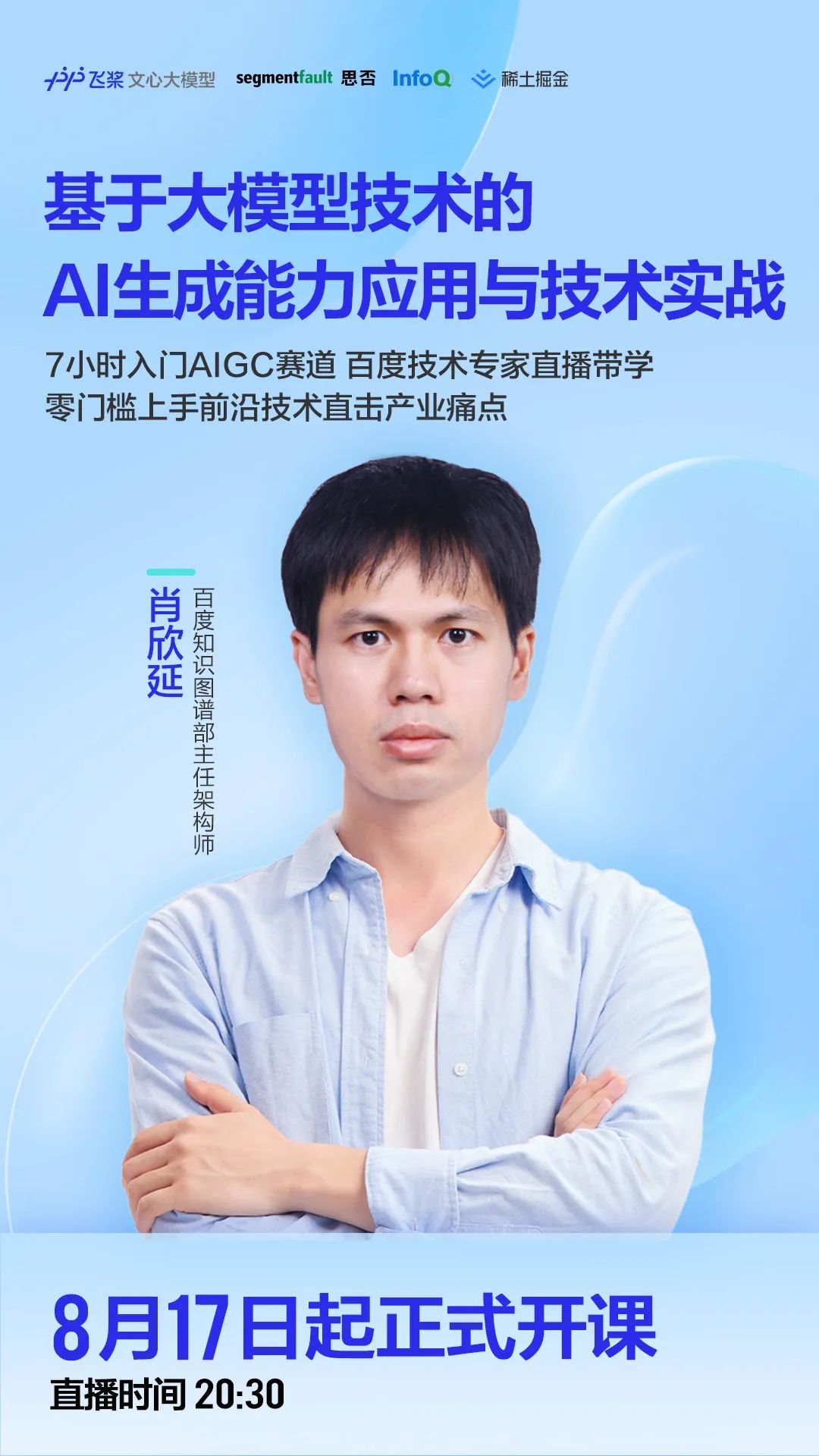

百度主任架构师肖欣延等多位大佬亲授、业内首个基于大模型技术的AIGC专题直播打卡课!8月17日晚正式开课,零基础也能清晰了解、轻松应用基于大模型的AIGC能力应用与技术要点。

零门槛快速掌握用AI生成花式文本/风格主题画作/趣味视频、闲聊对话生成、创意玩法等AIGC领域应用与技术要点。教程覆盖一键可用的SAAS软件、API、开源模型,无论你是追求直接应用的行业开发者,还是想学习大模型技术的学生,你都将学有所获。

课程配套丰富资源:行业场景/技术学习交流群、行业场景/技术学习闭门会、工信部&科技部主办的十万奖金池的大模型专题大赛、免费API调用额度等大礼包、专家直播答疑、资深开发者连续7天在线指导、百度飞桨官方结业证书等。

说实话,现在咱们搞深度学习的毕业生,找坑确实没有一两年前顺利了。现在还能经常看到急招岗位的也就是大模型方向了,这波上车不亏。

免费报名地址

扫码立即体验大模型技术

报名大佬课程

愿你学有所获,成为你喜欢的样子!