推荐系统作为现代信息生态中的基础性基础设施,帮助用户在不断扩张的数字内容空间中进行导航,并发现符合其偏好的项目。本质上,推荐系统旨在解决一个核心科研问题:如何实现用户与项目的匹配。在过去的数十年中,该领域经历了多次技术范式的演进——从机器学习时代的协同过滤与矩阵分解方法,到深度学习时代的复杂神经架构。 近年来,生成式模型(Generative Models) 的兴起——尤其是大型语言模型(Large Language Models, LLMs)与扩散模型(Diffusion Models)——引发了一种新的推荐范式:生成式推荐(Generative Recommendation)。这一范式将推荐问题重新定义为生成任务,而非传统的判别式打分过程。 本综述论文从数据、模型与任务三个维度构建统一框架,对这一新兴范式进行了系统性梳理与深入分析。不同于传统的分类综述,我们将研究方法细化为三个操作阶段: 1. 数据层面(Data Level) ——聚焦于知识增强与统一化的数据处理,包括基于生成模型的知识注入式数据增强、智能体驱动的用户行为模拟以及多模态与异构信号的统一表示; 1. 模型层面(Model Level) ——构建了对基于LLM的方法、大型推荐模型(Large Recommendation Models)以及扩散模型方法的系统分类,分析其对齐机制(alignment mechanisms)与创新点; 1. 任务层面(Task Level) ——探讨了生成式推荐所带来的新能力,包括对话式交互、可解释推理与个性化内容生成。

我们总结出生成式推荐的五大核心优势: (1)世界知识的整合能力; (2)自然语言理解能力; (3)复杂推理能力; (4)可扩展性规律(scaling laws); (5)创造性生成能力。 最后,我们对该领域面临的关键挑战进行了批判性审视,包括基准设计(benchmark design)、模型鲁棒性(model robustness)与部署效率(deployment efficiency)等问题,并提出了未来研究的路线图:迈向能够重塑人机信息交互的智能推荐助手(intelligent recommendation assistants)。

1. 引言(Introduction)

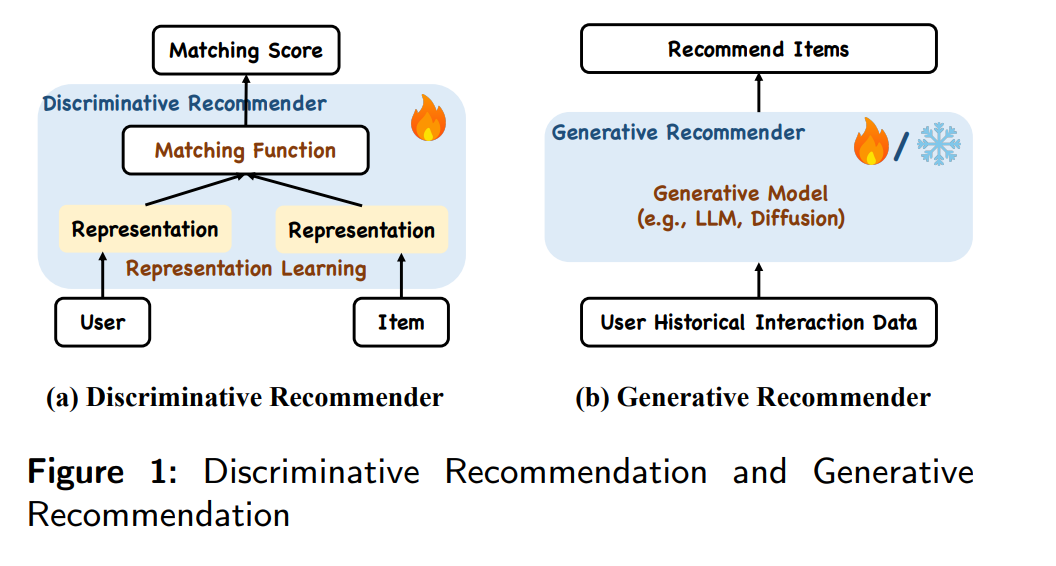

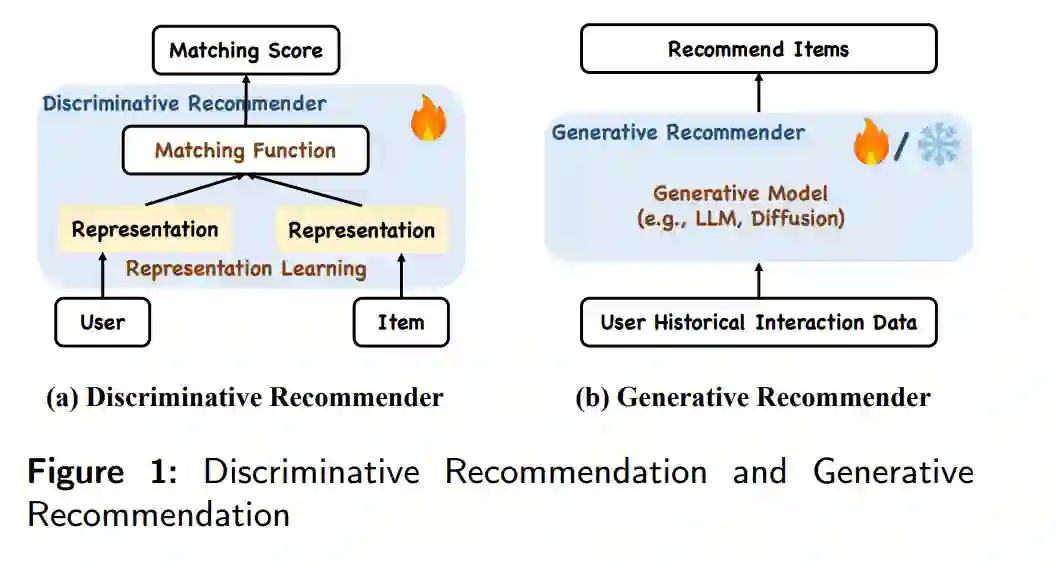

推荐系统(Recommender Systems, RSs)旨在通过对用户历史交互、用户画像以及上下文信息的建模,向用户推荐感兴趣的项目(例如电子商务商品、短视频、音乐或新闻)。推荐系统是缓解信息过载、帮助用户高效获取目标信息、并提升服务平台流量与收益的有效手段。目前,推荐系统已广泛部署于多个领域,包括电商、社交媒体、在线教育、在线视频与音乐服务,成为现代信息系统中最具普适性的用户中心型人工智能应用之一。 在过去十余年中,推荐系统取得了显著进展,这主要得益于深度学习架构的持续演进以及大规模用户行为数据的可得性提升。传统推荐系统可被视为一种判别式匹配范式(discriminative matching paradigm),其核心目标在于学习有效的用户–项目匹配函数。20 世纪 90 年代早期研究提出了启发式的基于内容(content-based)与协同过滤(collaborative filtering)方法 [146]。2000 年代,矩阵分解(Matrix Factorization) [73] 随着 Netflix Prize 的推出而广为关注,成为推荐系统发展的关键里程碑。至 2010 年代中期,卷积神经网络(CNNs)、循环神经网络(RNNs)、图神经网络(GNNs)与 Transformer 等神经架构的突破,推动推荐系统全面迈入深度学习时代。这类方法借助深度学习的强大表征能力以处理复杂数据,实现了用户–项目交互的非线性映射,并通过编码文本、图像、社交网络、知识图谱等丰富语义信息来增强用户与项目的表示学习。 尽管取得了长足进步,传统推荐系统仍面临多重挑战: * 过度依赖有限的、人工提取的语义知识; * 在小规模模型下性能不足; * 依赖固定的候选集合; * 需要任务特定的架构与训练目标; * 难以应对冷启动问题; * 缺乏透明性与上下文丰富的可解释性。

近年来,生成式模型(Generative Models)在人工智能领域取得了革命性突破,尤其是大型语言模型(Large Language Models, LLMs)与扩散模型(Diffusion Models)在人工智能生成内容(AIGC)中的崛起。借助海量预训练语料与强大的计算能力,LLMs 展现出上下文学习(in-context learning)与复杂推理(complex reasoning)等涌现能力;与此同时,扩散模型在高保真图像生成方面也取得了非凡成果。 生成式模型的出现正在推动推荐系统的范式转变:从以往的判别式匹配转向生成式推荐(Generative Recommendation)。这一新范式旨在直接生成满足用户信息需求的目标文档或项目(如图 1 所示),而非仅为候选项目打分排序。生成式推荐的引入带来了新的机遇与潜在优势,主要体现在以下几个方面: 1. LLMs 的内在能力可助力推荐系统: LLMs 拥有丰富的世界知识、语义理解、交互能力与指令遵循能力。这些特性可用于增强稀疏推荐数据、丰富项目表征、模拟用户行为以及统一跨域与跨模态的异构信息,从而缓解长期存在的数据稀疏与冷启动问题。 1. 生成式学习范式带来的建模革新: LLMs 的成功源自其生成式学习范式与可扩展性规律(scaling laws)。将生成式学习引入推荐系统,意味着从“判别式打分”向“生成式合成”转变,催生出能够捕获复杂用户–项目交互关系的强大架构,并在更大规模下展现出涌现能力(emergent capabilities)。 1. 生成式推荐推动人机交互新模式: 以 ChatGPT 为代表的生成式 AI 应用正在成为用户访问网络内容的新入口。将推荐功能与生成式交互融合,可支持对话式推荐、可解释推理与个性化内容生成等新任务范式,从而实现与生成式 AI 系统的无缝衔接。

为推动该快速发展的研究领域,本综述旨在系统回顾生成式推荐的最新进展,构建技术地图,为研究、实践与产业应用提供系统指导。

综述框架与视角

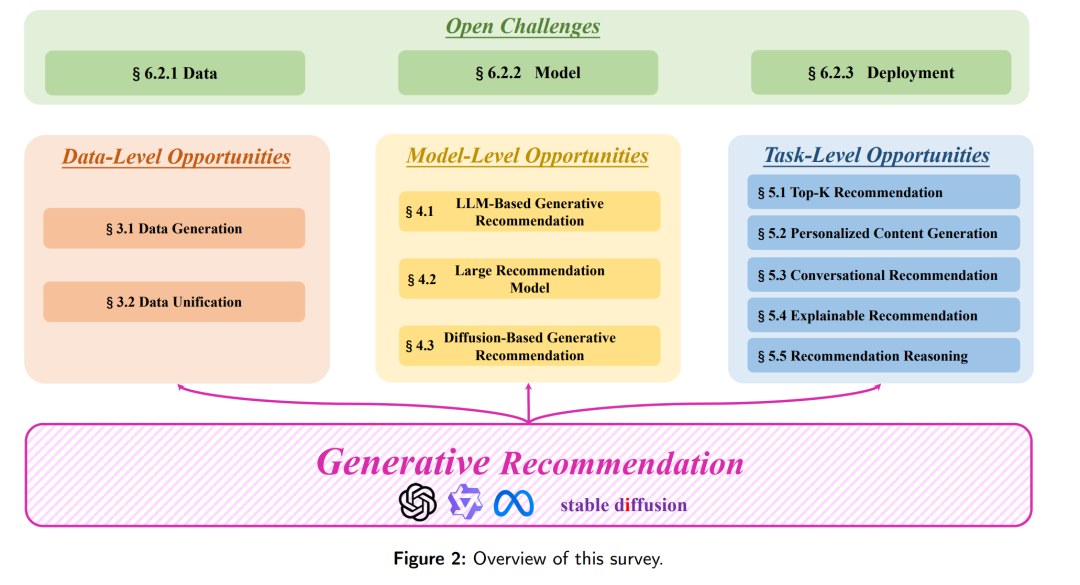

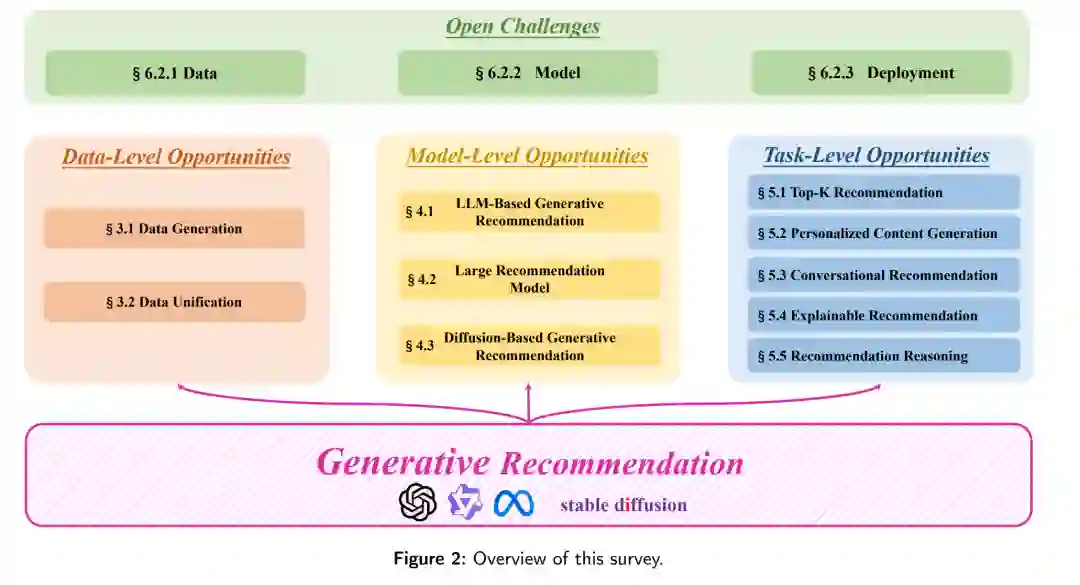

本综述从三个互补的视角组织现有研究:数据层(data level)、模型层(model level)与任务层(task level)。这一三维分类不仅反映了生成式建模对推荐系统全流程的全面影响,也提供了理解该领域发展的系统性框架。 * 数据层方法:利用生成模型增强与扩展数据空间,例如合成用户行为、生成项目属性或缓解数据稀疏问题; * 模型层方法:将生成机制直接整合入推荐架构中,使生成推理与概率建模成为核心组成部分; * 任务层方法:将生成式建模扩展到高层任务目标,如个性化内容生成、可解释推荐与对话式推荐。

这种数据–模型–任务三层结构不仅揭示了生成式推荐在端到端系统流程中的作用范围(从数据准备到模型设计与任务实现),也反映了该领域的历史演进脉络: 早期研究主要聚焦于数据层增强(如合成交互、项目生成以应对稀疏与偏差); 随后发展出模型层创新(引入生成式推理与概率机制); 近年来则出现了任务层生成(面向个性化内容、多模态推荐与可解释推理)。 三者共同构成了一个方法论深度与应用广度兼备的系统框架,标志着推荐系统从数据增强走向智能生成驱动的新阶段。

1.1. 文献收集方式(How Do We Collect the Papers?)

我们共收集了超过 200 篇与生成模型(LLMs 与 Diffusion Models)应用于推荐系统相关的论文。首先,我们检索了近三年来顶级会议与期刊,包括 ICML、ICLR、NeurIPS、ACL、SIGIR、KDD、WWW、RecSys、TKDE、TOIS 等;同时补充了 ArXiv 上的高引用率论文。 检索关键词主要分为两组: * 第一组与推荐系统相关:如 “recommendation”、“recommender system”、“user modeling”; * 第二组与生成式或基础模型相关:如 “generative”、“agent”、“large language model”、“reasoning”、“foundation model”、“retrieval-augmented generation (RAG)”; 随后通过组合这些关键词进行系统搜索,确保全面覆盖相关研究。

1.2. 本综述的贡献(Contributions of This Survey)

关于生成式推荐的研究正迅速发展。已有多篇综述回顾了该方向: Wu 等人 [187] 按照建模范式将 LLM 推荐划分为 LLM Embedding 增强型、LLM Token 增强型、LLM 作为推荐器; Lin 等人 [92] 从“在何处(where)”与“如何(how)”两个正交视角探讨了 LLM 在推荐系统中的适配方式; Zhao 等人 [233] 从预训练、微调、提示范式(prompting paradigms)三个阶段分析了 LLM 赋能推荐的研究; Deldjoo 等人 [22] 总结了基于交互的生成模型、基于 LLM 与文本数据的自然语言推荐、以及多模态生成与处理方法; Liu 等人 [106] 聚焦于多模态预训练、适配与生成技术在推荐中的应用; Li 等人 [80] 总结了基于 LLM 的生成式推荐进展,并对各类任务提出统一公式化描述; Wang 等人 [170] 探讨了学术研究到工业应用之间的差距。

然而,这些综述主要反映了 2024 年及以前的研究现状,对 2025 年新兴研究 尚有遗漏,尤其是: * 基于智能体(agent-based) 的推荐系统; * 超越监督微调(SFT) 的 LLM 推荐探索等。

本综述的主要贡献包括: 1. 更全面的生成范式覆盖:从 LLM 生成式推荐、大型推荐模型(Large Recommendation Models, LRMs)与扩散式生成推荐三方面系统梳理,并补充了近一年最新研究成果; 1. 提出数据–模型–任务框架:从数据准备、模型设计到任务创新多层面分析生成模型在推荐系统中的作用; 1. 重点关注任务层创新:探讨生成模型如何启发新的推荐场景,包括交互式推荐、对话式推荐与个性化内容生成; 1. 总结挑战与未来方向:提出未来研究路线图,为生成式推荐系统的持续发展提供最新参考。

1.3. 综述范围与组织结构(Scope and Organization)

推荐建模可从数据、模型、任务三大核心维度进行系统考察。本综述聚焦于生成模型在这三方面的变革性影响,旨在提供一个系统、全面的研究全景。其整体框架如图 2 所示: * 第 2 节:介绍推荐系统的基础与背景,对比传统判别式方法与生成式范式,阐释其关键概念与差异; * 第 3 节:综述生成模型在数据层的应用,包括特征生成、交互合成与数据整合; * 第 4 节:回顾以生成模型为核心推荐引擎的方法,分为 LLM 生成式推荐、大型推荐模型与扩散式生成推荐三类; * 第 5 节:讨论生成模型在任务层面的创新,如个性化内容生成、对话式推荐与可解释推理; * 第 6 节:总结开放挑战与未来研究方向; * 第 7 节:总结生成模型对推荐系统的总体贡献。