医学图像分割在各种医疗保健应用中起着关键作用,可实现准确诊断、治疗计划和疾病监测。近年来,视觉 Transformer (ViTs)作为一种有前景的技术,用于解决医学图像分割的挑战。在医学图像中,结构通常高度互连和全局分布。ViTs利用其多 Scale 注意机制来模拟图像中的长程关系。然而,它们确实缺乏与图像相关的归纳偏见和翻译不变性,这可能会影响它们的性能。近年来,研究人员提出了一些将卷积神经网络(CNNs)纳入其结构的ViTs基方法,称为混合视觉 Transformer (HVTs),以捕获图像中的局部相关性,并捕捉图像中的全局信息。本文详细介绍了ViTs和HVTs在医学图像分割方面的最新进展。除了对ViTs和HVTs基医学图像分割方法的分类外,作者还概述了它们在几种医学图像模式中的实时应用。本文可作为研究人员、医疗保健从业者和学生的有益资源,以了解基于ViTs的医学图像分割的最新方法。

1 Introduction

在医学图像分析中,图像分割起着重要作用。在医学图像中进行准确而高效的分割可以帮助医生识别和评估特定的解剖特征、疾病或感兴趣的区域。这些分割区域然后被分析,以估计疾病预后并制定有效的治疗策略。 在过去的十年中,利用深度学习技术在医学图像分割领域取得了显著的进步,尤其是卷积神经网络(CNNs),因为它们能够从未处理的数据中捕获复杂的模式。CNNs倾向于捕获图像中的局部相关性,这使得它们能够学习整个图像中分布的局部模式。从图像中提取2D特征的固有性质使它们优于传统方法。UNet是改变了医学图像分割任务的一类基于CNN的编码器-解码器技术。 随着时间的推移,许多UNet类似的算法被提出用于各种医学图像分割任务,在各种医学图像模式中取得了显著的改进。然而,它们在图像中的全局关系建模能力受到卷积算子的局部性质的限制。 研究人员提出了一些方法来将全局信息纳入基于CNN的分割架构中。在这方面,各种基于注意力的方法已经发展起来,以关注医学图像中的重要区域。最近,最初用于自然图像的视觉 Transformer (ViTs)在计算机视觉和医学图像分析等各种图像相关领域中取得了突出地位。 ViTs中的多 Scale 自注意力机制(MSA)具有捕获图像内全局关系的功能。基于ViTs的架构在处理各种图像模式下的复杂医学图像分割任务中取得了显著结果。ViTs固有的从医学图像中建模全局特征的能力涉及首先将图像分割成patch,然后通过他们的自注意力机制处理每个patch。然而,ViT架构不包括与图像相关的归纳偏差,以处理图像中的位置变化。此外,它们的性能可能会受到训练数据量的影响,因为ViT模型需要大量的训练数据进行学习。

近年来,将卷积神经网络(CNN)的归纳偏差集成到ViT架构中的兴趣日益增长,导致CNN-transformer的产生,也称为混合视觉 Transformer (HVTs)。这些CNN-transformer架构将ViTs的多 Scale 自注意力机制(MSA)机制与CNN的卷积操作相结合,以在图像中建模局部和全局关系。已经开发了许多新颖的框架,利用CNN-Transformer架构在医学图像分割等相关任务上展示出令人印象深刻的结果。 由于基于ViTs的医学图像分割技术迅速发展,已经进行了许多有趣的调查以回顾这些方法。这些调查大多数是针对特定器官或回顾特定模式。在本论文中,作者综合调查了各种模态的ViTs基分割方法。此外,作者将这些方法分为两类:

- ViTs基础方法

- HVTs基础方法

其次,作者为HVT设计了一个分类法,包括:

- 基于编码器的方法

- 基于解码器的方法

- 编码器-解码器集成方法

图1是本综述的具体的流程:

2. Medical Image Segmentation Overview

诊断和治疗疾病和其他医疗状况需要医学测试来帮助医生查看体内的情况。在这方面,医学影像是必不可少的,因为它允许非侵入性观察和诊断各种医疗状况。不同的成像模式提供对人类身体不同方面的独特见解。 医学图像在诊断和治疗疾病方面具有重要意义,因为它提供了有关症状的有价值信息。然而,在像素级别的医学图像检查中,只有某些区域对准确诊断和治疗有所贡献,如CT扫描中的肿瘤区域。因此,将感兴趣的区域(无论是感染区域还是异常器官)进行分割仍然是一个对研究人员来说既重要又具有挑战性的任务。准确地识别感兴趣区域是医学影像特征分割中最关键的一步,这对于辅助诊断、图像引导手术和治疗计划至关重要。图像分割包括将图像划分为根据感兴趣区域划分成几部分和目标。因此,医学影像中最重要特征分割的任务就是准确地识别感兴趣区域。 医学图像分割可以分为语义分割、实例分割和全像素分割三个子任务。语义分割通常被视为像素级别的分类,即对图像中的每个像素进行标签。实例分割检测和勾勒出图像中的每个关注项目或目标,并绘制实例的边界框。而全像素分割的目标是提供更全面的了解,通过结合语义分割和实例分割。它不仅为图像中的每个像素分配一个类别标签(如语义分割),而且还对同一类别中的不同实例(如实例分割)进行分类。 在临床病理学中,金标准是通过病理学家进行手工医学图像分析。这种手工检查涉及经过高度训练的病理学家通过视觉观察医学图像并手动勾勒或 Token 感兴趣的区域,如肿瘤、病变或特定解剖结构。这种手工评估既费时又费力,且可能受到人类主观性的影响,需要专家医生[26]。然而,数字病理学引入了一种新的范式转变,通过提供研究人员设计自动化系统的能力,实现快速、准确的诊断。这些自动化系统可以通过为病理学家提供快速诊断(可用作第二意见)来帮助他们减轻负担[27]。在医学影像的不同模式中,描述了人体内部结构。 这些模态的分割可以隔离特定器官,同时帮助在特定器官内识别疾病。 对于自动化诊断,多年来已经应用了许多传统的医学图像分割方法。这些方法包括基于区域的分割技术、边缘检测技术、统计形状模型、活动轮廓模型、阈值、聚类和机器学习方法[28]。然而,精确自动分割医学图像仍然是一个巨大的挑战,原因有:

- 医学图像中目标的大小范围很大

- 结构轮廓的歧义,以及与多样纹理变化和复杂形状相结合,容易产生不准确的结果

- 低强度对比度下从背景中隔离感兴趣目标的挑战

- 缺乏足够多的训练数据集

在过去的几年里,深度学习领域的进步,尤其是卷积神经网络(CNNs)的胜利,大大提高了医学图像分割算法的性能。基于深度学习的分割算法在具有密集标签的情况下表现出卓越的性能,特别是每个像素的标注。CNN有效地应用于医学图像分割和分类,以评估临床实践中的各种成像技术,包括超声、MRI、X光等。然而,由于卷积滤波器的限制接收域,它们无法捕获医学图像中的持久依赖关系。U-Net在该领域占主导地位,因为其高效性能和出色准确性,这得益于包括跳接连接和扩展解码器网络至今。V-Net是基于FCN的U-Net的杰出架构变体,其操作在3D中进行,以处理体积图像。 随着ViTs的出现, Transformer (Transformer)已成为执行各种与图像相关的任务的可行方法,包括图像分割、图像识别和目标检测[33]。 Transformer ,由于其学习全局上下文的能力,在精确医学图像分割方面表现出色。这导致了显著的性能改进,尤其是在具有较大感受野的器官分割中,如肺分割。 Transformer 通过自注意力机制提取全局和长期依赖关系,而CNN,具有局部感受野,通常在图像中学习局部相关性。 基于 Transformer 的方法在各种实际分割任务中已被证明非常有效,包括大脑肿瘤/组织分割,细胞核分割,结直肠癌分割,肝病灶分割,肾肿瘤分割,多器官分割,以及皮肤病变分割。最近,研究人员将两种架构相结合,以合并其优势。这些进步促进了医学图像分割领域的发展。

3 Introduction to Vision Transformers

在过去的十年里,CNN广泛应用于各种计算机视觉任务,如医学图像分析。然而,卷积滤波器的有限感受野限制了CNN在医学图像中捕捉持久依赖关系的能力,这可能会影响它们的性能。最近,Transformer和ViTs由于其出色的性能引起了研究人员的广泛关注。Transformer最初被提出用于机器翻译,但由于它们能够通过自注意力机制处理序列,因此在许多自然语言处理(NLP)任务中变得流行。 受到自然语言处理(NLP)中Transformer的成功启发,Dosovitskiy等人提出了一种ViT,用于处理图像作为一个序列的 Token (tokens),而不是一个2D像素网格。ViT架构在多个与图像相关的任务中取得了显著的成功,这鼓励研究人员使用改进的ViTs。这些改进包括更改位置编码技术、自注意力机制或创建新的架构变体。

Fundamentals of ViTs

ViTs基于Transformer架构来处理图像数据,从而颠覆了计算机视觉领域。通过将输入图像像素转换为序列,并使用自注意力机制来识别图像部分之间的长程依赖性和交互,ViT可以识别出存在于图像中的内在结构。 ViT将输入图像分割成非重叠的固定大小的 Patch ,并将每个 Patch 转换为特征表示,称为 Patch 嵌入。这些 Patch 嵌入经过线性变换,并作为 Transformer 编码器的输入 Token 。 Patch 允许模型观察整个图像并捕捉全局上下文。为了编码位置信息,在 Patch 嵌入中添加了位置嵌入。这有助于模型保持 Patch 在原始图像中的空间排列意识。 Transformer 编码器是ViT架构的基本构建模块。它包含多个MSA(多 Scale 自注意力机制)和前馈神经网络。MSA头使模型能够捕获 Patch 之间的局部和全局关系,而前馈网络引入非线性以改进特征。最后,编码器层的输出通常被池化,并添加一个分类头以进行预测。对于图像分类任务,通常在池化表示后跟随一个全连接层,其中使用softmax激活函数进行类概率预测,而对于图像分割,使用专门的解码器块以获得图像掩码。

4. ViTs在医学图像分割中的应用

ViTs在医学图像分割方面的应用取得了显著的成果。ViTs架构基于Transformer,可以处理图像数据,从而在计算机视觉领域引起了革命性的变革[13]。通过将输入图像像素转换为序列,并使用自注意力机制来识别图像部分之间的长程依赖性和交互,ViTs可以识别出存在于图像中的内在结构[49]。 ViTs将输入图像分割成非重叠的固定大小的 Patch ,并将每个 Patch 转换为特征表示,称为 Patch 嵌入[50]。这些 Patch 嵌入经过线性变换,并作为 Transformer 编码器[50]的输入 Token 。 Patch 允许模型观察整个图像并捕捉全局上下文。为了编码位置信息,位置嵌入[51]被添加到 Patch 嵌入[51]中。这有助于模型保持 Patch 在原始图像中的空间排列意识。 Transformer 编码器是ViT架构的基本构建模块。它包含多个MSA(多 Scale 自注意力机制)和前馈神经网络[52]。MSA头使模型能够捕获 Patch 之间的局部和全局关系,而前馈网络引入非线性以改进特征[52]。最后,编码器层的输出通常被池化,并添加一个分类头以进行预测。对于图像分类任务,通常在池化表示[53]后跟随一个全连接层,其中使用softmax激活函数进行类概率预测,而对于图像分割,使用专门的解码器块[53]以获得图像掩码[53]。 近年来,ViTs在医学图像分割方面取得了许多进展。一些研究人员提出了基于ViTs的医学图像分割方法,如Hybrid Vision Transformers (HVTs)[16]。这些CNN-Transformer架构将ViTs的多 Scale 自注意力机制(MSA)机制与CNN的卷积操作相结合,以在图像中建模局部和全局关系。这些新颖的框架在医学图像分割等相关任务上展示了令人印象深刻的结果[17]。 在本文中,作者对最近的ViTs基医学图像分割方法进行了详细调查。作者将其分为两类:

- 基于ViTs的方法

- 基于HVTs的方法

作者进一步将HVTs方法分为三类:

- 基于编码器的方法

- 基于解码器的方法

- 编码器-解码器集成方法

作者详细介绍了这些方法,并对其在各种医学图像模式中的实时应用进行了概述。本文可能对研究人员、临床医生等在理解基于ViTs的医学图像分割的最新方法方面具有很大的价值。 CNNs在医学图像分析中经常被用于各种应用,如肿瘤检测[54, 55],COVID-19检测[56],皮肤病变检测[57],以及分割[58]。然而,由于其感受野有限,CNNs可能难以学习显式的长程依赖性[59]。相比之下,基于ViT的医学诊断系统可以捕获大的感受野,并在各种医学图像相关任务上表现出卓越的性能[60]。 已经开发了许多基于ViT的医学图像模式系统,包括:

- 基于分类的系统

- 基于检测的系统

- 基于分割的系统

在医学影像中,对各种类型的癌变细胞的分类和检测对于病理学家及时进行疾病诊断至关重要。ViTs和更 recently 由于它们在CNNs上的明显优势,已成为高度有效的解决方案[64]。基于ViT和HVT的系统在各种医学图像分类任务上表现出显著的性能[65],包括乳腺超声图像分类[66],COVID-19检测[67, 68, 69, 70],组织学图像分类[71, 72, 73, 74],有丝分裂检测[75, 76, 77],皮肤病变检测[78, 79, 80, 81]。这些方法显著提高了医学图像分类的准确性和效率,并有可能增强临床诊断和决策。

ViT-based Medical Image Segmentation Approaches

基于分割的ViTs已经提出,可以根据其架构修改和采用的不同训练策略进行广泛分类。大多数基于ViTs的医学图像分割方法使用类似于UNet的编码器-解码器架构,其中ViT架构可以采用以下:

- 在编码器中

- 在解码器中

- 在编码器-解码器之间

- 编码器和解码器都是ViTs架构

下面对这些类别的详细信息进行讨论。

**4.1.1 ViT in Encoder

编码器-解码器架构是大多数医学图像分割技术的基石。编码器架构负责学习图像中的隐藏嵌入,然后通过解码器解码到分割掩码。为了在编码器和解码器之间实现有效信息传递,还添加了跳接连接和传统的顺序流。这些跳接路径可以是直接连接或基于CNN的处理块。许多基于ViT的医学图像分割方法在其编码器中使用ViT架构,以将全局关系融入其学习的潜在空间中。这种技术得益于ViT的MSA,可以利用全局特征,同时特征提取在编码器块中。基于CNN的解码器则利用这种高级信息进行像素级分割掩码的预测。

在Hatamizadeh等人的一项研究中,开发了一种基于Transformer的UNETR(UNet Transformer)架构,通过克服UNet的局部相关性限制,实现3D医学图像分割。它具有基于ViT的编码器,有效地捕获输入体积的多 Scale 全局信息。为了计算最终语义分割输出,编码器通过跳接连接直接链接到不同分辨率的解码器,通过跳接连接,类似于U-Net。

**4.1.2 ViT in Decoder

一些编码器-解码器技术只在其解码部分将ViT集成,以准确预测分割图像。由于全局上下文对于预测边界完美的分割掩码和区分背景和感兴趣的目标非常重要,因此MHSA在解码阶段对于这种目标非常有利。ConvTransSeg使用基于CNN的编码器进行特征学习,并使用ViT基解码器,在多个阶段链接。ConvTransSeg在二分类和多分类分割问题上显示出优越的结果,包括皮肤病变、息肉、细胞和脑组织。

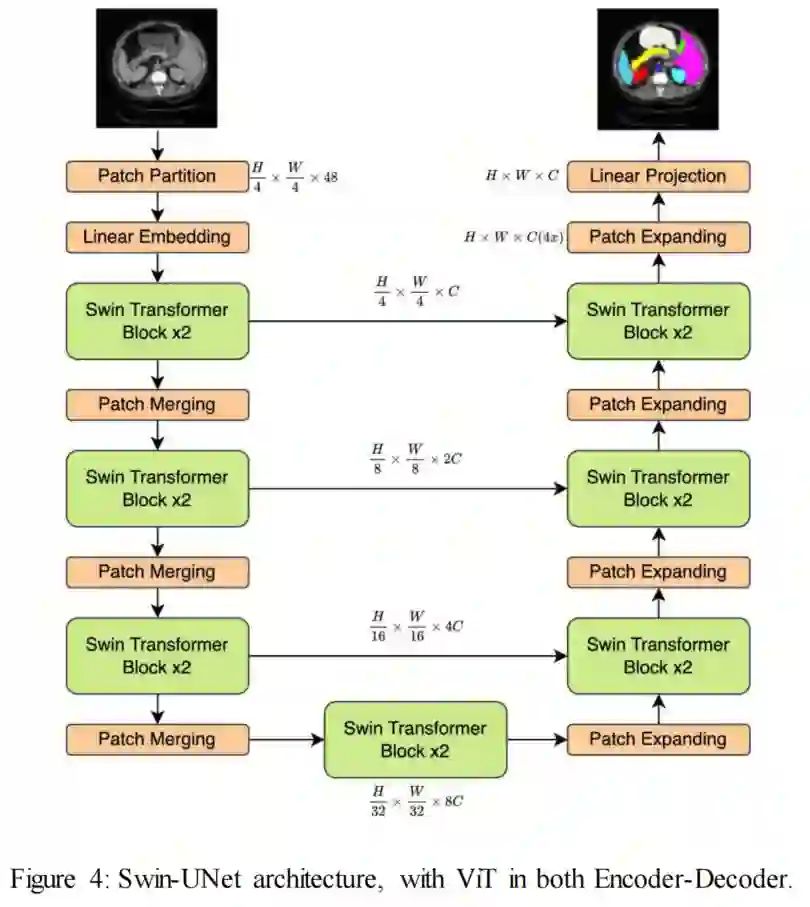

**4.1.3 ViT in both Encoder-Decoder

许多研究人员在编码器和解码器架构中都利用了ViTs,以充分利用注意力机制。Coa等人引入了Swin-Unet,用于医学图像分割。他们的架构基于Swin Transformer,其中编码器采用移位窗口方法,解码器中具有patch嵌入层。编码器和解码器架构都是分层设计的,以增强分割准确性和鲁棒性。Zhou等人提出了nnFormer,这是一种体积 Transformer 网络,用于进行分割。该架构利用基于注意力的跳接连接,以将体积图像中的局部和长期关系相结合。

此外,他们利用了体积-MSA(V-MSA)和移位版本-MSA(SV-MSA)的多头自注意力,以降低计算复杂性和捕捉多 Scale 信息。黄等人提出的MISSFormer是一种编码器-解码器架构,它融合了增强Transformer Block和增强Transformer Context Bridge,以减少计算复杂性。TransDeepLab[88]将DeepLabv3网络[89][90]与基于移位窗口的Swin Transformer相结合。它在Swin-Transformer模块内使用可变窗口大小来融合多个 Scale 上的信息。

**4.1.4 ViT in between Encoder-Decoder

李等人提出了一种基于ViTs的ATTransUNet架构,该架构利用自适应 Token 。在他们模型中,ViTs被集成到跳接连接[90]中。他们使用自适应 Token 提取模块(ATEM)在编码器中提取图像中最有判别力的视觉 Token 。这导致复杂性降低和性能增强。 在解码器架构中,他们采用了一种选择性特征强化模块(SFRM)来关注最具有贡献的特征。 双交叉注意力(DCA),这是一种简单但强大的注意力模块,可改进U-Net基础架构中的跳接连接,用于医学图像分割,由Ates及其同事提出[91]。通过从多 Scale 编码器获得的特征建模信道和空间关系,DCA在编码器和解码器特征之间建立了语义鸿沟。DCA首先使用通道交叉注意力(CCA)和空间交叉注意力(SCA)模块来建模信道和空间关系。最后,将编码器特征上采样以对应解码器的相应层。

ViT-V-Net在CNN编码器和解码器之间的瓶颈层应用ViT块,用于无监督的体积医学图像配准任务[92]。CoTr提供了一种高效的混合架构,使用CNN进行特征提取,使用可变形自注意力机制进行全局上下文建模[93]。使用的选择性多 Scale 可变形多头自注意力(MS-DMSA)减少计算复杂性,并允许更快地收敛。

Hybrid ViT-Based Medical Image Segmentation Approaches

纯粹的ViT架构,完全依赖于注意力机制,缺乏卷积运算符,可能导致低级细节丢失,从而导致不准确的分割结果。HVTs通过集成ViTs和CNN架构的优势,展示了捕获输入数据中长程和局部上下文的能力。这种独特的组合使HVTs在各种任务上都能实现尖端性能,特别是在医学图像分割方面表现尤为突出。

**4.2.1 Hybrid ViT in Encoder

最近研究中最常见的趋势是将HVTs集成到编码器阶段。TransUNet在其编码器阶段使用HVT架构,在解码器阶段使用级联上采样器[94]。它结合了ViT和U-Net的优势,捕捉输入图像中的局部相关性和长期关系,以获得准确的分割结果。Wang等人提出了一种名为TransBTS的分割架构,将ViT和3D CNN分别用于获取全局上下文信息和局部细节[95]。它处理3D医学体积数据,以捕捉图像切片中的局部相关性和长期依赖关系。TransFuse利用了一个双融合模块来结合其编码器和解码器分支,分别是CNN和ViT架构[96]。

MedT引入了一种新颖的注意力和训练策略,用于医学图像分割[97]。它包括一个全局模块(基于ViT)和一个局部模块(基于CNN)来捕捉像素中的高层次和细粒度细节。Swin-UNETR将Swin Transformer与U形架构相结合,用于分割脑肿瘤区域[98]。这涉及将输入划分为非重叠的 Patch ,并利用窗口机制。然而,将自注意力机制集成到CNN中可能导致由于空间尺寸大而计算复杂性高。在这方面,H2Former被引入,以有效结合MSA和CNN的优势,进行医学图像分割[99]。H2Former在保持模型参数、浮点运算(FLOPs)和推理时间方面的计算效率方面超过了以前的技术。

**4.2.2 Hybrid ViT in Decoder

为了在解码阶段利用Hybrid ViT的优势,近年来研究将HVT集成到解码器架构中。最近一项研究提出了一种统一的框架UNetFormer,在编码侧使用3D Swin Transformer,在解码侧使用CNN和Transformer的组合。

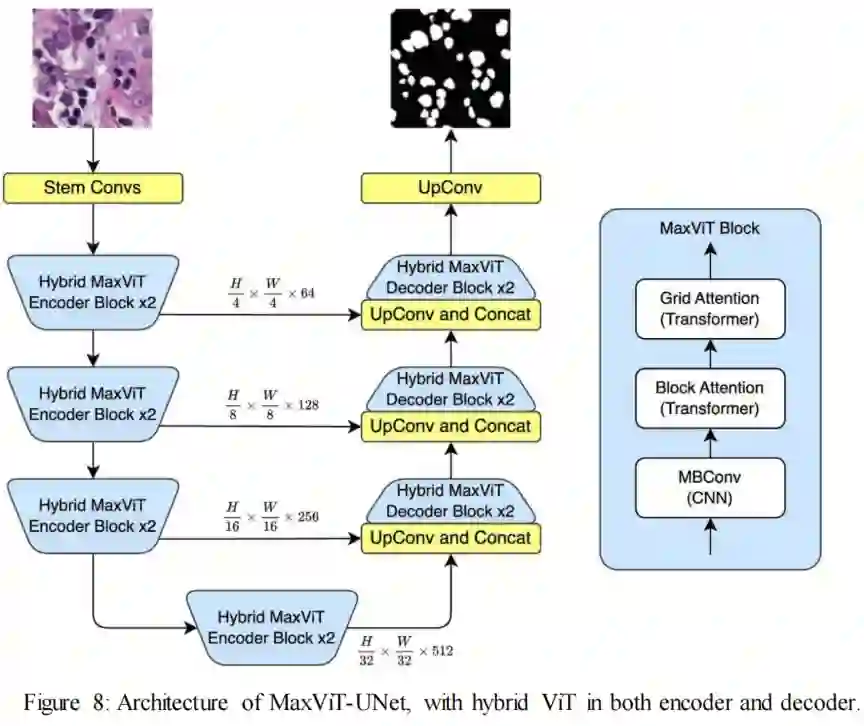

**4.2.3 Hybrid ViT in both Encoder-Decoder

许多研究人员在他们的架构中同时使用ViT和基于CNN的模块,在编码器和解码器部分。最近,MaxViT-UNet作为一种创新的高ViT-UNet解码器,专门用于医学图像分割[101]。作者有效地利用了多轴自注意力机制,允许模型在局部和全局轴上关注特征,从而增强目标和背景区域之间的判别能力,从而提高分割效率[102]。

5 ViT-based Medical Image Segmentation Applications

由于ViTs能够捕捉像素之间的全局关系,医学图像分析领域出现了指数级的增长。基于ViTs的医学图像分割可以广泛地根据特定的图像模式进行分类。这些方法包括但不限于:

- CT图像上的医学图像分割

- 组织学图像上的医学图像分割

- 显微镜图像上的医学图像分割

- MRI图像上的医学图像分割

- 超声图像上的医学图像分割

- X光图像上的医学图像分割

医学图像处理是医学分析的主要步骤,通过各种任务,如细胞计数、分类、检测和分割,促进诊断的熟练程度。然而,医学图像分割是医学诊断中最常用的任务[103, 104, 105]。

CT Images

CT(计算机断层扫描)是一种先进的医学影像技术,它使用X射线来生成详细的断层身体图像,用于疾病检测和诊断。目前,用于CT图像分割的技术大多数使用CNN,但ViTs的最近进展已经改变了这一趋势,许多针对CT模态的框架已经出现[106, 107, 108]。 TAU-Net3+用ViT替换了UNet的CNN编码器,用于肾脏肿瘤分割,并在跳接连接中添加了一种新颖的注意力机制,称为编码器-解码器 Transformer (EDformer),以学习局部特性。 为了应对在CT图像中实现准确前列腺分割所遇到的挑战,FocalUNetR引入了一种创新图像分割框架,利用一个关注 Transformer [108]。这种架构设计有效地捕获了局部视觉特征和全面上下文信息,具有高效性和有效性。作者创新地引入了一个辅助模块,称为“边界诱导的标签回归”,以补充主要的前列腺分割任务。Hoa等人提出了DBM-ViT,用于利用CT和胸X光图像对COVID-19和其他肺炎类型进行鉴别[110]。DBM-ViT中使用具有不同扩展率的逐点卷积增强了全局信息的捕捉。STHarDNet由Gu等人开发,用于进行脑出血分割[111]。在他们方法中,HarDNet和Swin Transformer被集成,以增强每个模型单独实现的分割性能。

Histopathological Images

组织病理学图像是从组织学检查样本中获得的,由病理学家用来研究细胞结构和发现显微镜异常或疾病[112]。基于组织病理学的分析对于及时的癌症诊断和预防至关重要。虽然ViTs在组织病理学图像上的应用还处于早期阶段,但它们已经在各种组织病理学分割任务上取得了有前景的结果[113, 114, 115]。 Wang等人提出了DHUnet,这是一种创新的功能融合方法,将全局和局部特征融合在一起,用于分割WSI(Whole Slide Image)。这种方法将Swin Transformer和ConvNeXt模块集成在一个双分支分层的U形架构中[116]。 另一种最近的方法是引入了具有级联上采样(SwinCup)的Swin Transformer来分割组织病理学图像[117]。为了提高SwinCup提出的特征聚合,作者引入了一个与编码器结合的级联上采样解码器。 在另一种技术中,MaxViT-UNet,作者提出了一种类似于Unet的编码器-解码器CNN-Transformer框架[101]。提出的混合解码器利用多轴自注意力(Max-SA)来提高分割结果。这些模型随后有可能在临床试验中为患者分层,为目标疗法选择患者以及个性化治疗计划做出贡献。

Microscopy Images

显微镜技术涉及使用显微镜观察微小的物体,如细胞、组织和微生物[118]。不同类型的显微镜,如光学显微镜、电子显微镜和荧光显微镜,提供了不同程度的细节和分辨率[119, 120]。皮肤病变的分割是计算机辅助诊断和治疗计划中的关键步骤。它使可以客观地识别和测量病变的大小、形状和特征,在分类良性病变和恶性病变、早期检测和监测时间变化中发挥重要作用。从ViTs在各种医学领域的成功应用中得到启示,最近的方法提出使用ViTs为基础的解决方案进行皮肤病变分割[78, 79, 80]。值得注意的是,在LesionAid框架[80]中,作者提出了一种新颖的多类预测方法用于皮肤病变,使用了ViT和ViTGAN[121]。为了解决类别不平衡问题,这些技术中使用了基于ViTs的生成对抗网络(GANs)。 视网膜血管的结构和功能改变与心血管疾病有关,包括冠状动脉疾病、动脉粥样硬化和高血压。对视网膜图像的自动分割和随后的分析对于评估和预测相关疾病至关重要,从而有助于公共卫生。在之前的视网膜血管分割研究中,各种研究方法创新地利用了 Transformer 的能力[122, 123, 124, 125, 126, 127, 128]。OCT2Former [125] 采用编码器-解码器架构,使用动态 Transformer 编码器与轻量级解码器相结合。动态 Token 聚合 Transformer 在动态 Transformer 编码器中捕获视网膜血管的全局上下文信息,而辅助卷积分支解决了 Transformer 固有的归纳偏差。Du等人提出了一种集成策略,将不同基础深度学习模型集成起来,如FCN-Transformer和金字塔视觉 Transformer (PVT),用于视网膜血管分割[124]。

MRI Images

磁共振成像(MRI)通过应用强大的磁场在人体内生成复杂的视觉表示,用于显示组织和器官。这种成像模式在检查关节、肌肉、心脏和肝脏等解剖区域时特别有价值。 近年来,ViT-based方法在心脏磁共振成像(MRI)数据分割方面的应用显著增加,如[130, 131, 132, 133]所示的方法。范等人提出了一种知识细化技术,称为视觉Transformer与特征再组合和特征蒸馏(ViT-FRD)。在他们方法中,ViT作为学生网络,吸收CNN的知识,并通过优化的蒸馏损失作为教师网络。ViT-FRD将两种改进措施纳入以提高训练效率和效果。 脑肿瘤分割的自动化和准确方法的发展有可能加速跨一系列肿瘤表型的诊断。近年来,采用Transformer-based模型有效地分割脑肿瘤的研究明显增加。例如,DenseTrans创造性地将Swin Transformer与增强的UNet++网络相结合。这种集成旨在从高分辨率层的卷积层中提取局部特征,并从Swin Transformer的位移窗口操作和自注意力机制中提取全局特征。 在3DCATBraTs的情况下,研究人员将Swin Transformer用于3D MRI图像中的脑肿瘤分割。这种Transformer包括一个修改后的CNN-encoder架构,具有残差块和通道注意力模块。此外,在不同的调查中,研究人员引入了一个强大的3D融合分割网络AMTNet,该网络基于传统的U形结构。值得注意的是,AMTNet包括一个基于Transformer的特征融合模块,旨在增强多模态特征的集成。 在利用MRI图像进行乳腺癌病变分割领域,如[139, 140, 141]等最近的研究,Iqbal等人提出BTS-ST,该方法受到Swin Transformer的启发,以增强特征表示能力,特别是对于形状不规则的肿瘤。BTS-ST创新地将Swin Transformer块中的像素级相关性编码空间知识。 为解决信息损失问题,引入了特征压缩块,并使用关系聚合块将Swin Transformer与CNN的特征进行有序的层次组合。在另一项研究中,Muller Franzes等人提出了TraBS[98],该方法增强了对多机构MRI数据中乳腺癌分割的原始SwinUNETR模型。TraBS策略性地利用非等距 Kernel 和步长在初始两阶段保持一致的深度,并集成深度监督以处理低分辨率层。

Ultrasound Images

超声或声学,使用高频声波产生器官和组织的实时图像。在产科中广泛使用,用于监测怀孕和评估胎儿发育,超声在医疗保健中占据重要地位。早期发现乳腺癌的潜力,可降低40%以上的死亡率,突显了对于医疗保健从业者进行自动化乳腺肿瘤检测的重要性。 朱等人[144]提出了区域感知 Transformer 网络(RAT-Net),该网络巧妙地将不同 Scale 的乳腺癌区域的信息集成在一起,从而实现精确的分割。同样,刘等人[145]设计了一种混合架构,将 Transformer 层集成到3D UNet的解码器部分,以便在 Voxel 乳腺数据中实现高效的肿瘤分割。LET-Net架构[146]最近提出,结合了 Transformer 和卷积方法。其特征对齐局部增强模块有助于提取独特的局部特征,同时保持与相邻级别特征的对齐。此外,逐步局部诱导解码器专注于通过一系列局部重构和细化阶段恢复高分辨率的空间细节,受自适应重构核的指导,并通过拆分注意力机制增强。 类似地,MRC-TransUNet [147] 提出了一个创新的方法,将 Transformer 和UNet组件合并。它包括一个轻量级的MR-ViT,以弥合语义差距,并利用一个相互关注模块(RPA)来抵消潜在的细节损失。这些研究努力共同表明,基于ViTs的技术具有显著提高医学图像分割准确性的潜力,并有望在各种临床应用中发挥作用。

X-Ray Images

X射线图像在诊断和治疗上都起着重要的作用,为人体内部器官提供了无价之宝的见解。现代深度学习模型可以有效地使用X射线图像来诊断各种医学疾病,它们在这个过程中的重要作用是众所周知的。 牙根分割是牙科图像分析的一个重要阶段,因为它允许牙医精确测量牙根的大小和形状,并发现可能存在的任何异常。许多最近的工作都采用了ViTs进行牙根分割[129, 149, 150]。杨等人引入了ImplantFormer,这是一个基于Transformer的种植体位置回归网络,使用口腔CT数据自动预测种植体的位置[149]。ImplantFormer使用牙齿冠部区域的2D轴向图像来预测种植体的位置,并在拟合中心线之前精确定位种植体在牙根中。在另一项研究中[151],赵等人引入了SwinUnet,这是一个专门用于全景X光片分割的U形Transformer基础架构,包括编码器、解码器和跳接连接。 乳腺X线摄影是一种特定的X射线检查方法,用于检查乳腺组织是否有乳腺癌的迹象。某些研究已经针对改进肿瘤边界分割的架构设计进行了努力[148, 152]。CSwin-PNet最近被提出用于乳腺病变分割任务。其架构基于一个金字塔网络,将CNN和Swin Transformer相结合[148]。

6 Challenges

VITs在医学图像分割方面具有巨大的潜力,可以彻底改变医学影像。通过使用Transformer,这是一种在自然语言分析中非常成功的方法,ViTs提供了一种创新的方法来分析和提取医学图像中的有价值的数据。然而,尽管它们具有潜力,但ViTs在临床设置中应用之前仍然面临许多挑战和限制。 1. 缺乏空间信息 1. 扩展性和计算成本 1. 数据稀缺和类别不平衡 1. 标注质量 1. 可解释性模型泛化

7 Future Recommendations

鉴于医学图像分割领域中视觉 Transformer 所面临的独特挑战,以下是一些可能的未来研究和创新方向: 1. 开发新的架构 1. 改进训练范式和方法 1. 探索集成方法 1. 将领域知识集成 1. 迁移学习 1. 多模态学习

8 Conclusion

基于ViTs的图像分割技术在许多与图像相关的应用中表现出优越性能,包括医学图像。ViTs中的自注意力机制使模型能够学习图像中的全局关系。本文详细讨论了几种架构修改以及一些最新的趋势和训练技术,以提高基于ViTs的医学图像分割方法的表现。 然而,ViTs缺乏捕捉医学图像中局部相关性的趋势,这可能影响其性能。因此,研究人员提出了一些利用CNNs的ViTs医学图像分割方法,以同时捕捉图像的局部和全局视角。作者还详细讨论了基于CNN和ViTs的医学图像分割技术,并按照它们在基于编码器-解码器架构中的位置进行分类。此外,作者还对各种ViTs和HVTs在实际医学图像分割应用中的使用方式进行了器官级别的概述。

参考

[1]. A Recent Survey of Vision Transformers for Medical Image Segmentation.